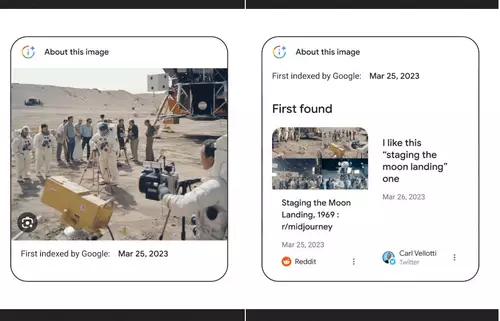

Immer mehr Menschen fallen auf KI-generierte Videoclips und Bilder herein, die viral durchs Internet jagen zuletzt etwa wurden Trampolin-hüpfende Kaninchen, scheinbar von einer Überwachungskamera gefilmt, millionenfach auf TikTok gesehen und geteilt. Die KI-Generatoren werden zunehmend besser, können teilweise auch Videos mit Ton errechnen und sind für viele nur noch einen Klick entfernt im Social-Dienst der Wahl direkt integriert. Die Flut der Fake-Bilder wir waten schon knietief darin.

Doch was heißt schon Fake? Dies wurde kürzlich Sam Altman gefragt, CEO von OpenAI, dem Unternehmen hinter u. a. ChatGPT und Sora. Seine Antwort ist gleichzeitig hanebüchen und leider realistisch. Auf die Frage, wie man in fünf Jahren noch unterscheiden soll, was echt ist und was nicht, sagt er nämlich Folgendes: "my sense is what&s going to happen is, it&s just going to like gradually converge" zu Deutsch: er denkt, es wird einfach nach und nach eins werden. Und weiter:

"Die Schwelle dafür, wie real etwas sein muss, um als real zu gelten, wird sich immer weiter verschieben." (original: "the threshold for how real does it have to be to be considered to be real will just keep moving").

Künftig soll also nicht nur die Schönheit, sondern auch die Wahrheit im Auge des Betrachters liegen rosige Aussichten fürwahr. Altman scheint es jedoch wenig zu beunruhigen, sein Argument dafür: schon jetzt seien ja Fotos beispielsweise vom iPhone nur noch größtenteils, aber nicht mehr völlig "echt", denn KI-Algorithmen bearbeiten bereits die Bilddaten, um die Resultate schöner zu machen (er spricht hier von Computational Imaging):

"There´s like a lot of processing power between the photons captured by that camera sensor and the image you eventually see. And you´ve decided it´s real enough or most people decided it´s real enough. But we´ve accepted some gradual move from when it was like photons hitting the film in a camera." (Zwischen den vom Kamerasensor eingefangenen Photonen und dem Bild, das schließlich zu sehen ist, steckt eine Menge Rechenleistung. Und Sie haben entschieden, dass es real genug ist, oder die meisten Menschen haben entschieden, dass es real genug ist. Aber wir haben eine allmähliche Veränderung akzeptiert, von der Zeit, als Photonen auf den Film in einer Kamera trafen.)

// Top-News auf einen Blick:

- Kameras, Objektive, Drohnen: Bis zu 1.530 Euro sparen bei Sony, Nikon & Co.

- Nahtloser 1-9x Zoom dank neuartiger optischer Konstruktion?

- Wenn man den Kotzschlauch sieht - Peinliche Fehler in neuer 4K Version von Mad Men

- Antigravity A1 - die erste 360° Drohne ist da

- Sony FX3 Sensor-Test - Dynamik, Debayering und Rolling Shutter

- Sony und slashCam verlosen eine FX2 Cinema Line Kamera

Nur ein gradueller Unterschied also zwischen Aufhellung, Nachschärfung und komplett KI-generiert? Aber sicher, Herr Altman. An dieser Stelle hätte bei einem echten Interview eigentlich eine kritische Nachfrage kommen müssen, jedoch fand das Gespräch im Rahmen der Podcast-Reihe "Huge If True" von Cleo Abram statt. Dabei handelt es sich um explizit "optimistische" Podcasts darüber, wie Wissenschaft und Technologie unsere Zukunft besser machen können. Mögliche negative Folgen werden dabei weitgehend ausgeklammert, was an anderen Stellen des Gesprächs zu geradezu absurden Verrenkungen führt, etwa wenn zum Schluss doch kurz thematisiert wird, dass manche KI-Forscher davor warnen, die Technologie könnte uns vernichten.

Was soll die praktische Konsequenz der Altmanschen Relativitätstheorie sein in der multimedialen Zukunft? Sollen Fake-Bilder nur noch "fake" sein, wenn sie sich fake anfühlen, aber quasi "real", wenn sie hätten echt sein können? Was reine Unterhaltungsschnipsel auf TikTok & Co. betrifft, geschenkt. Wenn echt und fake jedoch keine Kategorien mehr sind, an denen bildhafte Darstellungen gemessen werden können, sind Manipulation und Propaganda keine Grenzen mehr gesetzt. Aber hey, wird schon schiefgehen oder? Nur nicht negativ sein.

Nachfolgend das Gespräch, ab 18:35 kommt der betreffende Abschnitt (Its 2030. How do we know whats real?).