Wir hatten ja schon öfter über Nvidias Style GAN Deep Learning Algorithmus zum Generieren und Animieren berichtet und auch von Disneys Experimenten mit DeepFake-Algorithmen zur realistischen Darstellung und Animation virtueller Gesichter. Jetzt arbeitet Disneys AI Team an einer besonderen Kombination dieser Methoden mit klassischer CGI Techniken, um künstliche Gesichter auch in Filmqualität simulieren zu können.

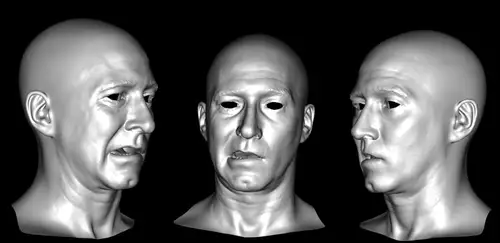

So können Gesichter mittels Aufnahmen mit mehreren Kameras inzwischen in sehr hoher Qualität digitalisiert und simuliert werden, allerdings vor allem die Hautoberfläche und das dreidimensionale Profil des Gesichts, nicht der ganze Kopf - außer den Haaren fehlen in diesen Modellen die Augen und der Mundinnenraum.

Deswegen musste beim Einsatz dieser Gesichtsmodelle in Filmen bisher viel per Hand nachträglich extrem aufwändig retuschiert und ergänzt werden, um einen realistischen animierten Kopf zu erhalten wie zum Beispiel in Star Wars die Re-Animation der mittlerweile verstorbenen Schauspieler Peter Cushing (Grand Moff Tarkin) oder Carrie Fisher (Prinzessin Leia) in kurzen Szenen. Oft trat dann der berüchtigte "Uncanny Valley"-Effekt auf, d.h. die künstlichen Gesichter sind zwar sehr realistisch, aber gleichzeitig noch nicht stimmig genug in Details wie zum Beispiel genau den Augen und dem Mund und dem dadurch und durch andere Details entstehenden Mikro-Mimikausdruck. Anstatt täuschend echt zu sein, wirken sie unheimlich (siehe dazu auch Was ist das Uncanny Valley? ).

// Top-News auf einen Blick:

- Blackmagic DaVinci Resolve und Fusion 21 Beta 2 Update verbessert u.a. Fotoverarbeitu

- Adobe kündigt Firefly AI Assistant an - Agent steuert Creative Cloud Apps per Prompt

- Tilta Khronos Cine-Adapter soll PL-Objektive an das iPhone bringen

- Manfrotto ONE: Das vielseitigste Hybrid Stativsystem für Video + Foto seiner Klasse?

- Cartoni Hyperroll - modulares Roll-Rig für kreative Kamerafahrten

- GoPro MISSION 1 Pro - 8K-Actioncam-Modelle erklärt

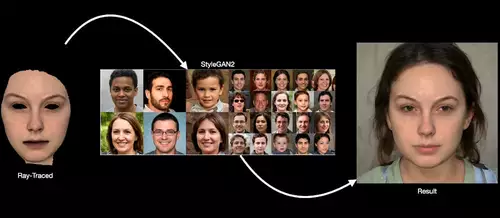

Das neue Disney-Projekt versucht jetzt, diesen letzten Schritt per KI zu automatisieren, um die hochqualitativen CGI Gesichtsrenderings mit den Stärken von Deep Learning erzeugten Gesichtern mittels Nvidias StyleGAN2 zu einem extrem echt wirkenden virtuellen Gesicht zu kombinieren - letztere krankten bisher noch an der relativ geringen Auflösung (aktuell 1024×1024) der durch sie erzeugten Gesichter. Sie liegt noch weit unter der für die Darstellung in Filmen benötigten. Oft gab es auch eine mangelnde Kohärenz über Sequenzen von Bildern hinweg, dafür brillierten sie im Gegensatz zu den CGI-Gesichtern mit ihrer realistischen Darstellung von Haaren, Augen und Mund.

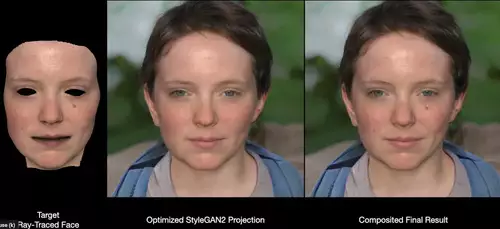

Die neue Methode fügt die per Ray-Tracing erzeugte Hautoberfläche auf das per StyleGAN2 erzeugte Gesicht samt Kopf per Compositing hinzu. Sie ermöglicht auch eine realistische Änderung der Beleuchtung der generierten Gesichter samt Augen, Haaren und Mund mit korrektem Schattenwurf -

- sowie auch komplexere Änderungen der Umgebungsbeleuchtung in Bezug auf Richtung und Farbe - der KI Algorithmus ergänzt Augen, Haare passend zur gerenderten Gesicht:

Und, ganz wichtig für das von Disney angepeilte Aufgabengebiet: die Ergebnisse sehen auch animiert zum Beispiel beim Wechsel von einer Mimik in eine andre oder beim Sprechen realistisch aus. Auch (leichte) Änderungen der Kameraperspektive können problemlos gemacht werden, bei größeren Änderungen der Perspektive allerdings neigt der Algorithmus zur Bildung von deutlich sichtbaren Artefakten. Noch ist die Methode nicht perfekt, aber ein großer Schritt auf dem Weg zu filmtauglichen künstlichen Gesichtern.