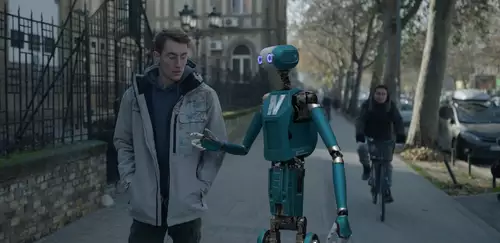

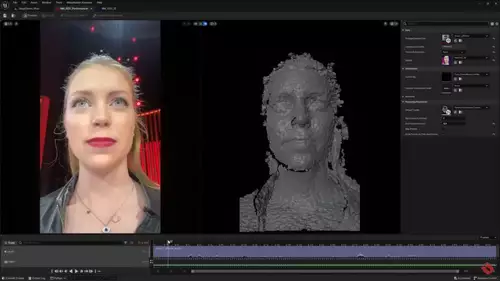

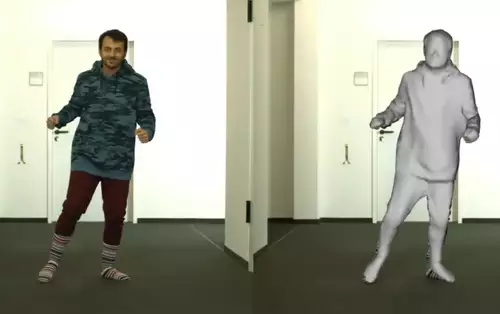

Das auf der Siggraph 2019 vorgestellt Projekt "LiveCap: Real-time Human Performance Capture from Monocular Video" realisiert die erste Echtzeit-Animation eines bewegten Menschen samt Kleidung mittels Motion Capturing anhand von ganz normalen Videoaufnahmen z.B. einer Webcam - das Verfahren nutzt also keine zweite Kamera oder eine Spezialkamera, welche Tiefeninformationen aufzeichnet.

Mittels eines Live-Videos werden die Bewegungen einer Person samt Alltagskleidung in Echtzeit gecapturet. Es wird also anders als bei klassischen Motion Capturing Verfahren kein Spezialanzug mit Marken benötigt, um die Bewegungen der einzelnen Körperteile exakt einzufangen. Auch die Verformungen der Kleidung während der Bewegungen des Menschen werden eingefangen und können per digitalem Modell verwendet werden. Die Analyse der Bewegungen samt Ausgabe des animierten digitalen Modells durch ein neuronales Netz erfolgt in Echtzeit auf einem PC mit einer CPU sowie zwei Standard-GPUs, welche parallel genutzt werden.

// Top-News auf einen Blick:

- Erste Black Friday Angebote von Atomos, Nanlite, DZOFILM und mehr

- SanDisk stellt Extreme Fit vor: Aktuell kleinster 1TB USB-C-Speicherstick

- Apple plant OLED-MacBook Pro, Mac Studio M6 Ultra und Mini-LED Studio Display

- DJI Avata 360 - Leaks zeigen DJIs neue 360°-Drohne

- ARRIs Color KnowHow könnte Millionen Wert sein - als Workflow Lizenz für Dritte

- Canon EOS C50 im Praxistest: Kompaktes Arbeitstier mit 7K 50p Raw - die neue FX3 Konkurrenz