Newsmeldung von slashCAM:Der Deutschlandvertrieb für den 4K Atomos Shogun Recorder hat uns soeben mitgeteilt, dass der Shogun eingetroffen ist und ab heute ausgeliefert wird

Hier geht es zur Newsmeldung mit Link und Bildern auf den slashCAM Magazin-Seiten:

Hier geht es zur Newsmeldung mit Link und Bildern auf den slashCAM Magazin-Seiten:

Atomos Shogun 4K Recorder wird ab heute ausgeliefert!

Antwort von Stephan_Kexel:

Hier das offizielle Vorstellungs-Video:

Viele Grüße

Stephan

Antwort von PerspectivePictures:

Achtung FS700 Users:

Our future proof platform (Powerful Generation 2 Processor, Sata 3 @ 6Gb/s, Large FPGA with upgradability) is designed for the following in the future:

12G-SDI 4K 50/60p Support

Apple ProRes HD 4:4:4 10-bit

3D LUTs

FS700 RAW decode

Full 4K - 4096 x 2160 support

Also leider noch kein FS700 RAW Support.

Antwort von Stephan_Kexel:

Das ist richtig, aber das ist schon seit September (IBC) bekannt das der RAW support für Sony und Canon erst nach der Auslieferung als

kostenloses FW update kommt.

Viele Grüße

Stephan

Antwort von mash_gh4:

Hier das offizielle Vorstellungs-Video:

schaut natürlich sehr beeindruckend aus! :)

das einzige, das mich ein wenig erschreckt, ist die unglaubliche verzögerung der monitordarstellung.

ich finde ich es allerdings ausgesprochen vorbildlich, dass derartiges in der produktpräsentation nicht vorsorglich ausgeklammert, sondern ganz offen zur schau gestellt wird. einen derart realistischen zugang würde man sich in solchem rahmen öfter wünschen. -- DANKE!

Antwort von Kranich:

Geiles Teil!

Demnächst soll ja n neuer Avid codec (DNXHR) raus kommen, da müssen die aber noch ma n update rausbringen für den Recorder?

Antwort von Fader8:

Da hat der Odyssey 7Q+ das auslieferungsfarum wohl ein bisschen angekurbelt^^

Bezgl. FS 700: warum um alles in dr Welt sollte man den shogun dem 7Q vorziehen?!

Grüsse

Antwort von Valentino:

Der Rekorder kann über einen Raid Caddy auch zwei 2,5" HDD aufnehmen.

Da bei solchen Datenraten ein Raid1 sinnlos ist, wollen die echt das man wieder Russisch Roulette im Raid0 Modus spielt?

Als ob uns nicht schon die RedDrives vor Jahren gezeigt haben, das bewegte HDDs im Raid0 definitiv keine zuverlässiges Aufnahmemedium sind.

Ich wäre als Hersteller nicht so mutig, noch so eine Speicherkombination für meine Rekorder zum empfehlen.

Warte schon auf den ersten User, der hier ein Datenverlust postet.

Antwort von PerspectivePictures:

Bezgl. FS 700: warum um alles in dr Welt sollte man den shogun dem 7Q vorziehen?!

Grüsse

Kompaktheit und Kosten.

Antwort von Bergspetzl:

Bezgl. FS 700: warum um alles in dr Welt sollte man den shogun dem 7Q vorziehen?!

Weil er schön bunt ist. :)

Zugute halten muss man ihm, dass er relativ üppig bepackt daher kommt und anscheinend out of the box (auch mit further updates) vieles mitbringt, was beim Odyssey erst teuer gekauft werden muss.

Er kann auf mehr Medien aufzeichnen, er hat Full HD, ich muss nicht teuer eine Akkuhalterung kaufen, die mit unpraktischem Mini-XLR angeschlossen wird (gibt es nicht als Winkelstecker - double shame on you). Die Menüs sehen vetrauenserweckender aus und man muss sicher nicht 10x im laufenden Betrieb einen Kaltstart hinlegen, weil das Gerät wieder einfriert oder Chaos auf dem Bildschirm veranstaltet, was vor Kunden wirklich unangenehm ist, da es den Anschein macht als hätte man nicht das Top-Produkt des Feldes vor sich, sondern irgendeinen Beta-Ramsch der Umständlich aussieht und offenbar nicht zuverlässig funktioniert. Dazu kostet der Shogun nur die Hälfte.

Bleibt abzuwarten, wie die Bildqualität ist. Was aber gar nicht geht und das Ganze zu einem Spielzeug macht ist das Delay. Ich denke einmal, das wird noch behoben sein, weil sonst ist jeder Vorzug definitiv den Bach runter.

Der 7Q ist wirklich ein guter Monitor, der auch zuverlässig aufnimmt, bei allen UI-Schwächen. Das Bild ist wirklich in Ordnung. Jedoch ist das Menü noch sehr weit von "nice" entfernt. Es macht den Anschein, als würden wir da in der Dos-Shell umhertapsen, oder im SpeedCommander anno 1998, der Shogun ist da schon eher beim Tablet angekommen. Und der 7q kostet knapp das Doppelte, ist proprietär und derweil bekleckert sich CD nicht mit Ruhm, wenn man sieht was da gerade ins Haus steht.

Gerade als Kunde der ersten Genereation (der dann ca. 6-9 Monate warten durfte) würde man sich erwarten, dass CD auf die Leute, die eh schon teuer gezahlt haben, zukommt und sie an manchen Dingen teilhaben lässt, ohne die Hand aufzuhalten. Da hat es der zweite im Feld immer leichter, und daher wird Atomos mit dem Shogun sicher einen Treffer einfahren. Und das mit wenig, aber bestimmten Aufwand, der es schafft, den 7Q auszuhebeln.

Meine Meinung :)

Antwort von Fader8:

Bezgl. FS 700: warum um alles in dr Welt sollte man den shogun dem 7Q vorziehen?!

Grüsse

Kompaktheit und Kosten.

Kompaktheit ok - obwohl der Odyssey auch nicht viel grösser sein sollte.

Kosten - nunja der shogun kostet ohne Medien sogar mehr als der Odyssey!

Ja die Lizenz brauchst du nicht, aber der Preisunterschied ist doch eher gering...aber beim Odyssey kriegst du viel mehr!

Antwort von Bergspetzl:

$1,995.00 bei BH

+2x 256 ssd ca 300

unterm strich 2000 fertig.

der odyssey kam auf 3800$, und da ist weder ein koffer dabei, noch ein passgenaues innenfutter, noch akkus/ladegerät/...

also billiger war der odyssey nie. der shogun wird in 6 monaten +- sicher auch noch einen pricedrop machen

Antwort von Valentino:

Was mich bis heute bei den ganzen SSD Rekordern wundert, warum werden von keinen Hersteller Samsung SSD unterstützt?

Weder die EVO noch die Pro Serie komprimiert intern und alle Innereien kommen aus einem Hause. Dazu sind die Samsung Pro SSD in fast jedem Test unter den "Top 3" und die EVOs kurz dahinter.

Wo hingegen gerade OCZ für interne Datenkomprimierung bekannt ist und diese gelistet werden.

Kann sich das einer erklären?

Antwort von DV_Chris:

Der Shogun kostet UVP 1.490,- netto, kann mit an jeder Ecke zu kaufenden HDD und SSD betrieben werden. Das Display hat FullHD Auflösung und ist REC709 kalibrierbar. Das Akku Konzept überzeugt seit dem ersten Shogun inklusive DTap Adapter. Ein HDMI/SDI Wandler ist integriert. Und der After Sale Support des deutschen Vertriebs ist vorbildlich.

Antwort von klusterdegenerierung:

Hat jemand einen bestellt und ein Datum bekommen?

Mein Dealer meint das es wohl vor 4 Wochen nichts wird, selbst bei vorbestellungen.

Habt ihr da was anderes gehört?

Antwort von wolfgang:

Wenn alles klappt sollte ich meinen am Ende der Woche haben. Schauen wir mal obs so kommt.

:)

Antwort von StefanFilm:

Hi, ich würde gerne etwas zu dem Thema beitragen.

Der Q7+ hat wie sein Vorgänger nur ein 1280x800pix Display.

Der Shogun 1920x1200.

Auf einem 720p Monitor 4k zu beurteilen ist schon sportlich.

Zudem kann er, trotz neuer Hardware nur 8bit 4:2:2 ProRes aufnehmen.

Ich habe den Shogun seit letzte Woche Montag und neben einigen Nachtszenen und Productshoot ein Musik Video mit der Sony A7S und dem Shogun in 4k UHD gedreht. Ist seit heute Abend online:

http://youtu.be/XXMLjBR4lzI

Zudem bereite ich gerade eine umfassende Review vor, in der ich u.a. für verschieden Kameras deren Menueeinstellung und eigenheiten zusammen mit dem Shogun erkläre.

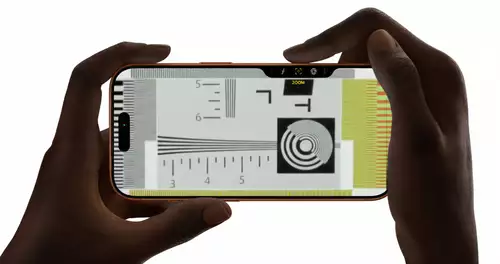

Kurze Sneak dazu:

Speziell für die beliebte Frage nach dem "sichtbaren Unterschied" von 4:2:2 zu 4:2:0 Material habe ich ein anschauliches Beispiel produziert.

Vielleicht kann ich damit ja ein paar offene Fragen beantworten.

In diesem Sinne,

Liebe Grüßen

Stefan

Antwort von klusterdegenerierung:

das einzige, das mich ein wenig erschreckt, ist die unglaubliche verzögerung der monitordarstellung.

Das ist doch kein Qualitätsmerkmal!

Das hat doch nur was damit zu tun, ob Du Dir das Signal anguckst welches Du gerade aufnimmst, oder gerade aufgenommen hast.

Ist eine Einstellungssache.

Antwort von Bergspetzl:

Stephan_Kexel hat folgendes geschrieben:

das einzige, das mich ein wenig erschreckt, ist die unglaubliche verzögerung der monitordarstellung.

Das ist doch kein Qualitätsmerkmal!

Das hat doch nur was damit zu tun, ob Du Dir das Signal anguckst welches Du gerade aufnimmst, oder gerade aufgenommen hast.

Stimmt, wenn ich ihn wegklappe, und nur als Rekorder mit optischer Wiedergabemöglichkeit betrachte, ist das richtig. Dann habe ich Glück gehabt und kann mit einen günstigen Odyssey 7 (ohne Q) kaufen, da ich ja nur noch einen Bildschirm benötige. Die Welt ist so schön...

:)

ich glaube nur nicht dran...

Antwort von mash_gh4:

hat jemand hier in der runde eine erklärung für die bereits angesprochene verzögerungsproblematik?

ist das ein problem, das sich nur im konkreten zusammenspiel mit der GH4 ergibt bzw. deren mängel geschuldet ist, oder aber ist es tatsächlich charakteristisch für den shogun?

ich halte das leider für ein qualitätsmerkmal, das sich beim praktischen arbeiten ausgesprochen störend bemerkbar machen dürfte. so etwas kann das schönste geräte mit den tollsten und umfangreichsten anderen technischen features beinahe unbrauchbar erscheinen lassen.

ich kenne solche einschränkungen vor allem von WLAN bedienungslösungen. die sind aus diesem grund in meinen augen auch nicht viel mehr als ein lustiges spielzeug, so lange es nicht befriedigender funktioniert. (im gegensatz zu externen all-in-one lösungen tut sich dort prinzipbedingt aber wenigstens auch die möglichkeit auf, die kamera sehr effizient zu steuern bzw. nicht alle mess- und aufnahmeeinstellungen unnötig zu verdoppeln)

die GH4 hat bekanntlich noch immer ganz grobe probleme mit der synchronität der tonspur, was sicher mit ein wichtiger grund sein könnte, externen aufzeichnungen von ton und bild anzustreben; trotzdem muss jede diesbezügliche lösung einfach kompromisslos sauber und reibungslos funktionieren, sonst ist sie solche summen nicht wert.

Antwort von chackl:

Kann das Ding eigentlich anamorph entzerren?

Antwort von Stephan_Kexel:

Hier das offizielle Vorstellungs-Video:

schaut natürlich sehr beeindruckend aus! :)

das einzige, das mich ein wenig erschreckt, ist die unglaubliche verzögerung der monitordarstellung.

ich finde ich es allerdings ausgesprochen vorbildlich, dass derartiges in der produktpräsentation nicht vorsorglich ausgeklammert, sondern ganz offen zur schau gestellt wird. einen derart realistischen zugang würde man sich in solchem rahmen öfter wünschen. -- DANKE!

Die Verzögerung kommt von dem GH-4 Ausgang und nicht vom Shogun.

Schließt man die GH-4 direkt an einen 4K Monitor an ist die Verzögerung 100% gleich.

Viele Grüße

Stephan

Antwort von Manuell:

Der Shogun macht echt einen tollen Eindruck:

- 4K Rekorder

- sehr sehr guter Monitor

- Audio-Rekorder

- SDI zu HDMI Konverter

- HDMI zu SDI Konverter

- eigenständiges Abspielgerät

Überlege mir den für meine Blackmagic Production Cam zu kaufen, obwohl ich die 4K Aufzeichnung nicht bräuchte finde ich die restlichen Funktionen einfach top und ich spare mir die Fummelei mit mehrern Geräten. Quasi alles in einem. Finde knapp unter 1800,- Euro Brutto auch nicht zu teuer für das Gebotene.

Antwort von Skeptiker:

Hi, ich würde gerne etwas zu dem Thema beitragen. ...

Für Infos die wir hier schon alle duch haben, meldest Du dich extra an?

Wow!

@klusterdegenerierung:

Was für eine unfreundliche, stillose Art, einen Neuankömmling im Forum zu begrüssen!

Und ist es wirklich so, dass wir schon alle Infos durch haben, wenn StefanFilm z.B. schreibt:

... Speziell für die beliebte Frage nach dem "sichtbaren Unterschied" von 4:2:2 zu 4:2:0 Material habe ich ein anschauliches Beispiel produziert. ...

Ich bin jedenfalls daran interessiert.

Antwort von Asahi:

gibts jetzt auch tatsächlich die ersten überteuerten ebay angebote....

Antwort von CameraRick:

... Speziell für die beliebte Frage nach dem "sichtbaren Unterschied" von 4:2:2 zu 4:2:0 Material habe ich ein anschauliches Beispiel produziert. ...

Ich bin jedenfalls daran interessiert.

Schon irgendwo, wobei ich das auch irgendwie immer etwas fraglich finde. Ein sichtbarer Unterschied (unbearbeitetes Material) ist mir da noch nie aufgefallen.

Wen interessiert der sichtbare Unterschied - es geht um Information, haben oder nicht. Wenn Du Dein Footage nur verschneidest und nichts anderes damit machst (Farb/Kontrast/Helligkeitskorrekturen etc) kann einem doch völlig egal sein, da reicht im Zweifel immer 420 in 8bit.

Sieht halt an dem Punkt anders aus, wenn Du etwas am Footage drehst (bzw auch wie viel, versteht sich).

Antwort von mash_gh4:

Die Verzögerung kommt von dem GH-4 Ausgang und nicht vom Shogun.

Schließt man die GH-4 direkt an einen 4K Monitor an ist die Verzögerung 100% gleich.

ich hab's befürchtet! :(

auch besitzer des YAGH haben immer wieder von ganz ähnlichen problemen berichtet.

für GH4-besitzer ist das natürlich keine besonders erfreuliche nachricht, weil damit auch alle ähnlichen lösungen nicht besser funktionieren dürften, aber zumindest ist es fein, wenn die schuld dafür nicht bei eurem jüngsten kind gesucht werden muss.

danke!

Antwort von wolfgang:

Wen interessiert der sichtbare Unterschied - es geht um Information, haben oder nicht. Wenn Du Dein Footage nur verschneidest und nichts anderes damit machst (Farb/Kontrast/Helligkeitskorrekturen etc) kann einem doch völlig egal sein, da reicht im Zweifel immer 420 in 8bit.

Sieht halt an dem Punkt anders aus, wenn Du etwas am Footage drehst (bzw auch wie viel, versteht sich).

Alles schön und gut, aber wenn man das Material nicht bearbeiten will wird man sich kaum die Mühe für 10bit 4:2:2 antun. Aber wenn man entsprechend Luma- und Farbkorrekturen machen will, dann hat man damit halt bessere Karten - einfach weil man weniger Rauschen ins Material im Zuge der Bearbeitung einbringt.

Und wer Banding kennt hat auch ein gutes Beispiel dafür, wo man halt auch im Fall ohne Bearbeitung entsprechend anstehen kann.

Aber das ist alles eine Frage des Anspruchs. Es muss ja keiner Rekorder wie den Shogun nutzen - ist eine freiwillige Entscheidung.

Antwort von domain:

Aber das ist alles eine Frage des Anspruchs. Es muss ja keiner Rekorder wie den Shogun nutzen - ist eine freiwillige Entscheidung.

Stimmt, denn die Anforderungen bei Erstkommunions- und Hochzeitsvideos sind bekanntlich besonders hoch. Da hast du sicher gut investiert ;-)

Antwort von Elsalvador:

Zudem bereite ich gerade eine umfassende Review vor, in der ich u.a. für verschieden Kameras deren Menueeinstellung und eigenheiten zusammen mit dem Shogun erkläre.

Kurze Sneak dazu:

Hallo Stefan,

willkommen im Forum. Freu mich auf die Review.

Gruß aus Bockenheim ;)

Antwort von mash_gh4:

Die Verzögerung kommt von dem GH-4 Ausgang und nicht vom Shogun.

Schließt man die GH-4 direkt an einen 4K Monitor an ist die Verzögerung 100% gleich.

nachdem es mir keine ruhe gelassen hat, weil es bisher nie so störend ins auge gefallen ist, hab ich das jetzt schnell empirisch überprüft:

meine GH4 zeigt bei interner aufnahme und ausgabe auf einen 1080p schirm ziemlich genau 3 frames verzögerung bei 25fps. der wert ändert sich auch nicht, egal ob man in 4K oder FHD aufnimmt.

in eurem video sind es aber zumindest 9 frames verzögerung -- fast eine halbe sekunde! :(

das ist schon ein gewaltiger unterschied!

natürlich nerven auch schon die besagt 3 frames, aber mit fast einer halben sekunde monitorverzögerung kann man meiner erfahrung nach wirklich kaum mehr flott scharfstellen oder schwenks präzise ausführen. da mag das display noch so schön groß und bunt sein.

ich kann mich noch sehr gut daran erinnern, wie erstaunt ich darüber war, dass das eingebaute display der GH4 in dieser hinsicht so viel besser funktioniert als ich es von vorgängern her gewohnt war. genau deshalb weiß ich ja leider auch, welche praktischen auswirkungen derartige ergonomische mängel nach sich ziehen. in diesem punkt möchte ich vermutlich wirklich keinen derart einschneidenden rückschritt hinnehmen.

Antwort von Stephan_Kexel:

Die Verzögerung kommt von dem GH-4 Ausgang und nicht vom Shogun.

Schließt man die GH-4 direkt an einen 4K Monitor an ist die Verzögerung 100% gleich.

meine GH4 zeigt bei interner aufnahme und ausgabe auf einen 1080p schirm ziemlich genau 3 frames verzögerung bei 25fps. der wert ändert sich auch nicht, egal ob man in 4K oder FHD aufnimmt.

in eurem video sind es aber zumindest 9 frames verzögerung -- fast eine halbe sekunde! :(

das ist schon ein gewaltiger unterschied!

Also unsere 2 GH4 zeigen über die 4K Ausgabe (nicht 1080P) an einem 4K Monitor das gleiche delay wie in unserem Video in dem Shogun zu sehen ist.

Mehr kann ich dazu nicht sagen.

Antwort von Bergspetzl:

das kann man einfach testen:

youtube timecode aufrufen, kamera darauf fixieren und foto wo beide displays zu sehen sind.

dann sieht man genau den versatz.

etwas sowas

bei der fs700 sinds via hdmi zum alphatron 1,5 frames. und man hat schon das gefühl es ist wirklich ein delay da...

Antwort von DV_Chris:

Aber das ist alles eine Frage des Anspruchs. Es muss ja keiner Rekorder wie den Shogun nutzen - ist eine freiwillige Entscheidung.

Stimmt, denn die Anforderungen bei Erstkommunions- und Hochzeitsvideos sind bekanntlich besonders hoch. Da hast du sicher gut investiert ;-)

Einfach mal nach der kroatischen Firma Art Studio googeln. Deren Hochzeitsvideos halten locker mit Mittelstandsproduktionen mit. Die können den Shogun gut gebrauchen. Ebenso viele Mitglieder der WEVA.

Antwort von klusterdegenerierung:

Einfach mal nach der kroatischen Firma Art Studio googeln. Deren Hochzeitsvideos halten locker mit Mittelstandsproduktionen mit. Die können den Shogun gut gebrauchen.

Jo!

http://www.art-studio.tv/v2011/

Oder auch 2 oder 3! :-)

Doch auch wenn die wirklich hohe Qualität liefern, bei wedding weiß man immer was kommt, ist es noch so gut umgesetzt! Ich kann quasi mitzählen, ab wann der Mann seine Krawatte beginnt zu binden, irgendwie auch schade, weil auch wenn die rumsliden wie Niki Lauda, es ist immer der gleiche Film!

Antwort von Jensli:

Einfach mal nach der kroatischen Firma Art Studio googeln. Deren Hochzeitsvideos halten locker mit Mittelstandsproduktionen mit. Die können den Shogun gut gebrauchen.

Jo!

http://www.art-studio.tv/v2011/

Oder auch 2 oder 3! :-)

Doch auch wenn die wirklich hohe Qualität liefern, bei wedding weiß man immer was kommt, ist es noch so gut umgesetzt! Ich kann quasi mitzählen, ab wann der Mann seine Krawatte beginnt zu binden, irgendwie auch schade, weil auch wenn die rumsliden wie Niki Lauda, es ist immer der gleiche Film!

Hab mir die auch angeschaut. Oberflächlich betrachtet, wirklich tolle Aufnahmen. Inhaltlich jedoch immer das Gleiche. Sogar ihre Imageclips für Hotels drehen sie wie einen Hochzeitsfilm. Nach zwanzig Jahren Weddingfilm kein Wunder. Da sieht irgendwann alles aus wie ein Weddingfilm... ;-)

Antwort von mash_gh4:

Also unsere 2 GH4 zeigen über die 4K Ausgabe (nicht 1080P) an einem 4K Monitor das gleiche delay wie in unserem Video in dem Shogun zu sehen ist. Mehr kann ich dazu nicht sagen.

naja -- die konkurrenz behauptet, dass sie 5 frames verzögerung am HDMI ausgang der GH4 sehen. sollte das stimmen -- ich glaub ja mittlerweile gar nichts mehr, bevor ich es nicht selbst ausprobiert habe ;) -- würde etwa die hälfte des problems der firma panasonic zuzuschreiben sein, die andere hälfte aber weiterhin als dringendes verbesserungspotential auf seiten von atomos offen bleiben.

ich würde es ohnehin für recht erfreulich halten, wenn auch panasonic durch diese aktuellen entwicklungen ein bisserl unter druck geraten würde, ewig vor sich her geschobene objektive mängel endlich auszumerzen und die tatsächlichen wünsche ihrer kunden ernst zu nehmen. immerhin ist der shogun sicher ein ganz brilliantes demonstrationsobjekt, wenn man zeigen will, wie ein YAGH aussehen hätte müssen, damit er/es wirklich ein erfolg geworden wäre.

jedenfalls ist es -- wie bergspetzl schon geschrieben hat -- ausgesprochen trivial, entsprechende verzögerungen einigermaßen objektiv nachzuvollziehen. (man muss nur drauf achten, dass man den eingeblendeten zeit- und frameangaben nicht zu viel glauben schenkt, sondern wirklich die einzelnen bilder durchgeht)

der monitor, mit dem ich das hier ausprobiert habe, besitzt übrigens einen lag von ~0.25 frames -- obwohl es wirklich nur ganz billiger schrott ist ;)

Antwort von wolfgang:

Aber das ist alles eine Frage des Anspruchs. Es muss ja keiner Rekorder wie den Shogun nutzen - ist eine freiwillige Entscheidung.

Stimmt, denn die Anforderungen bei Erstkommunions- und Hochzeitsvideos sind bekanntlich besonders hoch. Da hast du sicher gut investiert ;-)

Tja nur wer sagt dir den, dass bei mir der Shogun überhaupt für diese Videos überhaupt zum Einsatz kommen wird?

Erstkommunionsvideos mache ich schon seit Jahren nicht mehr - weil abgrundtief schlecht bezahlt. Hier auf UHD mit 10bit 4:2:2 zu gehen, würde heißen mit Kanonen auf Spatzen zu schießen.

Für Hochzeitsproduktionen kann man das (in Grenzen) durchaus anders sehen - denn ein Teil dieses Marktes ist sehr qualitätsbewußt (und die fahren auf so Spezialitäten wie 3D-Hochzeiten oder 4K-Hochzeiten durchaus ab). Aber auch da muss man erst diese Kunden haben und diesen Markt bedienen wollen.

Antwort von wolfgang:

Zurück zum Thema - die Konfusion darüber, dass über hdmi 1.4b offenbar doch UHD mit 10bit 4:2:2 transportiert werden kann, zieht sich im Moment wie ein roter Faden international durch alle Foren.

Sowohl Atomos wie auch Convergent Design bestätigen aber, dass dies bis zu 30p möglich sei.

Wer sich für die internationle Diskussion interessiert, der findet hier mal relevante Zitate:

http://www.videotreffpunkt.com/index.ph ... geht-doch/

Antwort von iasi:

der Shogun bietet all-in-one

und dazu scheinbar noch in guter Qualität

Timecode?

Wozu?

Der Shogun besitzt XLR-Eingänge und kann also eine weitere Tonspur aufzeichnen.

Mittlerweile sind Rechner ausreichend schnell, um auch zwei gleiche WAV-Dateien synchronisieren zu können.

Timecode ist also entbehrlich geworden.

Ich kann mir auch keine Situationen vorstellen, bei denen eine Verzögerung von 5fps nun wirklich dramatisch wären.

Wichtiger erscheint mir da doch schon eher die Einsparung während des Drehs durch die Konzentration von Funktionen auf möglich wenig Geräte.

Weniger Kabel, weniger Akkus, weniger ...

Der Shogun ist ein guter Monitor, der eben auch Ton und Bild aufzeichnen kann - tolle Sache.

Und dabei verschlingt er nicht einen derart großen Batzen am Investitionsbudget, wie die Konkurrenzprodukte.

Es ist zudem auch immer eine Frage der Relationen:

Eine 1500-Kamera und ein 3000-Rekorder?

Macht das überhaupt Sinn?

Der Shogun ergibt als Monitor/Rekorder-Kombination für den Preis, schon eine andere Relation.

Wer zudem wirklich denkt, er könne nur mit einem prall gefüllten Techniktransporter arbeiten, der sollte sich doch auch mal fragen, ob die Technikschlacht eigentlich wirklich noch einen Effizienzvorteil bringt.

Antwort von mash_gh4:

das problem ist einfach, dass es funktionieren muss!

Timecode?

Wozu?

Der Shogun besitzt XLR-Eingänge und kann also eine weitere Tonspur aufzeichnen.

ja -- aber vermutlich nur mit 5 frames zeitversatz, weil er das bild ja nicht früher von der kamera bekommt. und diese 5 frames gelten auch wieder nur für genau dieses eine spezielle gegenüber. bei einer anderen quelle sind es möglicherweise nur 3 od. vielleicht 6, jedenfalls wird es ohne umständliche kalibration kaum lippensynchron ausfallen.

genau dieses problem kennen sorgsame GH4 benutzer aus leidervoller erfahrung bereits sehr genau. bei dieser kamera weicht nämlich die tonspur auch schon bei interner aufnahme deutlich vom bildgeschehen ab. und noch unguter ist die ganze geschichte, weil es offenbar je nach verwendeter software (mainconcept vs. avlib) in unterschiedlicher ausprägung zu tage tritt. :( (einfach danach googlen, dann findest unzählige beschwerden dazu)

der shogun würde sich hier also geradezu anbieten, um diesem problem zu entkommen. aber so wie es sich momentan darstellt, dürfte es dadurch nur noch schlimmer werden.

Mittlerweile sind Rechner ausreichend schnell, um auch zwei gleiche WAV-Dateien synchronisieren zu können.

Timecode ist also entbehrlich geworden.

ja -- aber dazu benötigst du irgendeine referenzquelle, auf die man sich verlasssen kann. dass ist leider im falle der GH4 nichteinmal intern gegeben. :(

Ich kann mir auch keine Situationen vorstellen, bei denen eine Verzögerung von 5fps nun wirklich dramatisch wären.

beim ton stört schon dieses interne abweichung von ~1 frame.

was die verzögerung des shogun displays betrifft geht es aber um 9 frames! das ist zwar für die aufzeichnungsqualität nicht von relevanz, schlägt sich aber bestimmt außerordendlich störend auf die praktische anwendung beim filmen nieder. mit einem derart verzögerten monitor-bild kann man kaum ernsthaft arbeiten. da mag es auf den ersten blick noch so schön aussehen.

Wichtiger erscheint mir da doch schon eher die Einsparung während des Drehs durch die Konzentration von Funktionen auf möglich wenig Geräte. Weniger Kabel, weniger Akkus, weniger ...

da gebe ich dir insofern recht, als wir uns wahrscheinlich alle wünschen würden, dass ein großteil der funktionalität dieses geräts einfach auch intern in den entsprechenden kameras angeboten würde. dort könnte man sich bei passender gelegenheit immer noch einen externen monitor dranhängen, oder die speicherkapazitäten durch externe disks erhöhen, wäre aber prinzipiell nicht auf ein weiteres gerät angewiesen. so aber kommt doch nur wieder eine weitere fehlerquelle dazu, von der plötzlich alles andere abhängt.

Der Shogun ist ein guter Monitor, der eben auch Ton und Bild aufzeichnen kann - tolle Sache.

Und dabei verschlingt er nicht einen derart großen Batzen am Investitionsbudget, wie die Konkurrenzprodukte.

naja -- ganz geschenkt ist er auch nicht. immerhin teurer als manche kameras, an denen man ihn verwenden wird. wobei man natürlich z.b. für gute optiken auch immer wieder größere summen hinlegen muss. aber auch dort geht's schließlich nur darum, dass man wirklich jene qualität bekommt, die man sich dafür erwartet.

Antwort von Bergspetzl:

c'mon. neun Frames delay! wenn sie das nicht fixen, dann ist das ding an der cam für die katz.

Bei jeder anderen cam mag er ja funktionieren, aber neun frames an einer dslr, da hat panasonic dringenst nachholbedarf. Wie soll man denn da drehen?? ist ja für alles ausser megaszenisch nahezu unbrauchbar. und auch da müsste man jeden schauspieler soweit biegen dass er auf keinen fall von seinen vorgegebenen schärfenpunkten abweichen darf. zu keiner zeit. was soll das denn?

da können die knöpfe noch so bunt sein, aber wenn atomos das nicht vorne als warnhinweis abdruckt wäre das schon fast ein fall für den verbraucherschutz...polemisch jetzt...

allerdings kann man so mal wieder beweisen, wie man zu seinen produkten und kunden steht, und wann dieses problem gefixt wird. immerhin ist die gh4 ja die killerapplikation für den rekorder zur zeit, das ist wie das fs700 raw, ohne den sicher nur 50% soviele odyssey verkauft worden wären...

Edit: wozu timecode? da hätte ich mehr erwartet...

Antwort von -paleface-:

Also ich finde das Teil auf dem Papier gut.

Habe ihn bestellt und hoffe auf gutes.

Das Delay kann nerven, ja. Aber ich für meinen Teil werde eh weiterhin auf den normalen Sucher schauen. Weil ich viel vom Rig aus mache.

Denke ausserdem das die positiven Dinge den negativen überwiegen.

Alleine das ich jetzt mehr als 30min kontinuierlich aufnehmen kann ist schon sehr geil.

Antwort von -paleface-:

Ach und ich bin auf Tests gespannt wo das Rauschverhalten im dunkeln vergliechen wird.

Mir wurde mal gesagt das die Cam theoretisch weniger rauschen sollte bei schwarz.

Antwort von DV_Chris:

In meiner Eigenschaft als Händler darf ich die frohe Kunde bringen, dass wohl alle Vorbestellungen bis Weihnachten beim Händler der Wahl eintreffen werden und der Shogun ab nächste Woche auch ab Lager Deutschland verfügbar ist :-)

Antwort von iasi:

@mash_gh4

ja - da hast du recht:

wenn der Shogun das Bild mit Versatz erhält, ist es mit Bild-Ton-Sync vorbei - höchstens es wird eine Ausgleichseinstellung geboten.

So bliebe dann nur die zusätzliche Ton- und Bildaufnahme in der Kamera für Synchronisationszwecke - und beim Bild als Backup.

Das treibt den Aufwand leider auch etwas in die Höhe (auch wenn die kamerainterne Tonaufnahme nicht beste Qualität haben muss) ... in der Post hat man dann zumindest mit einer zusätzlichen Bildspur zu hantieren.

9fps Delay ???!!!

Woher hast du das denn?

Das wäre schon ziemlich heffffftig.

Bleibt auch die Frage, ob"s dann mit allen Cams so ist.

Antwort von domain:

Ja sagt mal, welche Maßstäbe setzt ihr denn hier?

Ein Delay darf sich überhaupt nur innerhalb eines Frames bewegen. Was soll denn die ganze Diskussion hier, wir befinden uns im Hightech-Zeitalter mit ultraschnellen Reaktionszeiten.

Wenn die hier diskutierten Delay-Zeiten realistisch sind, dann ist die Technik jedenfalls mal unausgereift und hinterwäldnerisch.

Antwort von mash_gh4:

9fps Delay ???!!!

Woher hast du das denn?

Das wäre schon ziemlich heffffftig.

schau dir einfach das eingangs hier vorgestellte offizielle video (http://vimeo.com/114644960) ab 13:50 an und zähl selber die frames...

aber, sie werden das schon noch irgendwie hinbekommen. ;)

es macht jedenfalls keinen sinn, die sachen unnötig schlecht zu reden...

nur geht's hier halt um dinge, die für eine zufriedenstellende nutzung ganz essentiell sein dürften.

Antwort von wolfgang:

Speziell für die beliebte Frage nach dem "sichtbaren Unterschied" von 4:2:2 zu 4:2:0 Material habe ich ein anschauliches Beispiel produziert.

Das wäre absolut gut sowas zu sehen.

Denn: es gibt doch etliche Leute die unverändert nicht glauben, dass eine wirkliche UHD Ausgabe mit 10bit 4:2:2 über HDMI 1.4b möglich ist. Die Zweifel kommen aus der Richtung, dass dies die Schnittstelle eigentlich nicht können dürfte.

Nur: auch Convergent Design hat recht klar gepostet - Links siehe oben - dass sie das können. Atomos hält sich hier (leider) bisher viel bedeckter.

Nicht dass ich das nicht glauben würde - auch wenn mir mal wieder irgendwer Leichtgläubigkeit vorhalten mag. Aber es wäre gut wenn es auch von Atomos eine ganz klare Stellungnahme dazu geben würde dass dies eben mit dem Shogun möglich ist. Und es wäre sehr gut anschauliche Beispiele zu haben anhand derer der Unterschied erkennbar wird.

Leider habe ich selbst das Gerät noch nicht - bin gespannt ob das bis Weihnachten klappt. Und ganz so einfach stelle ich mir diesen Nachweis halt auch nicht vor - ohne entsprechende Messgeräte. Aber wenigstens ein optischer Nachweis wäre toll.

Antwort von iasi:

9fps Delay ???!!!

Woher hast du das denn?

Das wäre schon ziemlich heffffftig.

schau dir einfach das eingangs hier vorgestellte offizielle video (http://vimeo.com/114644960) ab 13:50 an und zähl selber die frames...

aber, sie werden das schon noch irgendwie hinbekommen. ;)

es macht jedenfalls keinen sinn, die sachen unnötig schlecht zu reden...

nur geht's hier halt um dinge, die für eine zufriedenstellende nutzung ganz essentiell sein dürften.

na ja - dies scheint aber wohl nur bei der Ausgabe auf einen Monitor der Fall zu sein - da mit dem Playback wohl eh noch Probleme bestehen, könnte es daher rühren.

Antwort von CameraRick:

Alles schön und gut, aber wenn man das Material nicht bearbeiten will wird man sich kaum die Mühe für 10bit 4:2:2 antun. Aber wenn man entsprechend Luma- und Farbkorrekturen machen will, dann hat man damit halt bessere Karten - einfach weil man weniger Rauschen ins Material im Zuge der Bearbeitung einbringt.

Und wer Banding kennt hat auch ein gutes Beispiel dafür, wo man halt auch im Fall ohne Bearbeitung entsprechend anstehen kann.

Genau das mein ich ja. Wen interessiert der sichtbare Unterschied, wenn das Material eindeutig besser wird.

Beim Banding ists so eine Sache - hatte, bis auf in meinem Handy, noch nie sichtbares Banding in unbearbeitetem Material aus einer Kamera.

Antwort von Kranich:

Also wenn das Bild deutlich besser ist, dann is mir die verzögerung zwar nicht egal, aber dann werde ich mir das ding trotzdem kaufen.

Hat nicht jemand jetzt son Ding ma bekommen? sind die nicht Heute raus?

Ich würde mich mal über ein Testclip freuen, also ein Orginal clip aus dem Recorder :)

Bin gespannt

Antwort von klusterdegenerierung:

Ätsch! :-) ;-)

Antwort von srone:

Ätsch! :-) ;-)

manchmal möchte man dem gegenüber, einfach "eine reinhauen", mit dem kommentar "du weisst warum!" ;-)))))

lg

srone

Antwort von klusterdegenerierung:

Das verstehe ich! :-)

Aber Du kannst sofort mitmischen, denn ich stell mich wieder an wie das erste mal Inlinern!

Habe ich was verpasst oder ist es normal das ich den AVid Codec nicht anwählen kann?

Antwort von srone:

aktuelle firmware?

lg

srone

Antwort von Skeptiker:

... oder ist es normal das ich den AVid Codec nicht anwählen kann?

Ich bin nach wie vor sauer, wie Du den Neuling hier im Forum angebellt hast, der ein Video zu 4:2:0 versus 4:2:2 beisteuern wollte. Schlechter Stil!

Aber nun Schwamm drüber - ich gebe Dir trotzdem eine Antwort:

Beim Ninja musste der AVID Codec nachinstalliert bzw. aktiviert werden - das könnte etwas mit Lizenzrechten zu tun haben (?).

Antwort von klusterdegenerierung:

Danke!

USB3 Festplattenreader funktioniert an keinem USB Anschluß und ich habe 10 davon, Windows meint zu wenig Strom, egal ob ich das 2. Kabel auch verwende oder an USB2 gehe.

Fängt ja schon gut an! Etwa jedesmal die Platte aus dem Caddy schrauben?

Antwort von klusterdegenerierung:

Firmware ist aktuell und AVid kann man nicht wie bei Samurai lizensieren!

Antwort von Skeptiker:

Windows meint zu wenig Strom, egal ob ich das 2. Kabel auch verwende oder an USB2 gehe.

Ich kann nur von meinen Ninja sprechen:

Dort sind die zusätzlichen 5 Volt per 2. Kabel bei USB-3 Anschluss zwingend nötig.

Alternativ dazu könntest Du es mit einem Netzteil mit 5 Volt probieren, falls das Caddy-Computer-Interface in etwa vergleichbar mit dem des Ninja ist (dort gibt's einen 5 Volt DC In).

Antwort von klusterdegenerierung:

Windows hat die USB Ports auf Wunsch zurück gesetzt.

Jetzt funktioniert es zumindest an USB2.

Ist für Avid vielleicht die Kingston zu lahm?

Antwort von Kranich:

Magste ma was hochladen? :)

Haste ne gh4 dran? Wenn ja, wie is die Sync. So?

Antwort von mash_gh4:

na ja - dies scheint aber wohl nur bei der Ausgabe auf einen Monitor der Fall zu sein - da mit dem Playback wohl eh noch Probleme bestehen, könnte es daher rühren.

heute hat panasonic das angekündigte GH4 2.1 firmware-update um ein monat nach hinten verschoben und bei dieser gelegeheit erstmals ganz ausdrücklich von verbesserungen an der timecode-einbettung ins HDMI signal gesprochen. (siehe: http://av.jpn.support.panasonic.com/sup ... _yagh.html )

es scheint also so zu sein, als ob an dieser sache nun wirklich ernsthaft gearbeitet werden würde. dafür können wir vermutlich atomos gar nicht dankbar genug sein.

dass unzählige benutzer irgendwo im netz schon länger über ähnliche probleme klagen, kümmert ja bekanntlich bei einem consumer produkt niemanden ernsthaft. da es sich aber nun langsam doch auch als entscheidendes problem in der zusammenarbeit mit anderen geräten erweisen dürfte, gibt es wieder eine gewisse hoffnung, dass da einiges endlich überprüft und bereinigt wird.

was dabei dann letztlich herauskommt -- wie weit man die dinge noch optimieren kann --, ist schwer vorherzusehen. wir können aber sicher alle nur davon profitieren, wenn derartigen mängeln unter dem fachkundig prüfenden blick anderer kollegen auf den grund gegangen wird.

es gibt doch etliche Leute die unverändert nicht glauben, dass eine wirkliche UHD Ausgabe mit 10bit 4:2:2 über HDMI 1.4b möglich ist.

...

Nur: auch Convergent Design hat recht klar gepostet - Links siehe oben - dass sie das können.

naja -- sie haben bisher nur ihrer ankündigung wahr gemacht, dass sie das selbe feature anbieten werden, wenn es der konkurrenz gelingt. umgesetzt haben sie es noch nicht! ;)

es ist also nicht unbedingt dem aktuellen preisverfall für russische video-software-spezialisten zu verdanken, dass sich da plötzlich innerhalb von ein paar tagen ganz neue möglichkeiten auftun. eher würde ich es als ziemlich durchschaubaren wettbewerb in puncto ankündigungspolitik verstehen.

ich staune allerdings schon ein bisschen darüber, wie sich in diesem fall die grenzen zwischen traditioneller produktentwicklung und modischem crowd-founding völlig aufzulösen scheinen.

aber ich bin es manchen akteuren durchaus vergönnt, kunden zu finden, die bereit sind, ein solches produkt zu erwerben, das in vielerlei hinsicht noch nicht richtig fertig entwickelt und ausgereift wirkt. wenn es ihnen dadurch in derart beeindruckender weise gelingt, den ganzen umliegenden markt in bewegung zu setzen und alle anderen beteiligten unter zugzwang zu bringen, kann das manchmal recht fruchtbare folgen zeigen. mich persönlich erinnert es jedenfalls recht angenehm an jenen pioniergeist, den man sonst nur in der freien software-szene spürt.

Wen interessiert der sichtbare Unterschied, wenn das Material eindeutig besser wird.

was den praktischen qualitätsgewinn durch externe 10bit aufzeichnung angeht, habe ich keine ganz so überschwänglichen erwartungen.

ich denke, man kann diesen punkt ohnehin schon jetzt an hand von standbildern, ausgehend von den RAW daten, ziemlich gut durchspielen und in seinen auswirkungen abschätzen.

ein bisserl werden die 10bit sicher bringen. vermutlich aber bei weitem nicht so viel, wie wir uns das alle wünschen würden. es schaut eher so aus, als ob die GH4 bereits jetzt ausgesprochen gut optimiert für ansehnliche 8bit ausgaben sein dürfte. wenn alles passt, kann man damit schon bisher ausgezeichnete resultate erzielen. um allerdings einen schritt darüber hinaus zu setzen und weitere nachträgliche korrekturmöglichkeiten zu erschlißen bzw. den dynamikumfang des sensors voll auszuschöpfen, müssten grundsätzlichere änderungen zugänglich werden. genau jene erweiterungen also, die ohnehin bei jedem firmware-update wieder auf neue in gestalt der bekannten gerüchte in allen einschlägigen foren sehnlichst erträumt werden. technisch wäre vieles davon gewiss bereits jetzt auf der basis der vorhandenen hardware realisierbar, trotzdem werden wir die notwendigen features vermutlich erst in zukünftigen modellen zu gesicht bekommen. aber so ist das halt mit den etwas weniger erfreulichen klassischen modellen zurückhaltender produktpflege.

Antwort von DV_Chris:

Leider habe ich selbst das Gerät noch nicht - bin gespannt ob das bis Weihnachten klappt.

Hier spricht Dein Händler: es wird klappen.

Antwort von wolfgang:

Na dann kann ich ja schon den Weihnachtsbaum aufstellen!

Antwort von wolfgang:

naja -- sie haben bisher nur ihrer ankündigung wahr gemacht, dass sie das selbe feature anbieten werden, wenn es der konkurrenz gelingt. umgesetzt haben sie es noch nicht! ;)

es ist also nicht unbedingt dem aktuellen preisverfall für russische video-software-spezialisten zu verdanken, dass sich da plötzlich innerhalb von ein paar tagen ganz neue möglichkeiten auftun. eher würde ich es als ziemlich durchschaubaren wettbewerb in puncto ankündigungspolitik verstehen.

Also auch Panasonic hat ja bei der GH4 die 10bit 4:2:2 spezifiziert. Und ich vertehe ja wenn man das kleineren Firmen nicht glaubt - aber glauben wir das auch Panasonic nicht?

So gesehen ist das nicht einmal Ankündigungspolitik, sondern da die GH4 ja auch nur über hdmi ausgibt eigentlich gar keine Neuigkeit mehr, dass Hersteller sagen dass sie das können.

Antwort von Stephan_Kexel:

Das verstehe ich! :-)

Habe ich was verpasst oder ist es normal das ich den AVid Codec nicht anwählen kann?

Wir implementieren einen neuen Avid DNX Codec für 4k. Dieser Codec ist aber noch nicht von Avid frei gegeben. Sobald dieser freigegeben ist gibt es von uns sofort ein kostenloses FW update.

Viele Grüße

Stephan

Antwort von klusterdegenerierung:

Das verstehe ich! :-)

Habe ich was verpasst oder ist es normal das ich den AVid Codec nicht anwählen kann?

Wir implementieren einen neuen Avid DNX Codec für 4k. Dieser Codec ist aber noch nicht von Avid frei gegeben. Sobald dieser freigegeben ist gibt es von uns sofort ein kostenloses FW update.

Viele Grüße

Stephan

Wir?

Antwort von DV_Chris:

Stephan Kexel ist seit knapp 20 Jahren ein bekannte Größe im professionellen Videoumfeld und Vice President Sales, EMEA at ATOMOS. Also kann er beruhigt "wir" schreiben ;-)

Antwort von klusterdegenerierung:

Ahh! ;-)

Ok, hallo Stefan, gibt es dafür auch schon einen Termin?

Und auch dafür wann eine Pulldown funktion bzw. ich auch 1080p bei 4K Signal einstellen kann?

Danke :-))

Antwort von wolfgang:

Das verstehe ich! :-)

Habe ich was verpasst oder ist es normal das ich den AVid Codec nicht anwählen kann?

Wir implementieren einen neuen Avid DNX Codec für 4k. Dieser Codec ist aber noch nicht von Avid frei gegeben. Sobald dieser freigegeben ist gibt es von uns sofort ein kostenloses FW update.

Viele Grüße

Stephan

Stephan, das sind ausgesprochen gute Nachrichten! Denn nicht jede NLE kann mit ProRes problemlos umgehen - darum habe ich in Vegas eher mit DNxHD gearbeitet. Hoffe das geht mit dem neuen Codec ebensogut.

Antwort von mash_gh4:

Also auch Panasonic hat ja bei der GH4 die 10bit 4:2:2 spezifiziert. Und ich verstehe ja, wenn man das kleineren Firmen nicht glaubt - aber glauben wir das auch Panasonic nicht?

naja -- es gibt schon einiges, das panasonic in seiner feature-list aufzählt, das man besser schnell wieder vergisst, wenn man befriedigende resultate erzielen will. die ganze timecode/synchronitätsprobleme sind ein wunderbares beispiel dafür. es betrifft aber durchaus auch ganz einfache dinge, wie die eher durchschnittliche 1080p- od. zeitlupen-bildqualität.

im falle der hdmi begrenzungen stellt sich halt auch das problem, dass so etwas erst dann sinn macht bzw. tatsächlich 'funktioniert', wenn es auch ein gegenüber gibt, das die entsprechende kommunikation reibungslos akzeptiert. so kann ja auch atomos jederzeit behaupten, dass manche dinge bereits ausreichend unterstützt würden, wenn nur die kamerahersteller entsprechende anpassungen an ihrer ausgabe vornehmen würden.

so kommt man dann halt irgendwann zu lösungen, die sich zwar über spezielle atomos-panasonic-protokollanpassungen wunderbar verstehen, aber mit den gebräuchlichen konventionen und beschränkungen der umgebenden gerätelandschaft nicht mehr viel gemein haben. im gegenständlichen fall ist das auch sicher nicht weiter problematisch, da sich ja vorerst nur ganz wenige spezialgeräte in diese exotischen nische tummeln. eine wesentlich günstigere ausgereifte umsetzung bzw. völlig unspektakuläre unterstützung entsprechender features wird es trotzdem erst mit der verbereitung von hdmi 2.0 und entsprechenden komponenten geben. die meisten gebräuchliche interface-lösungen lassen sich nicht einfach durch ein firmware-update beliebig modifizieren, weil für die interne bildrepräsentation bereits in der hardware klare vorgaben und grenzen festgelegt sind. im besten fall können wir uns wünschen, dass sich diese gegenständlichen aktuellen vorreiter auch noch im hinblick auf diesen kommenden mainstream an hdmi 2.0 produkten als ausreichend kompatibel erweisen. im bereich der computer-monitore kann man dieses dilemma momentan ohnehin recht gut mitverfolgen.

So gesehen ist das nicht einmal Ankündigungspolitik, sondern da die GH4 ja auch nur über hdmi ausgibt eigentlich gar keine Neuigkeit mehr, dass Hersteller sagen dass sie das können.

möglicherweise unterstützt das BMD ultrastudio 4K die betreffenden features schon eine ganze weile und trotzdem kümmert es niemanden.

vermutlich würdest du ja auch nur ein mitleidiges lächeln ernten, wenn du einem fotografen ganz stolz erzählst, dass deine neue kamera zwar leider keine ausgabe als RAW erlaubt, aber dafür unter zuhilfenahme aufwendiger add-ons 12bit JPGs exportiert. ;)

dass ist natürlich jetzt ein bisserl polemisch. in wahrheit finde ich es auch ganz ausgesprochen fein, dass mit diesen aktuellen geräten die latte für alle beteiligten wieder ein wenig höher gehängt wird. vermutlich dürften wir uns also auch von der internen aufzeichnung günstiger kameras in kürze vergleichbares erwarten. darüber vermag auch ich mich vorbehaltlos zu freuen.

Antwort von Stephan_Kexel:

der shogun würde sich hier also geradezu anbieten, um diesem problem zu entkommen. aber so wie es sich momentan darstellt, dürfte es dadurch nur noch schlimmer werden.

Alle unsere Rekorder, auch natürlich der Shogun, haben eine Einstellmöglichkeit einen Audio/Video Versatz zu kompensieren. Die GH-4 ist ja nicht die einzigste Kamera die extern das Problem hat. Canon 5DMark 3 hat 5 Frames und einige Nikon Camera's 8 Frames. Unsere Einstellung kann bis zu 54 Frames kompensieren.

Viele Grüße

Stephan

Atomos GmbH

Antwort von Stephan_Kexel:

Es erscheint in kürze ein Podcast über den Shogun von Stefan Czech indem man anschaulich sehen kann das die GH-4 bei externer 4k Aufnahme über HDMI 10 bit ausgibt.

Ich finde die Stimmungsmache über Geräte die man gar nicht hat, bzw. keine Nachprüfmöglichkeit hat, hier etwas bedenklich.

Viele Grüße

Stephan

Antwort von Stephan_Kexel:

Ahh! ;-)

Ok, hallo Stefan, gibt es dafür auch schon einen Termin?

Und auch dafür wann eine Pulldown funktion bzw. ich auch 1080p bei 4K Signal einstellen kann?

Danke :-))

Termin für was? Der Avid Codec liegt nicht in unserer Hand, den können wir erst freigeben wenn Avid das tut. Wie oben schon geschrieben erwarten wir das im Januar.

Pulldown? Ich wüsste nicht warum der Pulldown nicht funktionieren sollte.

1080p bei 4K Signal? Wir zeichnen auf was die Kamera und anbietet, wir konvertieren nicht im Shogun 4k nach 1080p.

Viele Grüße

Stephan

Antwort von Jott:

Ich finde die Stimmungsmache über Geräte die man gar nicht hat, bzw. keine Nachprüfmöglichkeit hat, hier etwas bedenklich.

Ist kein Einzelfall, wird hier gerne so gehandhabt.

Antwort von CameraRick:

Ist für Avid vielleicht die Kingston zu lahm?

Gibt ja schon eine Antwort zur Problematik, aber hier noch eine zur SSD:

DNxHD ist in seiner größten Version nach MediaInfo etwa 360Mbit schwer (DNxHD 444, 10bit 25p, kein Alpha).

Das entspricht dann nur etwa 45MB/s und ist damit auch Pi mal Daumen halb so schwer wie ProRes 422 HQ bei UHD (731Mbit, 25p kein Alpha, nach Tabelle).

Antwort von TonBild:

Hier das offizielle Vorstellungs-Video:

Danke Stephan für den Link.

Bei den vier schweren XLR-Stecker, die frei an einem so dünnen Kabel und Stecker an dem Atomos Shogun 4K Recorder hängen, wird die Audioverbindung sicher sehr schnell zusammen brechen oder zumindest unzuverlässig arbeiten.

Was meint Ihr?

Sind bei dieser Lösung mit den frei hängenden Audio-Steckern nicht Kabelbrüche oder Wackelkontakte vorprogramiert?

Antwort von DV_Chris:

Sind bei dieser Lösung mit den frei hängenden Audio-Steckern nicht Kabelbrüche oder Wackelkontakte vorprogramiert?

Wer beim Feldeinsatz von professionellen Geräten nicht weiß, wie er eine Zugentlastung realisiert, der sollte mal ein paar Wochen als Assistent einlegen ;-)

Antwort von TonBild:

Sind bei dieser Lösung mit den frei hängenden Audio-Steckern nicht Kabelbrüche oder Wackelkontakte vorprogramiert?

Wer beim Feldeinsatz von professionellen Geräten nicht weiß, wie er eine Zugentlastung realisiert, der sollte mal ein paar Wochen als Assistent einlegen ;-)

Nein, das hat damit nichts zu tun. Gerade wenn Geräte für den professionellen, also werktäglichen Einsatz konstruiert werden, sollten die Produktentwickler darauf achten, dass es solche Schwachstellen erst gar nicht gibt und nicht durch Kameraassistenten notdürftig beseitigt werden müssen.

Schau Dir mal die Sony PXW-F7 auf

http://www.fstopacademy.com/wp-content/ ... -FS739.jpg

an. Am Monitor- und Audiokabel siehst Du, wie gut die Ingenieure gearbeitet haben. Beide Kabel verlaufen parallel zur und geschützt an der Kamera (so können die Kabel kaum abreißen) und verwenden robuste Stecker / Buchsen. Eine Zugentlastung, die durch einen Assistenten gebastelt werden muss, ist hier gar nicht nötig.

Warum soll ähnliches nicht auch bei Atomos möglich sein?

Antwort von iasi:

der shogun würde sich hier also geradezu anbieten, um diesem problem zu entkommen. aber so wie es sich momentan darstellt, dürfte es dadurch nur noch schlimmer werden.

Alle unsere Rekorder, auch natürlich der Shogun, haben eine Einstellmöglichkeit einen Audio/Video Versatz zu kompensieren. Die GH-4 ist ja nicht die einzigste Kamera die extern das Problem hat. Canon 5DMark 3 hat 5 Frames und einige Nikon Camera's 8 Frames. Unsere Einstellung kann bis zu 54 Frames kompensieren.

Viele Grüße

Stephan

Atomos GmbH

gut gut

Ist dieser Versatz bei jedem Modell immer gleich und vielleicht auch als Preset abrufbar?

Antwort von DV_Chris:

Am Monitor- und Audiokabel siehst Du, wie gut die Ingenieure gearbeitet haben. Beide Kabel verlaufen parallel zur und geschützt an der Kamera (so können die Kabel kaum abreißen) und verwenden robuste Stecker / Buchsen. Eine Zugentlastung, die durch einen Assistenten gebastelt werden muss, ist hier gar nicht nötig.

Warum soll ähnliches nicht auch bei Atomos möglich sein?

Wie oft tritt der Fall ein, dass man Ton extern in den Shogun embedden wird?

Antwort von TonBild:

Am Monitor- und Audiokabel siehst Du, wie gut die Ingenieure gearbeitet haben. Beide Kabel verlaufen parallel zur und geschützt an der Kamera (so können die Kabel kaum abreißen) und verwenden robuste Stecker / Buchsen. Eine Zugentlastung, die durch einen Assistenten gebastelt werden muss, ist hier gar nicht nötig.

Warum soll ähnliches nicht auch bei Atomos möglich sein?

Wie oft tritt der Fall ein, dass man Ton extern in den Shogun embedden wird?

Wenn ich es richtig verstanden habe, dann besteht bei Atomos mit dem neuen Shogun erstmals die Möglichkeit, professionelle symmetrische Audiosignale in/out (inklusive Phantomspannung) per XLR zu nutzen.

Wenn der Shogun gute Mirofonverstärker hat, dann wird man diesen neuen Eingang sehr oft (um nicht zu sagen eigentlich immer) nutzen wollen. Denn bisher war es nicht möglich, hochwertige externe Mikrofone mit Phantomspannung mit Atomos Geräten direkt zu nutzen.

Wäre doch schade, wenn das an einem defekten oder unzuverlässigen Kabel bzw. an nicht robust genug ausgeführten Stecker / Buchsen scheitern sollte.

Antwort von Stephan_Kexel:

Wäre doch schade, wenn das an einem defekten oder unzuverlässigen Kabel bzw. an nicht robust genug ausgeführten Stecker / Buchsen scheitern sollte.

Die externen Atomos Audiokabel sind nicht defekt oder unzuverlässig. Sie sind genau für diesen Einsatz gemacht.

Viele Grüße

Stephan

Antwort von TonBild:

Die externen Atomos Audiokabel sind nicht defekt oder unzuverlässig. Sie sind genau für diesen Einsatz gemacht.

Hallo Stephan,

ich kenne ja nur das Video und nicht das Gerät aus eigener Erfahrung. Kann natürlich sein, dass es dann anders wirkt.

Aber wenn ich mir hier im Video

ab ca. 5:00 im anschaue, wie das spezielle Atomos Audiokabel an dem kleinen Stecker horizontal nach rechts zeigt und von den schweren vertikalen XLR-Adaptern mit entsprechener Hebelwirkung nach unten gedrückt wird, mache ich mir schon Sorgen, dass die im Atomos eingebaute Audiobuchse (ist das ein proprietärer Anschluss?) nicht mit der Zeit ausleihert oder beschädigt wird. Ist mir an einer Kamera schon mit anderen Anschlüssen passiert. Und vier längere XLR Kabel, die man dann an den Adapter anschließt, haben auch ein sehr hohes Gewicht, welches dann mit Hebelwirkung an der kleinen Buchse komplett anliegt.

Wenn zumindest die im Atomos eingebaute Audiobuchse an der Unterseite des Gerätes plaziert worden wäre wären zumindest die Scherkräfte auf diese kleine Audiobuchse nicht mehr ganz so groß und die Kabel würden auch nicht geknickt. Aber das würde dann sicher Platzprobleme mit der Kamera erzeugen.

Eine andere Alternative wäre ein Winkelstecker wie bei dem Stromversorgungs- oder Kopfhörerkabel.

Antwort von srone:

atomos verwendet hier eine lemo buchse+stecker, bevor du die kaputt bekommst, wird es wohl den ganzen shogun zerreissen, aber winkelstecker wäre praktischer, da nicht so abstehend.

lg

srone

Antwort von TonBild:

atomos verwendet hier eine lemo buchse+stecker, bevor du die kaputt bekommst, wird es wohl den ganzen shogun zerreissen, aber winkelstecker wäre praktischer, da nicht so abstehend.

Es gibt ja rechtwinklige Lemo-Stecker

http://intra.lemo.ch/catalog/ROW/UK_Eng ... w_plug.pdf

Vielleicht könnte man sich damit etwas basteln, was auch auf die eigenen Bedürfnisse besser passt.

Meist braucht man ja nur die Mikrofoneingänge, so dass man auf die beiden schweren XLR-Out Stecker schon verzichten kann. Und dann könnte man das Kabel (am besten ein leichtes) noch so viel länger machen, so dass man gar kein schweres XLR-Verlängerungskabel mehr braucht.

Dann wäre der XLR-Adapter direkt am Mikrofon, wo er nicht mehr stört.

Praktisch wäre also ein Kabelsortiment unterschiedlicher Längen mit Lemowinkelstecker für die unterschiedlichen Anwendungen. Z. B. ein kurzes Kabel für das an der Kamera montierte Mirkro oder dem Funkempfänger und ein längeres für Interviews oder zum direkten Anschluss an ein Mischpult.

Ein Winkelstecker wäre auch für das Videokabel praktischer, da nicht so abstehend.

Antwort von klusterdegenerierung:

Hallo Stefan,

jetzt habe ich langsam doch Mitleid mit Dir!

Dir macht man es hier wirklich nicht einfach.

Und sorry wenn ich dumme Fragen stelle, ist mein erster Recorder.

Ich war davon ausgegangen das ich ein mal 4K an der GH4 einstellen und dann am Shogun die jeweilige Auflösung und Famerate wählen kann.

Dies scheint dann wohl nicht so zu sein und ich muß erst immer in das Cam Menü und die HDMI Ausgabe von 4K auf 1080 stellen?

Ich würd ja auch gerne mal die Slomofunktion nutzen, kann ich das dann überhaupt?

Atomos hat mir Heute eine Email geschickt und mir auch geschrieben, das man den Avid Codec ab Januar durch ein Firmware update, im Zuge des Playback updates nutzen kann.

Stefan, ich habe einen Spyder 4 Pro, kann ich diesen, vielleicht mit einem Zubehöradapter, auch nutzen oder müßte ich mir einen Atomos Spyder kaufen?

Danke für Deinen langen Atem hier! ;-)

Nachtrag:

Die Anschlüsse am Shogun sind alle wertig und mit dem Stecker im Audioanschluß, kann ich meine Tochter auf dem Bobbycar ziehen.

Keine Panik, der geht als letztes kaputt, da kauf ich mir doch lieber sofort ne iPad Schutzfolie und papp die auf dem mit Bonerwax polierten Touchglas.

Wenn ich da auch nur einen Kratzer drauf sehe, haue ich meinen Assi aus den Schuhen, wobei der schläft ja meistens! ;-):-)

Antwort von klusterdegenerierung:

Also wer mit dem Shogun längere Drehs einplant, der wird wohl ohne Strom aus der Dose kaum klar kommen.

Ein normaler voller Akku hielt hier gerade bei mir nur ca. 10min in Pausenfunktion.

Ich habe jetzt mal zum test einen großen Swit dran gehangen.

Was der stabilisierung am Rig oder am Stativ ganz gut tut undwofür ich auch gleichzeitig Atomos loben muß, ist die Möglichkeit den Recorder unten und oben gleichermaßen über die üblichen Gewinde zu befestigen und das Bild inkl. Menü zu flippen.

Da es ja ein Touchsreen ist und man dann doch häufiger draufrum daddelt, erschien mir die Lösung ihn über 2 Magicarme zu fixieren, sehr praktisch und sicher.

Ich habe mal 2 Bilder vom Setup an gehangen.

Meine 5DII hatte ich auch mal dran, funktioniert gut, leider ist das Livebild nur ca. 75% des ganzen Monis groß.

Die Daten der 5D habe ich noch nicht gesichtet.

Die der GH4 sind auf HQ 845Mbit groß und in Speedgrade und Premiere gut zu verarbeiten.

Sowohl in den Tiefen, als auch in den höhen steckt merklich mehr Potential.

Am meisten bin ich aber auf die verarbeitung in Davinci gespannt.

Hoffe euch mit meinen ersten Erkenntnissen bereichert zu haben? ;-)

Antwort von Jensli:

Ein normaler voller Akku hielt hier gerade bei mir nur ca. 10min in Pausenfunktion.

whuuut???? Das ist doch nicht deren Ernst?

Antwort von TonBild:

Die Anschlüsse am Shogun sind alle wertig und mit dem Stecker im Audioanschluß, kann ich meine Tochter auf dem Bobbycar ziehen.

Keine Panik, der geht als letztes kaputt

Wozu die LEMO-Stecker doch alles gut sind. ;-)

Aber wenn Du Deine Tochter auf dem Bobbycar ziehst wirkt an den Steckern lediglich eine Zugkraft. Und für diesen Zweck könntest Du im Zweifel auch eine dünne Schnur benutzen.

Aber wenn man am waagerecht angebrachten Lemo-Stecker am Kabel senkrecht nach unten zieht, so wird das Kabel unweigerlich geknickt. Das passiert nicht, wenn Du Deine Tochter auf dem Bobbycar ziehst.

Ok, an dieser Stelle hat das Atomos Kabel einen Knickschutz, aber wenn das oft so genutzt wird, dann wird irgendwann genau an dieser Stelle ein Kabelbruch eintreten.

Außerdem sind die Lemo-Stecker und deren Verankerung im Shogun sicher empfindlicher wenn man sie seitlich belastet als wenn man nur an ihnen zieht.

Wie schon geschrieben hatten wir große Probleme mit Kabeln, die auch waagerecht in die Kamera gesteckt wurden. Diese haben, obwohl nur mit dem Eigengewicht belastet, mit der Zeit die Kamerabuchse beschädigt.

Die Reparatur der Kamera war dann so teuer dass man dafür schon einen halben Shogun kaufen kann. Also die Beschädigung so einer kleinen Buchse kann ganz schön teuer werden. Erst recht, wenn sie während einer Produktion Störungen verursacht. Aber das gibt nur für unsere Erfahrungen. Vielleicht ist das ja alles beim Shogun kein Problem.

Die Ingenieure versuchen bei solchen Produkten natürlich viele Funktionen und Anschlüsse auf kleinstem Raum unter zu bringen so dass man aufgrund vieler Features effektives Marketing betreiben kann. Aber so werden auch die Buchsen diverser Anschlüsse immer kleiner und empfindlicher. Das ist bei sehr vielen Geräten leider so. Und das, obwohl die Verwendung größerer stabilerer Anschlüsse gar nicht wesentlich teurer wäre.

Hier kann man sehr schön sehen, wie stabile Buchsen man bei Sony verwendet:

Interessant:

- die Kopfhörerbuchse geht senkrecht nach unten. Bei einem Kopfhörer ohne Winkelstecker wäre das optimal.

- die XLR-Buchsen verlaufen parallel zur Kamera, kein Kabel steht nach außen

- es wird die größere HDMI-Geräte-Steckbuchse Typ A und nicht die bei Tablet-Computern üblichen Micro-HDMI-Typ-D-Anschlüsse verwendet

- es gibt zwei stabile BNC Buchsen für den SDI-Ausgang statt Micro-HDMI wie bei vielen DSLRs (BNC Buchsen hat der Shogun aber auch)

- außerdem können mit Hilfe des MI-Schuhadapters (Multi Interface) SMAD-P3 die Drahtlosempfänger der UWP-D-Serie ohne jegliche Kabel verbunden werden

Antwort von Valentino:

Welcher Akku und wie alt war er? Wie verhält er sich an anderen Geräten?

Kann mit das mit den 10min beim besten Willen nicht vorstellen, aber es gibt ja genug andere Möglichkeiten den Rekorder mit Strom zu versorgen.

Über D-Tap und 90Wh V-Mount sollten schon ein paar Stunden drin sein.

Antwort von DV_Chris:

Der Shogun wird mit einem NP Akku geliefert. Atomos gibt folgende Laufzeiten an:

2600mAh - up to 3hrs

5200mAh - up to 5hrs

7800mAh - up to 8hrs

Antwort von klusterdegenerierung:

Welcher Akku und wie alt war er? Wie verhält er sich an anderen Geräten?

Kann mit das mit den 10min beim besten Willen nicht vorstellen, aber es gibt ja genug andere Möglichkeiten den Rekorder mit Strom zu versorgen.

Über D-Tap und 90Wh V-Mount sollten schon ein paar Stunden drin sein.

Ja das muß ich wirklich noch mal genauer testen, denn ich hatte jetzt einen Noname mit gewisser Laufzeit. Allerdings habe ich mich schon dazu verleiten lassen es so zu schreiben, da ich ihn an meinem 7" Fieldmonitor min eine halbe Stunde nutzen kann.

Morgen werde ich mal den Mitgelieferten voll machen und bis zum schluß stoppen.

Allerdings kann man sich ja Heute auf die Batterisstandsanzeigen auch nicht mehr so verlassen, denn mit meiner Pocket konnte ich bei Leer noch mal genau so lange aufnehmen wie bei bis halb voll! ;-)

Das mit dem ganzen Stecker Theater ist natürlich schon richtig und imgrunde ist es alles popelzeug, aber wenn man es mit bedacht behandelt und sich eine eigene Zugentlastung bastelt, kann man damit bestimmt ganz gut leben.

Ich denke das auch niemand von uns die XLR Stecker so provokant runterbaumeln lässt wie der von Atomos. Ich würde sie bei benutzung auf jeden Fall irgendwo festzurren oder fixieren.

Das mit dem Bobbycar war natürlich auch im senkrechten Zustand des Recorders gemeint :-) ;-)

Antwort von StefanFilm:

Zudem bereite ich gerade eine umfassende Review vor, in der ich u.a. für verschieden Kameras deren Menueeinstellung und eigenheiten zusammen mit dem Shogun erkläre.

Kurze Sneak dazu:

Hallo Stefan,

willkommen im Forum. Freu mich auf die Review.

Gruß aus Bockenheim ;)

Hallo slachCam forum,

meine Review zum Atomos Shogun ist fertig und seit heute online.

Bestimmt wird die ein oder andere Frage hier beantwortet.

http://vimeo.com/stefanfilm/atomos-shogun

Eine Sache auf die ich in meiner Review nicht eingegangen bin, die hier aber extrem die Gemüter bewegt ist die Videoverzögerung über HDMI.

Ich kann die Aufregung hier nicht so ganz nachvollziehen. Diese Eigenschaft kommt von der Übertragung allgemein und ist bei allen Kameras zu beobachten.

Die Canon 5D Mark III hat 6-7frames, die GH4 4-5. Und selbst eine Sony EX1/EX3 hat über SDI, welche auch im profesionellen Einsatz ständig über diese Leitung an Mixer und im Studioverbund betrieben wird, 4-5 frames Verzögerung.

Da nach der Sensorauslesung in allen Kameras einige Berechnungen zur Verarbeitung, Codierung etc. ablaufen und die Weiterleitung per HDMI/SDI nicht an erster Stelle steht ist das also nicht wirklich etwas besonderes.

Es werden meist dann die progesive frames in PSF umgewandelt um sie aus der Kamera aus zu geben. Und auch das kostet Zeit.

Man kann damit aber ohne weiteres Arbeiten, wenn man entsprechen damit um zu gehen weiß ist das auch kein Problem.

MfG

Stefan

Antwort von motiongroup:

schön gemachte Vorstellung..

sind wir mal ehrlich, die leidige HDMI 8/10bit 4:2:0 4:2:2 Diskussion wäre keine gewesen so einer der Hersteller oder eben auch die HDMI.org klare Aussagen über die specs. gegeben hätten...

Ein Hr. Kexel an der Quelle sagt aus und belegt fertig.. basierend auf den specs. des hdmi Konsortiums und das ab Beginn der leidigen Diskussion.

Ich denke auch nicht, dass in den Aussagen der hier Schreibenden irgendeine Art von Schlechtrederei gegenüber den Produkten betrieben wird. Es wurde einfach generell die Möglichkeit der 10bit 4:2:2 4k30p via hdmi 1.4b in Frage gestellt.

Diese Frage stellt sich aber generell nicht nur um das Thema shogun drehend, sonder auch um convergent und allen Camera Herstellern die dieses Feature anbieten würden und werden.

Ein Produkt schlecht reden? Nein das sieht anders aus Herr Kexel, werfen Sie mal einen Blick in die Runde und es fällt Ihnen wie Schuppen von den Augen.

Sonst Gratulation zum shogun, tolles Produkt wie die Ninjas auch..

Antwort von crackerjack:

nett

A7s mit 10 bit - wie geht das?

Antwort von Bruno Peter:

Es erscheint in kürze ein Podcast über den Shogun von Stefan Czech indem man anschaulich sehen kann das die GH-4 bei externer 4k Aufnahme über HDMI 10 bit ausgibt.

Ich finde die Stimmungsmache über Geräte die man gar nicht hat, bzw. keine Nachprüfmöglichkeit hat, hier etwas bedenklich.

Viele Grüße

Stephan

Stimmungsmache?

Nein nicht schon wieder..., Sie zeigen ja ein Verhalten wie damals unter Canopus als Sie Anwender etwas in die Mangel genommen haben.

Legen Sie dieses Vehalten ab und lernen Sie etwas aus der Diskussion hier.

Ich finde jedenfalls die Diskussion hier sehr nützlich!

Antwort von klusterdegenerierung:

Ho ho ho!

Gratulation Stefan!!

Da hast Du Dir aber wirklich viel Arbeit gemacht!

Toll gemacht, schön auch Dein 8bit / 10bit Vergleich, endlich weiß ich (wie WoWu schon vermutet hatte) das mein Dell kein echter 10Bit Monitor ist! :-)

Womit hast Du denn das Material verarbeitet und hattest Du jetzt mehr Möglichkeiten als ohne Shogun?

Schön das Du auch Shogun sagst und nicht wie die Amis Showgohn ;-)

Danke für das Review! :-)

Antwort von Skeptiker:

@StefanFilm:

Auch von mir Dank & Kompliment für die vertiefte Shogun-Vorstellung!

Und den 8bit/10bit-Vergleich, der optisch eigentlich eher ein 8bit 4:2:0 versus 8bit 4:2:2 Vergleich ist, fand ich durch das Hervorheben des Banding-Effekts auch interessant!

Skeptiker (Ninja2-Besitzer)

Antwort von iasi:

Sollte die Qualität von Monitorbild und Bild/Ton-Aufzeichnung den Werbetexten entsprechen, ist das ein sehr preiswertes Gerät.

Die Delay-Problematik ist natürlich nicht ohne - 6fps sind nicht wenig.

Was wirklich stört ist der Ton-Kabelbaum, der sehr ungünstig absteht. Auch wenn Stecker und Buchse das aushalten, bringt es doch durch die Hebelwirkung schnell Unruhe rein.

Vielleicht würde ein Winkelstecker und längere Kabel zu den Buchsen Abhilfe schaffen - so ein Kabel treibt den Gesamtpreis dann aber nochmal ordentlich in die Höhe und steht in keiner Relation zum Gerätepreis.

Antwort von domain:

Toller Test und hochinteressanter Recorder, vor allem auch wegen des weiterentwickelten Zebras und der eingebauten LUTs zur realistischen Bildbeurteilung.

Jetzt müssten eigentlich nur noch die Gehäuse der filmenden Fotoapparate so groß werden, dass es keinen Kabel-Kladderadatsch mehr gibt, zwei SSD-Einschübe und variabel große Akkus ermöglichen würden sowie integrierte XLR-Buchsen und vor allem ein wirklich großes Display zur Bildbeurteilung ;-)

Antwort von klusterdegenerierung:

Jetzt müssten eigentlich nur noch die Gehäuse der filmenden Fotoapparate so groß werden, dass es keinen Kabel-Kladderadatsch mehr gibt, zwei SSD-Einschübe und variabel große Akkus ermöglichen würden sowie integrierte XLR-Buchsen und vor allem ein wirklich großes Display zur Bildbeurteilung ;-)

Also ne URSA? Lol :-)))

Antwort von klusterdegenerierung:

Frage an die Audioexperten.

Eigentlich zeichne ich Ton extern mit einem Sennheiser über einen H4n auf und synche dann mit dem Cam internen Mic.

Meint ihr ich kann jetzt auf den Zoom verzichten und alles genauso gut mit dem Shogun machen? Wäre schön weil der Zoom ist schon Leer wenn er neue Batterien bekommen hat! ;-)

Antwort von wolfgang:

http://vimeo.com/stefanfilm/atomos-shogun

Großartiger Review, Stefan.

Ich habe leider meinen Shogun noch nicht. Aber genau über das Banding hätte ich auch den Nachweis geführt, was der Unterschied zwischen 10bit 4:2:2, 8bit 4:2:2 und 8bit 4:2:0 ist. Und den sieht man hier einmal wirklich.

@ Stephan Kexel,

du arbeitest ja im Moment für Atomos, und ich finde es in eurer Kommunikation extrem unglücklich dass ihr es nicht schafft, euch klar auf die Hinterbeine zu stellen und mal zu sagen: "Jawohl Leute, es ist technisch möglich über HDMI 1.4b eben auch UHD/4K mit 10 bit 4:2:2 zu übertragen. Unser Shogun verwendet dieses Feature, und wir stehen dazu." Das hat zumindest Convergent Design so gemacht.

Der Umstand, dass ihr das nicht macht, ist für viele potentiellen Käufer ein Grund für Unsicherheit und Verwirrung - und wohl dann auch für einige der Grund dann eben nicht zu kaufen.

Wir kennen uns lange und auch kurz persönlich - und du weißt genau dass ich ein großer Fan und Beführworter von euren Produken bin. Und auch selbst gekauft habe. Aber ich fühle mich auch den Usern gegenüber verantwortlich, die in unseren Foren Ratschläge erwarten - und das zu Recht. Es ist daher keine Stimmungsmache gegen das tolle Produkt. Sondern die sehr verständliche Frage von euren Kunden was hier eigentlich technisch wirklich Sache ist. Und sowas unbeantwortet zu lassen finde ich als schwierig.

Antwort von Kranich:

Ja vielen Dank für diesen Beitrag!

Könnte denn mal ein Shogun + GH4 Besitzer einen Testclip machen und hochladen?

Würde mir die sache gern mal vom nahem anschauen :)

Wäre super!

Antwort von TonBild:

Jetzt müssten eigentlich nur noch die Gehäuse der filmenden Fotoapparate so groß werden, dass es keinen Kabel-Kladderadatsch mehr gibt, zwei SSD-Einschübe und variabel große Akkus ermöglichen würden sowie integrierte XLR-Buchsen und vor allem ein wirklich großes Display zur Bildbeurteilung ;-)

Du meinst, die Kamera auf

https://www.blackmagicdesign.com/de/pro ... kmagicursa

sollte noch eine Fotofunktion bekommen?

;-)

Antwort von TonBild:

http://vimeo.com/stefanfilm/atomos-shogun

Eine Sache auf die ich in meiner Review nicht eingegangen bin,

... ist auch die hier schon angesprochene Audiokabelgeschichte. Bei Deinen Aufnahmen ist der Shogun oft nur mit dem HDMI Kabel zu sehen, selbst bei den Außenaufnahmen ab 19:57 und sogar bei den dem Musikvideo ab 20:24 auf

Wenn Du diese mit dem tollen Atomos Shogun 4K Recorder aufgenommenen Videos abspielst, dann sind das doch Stummfilme?

Oder wird der Kameraton auch über das HDMI Kabel übertragen?

Bei 20:24 sieht man es deutlich: Die Kamera zeigt einen Tonpegel an, der tolle Atomos Shogun 4K Recorder mit XLR-Anschlüssen dagegen nicht. Hast Du damit wirklich, wie im Off-Text gesagt, damit ein Musikvideo aufgenommen? Oder einen Stummfilm?

Auf http://youtu.be/XXMLjBR4lzI

steht:

"Stefan Czech and his Team shot the very first music video on a Sony A7S and the Atomos Shogun in 4k UHD."

Woher kam der Ton?

Auch wenn man den O-Ton dann für Musikvideos meist nicht nutzt oder man ein externes Aufnahmegerät verwendet, wäre dieser doch zumindest für die Synchronisation hilfreich. Warum hast Du dann in dieser Situation kein Mikro an den Shogun angeschlossen?

Ansonsten natürlich ein sehr informatives Video. Danke Dir.

Antwort von iasi:

Musikvideos findet man doch eher selten mit Live-Tonaufnahmen

Antwort von klusterdegenerierung:

@TonBild

So viel geschwafel für die einfache Frage ob der Shogun auch den Ton der Cam aufzeichnet? ;-)

Antwort: Ja tut er!

Antwort von Skeptiker:

Antwort: Ja tut er!

Auch per HDMI, wenn der Ton so angeliefert wird/würde?

Antwort von klusterdegenerierung:

So erster Akkutest!

Der mitgelieferte Atomos 2600mAh lief bis zur blinkenden Akkuanzeige exat eine Stunde! Wobei ich dazu sagen muß das er nicht recorded hat, sondern nur das Livebild mit halbhellem Display gezeigt hat.

Was darauf hindeutet das man ihn über Tag in der Sonne mit hoher Helligkeit und in Aufnahme kaum länger als eine halbe Stunde nutzen kann!

Da würde mich mal wirklich interessieren wie Atomos da an 3 Stunden kommt.

Vielleicht Raumfahrt Akkus mit Atomzellen? ;-)

Antwort von klusterdegenerierung:

Antwort: Ja tut er!

Auch per HDMI, wenn der Ton so angeliefert wird/würde?

Ja von der Fragestellung bin ich ausgegangen!

Ich hatte nur ein HDMI Kabel am Shogun und GH4 und man sieht dann den Ausschlag im Audiometer, hat man im Atomos Video aber auch schon gesehen. Links das interne Mic und rechts sein Rhode.

Antwort von TonBild:

ob der Shogun auch den Ton der Cam aufzeichnet? ;-)

Antwort: Ja tut er!

Danke, das ist gut zu wissen. Wir ja auch hier ab ca. 30:00

bei einem anderen Gerät gut erklärt.

Bis auf den Les Misérables Film http://www.soundonsound.com/sos/apr13/a ... t-0413.htm wird bei Musikvideos meist ein separat produzierter Ton verwendet. Aber wenn zumindest der Ton vom Kameramikrofon das HDMI Kabel vom Shogun aufgenommen wird ist das für die Nachbearbeitung sehr hilfreich.

Dann habe ich noch eine Frage zu 8/10bit: Wenn der Kamerasensor nur ein 8bit Signal ausgibt, dann bringt es doch nur eine größere Datei - aber keinen Qualitätsgewinn - wenn der Shogun 10 bit aufzeichnet?

Bei 26:35 wird der Unterschied mit 10/8bit 4:2:2 bzw. 4:2:0 gezeigt. Wird somit 4:2:2 besonders für einen gleichmäßigen Helligkeitsverlauf ohne Banding von den TV-Sendern gefordert oder hat das noch andere Gründe?

Antwort von klusterdegenerierung:

Aber wenn zumindest der Ton vom Kameramikrofon das HDMI Kabel vom Shogun aufgenommen wird ist das für die Nachbearbeitung sehr hilfreich.

Dann habe ich noch eine Frage zu 8/10bit: Wenn der Kamerasensor nur ein 8bit Signal ausgibt, dann bringt es doch nur eine größere Datei - aber keinen Qualitätsgewinn - wenn der Shogun 10 bit aufzeichnet?

Was andere Cams so machen weiß ich nicht, aber Grundsätzlich hat HDMI auch immer einen Signalweg für Audio.

Die Frage ist von welcher Cam Du sprichst, da die GH4 ja echte 10bit ausgibt ist das dort natürlich unproblematisch, jedoch bei Cams die nur 8bit ausgeben ist es natürlich uninteressant.

Antwort von rabe131:

... bei der GH4: wozu soll dann das SDI Interface noch gut sein,

wenn ich mit dem Shogun, neben allem anderen, ein SDI u. HDMI Loop through habe?

Antwort von srone:

... bei der GH4: wozu soll dann das SDI Interface noch gut sein,

wenn ich mit dem Shogun, neben allem anderen, ein SDI u. HDMI Loop through habe?

manchmal sind es die kleinen dinge, wie zb 12v eingang, audio, hd-sdi - das stabilere signal, die zählen. aber das mag jeder in seinem produktions-umfeld für sich entscheiden dürfen. ;-)

lg

srone

Antwort von VideoUndFotoFan:

Stefan Czech zeigt ja in seinem Video, daß die GH4 auch UHD/24p/10bit/4:2:2 aus ihrem HDMI heraus liefert (sie selbst wohlgemerkt, und nicht aus dem Ziegelstein, den Panasonic ja zusätzlich für die GH4 anbietet (ich jedenfalls habe die GH4 auf dem Video nackt und ohne Ziegelstein gesehen!)).

Weiß jemand sicher und zuverlässig, welche Firmware dafür in der GH4 notwendig ist?

Die aktuelle, oder die gerüchteweise von irgendwem angekündigte spezielle für den Shogun? Also die, von der niemand weiß, ob Panasonic sie jemals als Update für die GH4 liefern wird?

Antwort von klusterdegenerierung:

Also jetzt ist auch mal Zeit zum meckern!

Was mir ziemlich negativ auffällt und hoffentlich nicht so bleibt, ist die obere Bildrandsteuerung zum einstellen des Codecs etc.!

Das ist wirklich pisselkram und nix für Erwachsene, sondern nur für Chinesische kleine Kinderfinger!! :-(((

Bis ich es geschaft habe in das obere Menü zu kommen, hat es sich ca. 15x eingeklappt und min genauso oft garkeine response gezeigt.

Zwischenzeitlich dachte ich schon das er kaputt ist!!

wer bitteschön trifft schon ein 2mm Icon mit einem min ein quadrat cm Fingerkuppe richtig??

Was mir auch etwas unbehagen bereitet ist das wenn ich die Cam mal auf Slomo einstelle, das obere Menü sich garnicht mehr entern lässt!

Was mir auch Sorge bereitet ist das der Powerbutton bei mir zu einer Seite viel mehr nach innen gedrückt wird als auf der anderen Seite.

Wenn ich bedenke das ich ihn fürs ausschalten länger reindrücken muß, habe ich jetzt schon Angst das er mir dann irgendwann zur Seite abschmiert! :-((

Find ich jetzt nicht so prickelig, Atomos!

Antwort von StefanFilm:

Hallo, ich habe gerde meine Arbeit beendet und den von vielen gewünschten 4k UHD clip online gestellt.

NEWS: Atomos Shogun feets Sony A7S..best of in 4k UHD: http://youtu.be/menAX79_Q7c

Nach dem sehr großen Erfolg in den ersten 24 Stunden, sage ich einfach einmal Danke.

Wie ich gesehen habe wird der Link hier im Forum fleisig geteilt.

Ich werde mich hüten, mich in diese Diskusionen einzumischen.

Aber vielleicht sollten die ein oder anderen "Teilnehmern" dieses Forums einmal mehr ihre Posts durchlesen bevor sie sie abschicken.

Ein letzte Sache möchte ich noch beantworten: Ja man kann eine Musik Video auch ohne Mikrofon drehen. Muß man aber nicht.

Was der ein oder andere in ein Making of Video gesehen hat, und was am ende auf meinem Schnittplatz landet, ist vielleicht nicht immer für den aussen stehenden zu erkennen.

Und ja, alle Atomos Geräte nehmen Ton auf, wenn er von der Kamera kommt. Die Canon 5D MarkIII z.B. gibt keinen Ton aus. Die Sony A7S, GH4, C100 aber schon.

Mit freundlichen Grüßen

Stefan Czech

Antwort von TonBild:

Und ja, alle Atomos Geräte nehmen Ton auf, wenn er von der Kamera kommt. Die Canon 5D MarkIII z.B. gibt keinen Ton aus. Die Sony A7S, GH4, C100 aber schon.

Mit freundlichen Grüßen

Stefan Czech

Danke für die Info und schönes Weihnachtsfest!

Antwort von klusterdegenerierung:

Ich werde mich hüten, mich in diese Diskusionen einzumischen.