Wer als Premiere Pro CC-User nicht extern farbkorrigiert und nicht auf Plugins wie Colorista zurückgreift, wird mit hoher Sicherheit die "Lumetri-Engine" benutzen, was Lumetri zum wahrscheinlich meistbenutzten Effekt in Premiere Pro CC macht.

Trotz des einfachen Aufbaus der Grading-Kontrollen innerhalb des Effektes ist Grundlagen-Wissen natürlich nie verkehrt und kann - je nach Footage - zu deutlich besseren Ergebnissen führen. Denn die Wahrscheinlichkeit ist groß, dass viele Premiere Pro CC-User den Lumetri-Effekt auf die folgende Weise noch nie benutzt haben:

LUTs und Highlight-Informationen

Generell gilt: Eine auf Video-Footage angewandte LUT (egal ob sie technisch oder kreativ benutzt wird) "mappt" alle Farbwerte über die in der LUT gespeicherten Farbtransformationen auf entsprechende Zielwerte. Während Premiere Pro intern durchgehend mit 32bit (linear) arbeitet, heißt das aber nicht, dass entsprechendes Material beim Anwenden einer LUT seinen Dynamikumfang behalten kann. Denn eine LUT kann auch beispielsweise die Highlights entsprechend ummappen, so dass es anschließend nichts mehr "zurückzuholen" gibt.

Die wenigsten Cutter arbeiten mit HDRI-Dateien auf einer normalen SDR-Timeline, aber im Jahr 2021 haben ja zum Glück schon viele Prosumer-Kameras eine Möglichkeit der Log-Aufnahme (mitunter sogar in 10bit oder RAW). Damit hat das Material Blendenumfangs-Reserven, die man mitunter gerne wieder ins Material bringen würde. Und genau da liegt das Problem verborgen - denn der Lumetri-Effekt in seiner "Basic-Correction" gibt einem gleich zu Anfang die Möglichkeit, die Input LUT ("Eingabe-LUT" in der deutschen Version) auszuwählen und wahrscheinlich machen das 99% der Benutzer auch genau so.

Die Position entscheidet

Erst danach, direkt darunter, kann man den Weißabgleich und die Belichtung einstellen. Was aber heißt: Man arbeitet schon auf dem "von der LUT gemappten" Material, und wenn man jetzt zum Beispiel die Belichtung runterdreht, zieht man beschnittene Highlights von "weiß" nach "grau".

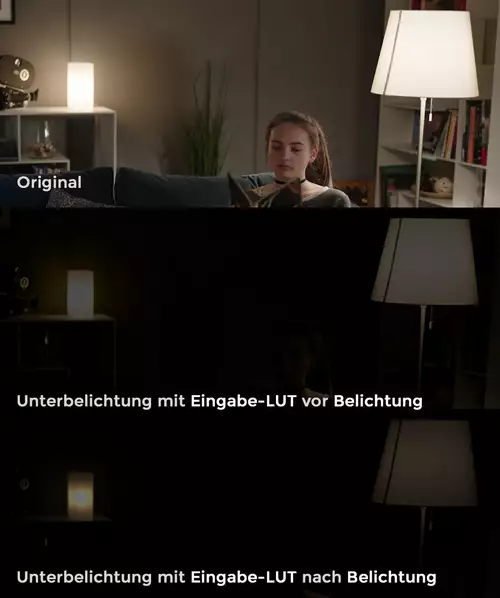

Zur Demonstration: Für einen einfachen Vergleich benutzen wir Arri Alexa-Beispiel-Footage, das für Testzwecke für jeden hier runterladbar ist:

Natürlich ist der ALEVIII-Sensor zurecht Branchenstandard in Sachen Dynamikumfang und Highlight-Rolloff, das Ergebnis ist aber auf jede andere Kamera anwendbar, die eine Log- oder RAW-Aufnahme ermöglicht - halt je nach Kameratyp mit mehr oder wenig guten Ergebnissen.

Als Beispiel nehmen wir eine Testszene aus dem Arri-Showroom mit zwei Lichtern im Shot, beide sind durch Lampenschirme diffusioniert, aber trotzdem werden wir gleich Highlights im Material erkennen.

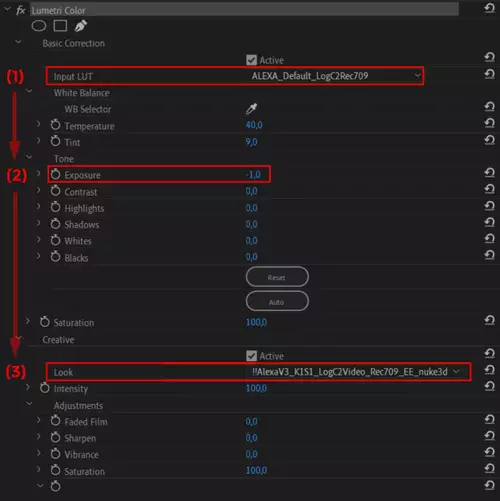

Bei der Input-LUT ([1] im Bild) wählen wir die Lumetri-Standard-Vorgabe "Alexa_Default_LogC2Rec709", was das "Original"-Bild ergibt, so wie es auf einem SDR-Monitor auch beim Dreh angezeigt wurde.

Wenn man jetzt etwas weiter unten im Lumetri-Panel ([2] im Bild) die Belichtung stark runterschraubt, erkennt man nach einigen Blenden, dass der Inhalt der Lampen flächig grau wird - wir ziehen geclippte Bildteile weiter ins Dunkle, was keinen schönen Rolloff ergibt.

Und nun der Vergleich: Die LUT bleibt, aber diesmal wird die Unterbelichtung von einigen Blenden in einem zweiten Lumetri-Effekt durchgeführt, der im Effekt-Panel VOR den Effekt mit der angewandten log2Rec709-LUT geschoben wird. Und siehe da - bei entsprechender Unterbelichtung ist in beiden Lampen eine runde Aura der Glühbirnen zu sehen, zudem tendieren die Farben in den Highlights dazu, wärmer zu werden, und eben nicht grau.

Den gleichen Effekt kann man übrigens erzielen, wenn man im Lumetri-Effekt die Belichtung ganz normal verändert, die LUT aber erst einen Schritt weiter unten in der "Creative"-Sektion (Im Bild[3]) benutzt, nicht schon bei (1) bei den "Basic Corrections". Denn auch dann kommt - wie wenn wir vorher den zweiten Lumetri-Effekt zum Abdunkeln davor benutzt haben - "Exposure" zuerst, danach erst die LUT. D.h. intern macht Lumetri durchaus alles richtig, denn mit dieser Reihenfolge arbeiten auch Profi-Coloristen in ihrer jeweiligen Software - die LUT kommt nie zuerst (wenn sie denn LUTs benutzen). Nur die Aufbereitung und Präsentation innerhalb des Lumetri-Effekts verleitet leider einfach dazu, mal schnell eine der Standard log-2-rec709-LUTS aus dem ersten Dropdown-Menü Input LUT zu wählen und nicht weiter über die Konsequenzen nachzudenken.

Nur für PixelPeeper relevant?

"Aber was bringt mir der ganze Aufwand? Wann ziehe ich mein Footage schonmal SO stark runter, dass ich den Unterschied sehe?" fragt ihr Euch hier jetzt sicher. Und das absolut mit Recht, denn kaum einer, der die Belichtung beim Dreh nicht ganz versemmelt hat, Testcharts für Kameratests dreht oder ein Noisefloor-Fetischist ist, würde derart viele Blenden nach unten korrigieren wollen.

Aber es gibt einen sehr gebräuchlichen Fall, wo wir im täglichen Gebrauch an die mit dem "Falsche Reihenfolge-Workflow" geschaffenen Grenzen stoßen: Bei gewöhnlichen Schwarzblenden!

Wenn man jetzt nämlich einfach die Transparenz seiner Clips animiert, dann macht man genau das gleiche, man bekommt bei seinen Highlights wieder die grauen Flächen. Je länger eine Schwarzblende andauert, desto stärker ist der Effekt, und desto video-artiger sieht das Ergebnis aus.

Wenn man die Blende aber nicht mit der Transparenz des Clips steuert, sondern mit einer animierten Unterbelichtung die VOR der LUT passiert, dann kann man auch noch die letzten Bits an Informationen, die im Ursprungsmaterial waren, nutzen - bei Schwarzblenden sieht man das ganz stark an großen hellen Stellen wie z.B. einer Sonne, die groß im Bild ist.

Hier im Youtube-Video der Vergleich, wiederum mit ARRI-Testmaterial, damit es jeder nachvollziehen kann:

Auf der linken Seite sehen wir, wie es aussieht, wenn man die LUT vor der Schwarzblende setzt (egal ob es eine animierte Belichtung ist oder das Runterziehen der Transparenz des Clips) und auf der rechten Seite das Ergebnis, wenn die Reihenfolge "stimmt": Der Himmel behält noch länger Zeichnung und ganz besonders bei der Sonne in der Gegenlicht-Situation sieht man sehr schnell nur noch einen grauen Fleck, obwohl durchaus noch einiges an Zeichnung "drin gewesen" wäre.

Es gibt übrigens einen gut versteckten kleinen Hinweis, dass den Premiere-Entwicklern der "richtige Workflow" durchaus bekannt ist und er korrekt implementiert wurde - denn wenn man z.B. Alexa- oder Amira-ProRes-Material auf die Timeline zieht, wird automatisch ein Lumetri-Masterclip-Effekt hinzugefügt, mit einer eigenen "embedded LUT". Und - siehe da - die findet sich nicht bei der INPUT LUT, sondern automatisch in der "Creative"-Sektion. Genau da, wo sie hingehört.

Fazit

Ist das Ganze mehr Arbeit? Definitiv. Wir sind zwar nicht mehr alle auf der Suche nach dem ultimativen Filmlook wie noch zum Anfang der digitalen Kamera-Revolution, aber trotzdem kommt man meiner Meinung nach an diesem kleinen Mehr-Aufwand nicht vorbei, wenn man "cinematische Ergebnisse" haben will. Und ganz ehrlich: Wir pixel-peepen Kamera-Modelle bis zum Umfallen und entscheiden uns am Ende für das Modell mit einer halben Blende mehr an Dynamik-Umfang. Dann sollte der eigene Color-Grading-Workflow aber auch stimmen, damit man im Endprodukt (auch auf herkömmlichen Nicht-HDR-Monitoren) etwas von dieser Kamera-Qualität sehen kann.

Happy Grading!

Steffen Hacker

Der Autor ist VFX-Supervisor, Regisseur, Adobe Influencer, langjähriger Premiere Pro-User und kann unter alexandsteffen.com erreicht werden.