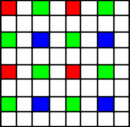

Newsmeldung von slashCAM:Ein neues Canon Patent beschreibt ein weiteres Sensor-Filter-Pattern, das eine deutlich erhöhte Lichtausbeute gegenüber dem typischen Bayer-RGGB-Pattern erreichen dürfte....

Hier geht es zur Newsmeldung auf den slashCAM Magazin-Seiten:

Hier geht es zur Newsmeldung auf den slashCAM Magazin-Seiten:

Neues Canon Sensor Patent: Luma vor Chroma

Antwort von piano_jochen:

Der Sensor für alle Kriminalfilme, wo nie die Sonne scheint und die Farbsättigung bei maximal 30% liegt. Den Blaustich kann man ja nachträglich reingraden... :-D

Antwort von nic:

Eine gemessenes Blau um daraus 16 Pixel zu errechnen? Da scheint aber jemand sehr an die neuen Algorithmen zu glauben.

Antwort von WoWu:

Man wird sich in Super Resolution von den bekannten Rastern lösen müssen denn die Anzahl der ausgelesenen Pixels ist deutlich geringer, als die Zielauflösung.

Bei solchen Sensoren wird daher zusätzlich noch gebinnt, sodass sich das Verhältnis aus Luminanz und Chroma zugunsten von Chroma wieder verschiebt.

Der Trend ist also für SR durchaus konsequent, den Schwerpunkt auf höhere Lichtausbeute einer relativ kleinen Fläche zu setzen, die Menge der ausgelesenen Pixels (über ein Binning) zu verkleinern und die Zielpixels über Patches zu erhöhen.

Das wird wohl zukünftig so aussehen.

Antwort von iasi:

Ein guter Ansatz.

Da die Sensel eh so klein geworden sind und die Rechenleistung stark zugenommen hat, ist es eigentlich nur konsequent, die Daten zu verfeinern.

Ob ein Sensel nun Blau ist oder einer aus einer Gruppe von 4 mit derselben Größe, ändert am DeBayer-Ergebnis nichts. Die verfeinerte Helligkeitsmessung in dieser Gruppe bringt jedoch viel.

WoWu predigt ja immer, dass die Objektive eh nicht so fein auflösen können, dass sie solch kleinen Sensel gerecht werden könnten. Aber solche Gruppen könnten sie durchaus abdecken.

Das Mehr an Daten lässt sich dann wirklich durch entsprechende Algorithmen auswerten und nutzen - die zunehmende Rechenpower muss ja auch sinnvoll genutzt werden.

Ich denke auch, dass es Canon gar nicht so sehr um hohe Empfindlichkeit geht. Den DR kann man hierdurch erheblich erweitern. Wenn die filterlosen Sensel schon clippen, liefert der Farbsensel noch Werte. Andererseits liegen die filterlosen Sensel noch im unproblematischen Bereich, während die Farbwerte schon im Rauschen untergehen.

Mir gefällt dieser Ansatz.

Daraus kann man mehr machen, als aus jeder Doppelbelichtung.

Die Farbwerte in den Schatten kann man zudem aus den Senseldaten um die jeweiligen Farbsensel errechnen. Und wenn alle drei RGB-Werte auf Null gehen, ist es eh in Wirklichkeit auch nur noch dunkelstes Grau bzw Schwarz.

Luma

und Chroma - gemeinsam sind sie stark.

Man kann ja die ständig steigenden Senselzahlen auch mal zur Weiterentwicklung des Bayer-Prinzips nutzen.

Antwort von iasi:

Der Trend ist also für SR durchaus konsequent, den Schwerpunkt auf höhere Lichtausbeute einer relativ kleinen Fläche zu setzen,

Ich denke, es geht um feinere Werteabstufungen - und eben um höheren DR.

Die Zielauflösung wird bei Bayer-Sensoren ja eh immer hochgerechnet.

Aber man kann bei den Berechnungen ja durchaus Qualität vor Quantität stellen und eben die Zielauflösung beschränken.

Eben 4k aus einem solchen 8k-Sensor.

Antwort von iasi:

Eine gemessenes Blau um daraus 16 Pixel zu errechnen? Da scheint aber jemand sehr an die neuen Algorithmen zu glauben.

Wo soll denn hier die Schwierigkeit liegen?

Du hast nur mehr Werte, die du nutzen kannst, als bisher.

Ob du nun einen Blauwert erhälst oder einen Blauwert zusammen mit mehreren Helligkeitswerten, macht das Ergebnis nicht schlechter - im Gegenteil.

Du hast genau dieselben Farbwerte wie beim althergebrachten Bayer - aber eben weit mehr Helligkeitswerte, die sich viel feiner zugeordnen lassen.

Antwort von Bommi:

Ob du nun einen Blauwert erhälst oder einen Blauwert zusammen mit mehreren Helligkeitswerten, macht das Ergebnis nicht schlechter - im Gegenteil.

Stimmt genau aber natürlich nur, wenn das Endergebnis ein Schwarz/Weiß-Film werden soll.

Ich frage mich, warum der #Aufschrei der 4:4:4-Apologeten ausbleibt. Wenn ich beim abgebildeten Raster richtig durchgezählt hab, wird uns hier eine Farbunterabtastung von 16:2:0! angeboten.

Antwort von WoWu:

Das trifft nur zu, wenn nicht gebinnt wird.

Wird die spatiale Auflösung im Patching erreicht, trifft das nicht zu.

Antwort von Bommi:

Ist richtig, WoWu. Hattest du schon in deinem ersten Post hier erwähnt und ich hab's auch berücksichtigt.

Denn die Frage ist doch, wie der Sensor vermarktet wird; dazu wird garantiert nicht die 'gebinnte' Auflösung in den Specs verkündet. Ein unbedarfter Kunde könnte getäuscht werden mit z.B. so einer 8K-Kamera.

Ich finde das Canon-Konzept sehr interessant und könnte mir vorstellen, dass es für bestimmte Workflows von Vorteil ist

- ganz besonders bei einer redundant hohen Auflösung des Quellmaterials, um daraus einen niedriger aufgelösten Film zu erstellen (der typische 4k -> FullHD Workflow).

- aber auch, wie von piano_jochen erwähnt, für Außenaufnahmen bei wenig Licht für stimmungsvolle Krimis o.ä.

Antwort von WoWu:

Ja, ich denke auch, dass man erst mal abwarten muss, in welchen Ausführungen Canon mit dem Sensor kommt und ihn einsetzt.

Ein Patent muss bei Firmen ja auch nicht automatisch in Produkte einfließen.

Zumal RGBW ist ja nun alles Andere als neu ist und auch Sony setzt es schon eine ganze Weile ein.

Aber dass die Sensorauflösung nur noch sehr begrenzt mit der Bildauflösung zu tun hat, daran sollten wir uns mittlerweile gewöhnt haben und getäuscht werden können dann nur noch die, die das bisher nicht nachvollziehen können und die beiden Parameter immernoch verwechseln.

Antwort von iasi:

Ist richtig, WoWu. Hattest du schon in deinem ersten Post hier erwähnt und ich hab's auch berücksichtigt.

Denn die Frage ist doch, wie der Sensor vermarktet wird; dazu wird garantiert nicht die 'gebinnte' Auflösung in den Specs verkündet. Ein unbedarfter Kunde könnte getäuscht werden mit z.B. so einer 8K-Kamera.

Ich finde das Canon-Konzept sehr interessant und könnte mir vorstellen, dass es für bestimmte Workflows von Vorteil ist

- ganz besonders bei einer redundant hohen Auflösung des Quellmaterials, um daraus einen niedriger aufgelösten Film zu erstellen (der typische 4k -> FullHD Workflow).

- aber auch, wie von piano_jochen erwähnt, für Außenaufnahmen bei wenig Licht für stimmungsvolle Krimis o.ä.

wenig Licht?

Weshalb denkt eigentlich jeder immer gleich an Low Light?

Die Sensoren sind doch eh schon längst um zig Blenden empfindlicher als Negativfilm.

Wenn ich für ein Pixel nun 4 Farb- und 16 Helligkeitwerte zur Verfügung habe, die dann auch noch in ihrer Empfindlichkeit aufgrund Filter/-nicht Filter gespreitzt sind, kann ich eben ganz andere Berechnungen anstellen, als bisher.

Hier ist der Ansatz für erweiterten DR und bessere Abstufungen.

Man könnte ja durchaus auch noch mit "ND-Filtern" vor einigen Senseln für noch weitere Spreizung der Helligkeitserfassung arbeiten.

Zum Beispiel RGB wie gehabt plus 2 Blenden in den Schatten ohne Filter und 2 Blende in den Lichtern mit "ND-Filtern".

Diese Werte zusammenzufassen, braucht dann zwar etwas mehr Rechenleistung, aber die gibt"s mittlerweile ja ausreichend. Erweitertes DeBayer statt simples Binning.

Aus einem 8k-Sensor erhält man dann z.B. 4k - mit einem um 4 Blendenstufen erweiterten DR - sowie weiterer Vorteile ...

Und selbst wenn man dann daraus 8k hochrechnen will, ist die Datenbasis zumindest nicht ganz schlecht.

Antwort von iasi:

Aber dass die Sensorauflösung nur noch sehr begrenzt mit der Bildauflösung zu tun hat, daran sollten wir uns mittlerweile gewöhnt haben und getäuscht werden können dann nur noch die, die das bisher nicht nachvollziehen können und die beiden Parameter immernoch verwechseln.

Das ist natürlich nicht neu - seit Sigma den Fovoen baut, hauen sie auf die Trommel und erklären, Bayer-Sensoren hätten weit geringere Auflösung. dabei lassen sie jedoch außer Acht, dass die Algorithmen durchaus Wirkung zeigen.

Antwort von Bommi:

Wenn ich für ein Pixel nun 4 Farb- und 16 Helligkeitwerte zur Verfügung habe

Wo willst du denn 4 Farb- und 16 Helligkeitswerte für ein Pixel hernehmen?

Antwort von WoWu:

Aus dem Bin. Wobei die dann natürlich nicht mehr als Einzelwerten auftauchen sondern als Clusterwerte.

Antwort von Bommi:

Aus dem Bin. Wobei die dann natürlich nicht mehr als Einzelwerten auftauchen sondern als Clusterwerte.

Also, ich kenne nur das 'binning'

zu einem Bin nicht

aus einem Bin. Von daher ist meine Frage nicht beantwortet.

Antwort von iasi:

Aus dem Bin. Wobei die dann natürlich nicht mehr als Einzelwerten auftauchen sondern als Clusterwerte.

Spannend wird doch aber, wie aus diesen Einzelwerten der Clusterwert errechnet wird. Ich denke, darin liegt enormes Potential.

Wie gesagt: Rechenpower dürfte (zumindest bald) ausreichend vorhanden sein.

Wir sind bei 5fps mit

Max Resolution‎: ‎50.3 MP: 8688 x 5792

für unter 4000$.

Sinnvoll, die Bayer-Technik weiterzuentwickeln, statt immer nur mehr RGGBs auf den Sensor zu quetschen.

Antwort von WoWu:

Aus dem Bin. Wobei die dann natürlich nicht mehr als Einzelwerten auftauchen sondern als Clusterwerte.

Also, ich kenne nur das 'binning'

zu einem Bin nicht

aus einem Bin. Von daher ist meine Frage nicht beantwortet.

Wenn schon, dann Binning zu einem Cluster und daraus entsteht ein Wert. wobei ein Cluster nicht aus direkt zusammenliegenden Pixeln gebildet werden muss, insofern kann ein Binning also auch aus entfernten Pixels geschehen.

Binning ist nur der Vorgang. Cluster ist das Ergebnis, das Bin beschreibt den gesamten Pixelraum, aus dem auch unterschiedliche Cluster gebildet werden können.

Insofern hast Du die Clusterwerte,

AUS einem Bin.

Antwort von WoWu:

Aus dem Bin. Wobei die dann natürlich nicht mehr als Einzelwerten auftauchen sondern als Clusterwerte.

Spannend wird doch aber, wie aus diesen Einzelwerten der Clusterwert errechnet wird. Ich denke, darin liegt enormes Potential.

Wie gesagt: Rechenpower dürfte (zumindest bald) ausreichend vorhanden sein.

Wir sind bei 5fps mit

Max Resolution‎: ‎50.3 MP: 8688 x 5792

für unter 4000$.

Sinnvoll, die Bayer-Technik weiterzuentwickeln, statt immer nur mehr RGGBs auf den Sensor zu quetschen.

Eigentlich ist das schon lange geschehen.

Leider wurde von den meisten Herstellern aber nur das Kodak Pixelux, das am häufigsten verwendete Binning Schema angewandt, das jeweils vier benachbarte Pixel-Werte kombiniert, um ein Superpixel zu bilden.

Dieser Prozess der Kombination entspricht der Anwendung einer Faltungsoperator gefolgt von Downsampling und ist lange nicht "das Gelbe vom Ei"

PhaseOne ist da schon etliche Jahre weiter mit ihrer Binning Methode ... aber man muss wirklich erst einmal abwarten, was Canon da wirklich macht.

Alle Andere ist nur Spekulation, aber ich denke auch, dass das größere Potential mittlerweile in der Pixelqualität statt dem Versuch liegt, einfach nur mehr spatiale Auflösung vorzugaukeln, mit all den bekannten Problemen.

Antwort von iasi:

Alle Andere ist nur Spekulation, ...

Entwicklungen liegen durchaus auf der Hand.

Eine Digitale Cine-Cam musste irgendwann kommen, nachdem die Digi-Still-Cams immer höhere Auflösungen mit steigenden Frameraten bewältigten.

Nun sind wir an einem Punkt angelangt, wo höhere Frameraten und höhere Pixelzahlen eine sich verringernde Käuferschicht ansprechen - 8k und 1000fps brauchen nicht viele Leute.

Aber man kann eben nunmal mit immer höheren Datenmengen umgehen - folglich liegt es nahe, dass nun andere Bereiche weiterentwickelt werden.

Begeisterung erntet Reds Helium weniger für die 8k als vielmehr durch das bessere Rauschverhalten.

Schraub an eine Alexa65 ein softes Objektiv, dann sind die 4k auch in weite Ferne gerückt - aber an den Flares ziehen sie sich dann hoch, diejenigen, die die Linse davor gehängt hatten.

Ich denke auch, dass das ISO-Rennen ein Ende findet - über die ISO2000 bei Sonys slog stöhnt schon so mancher. Und ND-Filter verbessern die Bildqualität auch nicht gerade.

Bald haben wir sie: Die 4k (Endauflösung) Kamera mit einem weichen Auslaufen der Lichter, sehr geringem Rauschen tief hinunter in den Schattenkeller, feine Farbwiedergabe und alles in einem kleinen leichten Body.