Frage von Schwermetall:Hallo zusammen,

ich hatte die Möglichkeit ein Macbook Air mit dem M1 Prozessor mit meinem Win 10 Rechner (Intel i7-8700k; 32GB RAM; GTX1070Ti) zu vergleichen.

Da ich nach all den sehr guten Test des M1 schon überlegt habe auf den Mac mini mit dem M1 umzusteigen,

sollte erstmal ein Vergleich mit meinem persönlichen Nutzungsprofil gemacht werden.

Als Programm habe ich ReSolve Studio 17 verwendet.

Als GPU war Metal-M1 bzw. Cuda gewählt. Timeline Proxymode war bei beiden auf off.

In der Timeline hatte ich 4 kurze Videosequenzen von der Fujifilm X-T4 (2x h264; 2x h265; alle in UHD mit 60fps) als eine Spur.

Bei der Wiedergabe lief alles mit 59,94 fps, nur bei h265 gab es ab und zu bei beiden Rechnern Mikroruckler.

Als ich bei den Sequenzen "Sharpen" auf die Node (je 1x auf eine h264 und 1x auf eine h265) gelegt hatte, wurde es übel.

Beim Desktop waren es nur noch 28 fps und beim Apple nur noch 8 fps!

Die beiden anderen Sequenzen hatte ich nur mit leichten Grading belegt und da lief alles normal.

Beim Exportieren der Timeline in 4k h264 hat es beim Windows Desktop 6 Minuten gedauert und beim Apple M1 18 Minuten!

Da war ich doch sehr enttäuscht.

Habe ich da einen Fehler im Setup gemacht oder ist das normal?

Danke für eurer Feedback.

Schöne Grüße, Alex

Antwort von roki100:

Hmm, das liest sich nicht gut... :(

Schwermetall hat geschrieben:

Als Programm habe ich ReSolve Studio 17 verwendet.

Die aktuellste 17er Version?

Als GPU war Metal-M1 bzw. Cuda gewählt. Timeline Proxymode war bei beiden auf off.

Cuda ist doch Nvidia. Wenn dann Metal-M1. Auch Resolve beim Wechsel neu gestartet? ich weiß, blöde frage, kann aber sein dass Du das nicht gemacht hast...

Antwort von Schwermetall:

ne, 2 Rechner, 2x Resolve, also unabhängig voneinander.

Auf dem Mac frisch runter geladen und auf dem Windows ist es 17.3.1

Metal auf dem Mac,

Cuda auf dem Windows Rechner

Antwort von roki100:

Okay.

Vielleicht kann jemand hier mit seinem M1 testen und das bestätigen? Ich habe zwar gelesen, dass FCPX schneller mit M1 funkt als Davinci, aber das es so langsam sein kann, ist mir echt neu. Also mein guter Hakintosh mit nem i7 4x 3,41GHz und Radeon RX 580 8 GB, 16GB Ram, schafft mehr fps mit Sharpen Plugin, gerade getestet, 24fps wird in realtime mit 24fps abgespielt und Timeline/Viewer ist auf UHD...Das selbe sogar mit 5K Video.

8fps mit 5K Video habe ich erst dann wenn ich Temporal NR verwende...

Antwort von Schwermetall:

Möglicherweise habe ich im Setup was falsch eingestellt?

Antwort von mash_gh4:

da gibt's viele erklärungen, warum die ergebnisse ein bisserl schrägt ausfallen können.

eine ganz wesentlich ist die tatsache, dass viele de-/kompressions-hardware-beschleunigungslösungen mit 4:2:2 od. 10bit in h.264 nicht gut klar kommen, und in beiden fällen dann wesentlich langsamere lösungen auf der CPU genutzt werden müssen...

aber auch sonst hängt es einfach sehr stark davon ab, wie gut die jeweiligen programme tatsächlich optimiert bzw. auf die verwendete hardware angepasst sind. das macht gerade bei video-anwendungen immer ausgesprochen viel aus.

unter linux, wo ja der code der meisten anwendungen offen zugänglich ist und von den diversen distributionsanbietern in jeweils leicht unterschiedlicher weise für die endanwender übersetzt wird, kann man bspw. regelmäßig beobachten, dass intels clear linux praktisch alle anderen bei ein paar video-typischen benchmarks signifikant abhängt, obwohl eben überall grundsätzlich genau der selbe code exekutiert wird und sehr viele experten umengen auf mühen darauf verschwendet haben, die betreffenden kritischen stellen in allen libraries unmd anwendungen möglichst gut zu optimieren.

bei kommerziellen closed source anwendungen ist das in der praxis leider meist noch wesentlich schlimmer, weil dort eben viel weniger programmierer daran arbeiten und dieser kritische blick von außen bzw. das ständige verbessern und ausmerzen von schwächen durch eine riesige entwicklergemeinde weitestgehend fehlt. im übrigen lässt sich ja hier auch nie so recht abschätzen, wie gut die sachen längerfristig gepflegt werden -- d.h. BMD mag sich zwar große mühe geben, dass die ergebnisse auf M1-hardware bzw. im metal-umfeld momentan, wo das in der öffentlichkeitsarbeit gerade gut ankommt, möglichst gut aussehen, aber ob man sich auch längerfristig darum kümmern wird, ist damit noch lange nicht gesagt. das sehe ich vor allem auch deshalb so, weil man ja bzgl. ihres intel-iGPU-supports aber auch im hinblick auf all die probleme mit dem nvidia GPU-ressourcenverbrauch immer wieder ganz klar vor augen geführt bekommt, wie wenig BMD sich in wahrheit um diese probleme kümmert bzw. wie schlecht sie das im griff haben.

Antwort von dienstag_01:

Das wird eine Frage ausschließlich der GPU sein, da scheint es erhebliche Unterschiede zu geben.

Antwort von hexeric:

hier wird einem 'air' auch etwas viel abverlangt. mini m1 oder speziell die neuen m1 pro ziehen an allem vorbei...auch mit resolve (fast schneller als fcp ... je nach format)

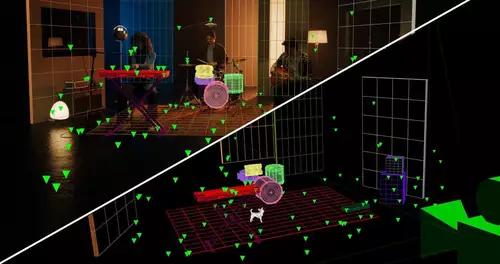

Antwort von acrossthewire:

Soweit ich erinnere hat das Air keine aktive Kühlung taktet also bei Extrembelastung nach unten. Das Delivery passiert meist auf der GPU weshalb die CPU oft am Däumchendrehen ist. Und nur mal so zur Erinnerung: Das Air ist das Einstiegsnotebook bei Apple. Hier die Auslastung mal bei einemBildschirmfoto 2021-11-08 um 11.56.23.png Export zu HD von 4kDCI50p BRAW Clip mit Temporal NR und Edgesharping.

Antwort von Axel:

Schwermetall hat geschrieben:

Als Programm habe ich ReSolve Studio 17 verwendet.

Als GPU war Metal-M1 bzw. Cuda gewählt.

Ich würde bei einem Apple-Computer von der Stange gar nichts "wählen", sondern die Einstellung auf AUTO lassen:

zum Bild

Denn "optimiert für M1" bedeutete bisher optimiert für drei Geräte, aus die Maus. Während bei Intel mit Nvidia oder was auch immer alle möglichen und unmöglichen Kombinationen denkbar sind und waren. Deswegen gab es früher ziemlich genau definierte Hardware-Empfehlungen von Blackmagic.

Schwermetall hat geschrieben:

Als ich bei den Sequenzen "Sharpen" auf die Node (je 1x auf eine h264 und 1x auf eine h265) gelegt hatte, wurde es übel.

Beim Desktop waren es nur noch 28 fps und beim Apple nur noch 8 fps!

Bei einer 25p Timeline mit zwei Nodes vorher (HDR-Wheels und Colorwarper) habe ich bei XAVC-I-10-bit-422 sogar nur *7* fps Wiedergabe, während ohne die Sharpen-Node Echtzeit bleibt.

Wenn ich statt des Resolve FX Sharpen allerdings die "normale", manuelle Methode anwende, verliere ich ebenfalls keine Echtzeit.

zum Bild

Das legt nahe, dass dieser Effekt stark GPU-lastig ist. Und eine richtige, eigenständige und vor allem leistungsstarke GPU fehlt nun einmal bei den 2020ern M1.

Ein besseres Schärfen wird ohnehin bei Separieren des Lumakanals erzielt:

... und auf diese dann vierte Node kann ich sogar noch eine weitere, fünfte, dazutun, ohne Echtzeit zu verlieren. Freilich nicht Sharpen, Noise Reduction oder ...

Sobald ich aber den Kontrast in den Farben zu stark erhöhe, erhalte ich Halos. Das wollen wir nicht!

... das neue Halation.

Wie ist das alles nun einzuschätzen, zu bewerten, vergleichbar zu machen? Vor allem, wenn man den von dir erwähnten Hype um M1 berücksichtigt?

Da ist zuerst einmal die Feststellung, dass die M1 Macs alle modernen, stark komprimierten Codecs gut abspielen. UHD HEVC? Klar, sogar PiP mit mehreren Spuren. Eher ist die Performanz bei ProRes nicht besser und daher fast enttäuschend (bei den 2021er MBPs dank spezieller Decoder wiederum doch).

Die M1 (=Einsteiger-) Macs sind daher sehr gut geeignet für Leute, die die in Frage kommenden Codecs verwenden, hauptsächlich schneiden und dann eher überschaubare Farbkorrektur machen. Weil die nämlich, wie Alex Jordan von filmsimplified.com mehrfach demonstriert hat, keinen Unterschied merken würden zu einem vollausgebauten 16" MBP M1 Max für 7000 .

Das MacBook Air hat eine Display-Auflösung von 2560 x 1600. Also selbst wenn man die Vollbildfunktion verwendet, hätte man nur halbe UHD-Auflösung. Das legt nahe, die Projekteinstellung zu 1080p zu ändern, als Wiedergabe-Performanz-Trick. Damit hab ich, ich hab's gerade gecheckt, mit dem erwähnten Sharpen-Filter zwar immer noch nur 20 fps, aber ich kann, wie ich aus Erfahrung weiß, nochmal 2-5 "normale" Nodes in die Pipeline schieben, mit Echtzeit.

Ein externes UHD-Display kostet nochmals ein wenig GPU-Power. Wenn man meint, man braucht das (was ich verstehe), dann hat man halt ab der dritten Node keine Echtzeit mehr. Vorher, beim Schnitt, da, wo es auf Echtzeit und Timing ankommt, schon. Früher waren die Grading-Suiten schon für popeliges HD nicht unbegrenzt Echtzeit, was erwarten die Leute eigentlich für round about 1000 Öre?

Antwort von cantsin:

Axel hat geschrieben:

Früher waren die Grading-Suiten schon für popeliges HD nicht unbegrenzt Echtzeit, was erwarten die Leute eigentlich für round about 1000 Öre?

Ich finde es sensationell, dass Resolve überhaupt auf einem 1000-Euro-Notebook läuft, und umgekehrt, dass dieses Notebook mit seiner Hardware (vor allem dem Bildschirm qua Auflösung und Farbreproduktion) das auch praxistauglich unterstützt.

Dass man von einem Macbook Air keine Color Grading-Workstation-Performance erwarten kann - und dafür noch einen leistungsstarken stationären Rechner einsetzt -, liegt doch auf der Hand. Es ist höchstens die Schuld der üblichen YouTube-Influencer und Foren-Fanboys, wenn die die o.g. Tatsachen aufbauschen und überzogene Erwartungen wecken.

Antwort von mash_gh4:

cantsin hat geschrieben:

Ich finde es sensationell, dass Resolve überhaupt auf einem 1000-Euro-Notebook läuft, und umgekehrt, dass dieses Notebook mit seiner Hardware (vor allem dem Bildschirm qua Auflösung und Farbreproduktion) das auch praxistauglich unterstützt.

natürlich ist es fein, dass man heute auch bereits auf sehr günstiger hardware ganz erstaunliches erledigen kann, trotzdem ist das natürlich längst nichts ungewöhnliches mehr.

resolve ist hier halt eher eine ganz ungute ausnahmeerscheinung, oder fällt dir auf die schnelle eine anwendung ein, die noch mehr ressourcen verschwendet bzw. ungutere hardwareanforderungen stellt, um überhaupt zu starten?

in der regel läuft alles "irgendwie" auch auf solchen einfachen geräten, wenn man sich seitens der entwickler nur ein wenig darum bemüht..

das könnte bekanntlich auch mit intel hardware und in der linux-ausgabe bei resolve der fall sein -- wie gesagt: wenn sich bei BMD nur ein wenig darum bemühen würde... was man aber ganz offenbar nicht sehr ernsthaft betreibt...

Antwort von Axel:

Nicht nur Intel und Blackmagic erleben hier Fortschritt. Madhevs Brille ... - früher hätte er wohl so genannte Flaschenböden gehabt. Ist euch mal aufgefallen, dass es solche Brillen gar nicht mehr zu geben scheint außer in Scherzartikelläden?

Antwort von rush:

Back zur M1 Ausgangssituation... Handelt es sich um die 8/8 Core Variante oder die 8/7 Core Base? Keine Ahnung ob das relevante Unterschiede macht - vermutlich eher nicht aber es gibt da ja zumindest beim Air beide Varianten wo das eine Modell einem Grafikkern mehr vorweisen kann. Vermutlich eher Messetoleranz? :+)

Antwort von cantsin:

mash_gh4 hat geschrieben:

resolve ist hier halt eher eine ganz ungute ausnahmeerscheinung, oder fällt dir auf die schnelle eine anwendung ein, die noch mehr ressourcen verschwendet bzw. ungutere hardwareanforderungen stellt, um überhaupt zu starten?

Nein, aber Google Chrome/Chromium ist nicht weit davon entfernt...

Antwort von Axel:

Vor 20 Minuten aufgetaucht:

Den Nachmittag verbrachte ich auch mit Resolve. Ich stellte zwar keinen Timeline Proxy Mode auf Viertel-Auflösung, aber stellte UHD auf 720p. Komplette Echtzeit, mit 10, 12 Nodes, Halation dabei (als ersten Node, wie von Waqas Qazi vorgeschlagen, weil bei Film Halos und Filmkorn "nativ" sind und vor der Korrektur kommen). Das Umschalten auf volle Auflösung zur besseren Beurteilung ist banal. Kann entweder gerendert werden oder im Standbild beurteilt oder beides. Wie sich zeigt, hilft hier ein M1 Pro oder Max gelegentlich und teilweise, aber nicht grundsätzlich.

rush hat geschrieben:

Back zur M1 Ausgangssituation... Handelt es sich um die 8/8 Core Variante oder die 8/7 Core Base? Keine Ahnung ob das relevante Unterschiede macht - vermutlich eher nicht aber es gibt da ja zumindest beim Air beide Varianten wo das eine Modell einem Grafikkern mehr vorweisen kann. Vermutlich eher Messetoleranz? :+)

Alles, was man sagen kann ist, dass die Specs sich nicht mit der Diversified Architektur (ähhm, im Gegensatz zum Unified Memory) vergleichen lassen. Selbst mit 40 x Chrome-Seiten, 50 x 48 MP-Lightroom-Raws, Windows 11 auf Parallels und einem 500 GB FCP-Projekt nur aus hunderten Long-Gop-Fitzeln und das alles gleichzeitig auf konnten 32 GB Ram auf einem M1 Max nicht angesprochen werden. Für alles reine Video können 16 GB nicht getoppt werden.

Trotzdem gibt es einen Grafik-Flaschenhals, und das je nach Aktion relativ früh und dann mit steilem Leistungsabfall.

Antwort von cantsin:

Axel hat geschrieben:

Alles, was man sagen kann ist, dass die Specs sich nicht mit der Diversified Architektur (ähhm, im Gegensatz zum Unified Memory) vergleichen lassen. Selbst mit 40 x Chrome-Seiten, 50 x 48 MP-Lightroom-Raws, Windows 11 auf Parallels und einem 500 GB FCP-Projekt nur aus hunderten Long-Gop-Fitzeln und das alles gleichzeitig auf konnten 32 GB Ram auf einem M1 Max nicht angesprochen werden. Für alles reine Video können 16 GB nicht getoppt werden.

Trotzdem gibt es einen Grafik-Flaschenhals, und das je nach Aktion relativ früh und dann mit steilem Leistungsabfall.

Aber das ist doch bei Unified Memory letztlich dieselbe Geschichte, oder übersehe ich da etwas? Denn der RAM, der mit Chrome-Seiten, Lightroom-Raws, Windows auf Parallels etc. vollsitzt, ist dann nicht mehr als GPU-RAM verfügbar und führt zum Einbruch der GPU-Performance.

Antwort von Schwermetall:

cantsin hat geschrieben:

Ich finde es sensationell, dass Resolve überhaupt auf einem 1000-Euro-Notebook läuft, und umgekehrt, dass dieses Notebook mit seiner Hardware (vor allem dem Bildschirm qua Auflösung und Farbreproduktion) das auch praxistauglich unterstützt.

Dass man von einem Macbook Air keine Color Grading-Workstation-Performance erwarten kann - und dafür noch einen leistungsstarken stationären Rechner einsetzt -, liegt doch auf der Hand. Es ist höchstens die Schuld der üblichen YouTube-Influencer und Foren-Fanboys, wenn die die o.g. Tatsachen aufbauschen und überzogene Erwartungen wecken.

Ich vermute du hast es auf den Punkt gebracht.

Ich war nur von den ganzen YouTube Reviews geflasht. "8k RAW ..." usw.

Ich habe mir vielleicht mit "FX - sharpen" auch nur die falsche Funktion zum Testen ausgesucht 😉

Aber nicht falsch verstehen, ich finde das Macbook Air trotzdem genial und extrem preiswert.

Danke für eure Rückmeldungen, Alex

Antwort von Axel:

cantsin hat geschrieben:

Für alles reine Video können 16 GB nicht getoppt werden. Trotzdem gibt es einen Grafik-Flaschenhals, und das je nach Aktion relativ früh und dann mit steilem Leistungsabfall.

Aber das ist doch bei Unified Memory letztlich dieselbe Geschichte, oder übersehe ich da etwas? Denn der RAM, der mit Chrome-Seiten, Lightroom-Raws, Windows auf Parallels etc. vollsitzt, ist dann nicht mehr als GPU-RAM verfügbar und führt zum Einbruch der GPU-Performance.

Wieso ist dann einerseits der Großteil des Arbeitsspeichers unbenutzt, während andererseits die Echtzeit verloren geht? Wie gesagt bekommt man auch mit Resolve kaum mehr als 16 GB benutzt und kann mit 64 GB ebenfalls keine temporale Entrauschung in Echtzeit abspielen (das nicht optimierte Premiere fraß sofort allen Ram und war trotzdem lahm und instabil). Das ist doch nur logisch damit vereinbar, dass es gar keine Korrelation zwischen Größe des Speichers und Performanz gibt (bitte nehmen Sie das zur Kenntnis, würde Alex Jordan sagen, please note). Und, wie gesagt, nur um Performanz geht's hier. Aber selbst wenn man Exportzeiten für entscheidend hält, sind die Unterschiede, wenn nicht marginal, so zumindest nicht proportional zur fetteren Ausstattung und Preis.

Zu Schärfen wurde mir eben dieser brandneue Clip vorgeschlagen:

Diesen Filter kenne ich noch gar nicht. Nach allem, was ich verstanden habe, kann er auch Luma und Chroma trennen. Man möchte natürlich - Mostyn erwähnt es selbst - den Filter im Vollbild beurteilen. Das kann man auch ohne Echtzeit, denn wie man sieht spielt Mostyn die Clips gar nicht ab, sondern wendet den Effekt auf dem Standbild an. Das gilt ja für die meisten CC-Operationen.

Antwort von tvontheradio:

ich glaub das hier Erwartungen bzw Hype einfach zuweit von der Realität entfernt sind. Durchaus schuld der Youtuber usw. die da hauptsächlich Vergleiche zu den underpowered Intel Macs der letzten Jahre machen....

Du vergleichst hier einen Desktop PC mit einer 95W CPU + >= 180W GPU mit einer passiv gekühlten 10W Laptop-CPU.

Alleine schon der RAM von dem Desktop wird ungefähr soviel Strom verbrauchen wie gesamte M1 CPU/GPU/RAM-Kombi.

Wenn man das so betrachtet ist es also schon sehr beachtlich was M1 mit dem 1/30tel an Stromverbrauch schafft. Aber es bleibt ein günstiges Einstiegsgerät das nicht auf Dauerlast (= Rendering) ausgelegt ist.

Antwort von cantsin:

Axel hat geschrieben:

cantsin hat geschrieben:

Aber das ist doch bei Unified Memory letztlich dieselbe Geschichte, oder übersehe ich da etwas? Denn der RAM, der mit Chrome-Seiten, Lightroom-Raws, Windows auf Parallels etc. vollsitzt, ist dann nicht mehr als GPU-RAM verfügbar und führt zum Einbruch der GPU-Performance.

Wieso ist dann einerseits der Großteil des Arbeitsspeichers unbenutzt, während andererseits die Echtzeit verloren geht?

Das könnte kein Problem der RAM-Kapazität, sondern der RAM-Bandbreite bzw. Bus-Geschwindigkeit sein. Alle die laufenden Anwendungen/Prozesse nagen an dieser Bandbreite, so dass da nicht mehr genügend GPU-Speicher-Durchsatz bleibt. Dieses Problem hat man dann eben nicht mit einer dezidierten GPU mit ihrem eigenem GPU-RAM und Speicherinterface.

Antwort von Axel:

Als Impulskäufer, der sich stetig Sorgen macht, wie groß der Wertverlust durch galoppierende Inflation ist - wer kann, kauft mit 0% Ratenzahlung und gewinnt dabei! - habe ich volles Verständnis für Käufer der aktuellen MBPs. Das Geld muss weg.

Das Dahinschmelzen des Euros ist aber in der Auswirkung komplett zu vernachlässigen gegenüber der Obsoleszenz im Computermarkt. Vor weniger als zwei Jahren kam der Mac Pro heraus, ein Design-Gehäuse für Pferdestärken-Komponenten zum Rekordpreis. Kann immer noch tieeef Luft holen und wie bescheuert rendern, kommt aber bei Extremcodecs moderner Kameras beim Playback schnell aus der Puste. Aber auch das Neueste kommt an Grenzen:

Das Leben (Chiara würde sagen Gott) hat unsere eigene Obsoleszenz geplant, unsere Batterie lässt nach. Aber wir erlangen wenn schon nicht Weisheit, dann zumindest Erfahrung. Wir programmieren unsere Effizienzkerne und kommen im Energiesparmodus zu Potte.

Eine Alternative zu roher Körperkraft ist smartes Know-How, und der sympathische Jordan (die 2020er M1s bieten die stärkste Leistung pro Dollar, wie er im Fazit dieses Videos sagt) propagiert dieses. Auch Blackmagic hat im Laufe der Jahre etliche Strategien in Resolve eingebaut, die erlauben, mit wenig viel zu erreichen.

Ich fasse mal mit spezieller Berücksichtigung der M1-Macs zusammen (bitte vervollständigen, falls euch mehr bekannt ist):

> früher gab es die Möglichkeit, Medien zu optimieren (ProRes, DNxHD). Mit M1 wird dann das Playback u.U. schlechter als mit H.264/H.265.

> wenn Resolve den Codec auf M1 abspielen kann, gibt es auch keinen Grund für Proxies. Was beim Schnitt marginal besser funktioniert, kommt trotzdem im Colortab genauso schnell zum Echtzeitverlust (abgesehen von der schlechten Beurteilbarkeit des inferioren Codecs). Also nativ bleiben.

> eine halbe bzw. viertel Auflösung im Timeline-Proxy-Modus scheint in etwa zur doppelten bzw. vierfachen Echtzeitleistung zu führen. Ist im Effekt dasselbe, als würde ich UHD in 1080 oder 720-Timelines bearbeiten. Mit dem Unterschied, dass ich schneller hin- und herschalten kann.

> und hin- und herschalten sollte ich. Viele Korrekturen benötigen keine volle Auflösung. Andere schon. Nehmen wir eines, das kürzlich erwähnt wurde: Texture Pop. Ich könnte Texture Pop theoretisch fest im Powergrade (Standard-Nodebaum) haben, aber es per Default deaktiviert haben und erst am Schluss (und bei Bedarf, oft wirkt das Bild ja zu scharf. Wobei Texture Pop ja auch im Sinne von Midtone Detail weichzeichnen kann) aktivieren. Dann könnte ich auf volle Auflösung umschalten. Für iMac/MacBook - Besitzer ohne zweiten Monitor hat Resolve auch da einen smarten Kniff:

> Shift + F (Toggle). Alle Effekt-Inspektoren bleiben rechts einstellbar, ansonsten herrscht Vollbild. Macht ja freilich im Proxymodus wenig Sinn.

> Cache-Rendern. Von zweifelhaftem Nutzen. Das, was fast oder ganz in Echtzeit gespielt werden kann, rendert super schnell. Alles andere sehr langsam.

> Render in Place. Über das Edit-Tab per Rechtsklick zu erreichen. Heißt quasi "Replace with Render" und ist ebenfalls mit Rechtsklick reversibel.

Antwort von dienstag_01:

> früher gab es die Möglichkeit, Medien zu optimieren (ProRes, DNxHD). Mit M1 wird dann das Playback u.U. schlechter als mit H.264/H.265.

Dieser Punkt beschreibt es doch sehr schön, die Steigerung von Performance basiert seit einigen Jahren eher auf maßgeschneiderten Hardwarelösungen inside Computer - also vor allem Hardwaredecoder für hochkomprimiertes Material - , als auf Rechenpower im Allgemeinen. Das funktioniert sehr gut, solange man sich im Bereich der von den Hardwareherstellern vorgeplanten Szenarien bewegt, kommt dann mal was grundsätzlich anderes oder neues daher, dann wirds schnell eng. Zumindest für Laptops schein mir das aber ein ziemlich sinnvoller Weg zu sein. Darüber hinaus kann man streiten.

Antwort von koeniglois:

Hallo!

Hier wird ja schon sehr tief ins Detail gegangen und ich bin mir nicht sicher, ob der M1 da nicht etwas falsch bewertet wird.

Bei mir war die Ausgangslage fast gleich:

Fuji XT3, 4K25 und 4K50 HEVC mit 200 bzw. 400mbit 4:2:0 flog mit Eterna LUT in Resolve

Intel 8700k @ 4,7 GHz allcore

GTX1080 8GB

64GB RAM

PCIe SSD und ein viele SATA-SSD"s für Footage

M1 air 8/16 512GB

Der M1 ist in Resolve viel schneller und flüssiger. Scrubben durch die Timeline ist super flüssig. Es werden keine Proxys benötigt und es geht alles in max. Auflösung.

Allerdings habe ich das Schärfen in der Kamera wieder aktiviert. Denn damit kommt der M1 überhaupt nicht klar. Genauso wie mit Denoise.

Ich habe davor den 8700k immer nachschärfen lassen. Die GTX1080 hat die Arbeit übernommen und das Rendern dauerte nur ein wenig länger als ohne Nachschärfen.

Scrubben in der Timeline war auch ganz brauchbar (ohne aktiviertes Schärfen).

Der M1 bricht da komplett zusammen. Der ist aber auch nicht für solche Zwecke gemacht. Durch die zusätzlichen De- und Encoder usw. ist er bei normaler Bild- und Videobearbeitung extrem schnell.

Damit schneide ich super flüssig und rendere in einem Bruchteil dessen was der Desktop benötigt.

Aber eben ohne Schärfen.

Bei Lightroom Classic ist das Erstellen der Vorschauen und auch der Export etwas langsamer am M1, das Bearbeiten und Durchschalten der Fotos ist aber viel flüssiger.

Der M1 ist also extrem gute bei "leichter" Arbeit, ein Desktopersatz ist er aber nicht unbedingt.

Soviel zu meinen Erfahrungen. Ich hoffe das hilt ein wenig weiter.

LG Tom

Antwort von koeniglois:

Hier noch ein Screenshots meiner Export-Benchmarks vor einiger Zeit (damals habe ich den 8700k sogar auf 4,9GhZ allcore eingestellt):

https://ibb.co/4NM2qjg

Antwort von rush:

Welches Footage bevorzugt der M1 eigentlich?

Bei einigen 10bit h.264 Codes aus der A7S III meckert der integrierte (QuickTime? Player) das es sich um ein nicht unterstützes Format handelt - er spielt das Material dennoch fehlerfrei ab.

Nutze ich dagegen h.265 mit zusätzlich eher krummen 4Kanal 24bit Audio gibt es keine solche Meldung.

Kann ich also davon ausgehen das h.265 10 Bit generell besser unterstützt wird als h.264 10bit?

Als Software nutze ich Resolve... Im Playback und der Timeline alles bestens - aber der Export des 10bit h.264 Materials war jetzt nicht übermäßig flott... Also ungefähr in Echtzeit was total okay ist, aber auch komplett ohne Filter.

Werde die Tage nochmal eine längere Sequenz mit h.265 probieren - daraufhin scheint der M1 ja optimiert zu sein?

Manchmal bleibt aber ein Mischmasch an Material nicht aus, etwa aus der Drohne oder Actioncam... Daher habe ich bisher versucht eher in einem Codec zu bleiben. Wie seht ihr das?

Antwort von mash_gh4:

koeniglois hat geschrieben:

Hier noch ein Screenshots meiner Export-Benchmarks vor einiger Zeit (damals habe ich den 8700k sogar auf 4,9GhZ allcore eingestellt):

https://ibb.co/4NM2qjg

die vergleiche mit den h.264/h.265 machen nur dann ernsthaft sinn, wenn man sicherstellt, dass in beiden fällen auch tatsächlich die selbe qualität erzielt wird.

mit praktisch allen hier verwendeten encodinglösungen kann man nämlich das encodieren in ganz unterschiedlichen qualitätsstufen abwickeln, die jeweils auch völlig unterschiedliche rechenlast bzw. ausführungszeiten mit sich bringen.

Antwort von koeniglois:

mash_gh4 hat geschrieben:

koeniglois hat geschrieben:

Hier noch ein Screenshots meiner Export-Benchmarks vor einiger Zeit (damals habe ich den 8700k sogar auf 4,9GhZ allcore eingestellt):

https://ibb.co/4NM2qjg

die vergleiche mit den h.264/h.265 machen nur dann ernsthaft sinn, wenn man sicherstellt, dass in beiden fällen auch tatsächlich die selbe qualität erzielt wird.

mit praktisch allen hier verwendeten encodinglösungen kann man nämlich das encodieren in ganz unterschiedlichen qualitätsstufen abwickeln, die jeweils auch völlig unterschiedliche rechenlast bzw. ausführungszeiten mit sich bringen.

Da hast du natürlich Recht.

Das MBA wurde für unkomplizierte Bearbeitung angeschafft damit mehr Zeit für die Kinder bleibt. Genau das macht er und ich habe daher die Export Einstellungen auch Resolve überlassen.

Sie sind aber auf beiden Systemen gleich. Mir ging es um den Unterschied zwischen Desktop und M1 und nicht um den Unterschied zwischen 264 und 265. So wie ich es hier getestet habe, rendere ich in der Praxis. Und das geht mit dem M1 jetzt schneller (Ziel war eigentlich nur eine ähnliche Performance bzw. keine allzu großen Abstriche bei Umstieg auf etwa portables).

LG Tom

Antwort von koeniglois:

rush hat geschrieben:

Welches Footage bevorzugt der M1 eigentlich?

Bei einigen 10bit h.264 Codes aus der A7S III meckert der integrierte (QuickTime? Player) das es sich um ein nicht unterstützes Format handelt - er spielt das Material dennoch fehlerfrei ab.

Nutze ich dagegen h.265 mit zusätzlich eher krummen 4Kanal 24bit Audio gibt es keine solche Meldung.

Kann ich also davon ausgehen das h.265 10 Bit generell besser unterstützt wird als h.264 10bit?

Als Software nutze ich Resolve... Im Playback und der Timeline alles bestens - aber der Export des 10bit h.264 Materials war jetzt nicht übermäßig flott... Also ungefähr in Echtzeit was total okay ist, aber auch komplett ohne Filter.

Werde die Tage nochmal eine längere Sequenz mit h.265 probieren - daraufhin scheint der M1 ja optimiert zu sein?

Manchmal bleibt aber ein Mischmasch an Material nicht aus, etwa aus der Drohne oder Actioncam... Daher habe ich bisher versucht eher in einem Codec zu bleiben. Wie seht ihr das?

Mein MBA tut sich mit 10bit HEVC aus der Fuji deutlich leichter als mit 4k h.264 von meinem Google Pixel. Zumindest beim Rendern ist ein deutlicher Unterschied. Allerdings rendere ich alles in HEVC. Vermutlich hat das Ausgangsmaterial, welches ebenfalls HEVC ist, hier einen Vorteil?!

Antwort von Schwermetall:

koeniglois hat geschrieben:

Hier noch ein Screenshots meiner Export-Benchmarks vor einiger Zeit (damals habe ich den 8700k sogar auf 4,9GhZ allcore eingestellt):

https://ibb.co/4NM2qjg

Hallo Tom,

vielen Dank für dein Feedback.

Es scheint also so zu sein, dass der M1 bei bestimmten Setups extrem schnell ist und bei anderen nicht (z.B. Sharpen).

Jetzt ärgere ich mich natürlich, dass ich die Schärfung bei meinem Test drin hatte,

da ich bei meinem Aufnahmen eigentlich fast nie nachschärfe da bei meiner X-T4 Kamera intern auch bei minimaler Schärfung immer was passiert

und eine Schärfung es irgendwie unnatürlich wirken lässt.

Schöne Grüße, Alex

Antwort von ahuba:

Ich versuchs erstmal hier bevor ich einen neuen Thread eröffne.

Meint ihr ein Macbook Air M1 kann ein 2 DSLR Kamera-Setup via ATEM Mini nach OBS ruckelfrei "verarbeiten"?

Antwort von rush:

Das sollte problemlos machbar sein - die größte Rechenarbeit übernimmt in dem Fall ja sogar der Atem Mini. Im Endeffekt läuft also nur ein Stream auf - es sollte so gesehen egal sein ob 1, 2 oder 3 Kameras am Atem hängen - die Kiste gibt ja nur einen fertigen Stream an den Rechner respektive OBS.