Newsmeldung von slashCAM:

Die Arbeitsgemeinschaft Dokumentarfilm e.V. hat erneut einen von uns sehr geachteten Vergleichstest aktueller S35- und Vollformat-Kameras in Angriff produziert, den wir an dieser Stelle auch gerne wieder veröffentlichen.

Hier geht es zum slashCAM Artikel:

Test: AG DOK Kameratest 2020 - u.a. mit Blackmagic 6K, Canon C500 MkII, Panasonic S1(H) und Sony FX9

Antwort von klusterdegenerierung:

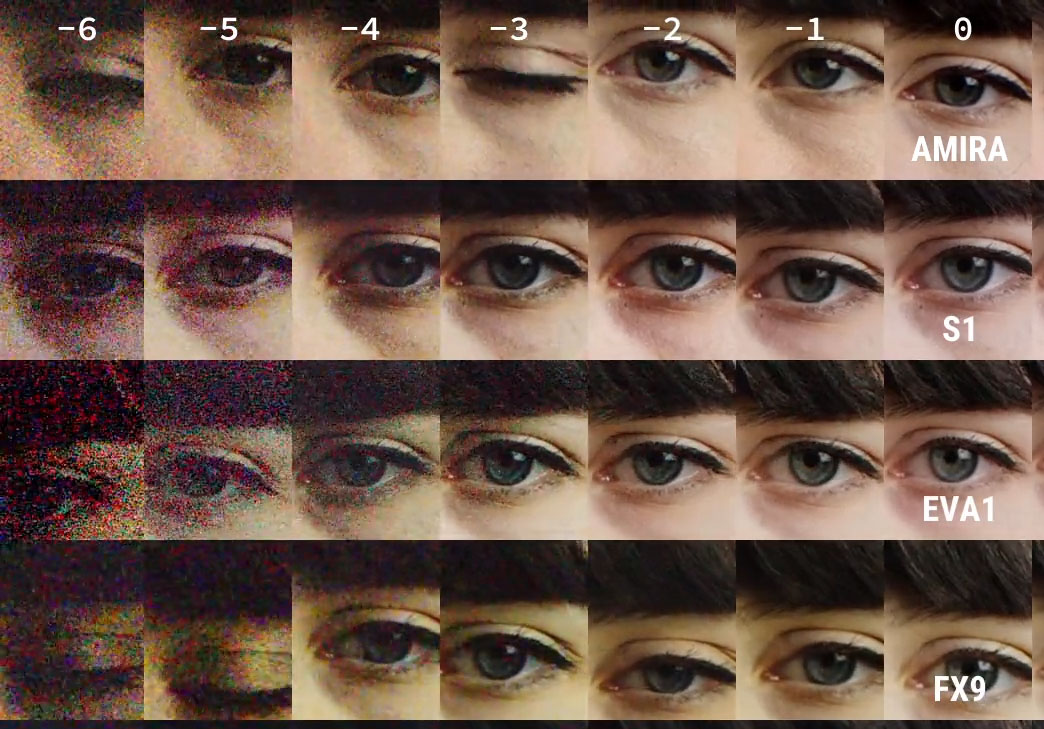

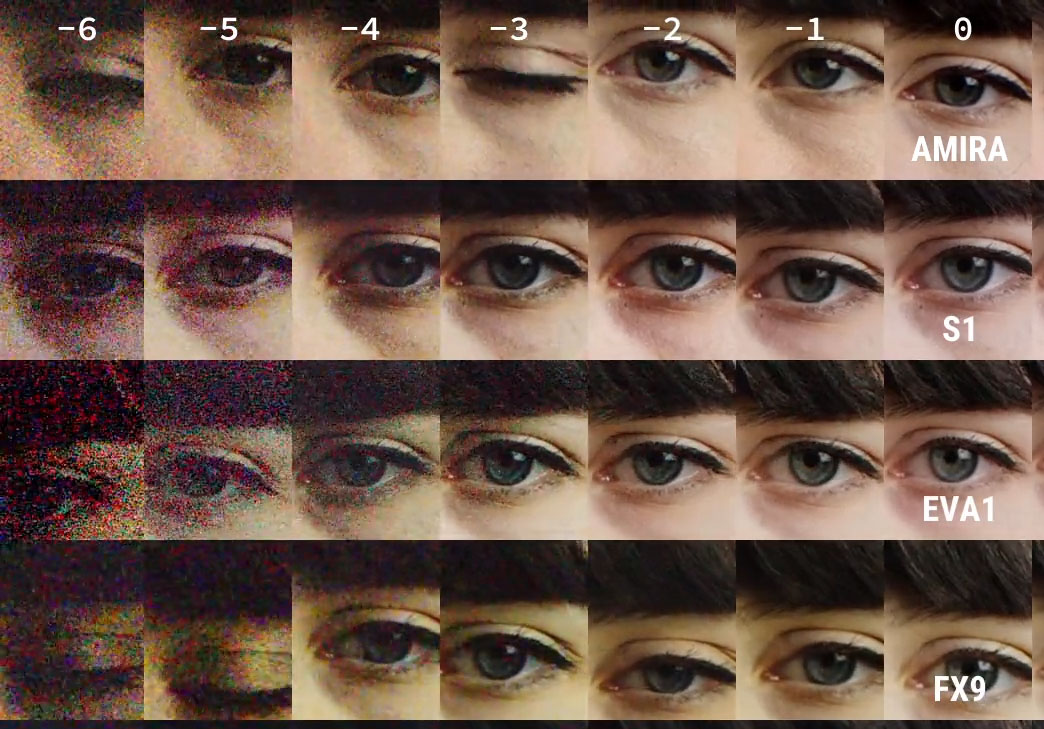

Aha, eine XT3 und S1 aber keine A7III, wie enttäuschend, aber warum die Amira die teuerste ist, sieht man dann ja auch ganz gut.

Antwort von Mantas:

interessanter Test!

eine aktuelle RED wäre noch spannend gewesen, auch wenn selten bei Dokus eingesetzt wird.

Gleich kommt der erste und schreit nach Highlight Recovery bei den Pockets...

Antwort von -paleface-:

Ja... Das Baby wirkt nur mit Dual ISO so quietschfidel!

:-D

Screenshot_20200610_132244_com.android.chrome.jpg

Antwort von cantsin:

klusterdegenerierung hat geschrieben:

Aha, eine XT3 und S1 aber keine A7III

Bei der A7III ist der Codec zu beschränkt und dürfte nicht den Mindestanforderungen der AG Dok genügen (schreibe ich als A7iii-Besitzer).

Antwort von klusterdegenerierung:

Denke auch, sind wohl eingefleischte 10Bitler!

Antwort von cantsin:

klusterdegenerierung hat geschrieben:

Denke auch, sind wohl eingefleischte 10Bitler!

Bei der A7iii sind nicht mal die 8bit das Problem, und auch nicht 4:2:0, sondern Abstriche bei Codec- und Signalqualität, die auch bei 8bit nicht sein müssten. Wie gesagt, bei diesem speziellen Einsatzzweck (Dokumentarfilm mit Kino/Festival- und TV-Auswertung).

Antwort von mediadesign:

Wahnsinn wie eindeutig der Vorsprung der Arri ist und das obwohl sie deutlich älter ist, als die anderen Exemplare.

Antwort von Frank Glencairn:

Ehrlich gesagt halte ich den Testaufbau für etwas waghalsig, um zu aussagekräftigen Ergebnissen zu kommen.

Antwort von dienstag_01:

Irgendwie beschleicht mich das Gefühl, hier wird wieder wie in dem Slashcam Test (SH1/A7III) nicht die Dynamik der Kamera sondern die Dynamik der LUT getestet.

Ich hoffe, ich liege damit falsch ;)

Antwort von Mantas:

hm kann sogar sein.

Immer das Problem, wenn die Settings der Kameras und der Postworkflow nicht ganz durchsichtig ist

Antwort von klusterdegenerierung:

Kann man solche Tests denn nicht mal endlich ohne Hersteller Luts machen?

Antwort von DeeZiD:

klusterdegenerierung hat geschrieben:

Kann man solche Tests denn nicht mal endlich ohne Hersteller Luts machen?

Ohne Rec709-Konvertierung? Ne, lass mal.

Wäre allerdings dafür zusätzlich Downloads des Originalmaterials anzubieten.

Antwort von dienstag_01:

DeeZiD hat geschrieben:

klusterdegenerierung hat geschrieben:

Kann man solche Tests denn nicht mal endlich ohne Hersteller Luts machen?

Ohne Rec709-Konvertierung? Ne, lass mal.

Wäre allerdings dafür zusätzlich Downloads des Originalmaterials anzubieten.

Hm, aber wäre es dann nicht besser, gleich in 709 zu drehen?

Denn man gewinnt doch auf diesem Weg gar nichts durch das LOG Profil?

Antwort von klusterdegenerierung:

Aber Rec Konvertierung muß ja nicht zwangsläufig heißen das man eine Lut über Material knallt, welches danach nicht mehr das ist, welches es eigentlich sein sollte und mal unter uns, bei perfektem WB ist es doch nicht mehr als Sättigung, Gamma & Kontrast, dafür braucht man doch keine Lut die zu 70% passt.

Da kann man sich doch eben ein Still einer gut gemachten Korrektor Node pro Cam anlegen und gut ist, so hat man dann zumindest einen Einduck des Materials und nicht der jeweiligen Lut.

Antwort von DeeZiD:

dienstag_01 hat geschrieben:

Hm, aber wäre es dann nicht besser, gleich in 709 zu drehen?

Denn man gewinnt doch auf diesem Weg gar nichts durch das LOG Profil?

Wenn ich mit einer ARRI in Log C drehe, habe ich nach der offiziellen Konvertierung trotzdem volle 14 stops.

Genauso wenn ich mit meiner S1H V-Log drehe, habe ich nach der offiziellen Konvertierung volle 12.5 stops (ca.)

Wenn ich allerdings mit meiner S1H im Standard oder gar Rec709-Profil drehe, habe ich deutlich unter 10 stops DR.

Bei Rec2100 (HLG oder PQ) sähe die Situation anders aus, hier ist eine Konvertierung gar notwendig, da ansonsten nur ca. 6 stops auf Rec709- oder sRGB-Bildschirmen dargestellt werden koennen. Kompression ist das Stichwort.

Antwort von DeeZiD:

klusterdegenerierung hat geschrieben:

Aber Rec Konvertierung muß ja nicht zwangsläufig heißen das man eine Lut über Material knallt, welches danach nicht mehr das ist, welches es eigentlich sein sollte und mal unter uns, bei perfektem WB ist es doch nicht mehr als Sättigung, Gamma & Kontrast, dafür braucht man doch keine Lut die zu 70% passt.

Da kann man sich doch eben ein Still einer gut gemachten Korrektor Node pro Cam anlegen und gut ist, so hat man dann zumindest einen Einduck des Materials und nicht der jeweiligen Lut.

LOG-Material hat in der Regel einen erweiterten Farbraum mit Bt.2100 Primärfarben und Weißpunkt. Dein Vorschlag würde zu völlig falschen Farben bei RED WideGamutRGB, Canon C-Log2, Panasonic V-Log, F-Log, S-Log2 und 3 sowie weiteren führen.

Der Hersteller der jeweiligen Kameras liegt in der Verantwortung korrekte Konvertierungen zu Rec709 zu liefern.

Diese sind leider in der Regel - wie bereits von AG DOK beschrieben - nicht immer optimal auf das jeweilige Modell zugeschnitten, liefern aber grundsätzlich bereits deutlich bessere Ergebnisse als mit einer manuellen Korrektur möglich sind.

Antwort von dienstag_01:

DeeZiD hat geschrieben:

dienstag_01 hat geschrieben:

Hm, aber wäre es dann nicht besser, gleich in 709 zu drehen?

Denn man gewinnt doch auf diesem Weg gar nichts durch das LOG Profil?

Wenn ich mit einer ARRI in Log C drehe, habe ich nach der offiziellen Konvertierung trotzdem volle 14 stops.

Genauso wenn ich mit meiner S1H V-Log drehe, habe ich nach der offiziellen Konvertierung volle 12.5 stops (ca.)

Wenn ich allerdings mit meiner S1H im Standard oder gar Rec709-Profil drehe, habe ich deutlich unter 10 stops DR.

Bei Rec2100 (HLG oder PQ) sähe die Situation anders aus, hier ist eine Konvertierung gar notwendig, da ansonsten nur ca. 6 stops auf Rec709- oder sRGB-Bildschirmen dargestellt werden koennen. Kompression ist das Stichwort.

Was heißt genau *offizielle Konvertierung*? Ist das die Konvertierung nach 709?

So wie ich das verstehe, wird bei der Konvertierung in 709 beschnitten (Resolve: man kann nach Konvertierung Werte nicht zurückholen), ist das falsch?

Antwort von DeeZiD:

dienstag_01 hat geschrieben:

DeeZiD hat geschrieben:

Wenn ich mit einer ARRI in Log C drehe, habe ich nach der offiziellen Konvertierung trotzdem volle 14 stops.

Genauso wenn ich mit meiner S1H V-Log drehe, habe ich nach der offiziellen Konvertierung volle 12.5 stops (ca.)

Wenn ich allerdings mit meiner S1H im Standard oder gar Rec709-Profil drehe, habe ich deutlich unter 10 stops DR.

Bei Rec2100 (HLG oder PQ) sähe die Situation anders aus, hier ist eine Konvertierung gar notwendig, da ansonsten nur ca. 6 stops auf Rec709- oder sRGB-Bildschirmen dargestellt werden koennen. Kompression ist das Stichwort.

Was heißt genau *offizielle Konvertierung*? Ist das die Konvertierung nach 709?

So wie ich das verstehe, wird bei der Konvertierung in 709 beschnitten (Resolve: man kann nach Konvertierung Werte nicht zurückholen), ist das falsch?

Nicht beschnitten, in den Schatten und Lichtern komprimiert.

Wenn du wenig DR input hast wirken Spitzlichter trotzdem hart sowie Schatten rauschig, farblos etc.

Außerdem ist der Spielraum in der post dann ebenfalls gering.

I.d.R. geht man so vor.

Material -> WB/Tint -> Gain/Offset -> Rec709 Konvertierung via CST/Lut -> Secondary CC

oder falls man auf Luts verzichten möchte

Material -> ACES IDT/RCM Input -> ACES AP1/RCM Working color space -> WB/Tint -> Log controls -> Secondary CC -> ODT /RCM Output color space

Antwort von DeeZiD:

Natürlich ist es wichtig darauf zu achten, dass gerade bei der Anwendung einer Hersteller-spezifischen Lut, die nicht lossless arbeitet, darauf zu achten, dass vorher die Belichtung stimmt und nicht nach Konvertierung angepasst wird, da ansonsten - wie bereits erwähnt - die Kurve/Lut und nicht die eigentliche Kamera getestet wird.

Bei der Arbeit in einem Workspace wie ACES oder RCM ist dies vollkommen irrelevant.

Antwort von dienstag_01:

DeeZiD hat geschrieben:

dienstag_01 hat geschrieben:

Was heißt genau *offizielle Konvertierung*? Ist das die Konvertierung nach 709?

So wie ich das verstehe, wird bei der Konvertierung in 709 beschnitten (Resolve: man kann nach Konvertierung Werte nicht zurückholen), ist das falsch?

Nicht beschnitten, in den Schatten und Lichtern komprimiert.

Wenn du wenig DR input hast wirken Spitzlichter trotzdem hart sowie Schatten rauschig, farblos etc.

Außerdem ist der Spielraum in der post dann ebenfalls gering.

I.d.R. geht man so vor.

Material -> WB/Tint -> Gain/Offset -> Rec709 Konvertierung via CST/Lut -> Secondary CC

oder falls man auf Luts verzichten möchte

Material -> ACES IDT/RCM Input -> ACES AP1/RCM Working color space -> WB/Tint -> Log controls -> Secondary CC -> ODT /RCM Output color space

Gut, komprimiert. Damit aber weg. Das ist doch für den Dreh mit LOG Profile sinnentstellend. Du beschreibst ja selbst eine von dir bevorzugte Reihenfolge, weil die Werte sonst weg sind.

Zusammengefasst ist das kein Testszenario für den Dynamikumfang einer Kamera.

Antwort von klusterdegenerierung:

DeeZiD hat geschrieben:

LOG-Material hat in der Regel einen erweiterten Farbraum mit Bt.2100 Primärfarben und Weißpunkt. Dein Vorschlag würde zu völlig falschen Farben bei RED WideGamutRGB, Canon C-Log2, Panasonic V-Log, F-Log, S-Log2 und 3 sowie weiteren führen.

Der Hersteller der jeweiligen Kameras liegt in der Verantwortung korrekte Konvertierungen zu Rec709 zu liefern.

Diese sind leider in der Regel - wie bereits von AG DOK beschrieben - nicht immer optimal auf das jeweilige Modell zugeschnitten, liefern aber grundsätzlich bereits deutlich bessere Ergebnisse als mit einer manuellen Korrektur möglich sind.

Habe ich ehrlich gesagt noch nie gesehen, das Log Material nach einem korrektem WB plötzlich anders aussehen als vergleichbares Rec Material. Wenn dem so wäre würde es doch völlig ausreichen einen Colorchart mit zu filmen und in Resolve ein zu pflegen, danach bleibt dann aber trotzdem nur noch die üblichen Verdächtigen an denen man dreht.

Bei Log geht es doch wohl eher um Dynamikgewinn durch Lumakompression und Verschiebung.

Wenn ich mein Slog oder Raw aus der FS700 mit Kontrast, Sättigung und Gamma richtig rückführe, sind die Farben identisch zur Rec Version.

Antwort von DeeZiD:

dienstag_01 hat geschrieben:

DeeZiD hat geschrieben:

Nicht beschnitten, in den Schatten und Lichtern komprimiert.

Wenn du wenig DR input hast wirken Spitzlichter trotzdem hart sowie Schatten rauschig, farblos etc.

Außerdem ist der Spielraum in der post dann ebenfalls gering.

I.d.R. geht man so vor.

Material -> WB/Tint -> Gain/Offset -> Rec709 Konvertierung via CST/Lut -> Secondary CC

oder falls man auf Luts verzichten möchte

Material -> ACES IDT/RCM Input -> ACES AP1/RCM Working color space -> WB/Tint -> Log controls -> Secondary CC -> ODT /RCM Output color space

Gut, komprimiert. Damit aber weg. Das ist doch für den Dreh mit LOG Profile sinnentstellend. Du beschreibst ja selbst eine von dir bevorzugte Reihenfolge, weil die Werte sonst weg sind.

Zusammengefasst ist das kein Testszenario für den Dynamikumfang einer Kamera.

Wie willst du dann das Material zufriedenstellend auf einem Rec709/sRGB-Ausgabegerät darstellen?

Wie gesagt, wichtig ist nur, dass das Material korrekt belichtet in die Rec709-Konvertierung geht und nicht - wie viele andere glauben - nachträglich angepasst werden sollte.

So wird der komplette Dynamikumfang ausgenutzt und wenn eine Kamera (wie z. B. die GH5) weniger Input liefert, wirkt sich das auch im Endergebnis negativ aus.

AG Dok macht das schon richtig.

Schöner wäre es in Zukunft stattdessen ACES einzusetzen, da so die Ergebnisse deutlich einheitlicher werden.

Antwort von DeeZiD:

klusterdegenerierung hat geschrieben:

DeeZiD hat geschrieben:

LOG-Material hat in der Regel einen erweiterten Farbraum mit Bt.2100 Primärfarben und Weißpunkt. Dein Vorschlag würde zu völlig falschen Farben bei RED WideGamutRGB, Canon C-Log2, Panasonic V-Log, F-Log, S-Log2 und 3 sowie weiteren führen.

Der Hersteller der jeweiligen Kameras liegt in der Verantwortung korrekte Konvertierungen zu Rec709 zu liefern.

Diese sind leider in der Regel - wie bereits von AG DOK beschrieben - nicht immer optimal auf das jeweilige Modell zugeschnitten, liefern aber grundsätzlich bereits deutlich bessere Ergebnisse als mit einer manuellen Korrektur möglich sind.

Habe ich ehrlich gesagt noch nie gesehen, das Log Material nach einem korrektem WB plötzlich anders aussehen als vergleichbares Rec Material. Wenn dem so wäre würde es doch völlig ausreichen einen Colorchart mit zu filmen und in Resolve ein zu pflegen, danach bleibt dann aber trotzdem nur noch die üblichen Verdächtigen an denen man dreht.

Bei Log geht es doch wohl eher um Dynamikgewinn durch Lumakompression und Verschiebung.

Wenn ich mein Slog oder Raw aus der FS700 mit Kontrast, Sättigung und Gamma richtig rückführe, sind die Farben identisch zur Rec Version.

Bei den oben erwähnten Log-Gammas wäre eben dies nicht der Fall, was auch der Grund ist, warum viele Einsteiger in die Materie über die Falschfarben ihrer Kameras entsetzt sind, nachdem sie vergessen haben das Manual zu lesen, welches eben genau obiges Phänomen beschreiben würde.

Hier mal ein Beispiel aus der S1H.

Log vs Kurve/Sat vs Konvertierung vs meine eigene Lut

Antwort von klusterdegenerierung:

Ok, wenn ich aber nun das Quellgamma ins Zielgamma konvertiere, bin ich doch wieder safe oder nicht, dann hätte ich ein neutrales Log für die händische Rückführung ins Rec, oder nicht?

Antwort von DeeZiD:

klusterdegenerierung hat geschrieben:

Ok, wenn ich aber nun das Quellgamma ins Zielgamma konvertiere, bin ich doch wieder safe oder nicht, dann hätte ich ein neutrales Log für die händische Rückführung ins Rec, oder nicht?

Da das Quellgamma (Log) und das Zielgamma (i.d.R. Rec709 oder neuerdings Rec2020PQ) ist, verstehe ich die Frage nicht.

Rec709 zu Log konvertieren würde nicht viel Sinn machen, da zwar durchaus Luma-Informationen vorhanden sein können - vorallem in 10Bit und aufwärts, allerdings ist Bt.709 ein schon fast peinlich kleiner Farbraum.

Wenn man beispielsweise mit VFX in ACES arbeitet kann gerade dies beim Umgang mit Rec709- oder sRGB-kodierten externen Assets zum Problem werden, da diese per Reverse IDT (Rec709 zu ACES AP0) konvertiert werden müssen, es aber an Farbinformationen mangelt.

Antwort von klusterdegenerierung:

Sorry, missverständlich ausgedrückt, mit Zielgamma meinte ich nicht Rec709, sondern eines welches das gleiche Potenzial/Raum inne hat, wie das Quellgamma, dann korrigiert man einfach Kurve & Sättigung.

Wenn ich das so mache wie Du verstanden hast, wäre es ja im Grunde eine klassische Konvertierung wie mit Lut, das wollte ich ja vermeiden.

Antwort von dienstag_01:

DeeZiD hat geschrieben:

dienstag_01 hat geschrieben:

Gut, komprimiert. Damit aber weg. Das ist doch für den Dreh mit LOG Profile sinnentstellend. Du beschreibst ja selbst eine von dir bevorzugte Reihenfolge, weil die Werte sonst weg sind.

Zusammengefasst ist das kein Testszenario für den Dynamikumfang einer Kamera.

Wie willst du dann das Material zufriedenstellend auf einem Rec709/sRGB-Ausgabegerät darstellen?

Wie gesagt, wichtig ist nur, dass das Material korrekt belichtet in die Rec709-Konvertierung geht und nicht - wie viele andere glauben - nachträglich angepasst werden sollte.

So wird der komplette Dynamikumfang ausgenutzt und wenn eine Kamera (wie z. B. die GH5) weniger Input liefert, wirkt sich das auch im Endergebnis negativ aus.

AG Dok macht das schon richtig.

Schöner wäre es in Zukunft stattdessen ACES einzusetzen, da so die Ergebnisse deutlich einheitlicher werden.

Korrekt belichtet ist ja nun bei einem Dynamiktest eher nichts.

Wie schaffen es denn Panasonic und Arri die 12 oder 14 Stops nach der Konvertierung zu erhalten? Da muss doch eigentlich auch komprimiert werden.

Antwort von DeeZiD:

klusterdegenerierung hat geschrieben:

Sorry, missverständlich ausgedrückt, mit Zielgamma meinte ich nicht Rec709, sondern eines welches das gleiche Potenzial/Raum inne hat, wie das Quellgamma, dann korrigiert man einfach Kurve & Sättigung.

Wenn ich das so mache wie Du verstanden hast, wäre es ja im Grunde eine klassische Konvertierung wie mit Lut, das wollte ich ja vermeiden.

Das würde in Richtung ACES gehen, weshalb ACES auch die bessere Alternative wäre, da so alle Kameras die gleiche Grundlage hätten. ;)

Antwort von DeeZiD:

dienstag_01 hat geschrieben:

Wie schaffen es denn Panasonic und Arri die 12 oder 14 Stops nach der Konvertierung zu erhalten? Da muss doch eigentlich auch komprimiert werden.

Schon richtig. Roll-off in den Schatten und Highlights, einfach ausgedrückt S-Kurve. Mit einer exakten negativen S-Kurve lassen sich diese wieder zurück nach Log 'biegen'.

Da aber auch eine Gamut-Konvertierung in den deutlich kleineren Bt.709-Farbraum stattfinden muss, gehen Chroma-Informationen definitiv verloren.

Vielleicht wäre der Einsatz von ACES samt passender IDTs sinnvoller.

Antwort von dienstag_01:

DeeZiD hat geschrieben:

dienstag_01 hat geschrieben:

Wie schaffen es denn Panasonic und Arri die 12 oder 14 Stops nach der Konvertierung zu erhalten? Da muss doch eigentlich auch komprimiert werden.

Schon richtig. Roll-off in den Schatten und Highlights, einfach ausgedrückt S-Kurve. Mit einer exakten negativen S-Kurve lassen sich diese wieder zurück nach Log 'biegen'.

Da aber auch eine Gamut-Konvertierung in den deutlich kleineren Bt.709-Farbraum stattfinden muss, gehen Chroma-Informationen definitiv verloren.

Vielleicht wäre der Einsatz von ACES samt passender IDTs sinnvoller.

Man kommt zurück nach LOG?! In Resolve sieht das nach meiner Kenntnis anders aus, da gehen Highlights durch die Decke und sind verloren. Das ist ja das Problem, was ich mit der Verwendung von LUTs habe. Und du beschreibst ja selbst, dass man VOR der LUT anpassen muss. Wozu denn, wenn man danach auch noch an das LOG - und damit an die Dynamik - ran kommt?!

Was soll dann ein Test bringen, der genau das nicht macht und als erstes eine LUT drauf legt. (Wahrscheinlich nicht macht, weiß man ja nicht genau)

Antwort von Frank Glencairn:

dienstag_01 hat geschrieben:

Hm, aber wäre es dann nicht besser, gleich in 709 zu drehen?

Da kein Sensor 709 ausgibt, wird die LUT halt in der Kamera drauf gelegt, statt in der Post. Macht dich halt noch unflexibler.

Wie ich oben schon sagte, halte ich den ganze Testaufbau für extrem schwindlig, und damit ist auch das Ergebnis unbrauchbar.

Das geht mit den ganzen externen Variablen los - mal mit ND, mal ohne, mal mit IR mal ohne. Dann mal mit dual ISO bei der einen Kamera, die andere kann es halt nicht. Und am Ende halt noch Gepfusche in der Post.

Tatsächlich aussagekräftige und brauchbare Ergebnisse für die Praxis, erhält man nur bei einem praxisorientierten Versuchsaufbau.

Antwort von dienstag_01:

"Frank Glencairn" hat geschrieben:

dienstag_01 hat geschrieben:

Hm, aber wäre es dann nicht besser, gleich in 709 zu drehen?

Da kein Sensor 709 ausgibt, wird die LUT halt in der Kamera drauf gelegt, statt in der Post. Macht dich halt noch unflexibler.

Wie ich oben schon sagte, halte ich den ganze Testaufbau für extrem schwindlig, und damit ist auch das Ergebnis unbrauchbar.

Das geht mit den ganzen externen Variablen los - mal mit ND, mal ohne, mal mit IR mal ohne. Dann mal mit dual ISO bei der einen Kamera, die andere kann es halt nicht. Und am Ende halt noch Gepfusche in der Post.

Tatsächlich aussagekräftige und brauchbare Ergebnisse für die Praxis, erhält man nur bei einem praxisorientierten Versuchsaufbau.

Dass in der Kamera eine LUT drauf gelegt wird, so würde ich das interne Processing jetzt nicht nennen. Aber egal.

Ich dachte eher, diese Aussage lässt Absurdität eines Workflows verstehen, der erst ein Log Profil drauf legt (intern), um es dann in der Post nochmal in 709 umzuwandeln. Ohne Gewinn, nur mit Verlusten.

Über praxisrelevant lässt sich übrigens immer streiten, Slashcam war im Panasonic/Sony-Test ja der Meinung, die Hersteller-LUT zu verwenden, sei praxisrelevant, weil flott.

Für andere, wie für mich, wäre die Möglichkeit, Dynamik zu speichern und zu nutzen, auch wenn das mal etwas Aufwand bedeutet, viel relevanter. Weil, sonst brauche ich im Zweifelsfall eine andere Kamera. Und ob der Test hier dazu beiträgt, ist die Frage. Sieht nicht so aus.

Antwort von Frank Glencairn:

dienstag_01 hat geschrieben:

Dass in der Kamera eine LUT drauf gelegt wird, so würde ich das interne Processing jetzt nicht nennen.

Was glaubst du denn, was da sonst passiert?

Was das mit der Absurdität betrifft, da hast du allerdings recht - wenigstens teilweise.

Als die FS100 raus gekommen ist hab ich jede Menge Zeit damit verbracht ein Pseudo-LOG Profil zu erstellen (was seltsamerweise auch noch ziemlich beliebt war). Irgendwann hab ich dann geschnallt, daß durch den hochkomprimierten Codec beim "Auseinanderziehen" in der Post mehr Artefakte und Abrisse entstehen, als die ganze Nummer Wert ist. Das nächste Profil basierte dann darauf einfach das Maximale aus dem Sensor raus zu holen, statt das Signal zu Quetschen und dabei nur ne Menge "heiße Luft oben und unten zu speichern, was bei halbwegs richtiger Belichtung deutlich bessere Ergebnisse Brachte.

Bei raw gilt das alles natürlich nicht. Da bekomme ich den kompletten Umfang, ohne daß es zu Abrissen führt.

Antwort von -paleface-:

Verstehe ich den Test eigentlich korrekt das die Pocket 6k mehr DR haben soll als die Ursa G2?

Antwort von dienstag_01:

-paleface- hat geschrieben:

Verstehe ich den Test eigentlich korrekt das die Pocket 6k mehr DR haben soll als die Ursa G2?

So wie ich das verstehe, haben die bei der Ursa den falschen Codec genommen.

Antwort von klusterdegenerierung:

Aber wenn eine Log Lut davon abhängig ist wie perfekt man belichtet, in jeglicher Hinsicht, dann müßte sich doch dem Hersteller auch die Frage stellen, ob es überhaupt Sinn macht eine solche Lut anzubieten.

Auf der einen Seite propagieren auch Profis das man Slog ETTR belichten soll, aber gerade ETTR und standard Lut können ja nunmal garnicht mit einander. Belichte ich in die Mitte oder gar etwas auf die Höhen, haut die Lut mir extremes Rauschen um die Ohren und Grundsätzlich sind diese Luts doch fasst durch die Bank zu Tiefen betont und sehen oft grusseliger aus als das InKamera Rec.

So ganz werde ich nicht Schlau aus dieser Thematik. Ehrlicher und kompetenter wäre wenn der Hersteller porpagieren würde das es immer individuell ist und man keine Lut anbieten kann, oder?

Antwort von Frank Glencairn:

ETTR = richtig belichtet. Nicht in Hinsicht auf das gewünschte Endergebnis (das ist Job der Post) sondern technisch richtig belichtet.

Wenn die Hersteller LUT was taugt, dann passt das am Ende, wenn nicht, mach dir ne eigene bessere.

Antwort von klusterdegenerierung:

"Frank Glencairn" hat geschrieben:

ETTR = richtig belichtet.

Eben, das ist ja genau das Problem bei den Herstellern, das sie selbst anscheinend nicht wissen das ETTR belichtetes Slog "richtig" belichtet ist, um so ärgerlicher das dann eine angeblich passende Lut nicht passt.

Antwort von cantsin:

klusterdegenerierung hat geschrieben:

"Frank Glencairn" hat geschrieben:

ETTR = richtig belichtet.

Eben, das ist ja genau das Problem bei den Herstellern, das sie selbst anscheinend nicht wissen das ETTR belichtetes Slog "richtig" belichtet ist, um so ärgerlicher das dann eine angeblich passende Lut nicht passt.

Ich empfehle statt LUTs die Funktion "Transform Color Space" im Effekt-Menü von Resolve (alternativ auch in den Projekteinstellungen, falls man Material nur aus einer Kamera hat), bei der sich neben der Farbraum- und Gammatransformation auch Tone Mapping aktivieren lässt, was diese Probleme löst.

Antwort von -paleface-:

dienstag_01 hat geschrieben:

-paleface- hat geschrieben:

Verstehe ich den Test eigentlich korrekt das die Pocket 6k mehr DR haben soll als die Ursa G2?

So wie ich das verstehe, haben die bei der Ursa den falschen Codec genommen.

Ich dachte nur die falsche Auflösung.

Antwort von klusterdegenerierung:

cantsin hat geschrieben:

Ich empfehle statt LUTs die Funktion "Transform Color Space" im Effekt-Menü von Resolve

In dem Kontext bin ich gerade auf diese Wilde aber dennoch interessante Bearbeitung gestoßen, was ich vorher soo auch noch nicht gesehen habe.

https://youtu.be/P0ht8BFqktI?t=35

Antwort von klusterdegenerierung:

Hier geht es um die Einbindung von Luts in Log.

https://www.youtube.com/watch?v=mRE1eCsHQ5U

Antwort von DeeZiD:

cantsin hat geschrieben:

klusterdegenerierung hat geschrieben:

Eben, das ist ja genau das Problem bei den Herstellern, das sie selbst anscheinend nicht wissen das ETTR belichtetes Slog "richtig" belichtet ist, um so ärgerlicher das dann eine angeblich passende Lut nicht passt.

Ich empfehle statt LUTs die Funktion "Transform Color Space" im Effekt-Menü von Resolve (alternativ auch in den Projekteinstellungen, falls man Material nur aus einer Kamera hat), bei der sich neben der Farbraum- und Gammatransformation auch Tone Mapping aktivieren lässt, was diese Probleme löst.

Durch Kompression wie bei eben fast allen herstellerspezifischen Luts ;)

ACES halte ich deutlich besser für direkte Vergleiche, da das Material verschiedener Kameras bereits nach dem Import sehr ähnlich aussieht, während CST oder auch Luts i.d.R. zu völlig unterschiedlichen Resultaten führen.

Antwort von DeeZiD:

"Frank Glencairn" hat geschrieben:

ETTR = richtig belichtet. Nicht in Hinsicht auf das gewünschte Endergebnis (das ist Job der Post) sondern technisch richtig belichtet.

Wenn die Hersteller LUT was taugt, dann passt das am Ende, wenn nicht, mach dir ne eigene bessere.

Eh

gerade bei BMD Film V4 führt dieser Tipp ganz schnell zum Übersteuern des Rotkanals, teilweise gar sichtbar im BMD Braw-Demo-Material.

Bei S-log 2/3 kann man den Tipp aufgrund des furchtbaren 8 Bit Codecs und des gar schlimmeren Sony-Rauschteppichs (ja, sogar die FX9 sieht diesbezüglich furchtbar aus) immerhin nachvollziehen.

Links

https://www.blackmagicdesign.com/products/blackmagicraw (Clip1)

https://drive.google.com/file/d/1f96y0K ... sp=sharing

https://www.youtube.com/watch?v=3byzdtU_HAQ&t=113s

https://forum.blackmagicdesign.com/view ... wide+gamut

Antwort von Jott:

Wie wärs mal mit einem Kameratestvideo-Festival?

Das Genre ist inzwischen in all seinen vielfältigen Spielarten so dominant, dass die breite Anerkennung überfällig ist.

Antwort von rideck:

@ Frank

Ich verstehe deine Bedenken, allerdings meine ich dass sie die Jungs bei Ihren Tests immer sehr viel Mühe geben.

Ich finde dass man sieht dass bei der FX 9 in den Highlights etwas mehr geht als bei der C500 MK II, auch wenn Sie

es mit den Farben irgendwie verhauen haben.

Antwort von klusterdegenerierung:

Ich finde bei den Ergebnisse der FX kann irgendwas nicht stimmen, das sieht ja aus als wäre da ein Denoising Algorithmus am werkeln, so ugly sieht ja nicht mal mein 8Bit Material aus der A7III aus.

Sieht sehr ähnlich aus wie bei einigen YT Lowlight Test, wo die YTuber vergessen haben das incamera denoising ab zu schalten.

Antwort von rideck:

@ klusterdegenerierung

Lustig dass Du das schreibst, ich habe ihnen geschrieben und nachgefragt, warum das Material so schlecht aussieht :) Also vor allem farblich habe ich

selten so schlechtes FX9-Material gesehen.

Antwort von klusterdegenerierung:

rideck hat geschrieben:

Lustig dass Du das schreibst, ich habe ihnen geschrieben und nachgefragt

Dann zeig mal wo das gewesen sein soll und vorallem was das eine mit dem anderen zutun haben soll???

Antwort von Mantas:

wundert mich auch, besonders die Aussage, dass die soft ist.

Im meinem direkten Vergleich zu FS7 war es ein riesen Unterschied. Was Rauschen angeht um vielfaches besser.

Wirkt bei dem Test nicht so.

Antwort von rideck:

@ klusterdegenerierung

Wo schreibe ich denn dass das miteinander zu tun hat? Was soll ich dir denn zeigen? Ich glaube Du hast meinen Post missverstanden.

@ Mantas

Wenn man sich die Testclips mal vergrößert nebeneinander ansieht, liegt die FX9 bei +5 näher an der Arri als an der C500 MK II. Alleine

die SH1 ist da noch mit dabei.

Antwort von iasi:

Jott hat geschrieben:

Wie wärs mal mit einem Kameratestvideo-Festival?

Das Genre ist inzwischen in all seinen vielfältigen Spielarten so dominant, dass die breite Anerkennung überfällig ist.

Gab"s doch schon: Das Camerashootout 2012.

Der Ansatz war sehr gut, das Testszenario aber leider ihne richtige Herausforderungen:

Eingearbeitete Teams traten mit ihren Kameras gegeneinander an. So kann man schon einmal davon ausgehen, dass das Maximum aus Kamera und Material herausgeholt wird.

Leider war es eine Studiosituation ein schlechtes Testszenario, bei der durch Lichtsetzung alle Kamera in einem Bereich betrieben wurden, die sie nicht an die Grenzen führten. Entsprechend schwierig war es dann auch Unterschiede zwischen den Ergebnissen zu erkennen.

Gib jemandem, der üblicherweise mit einer Amira arbeitet,verschiedene Kameras in die Hand, um einen Vergleichstest zu machen. Dann erwarte aber nicht wirklich objektive Ergebnisse.

Es ist wie mit diesen vielen Youtube-Tests:

1. Ein unbox-Video

2. rausrennen, um "Testvideos" zu drehen

3. Mit dem Testobjekt neben sich, in die Streaming-Cam die Bewertung reinquatschen.

Einarbeitung? Was ist das?

Antwort von Jott:

Das war kein Festival, sondert Zacuto-Werbung für Riggerümpel.

Ich will ein richtiges Festival, mit Siegern in diversen Kategorien (dümmster Auftritt, schlechteste Footage etc.), Die Kameras sind völlig egal.

Antwort von iasi:

Jott hat geschrieben:

Das war kein Festival, sondert Zacuto-Werbung für Riggerümpel.

Ich will ein richtiges Festival, mit Siegern in diversen Kategorien (dümmster Auftritt, schlechteste Footage etc.), Die Kameras sind völlig egal.

Und du willst das ganz uneigennützig organisieren und finanzieren?

Respekt. :)

Antwort von Jott:

Wo steht, dass

ich so was organisieren will? Keine Zeit. Ich finde nur, selbige ist reif, weil das Genre so dominant geworden ist. Und es könnte extrem lustig werden. Einen Sonderpreis gibts für die höchste Anzahl an Jump Cuts bei den Leuten, die keinen Satz am Stück gebacken kriegen, während sie fachmännisch gegen die Reifen treten.

Gibts eigentlich auch Frauen in dem Genre, mal abgesehen von iJustine?

Antwort von Jörg:

Gibts eigentlich auch Frauen in dem Genre

die haben für solch Unsinn meist keine Lus tund/oder Zeit.

Antwort von iasi:

Jott hat geschrieben:

Wo steht, dass ich so was organisieren will?

Ich dachte das impliziert deine Kritik an der Zacuto-Werbung.

Es gibt schließlich nicht viele (ob Mann oder Frau), die völlig uneigennützig Zeit und Geld investieren würden.

Aber vielleicht wird ja jemand durch so eine Cam-Test-Show zum Youtube-Millionär. :)

Antwort von klusterdegenerierung:

iasi hat geschrieben:

Es gibt schließlich nicht viele (ob Mann oder Frau), die völlig uneigennützig Zeit und Geld investieren würden.

Eben, warum dann selbige nicht sinnvoll nutzen.

Antwort von klusterdegenerierung:

DeeZiD hat geschrieben:

Bei den oben erwähnten Log-Gammas wäre eben dies nicht der Fall, was auch der Grund ist, warum viele Einsteiger in die Materie über die Falschfarben ihrer Kameras entsetzt sind, nachdem sie vergessen haben das Manual zu lesen, welches eben genau obiges Phänomen beschreiben würde.

Hallo DeeZid,

ich habe mich dem Thema noch mal gewidmet, und der Standard Slog Lut noch mal eine Chance gegeben weil ich das mit den gamut Farben auch vergleichen wollte, da es wohl oft nur eine bestimmte Farbe betrifft und man diese gerne mal übersieht wenn man nicht drauf achtet.

Bei meiner FS700 scheint es das Orange zu sein.

Weil ich auch nicht gänzlich beratungsresistent sein will ;-) habe ich mich noch mal mit dem Lut workflow im Nodetree beschäftigt und festgestellt, das ich wohl wie viele, die Korrektur Node hinter die Lut Node platziere, was zum graden der Lut und nicht zum graden des Quellfootage führt.

Legt man die Lut ans Ende der Kette und die Korrekturnode als erstes, ist alles gut und man hat den vollen Umfang trotz Lut,

insofern kann man die Lut doch als Basis nutzen, ohne das sie das Material zerstört, was ich nicht erwartet hätte.

Kann es sein das es bei dem Dok Kameratest zu den gleichen Problemen kam, was auch Jörg ansprach?

Hier mal ein Vergleich zwischen Lut und normaler Korrektur, man sieht sehr schön, dass das echte Orange wohl mehr Rotanteile besitzt.

Allerdings muß ich dazu sagen, das mir das Orange aus dem unkorregiertem Gamut besser gefällt, besonders wenn es in der Haut auftaucht.

Danke Dir noch mal sehr für den Hinweis! :-)

Antwort von dienstag_01:

Legt man die Lut ans Ende der Kette und die Korrekturnode als erstes, ist alles gut und man hat den vollen Umfang trotz Lut,

insofern kann man die Lut doch als Basis nutzen, ohne das sie das Material zerstört, was ich nicht erwartet hätte.

Das ist doch genau das, was seit Jahren (wenn denn überhaupt Lut) hier empfohlen wird.

Nie wahrgenommen?

Antwort von klusterdegenerierung:

dienstag_01 hat geschrieben:

Legt man die Lut ans Ende der Kette und die Korrekturnode als erstes, ist alles gut und man hat den vollen Umfang trotz Lut,

insofern kann man die Lut doch als Basis nutzen, ohne das sie das Material zerstört, was ich nicht erwartet hätte.

Das ist doch genau das, was seit Jahren (wenn denn überhaupt Lut) hier empfohlen wird.

Nie wahrgenommen?

Das kann ich nicht mal genau sagen, vielleicht habe ich sogar an der Lut selbst rumgedreht.

Ich muß aber dazu sagen, das ich mich nicht wirklich groß damit beschäftigt habe, weil der Gedanke, das ich trotz lut eh alles selbst noch mal einstellen muß, mir so abwegig vorkam, das ich diesen Weg für eher aufwendiger hielt.

Nun, wo DeeZid noch mal das Farb Problem ins Spiel brachte, sah ich mich veranlasst das zu überprüfen und zu überdenken, denn jetzt steht ja quasi eine Art Notwendigkeit dahinter, zumindest wenn man was filmt was Farbrelevant ist, wie zb. Product shots.

Ich lerne ja gerne und nutze auch gerne unkonventionelles, deswegen bin ich eigentlich immer gut mit der ohne Lut Variante klar gekommen.

Aber eines habe ich trotzdem noch nicht so recht durchschaut, vielleicht kannst Du mir da weiter helfen.

Ohne habe ich manchmal das Problem, das ich um Kontrast ins Bild zu bekommen, einen recht kleinen Spielraum habe bevor was clippt und manchmal stellt sich auch der richtige Kontrastumfang überhaupt nicht ein und das Log ist auf verdei und verderb flau.

Mit einer der poppigere Slog Luts, lässt sich allerdings der Konstrast soweit zurück fahren, das noch genügend da ist, aber ohne dabei in der Skala an beiden Enden über zu gehen, bzw zu clippen.

Weißt Du was da passiert und warum genau dies manuell wesentlich schwieriger zu realisieren scheint?

Danke! :-)

Antwort von Frank Glencairn:

Dazu müßte ich erst mal wissen wie du das mit dem Kontrast überhaupt machst.

Kontrastregler, LGG, Curve?

Antwort von klusterdegenerierung:

Tja, Frank, da habe ich schon einiges versucht, aber irgendwie verhält es sich immer anders und so richtig komme ich nicht auf einen grünen Zweig.

Ob S Kurve, oder Gain/Gamma oder der einfache Kontrast Regler, irgendwo zwackt es dann und wann immer.

Wobei es jetzt nicht wirklich dramatisch ist, aber dann und wann könnte ich schon das ko...kriegen, so habe ich die Tage wieder eine weiße Maschine ich einer recht weißen Halle mit anderen weißen Maschinen in Slog gefilmt, was ich öfters mache, aber diesmal, ProRes HQ 10Bit, irgendwie extremst flauschig und ob mit ACES, oder Lut, oder selbst, die Ergenisse fielen durch die Bank so übertrieben aus, da wurde das leicht umbra weiß zu einem Grün und alles was etwas heller war, flog mir direkt um die Ohren.

Andersrum, bekam ich so schwer Kontrast rein, das es mir bei manuell dann auch schnell um die Ohren flog.

Aber das scheint dann wohl eher am generellen DR Umfang der Szene zu liegen, der hier quasi nicht vorhanden war, oder? ;-)

Antwort von dienstag_01:

klusterdegenerierung hat geschrieben:

dienstag_01 hat geschrieben:

Das ist doch genau das, was seit Jahren (wenn denn überhaupt Lut) hier empfohlen wird.

Nie wahrgenommen?

Das kann ich nicht mal genau sagen, vielleicht habe ich sogar an der Lut selbst rumgedreht.

Ich muß aber dazu sagen, das ich mich nicht wirklich groß damit beschäftigt habe, weil der Gedanke, das ich trotz lut eh alles selbst noch mal einstellen muß, mir so abwegig vorkam, das ich diesen Weg für eher aufwendiger hielt.

Nun, wo DeeZid noch mal das Farb Problem ins Spiel brachte, sah ich mich veranlasst das zu überprüfen und zu überdenken, denn jetzt steht ja quasi eine Art Notwendigkeit dahinter, zumindest wenn man was filmt was Farbrelevant ist, wie zb. Product shots.

Ich lerne ja gerne und nutze auch gerne unkonventionelles, deswegen bin ich eigentlich immer gut mit der ohne Lut Variante klar gekommen.

Aber eines habe ich trotzdem noch nicht so recht durchschaut, vielleicht kannst Du mir da weiter helfen.

Ohne habe ich manchmal das Problem, das ich um Kontrast ins Bild zu bekommen, einen recht kleinen Spielraum habe bevor was clippt und manchmal stellt sich auch der richtige Kontrastumfang überhaupt nicht ein und das Log ist auf verdei und verderb flau.

Mit einer der poppigere Slog Luts, lässt sich allerdings der Konstrast soweit zurück fahren, das noch genügend da ist, aber ohne dabei in der Skala an beiden Enden über zu gehen, bzw zu clippen.

Weißt Du was da passiert und warum genau dies manuell wesentlich schwieriger zu realisieren scheint?

Danke! :-)

Bei deinem Problem kann ich dir nicht helfen, dass ist mir zu speziell.

Ich hatte die Frage auch mehr aus der Richtung gestellt, dass es sehr auffällig ist, dass die Diskussion mit dir hier öfter komplett aus dem Ruder läuft. Und wenn du so einen alten Hut, wie, dass man die LUT in Resolve erst im letzten Node anwendet (wenn überhaupt LUT) - was bisher allerdings fast ausschließlich die Luma Range betreffend diskutiert wurde, logischerweise, möchte man hinzufügen - nicht kennst, scheint dafür zu sprechen, dass du an der Klärung grundsätzlicher Fragen eher weniger Interesse hast, sondern eher an der Lösung ganz spezieller Probleme. Dass dabei die Gefahr besteht, dass der Überblick verloren gehen kann, scheint dich nicht zu stören.

Nicht, dass du mich falsch verstehst, ich habe nichts dagegen. Das ist eher so eine Art Bestandsaufnahme, was an der Kommunikation mit dir vielleicht so anders ist.

Interessant.

Und für mich an manchen Stellen nur sehr schwer zu begreifen.

|

Antwort von Frank Glencairn:

klusterdegenerierung hat geschrieben:

Andersrum, bekam ich so schwer Kontrast rein, das es mir bei manuell dann auch schnell um die Ohren flog.

Aber das scheint dann wohl eher am generellen DR Umfang der Szene zu liegen, der hier quasi nicht vorhanden war, oder? ;-)

Da müßte ich erst mal das Material haben, alles andere wäre nur Kaffeesatzleserei.

Und ja, es gibt natürlich Situationen da gibt das Motiv nicht viel Kontrast her.

Ich hab mal in einer weißen Traglufthalle gedreht. Erster Impuls: Geil! Gigantische Softbox - ja von wegen.

Es mußten dann zwei 4K HMIs her um halbwegs Kontrast zu erzeugen.

Hab jetzt leider keine Bilder von der Location mehr zur Hand, nur screenshots (geleuchtet und gegradet).

2020-06-19 12.02.47 www.youtube.com 8c2cb7c8846b.jpg

2020-06-19 12.03.55 www.youtube.com eaf1fbbfb7d9.jpg

Antwort von klusterdegenerierung:

@dienstag,

schade das es, egal wie sehr ich mich auch um neutralität bemühe, es immer wieder ins analysieren und kompromittieren meiner Persönlichkeit geht.

Kann man, wenn man will nachvollziehen, aber eine Notwendigkeit zur Klärung, besteht dafür nicht.

Man kann auch durchaus Worte finden die dem anderen nicht immer wieder vorhalten wie anders und unpassend er hier ist.

Antwort von klusterdegenerierung:

@Frank

Uff ui, ja da kommt viel Licht dahin wo man es nicht braucht.

Ist eben dem Blickwinkel geschuldet, zu viel Blendenstufen zwischen unten und oben.

Das Licht kommt nicht dahin wo es hin soll.

Antwort von dienstag_01:

klusterdegenerierung hat geschrieben:

@dienstag,

schade das es, egal wie sehr ich mich auch um neutralität bemühe, es immer wieder ins analysieren und kompromittieren meiner Persönlichkeit geht.

Kann man, wenn man will nachvollziehen, aber eine Notwendigkeit zur Klärung, besteht dafür nicht.

Man kann auch durchaus Worte finden die dem anderen nicht immer wieder vorhalten wie anders und unpassend er hier ist.

Ich sage überhaupt nicht, dass du unpassend bist. Deine Herangehensweise ist nur komplett anders als meine. Ich finde das eher interessant als falsch. Sonst hätte ich mir keine Gedanken darüber gemacht.

Antwort von Jörg:

es immer wieder ins analysieren und kompromittieren meiner Persönlichkeit geht.

woran, um alles in der Welt, mag das liegen ?????

Antwort von dienstag_01:

Jörg hat geschrieben:

es immer wieder ins analysieren und kompromittieren meiner Persönlichkeit geht.

woran, um alles in der Welt, mag das liegen ?????

Das ist jetzt auch nicht wirklich hilfreich.

Antwort von klusterdegenerierung:

Jörg hat geschrieben:

es immer wieder ins analysieren und kompromittieren meiner Persönlichkeit geht.

woran, um alles in der Welt, mag das liegen ?????

Bei Dir vermute ich mal weil Du aus Berlin kommst, gefrustet bist und Dich nur gut fühlen kannst, wenn Du andere runter machst.

Antwort von klusterdegenerierung:

@dienstag,

ja Du hast vollkommen Recht, jeder geht anders an die Sache ran und oft meint man das nur seine sei die einzig gute und richte, dabei gibt es durchaus viele Möglichkeiten an sowas ran zu gehen.

Ich war ja eigentlich ohne Lut immer sehr zufrieden, denn ich mag eigentlich zu viel Sättigung und Kontrast eher weniger, deswegen kam ich ja mit dem outofthe box Luts nicht so klar und habe mich deswegen dem Thema auch nicht näher gewidmet, was natürlich auch zur Folge hat, das man Leuten die sich damit besser auskennen auch mal ungewollt auf die Füße tritt.

Aber Gottseidank hat man ja hier sowohl die Chance das zu korrigieren und sich bei erfahreneren zu entschuldigen, wenn das überhaupt der richtige Begriff wäre. :-)

Zumindest habe ich gestern Nacht noch mal sehr viel meines Log Materials durchprobiert und konnte, zwar nicht überall, aber häufig eine positive Auswirkung der Lut bei richtiger Anwendung beobachten.

Allerdings muß ich jetzt erstmal auf die neue Farbgebung klar kommen, denn die gefällt mir nicht immer.

Kann man genau die irgendwie separieren?

Antwort von Mantas:

weiß einer ob Adobe Premiere das richtig handhabt?

Wenn man in Lumetri den LUT reinlädt und gleich bearbeitet. Oder muss man da zweimal Lumetri raufschmeißen?

Antwort von dienstag_01:

Mantas hat geschrieben:

weiß einer ob Adobe Premiere das richtig handhabt?

Wenn man in Lumetri den LUT reinlädt und gleich bearbeitet. Oder muss man da zweimal Lumetri raufschmeißen?

Ich weiß es nicht, sollte aber doch sehr leicht rauszubekommen sein.

Antwort von klusterdegenerierung:

Mantas hat geschrieben:

weiß einer ob Adobe Premiere das richtig handhabt?

Wenn man in Lumetri den LUT reinlädt und gleich bearbeitet. Oder muss man da zweimal Lumetri raufschmeißen?

Interessante Frage wenn man davon ausgeht das eine Lumetri Instanz wie eine Node werkelt.

Dann wäre es wahrscheinlich auch nicht uninteressant an welcher Stelle man die Lut Lumi einsetzt.

Wenn es so wäre wie bei Resolve, müßtest Du ja das grading über der Lut legen.

Sag mal gerne Bescheid wenn Du das für Dich austüfftelst.

Antwort von Mantas:

ok vielleicht könnt ihr mir da helfen.

LUT vor der Exposure = schneller clippen, egal ob Highlights oder Blacks.

Exposure vor der LUT = schönere RollOffs

richtig oder? Wenn ja, dann scheint Premiere es richtig anzugehen.

Antwort von dienstag_01:

Mantas hat geschrieben:

ok vielleicht könnt ihr mir da helfen.

LUT vor der Exposure = schneller clippen, egal ob Highlights oder Blacks.

Exposure vor der LUT = schönere RollOffs

richtig oder? Wenn ja, dann scheint Premiere es richtig anzugehen.

Was soll denn *richtig* in diesem Zusammenhang heißen?!

Worum geht es? Bei Verwendung einer LUT (in Resolve) können Bereiche, die ins Clipping gehen, nicht wieder zurückgeholt werden. Was einmal weg ist, ist weg. Deshalb wendet man die LUT im letzten Node an, danach korrigiert man nicht mehr.

Eine LUT von Log nach 709 im ersten Node eliminiert sozusagen den Dynamikgewinn wieder, den man sich mit der LUT erst geholt hat.

Ob da irgendetwas *schneller* clippt oder nicht, ist nicht die Frage, sondern, ob man den Dynamikgewinn des Log in seinem Workflow nutzen kann.

Antwort von klusterdegenerierung:

Mantas hat geschrieben:

ok vielleicht könnt ihr mir da helfen.

LUT vor der Exposure = schneller clippen, egal ob Highlights oder Blacks.

Exposure vor der LUT = schönere RollOffs

richtig oder? Wenn ja, dann scheint Premiere es richtig anzugehen.

Ja, genauso!

Wenn Du die erste Variante nimmst, drehst Du quasi an der Lut rum und vergurkst das Material und hast nicht die original Bandbreite.

Bei der 2. Variante kannst Du, wenn die Lut übertrieben hat, es mit einer secondary davor, wieder einleveln.

Oft ist es kein clippen, sondern die Lut schlägt über die Stränge, weil sie ja Dein Material bzw, Belichtung nicht kennt und es nur eine Annäherung darstellt.

Dann kannst Du alles wieder zurückholen und es nach Deinen Vorstellungen eingrooven.

Kannst Du ganz easy selbst mal testen und gucken, welche von den unterschiedlichen Luts am Ende der Kette überhaubt passt.

Sogesehen, kannst Du immer wieder zurück zum Umfang des Originals, aber es wird mit Lut nicht einfacher, wenn die Lut zb. die Höhen so hoch gedreht hat, das Du erst mal eine paar Umdrehungen brauchst, um sie wieder unters clipping zu bekommen. :-)