Der Begriff Denoising (auch Noise Reduction, kurz NR) bedeutet Entrauschen und ebendiese Funktion nutzen viele Anwender in letzter Zeit immer häufiger. Doch wann macht der Einsatz eines Denoisers überhaupt Sinn?

Auf den ersten Blick klingt "Denoising" wie eine magische Wunderwaffe. Mit genügend Rechenpower ist es scheinbar irgendwie möglich, aus stark verrauschten Aufnahmen wieder ein "klares" Bild zu erzeugen. Doch in der Praxis ist die Rauschentfernung auch mit ein paar Nachteilen verbunden, auf die wir sukzessive eingehen wollen.

Denoising braucht Rechenleistung

Als Daumenregel kann erst einmal gelten: Je besser ein Denoising-Algorithmus funktioniert, desto mehr Rechenleistung benötigt er. Auf einer normalen CPU ist schon ein moderner FullHD-Denoising-Algorithmus kaum in Echtzeit zu schaffen. Auf einer modernen GPU (also Grafikkarte) dagegen schon. Wenn es jedoch um die bestmöglichen Ergebnisse - eventuell sogar in 4K - geht, kommt man in der Regel nicht um längere Rendering-Sessions herum.

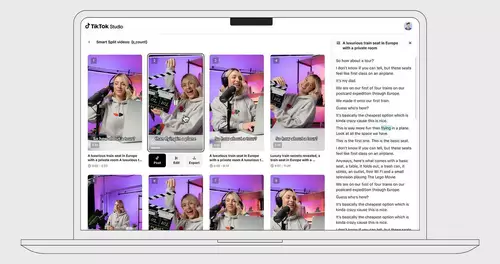

Dies ist insofern problematisch, weil man in vielen Bereichen einen Denoiser immer visuell kontrollieren sollte. Parameter, die in einer Szene gut funktionieren, können in einer anderen Szene (oder auch nur in anderen Bildbereichen) für hässliche Artefakte sorgen. Um jedoch die Qualität eines Denoisers richtig einzuschätzen, MUSS man dessen Ergebnis in Echtzeit sehen. Sieht man das Ergebnis z.B. nur mit 17 fps statt mit 24 fps, so ist eine korrekte Einschätzung der Bildwirkung fast unmöglich, da man das Bewegungsverhalten der Flächen und des übrigen Rauschens bei anderen Bildraten eben ganz anders wahrnimmt.

Zwei Grundtypen

Grundsätzlich lassen sich die Verfahren zur Rauschunterdrückung in zwei Klassen einteilen, temporale und spatiale Verfahren, wobei die besten Denoiser meistens beides kombinieren.

Die spatialen Verfahren betrachten nur die Rauschverteilung innerhalb eines Bildes und versuchen sich ein eigenes Bild des Rauschens zu machen. In der Regel erstellen sie so etwas wie einen typischen Abdruck (Noise-Print), worunter man sich eine möglichst getreue Simulation des vorhandenen Rauschens vorstellen kann. Dieses geschätzte Rauschen wird dann aus dem Original-Bild herausgerechnet.

Bei den temporalen Verfahren versucht dagegen die Noise Reduction zu erkennen, welche Veränderungen zwischen mehreren Bildern alleine auf das Rauschen zurückzuführen sind. Damit dies gut funktioniert, muss die Software daher auch erkennen, wenn sich die Kamera oder einzelne Objekte bewegen. Deswegen wird hierbei in der Regel das Material mittels Optical Flow-Algorithmen analysiert, was ohne GPU extrem zeitaufwändig ist. Im Gegenzug sind die temporalen Verfahren meist spürbar effektiver und gehen meist deutlich weniger destruktiv zu Werke. Eben weil sie über den zeitlichen Vergleich besser einschätzen können, welche Pixelwerte zu einem Objekt gehören und welche Pixelveränderungen durch Rauschen entstehen.

In diesem Zusammenhang sei auch kurz angemerkt, dass fast alle uns bekannten temporalen Rauschunterdrücker zeitlich nur in eine Richtung arbeiten. Das bedeutet, dass die ersten Frames eines Clips meistens noch stärker rauschen, bis der Algorithmus seine Parameter gefunden hat. Es ist daher anzuraten, beim Denoising immer ein paar Frames mehr Vorlauf/Fleisch mitzunehmen, als man später einsetzen wird. Denn dieses "Einschwingen" der Noise Reduction fällt auch ungeübten Betrachtern schnell ins Auge.