Nachdem wir ja kürzlich etwas kritisch auf die Zukunft der Kameraentwicklung geblickt haben, stehen wir vielleicht auch etwas in der Beweislast, welche Funktionen in Zukunft von der Computational Videography übernommen werden könnten.

Ein dabei von uns bislang wenig beachtetes Feld ist das Tracking, denn Verbesserungen in diesem Bereich ziehen in der Postproduktion extreme Möglichkeiten synthetischer Optimierungen nach sich. Nicht nur bei der Stabilisierung und der Berechnung von Slow Motions oder nachträglichem Motion Blur - in zweiter Instanz kann Motion Tracking sogar "über Bande" beim Denoising und damit der Dynamik helfen, sofern man damit Objekte zuverlässig erkennen und über die Zeit verfolgen kann.

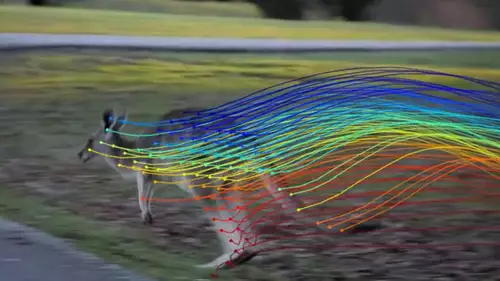

Für die meisten Tracking-Anwendungen sind Optical Flow Algorithmen aktuell der Goldstandard. Hierbei versucht ein Algorithmus einzelne Pixel im Bild zu erfassen und in ihrer Bewegung vorherzusagen. Sogenannte Solver versuchen dann ein komplexes Gleichungssystem für einige Pixel im Bild so zu lösen, dass die Abweichung von der Vorhersage mit den tatsächlich verfolgten Pixeln bestmöglich übereinstimmt.

Hat man so die Bewegung einiger Pixel als Bewegungsvektor gelernt, so kann man leicht Zwischenbilder generieren, weil die Position des Pixels zwischen zwei Bildern durch das gefundene Formel-System interpoliert werden kann.

In der Praxis

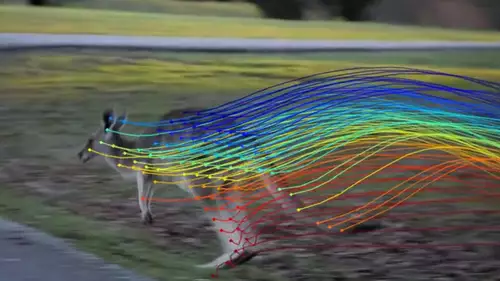

In der Praxis funktioniert dies oft auch erstaunlich gut. Gerade synthetische SlowMotion-Bewegungen können bereits ziemlich realistisch gerendert werden, was den Einsatz einer HighSpeed-Kamera in manchen Fällen überflüssig gemacht hat. Bzw. man kann Slow Motion damit sogar nachträglich in Bereichen einsetzen, in denen eine High Speed Kamera nicht zur Verfügung stand.

Pixelpeeper finden bei vielen synthetischen Bewegungen jedoch oft Stellen, die optisch nicht stimmen und gar nicht so selten kommt es bei vielen Optical Flow Anwendungen auch zu deutlich sichtbaren Artefakten, die nicht erst bei genauem Hinsehen offensichtlich werden.

Allerdings weiß man beim Dreh nie, ob man eventuell problematisches Tracking-Material für die Postproduktion erzeugt hat - weshalb man sich bei wichtigen Produktionen lieber nicht auf Optical Flow Algorithmen verlässt. Zumindest solange sie nicht noch zuverlässiger agieren...