Stable Diffusion auf dem eigenen PC

Voraussetzung für die Nutzung von Stable Diffusion auf dem eigenen PC ist eine GPU mit mindesten 4 GB VRAM (wie etwa eine Nvidia GeForce GTX 1660, RTX 2060 oder eine AMD Radeon RX 5600), um 512x512 Pixel große Bilder in wenigen Sekunden zu erzeugen. Zwar werden offiziell nur Nvidia GPUs unterstützt, aber inzwischen klappt das ganze erfreulicherweise auch mit AMD GPUs und https://replicate.com/blog/run-stable-diffusion-on-m1-mac Apples M1 Chips). Die Installation erfordert noch einige manuelle Schritte, es werden vermutlich aber bald auch komfortable Installer erscheinen.

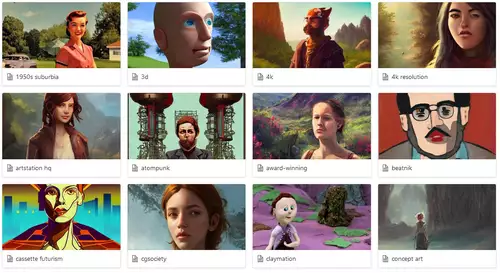

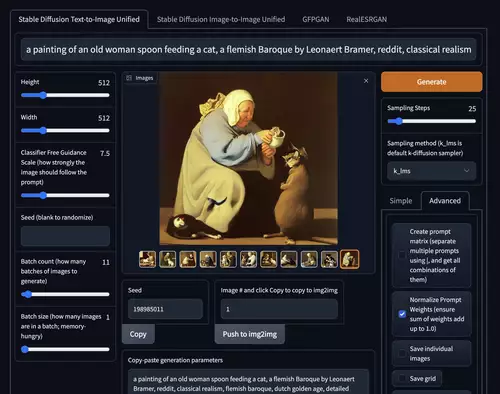

Ein schönes Userinterface zu Bedienung von Stable Diffusion samt zahlreicher praktischer Funktionen bietet das Projekt Stable Diffusion web UI, welches unter anderem einen Bildeditor samt Image2Image (plus der Möglichkeit nur Teile eines Bildes zu manipulieren) sowie einen KI Upscaling-Algorithmus integriert und die Einstellung vieler Parameter der Generierung ermöglicht.

Alternativen zum eignen PC: Per Webdienst oder Google Colab

Wer keine entsprechende Grafikkarte hat, muss aber nicht auf Stable Diffusion verzichten: es gibt inzwischen zahlreiche Möglichkeiten, Bilder auch kostenlos (wenn auch in begrenztem Umfang bzw. etwas langsamer) online selbst zu generieren, wie zum Beispiel bei Hugginface oder in einer verbesserten Version namens Dreamstudio, in welcher 1.024 x 1.024 große Bilder erzeugt werden können und man einfache Kontrolle über die verschiedenen Einstellungen der Generierung hat, auch bei Stability.ai selbst. Dreamstudio erlaubt eine Reihe von kostenlosen Läufen, bevor man zur Kasse gebeten wird. Weitere kostenfreie Online-Dienste mit einem simplen Interface zum Ausprobieren findet man auf dieser umfangreichen Liste.

Eine weitere Möglichkeit, die aber eher für User mit Programmierkenntnissen geeignet ist, bietet die Nutzung von Googles Colab, einem Online Python-Editor samt Laufzeitumgebung, welcher Nvidia Tesla ML-GPUs der Google-Cloud nutzt und auch in der kostenfreien Standardversion per Stable Diffusion Bilder rendern kann. Dank seiner Programmierumgebung können mittels kleiner Hacks schöne Features wie etwa die Generierung beliebig vieler Alternativen in einem Lauf implementiert werden.

Hier findet sich auch eine noch komfortablere Version mit dem oben genannten Webinterface. Wissenswertes zu Stable Diffusion findet sich im folgenden Wiki. Und wer wissen will wie eine solche Generierung von Bildern funktioniert, findet hier eine Beschreibung in Form eines Twitter Threads bzw. auch im folgenden Video:

Probleme hat Stable Diffusion oft noch mit menschlichen Gliedmaßen oder den Augen, die manchmal seltsam aussehen - das Team von Stability.ai arbeitet aber bereits an einer verbesserten Version.