Die Stable Diffusion Revolution durch bildgenerierende KI

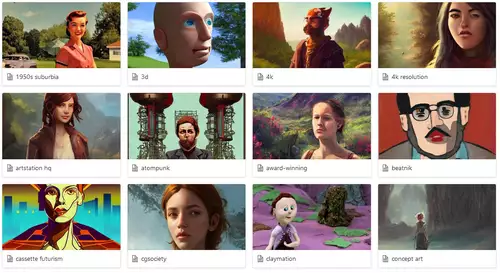

Weil Stability.ai - anders als zum Beispiel OpenAI (DALL-E2) oder Midjourney - erstmalig auch den zugrundeliegenden Programmcode samt trainiertem (und für normale GPUs komprimiertem) Modell veröffentlicht hat, explodieren gerade sowohl die Nutzerbasis als auch die darauf basierenden Tools und Online Dienste - nahezu täglich entwickeln User weitere - meist ebenfalls offene - KI Tools, die neue Möglichkeiten eröffnen. So gibt es jetzt zum Beispiel die spezialisierte Suchmaschine Lexica, mit deren Hilfe man 5 Million mit Stable Diffusion erzeugte Bilder nach Bildmotiven und Prompts durchsuchen kann und so Inspirationen für eigene Projekte finden. Andere Projekte feilen an Bildern mit einer noch höheren Auflösung oder interaktiver Bearbeitung.

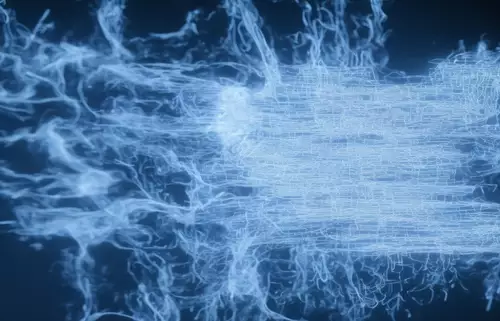

Viele Künstler experimentieren schon mit Stable Diffusion und entdecken für sich neue Möglichkeiten und Workflows in Interaktion mit der KI. Wie in Zukunft die professionelle Zusammenarbeit von Künstlern mit einer bildgenerierdenen KI aussehen könnte, demonstriert das im Verein mit Stable Diffusion veröffentlichte und darauf basierende Tool img2img, welches mehr Kontrolle über den Generierungsprozess ermöglicht als Stable Diffusion selbst, denn es kann als Vorlage für eine exakte Bildkomposition eigene Skizzen nutzen. Da img2img auch einfach vorgegebene Bilder in andere Stile umwandeln kann, gibt es auch schon damit produzierte Animationen von Videos, allerdings hapert es dabei noch an einer zeitlichen Kohärenz der Bilder.

Das folgende Video demonstriert schön, wie mit Hilfe von Stable Diffusion in Form eines Photoshop-Plugins (des noch in einer privaten Betaphase befindlichen Alpaca ) ganz gezielt künstlerische Visionen umgesetzt werden könnten: