Eigentlich entspricht es ja dem gesunder Menschenverstand, daß fehlende Detailinformationen bei unscharfen Bildern nicht im Nachhinein ergänzt werden können. Es werden aber schon seit längerem sogenannte Super-Resolution Verfahren entwickelt, um Bilder nachträglich zu schärfen, etwa indem Informationen aus vor- und nachgehenden Bildern genutzt werden oder indem versucht wird in einem Bildausschnitt bekannte Muster zu erkennen, welche dann ergänzt werden können. Wir hatten zu den verschiedenen Entwicklungsstufen von Super-Resolution über die Jahre ja schon einige Artikel wie etwa ehr Bildschärfe durch künstliche Intelligenz - Super-Resolution und Grundlagen : Hocus Bogus - Super-Resolution.

Durch (tiefschichtige) neuronale Netze haben diese Super-Resolution Verfahren in den letzten Jahren große Fortschritte in Sachen Qualität und Schnelligkeit gemacht, eigenen diese sich doch perfekt dafür, mittels Training anhand einer großen Anzahl von Bildern, auch in unbekannten Bildern (unscharfe) Strukturen zu erkennen und diese durch ihr vorhandenes Wissen sinnvoll durch mehr Bildinformationen zu ergänzen und so zu schärfen.

Dabei handelt es sich allerdings streng genommen nicht um das das realistätsgetreue Wiederherstellen verlorengegangener Informationen, sondern um ein auf Erfahrungen basierendes "Raten", ähnlich wie es die menschliche Wahrnehmung auch oft macht (was man bei manchen optischen Täuschungen gut beobachten kann).

Erst wurden solche Verfahren für Photos oder Einzelbilder aus Videos entwickelt, dann auch für ganze Videos. Das Training ist einfach - Clips werden in niedriger Auflösung ausgespielt und anhand der Originale bewertet dann der Algorithmus, wie gut er gerade den verlorengegangenen Inhalt "erraten" hat und verbessert dann den nächsten Rateversuch.

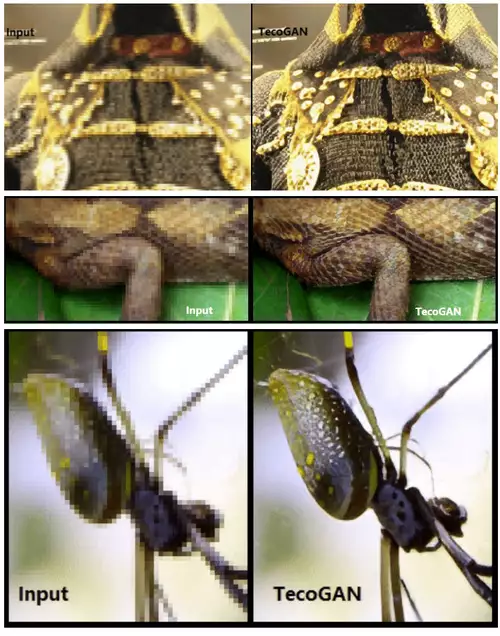

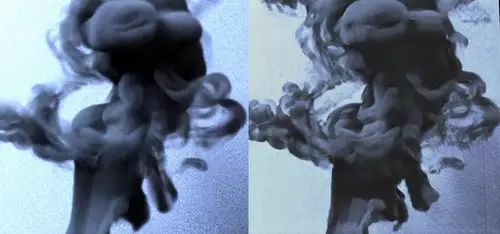

Bisher aber litten solche Verfahren darunter, daß es oft zu Sprüngen zwischen zeitlich aufeinanderfolgenden Einzelbildern kam, weil der Algorithmus - sei es durch Artefakte oder durch Bildrauschen - unterschiedliche Muster zu erkennen glaubte und diese ergänzte. Der gerade auf der Siggraph 2020 vorgestellte TecoGAN Algorithmus der TU München erzielt in genau diesem Aspekt jetzt große Fortschritte und erzeugt räumlich und zeitlich kohärente Bildfolgen. Die Ergebnisse sind wirklich erstaunlich - die aus unscharfen Videos resultierenden Clips sind deutlich schärfer und zeigen mehr Details.

// Top-News auf einen Blick:

- Blackmagic DaVinci Resolve 20.2.2 verbessert Farbmanagement und behebt Bugs

- Support-Ende für Windows 10: Microsoft gewährt weitere Gnadenfrist.

- Blackmagic DaVinci Resolve Studio gibt es gerade rund 45 Euro billiger

- 43Rumors - Stellt Panasonic am 17. Oktober eine neue Panasonic LX100 III vor?

- Adobe Creative Cloud Pro Abo aktuell rund 50% ermässigt

Hier wird der TecoGAN Algorithmus noch etwas erläutert:

Wer will und über das notwendige Wissen verfügt, kann TecoGAN selbst ausprobieren, der Code findet sich auf hier auf GitHub. Hier noch mehr Beispiele von geschärften Bildern. Das Projekt hat zur Berechnung eine Nvidia GeForce GTX 1080Ti GPU mit 11 GB RAM genutzt.

Und zur Anschauung noch ein weiterer "2 Minute Papers" Clip, der einen anderen faszinierenden DeepLearning Algorithmus vorstellt, der im großen Maßstab fehlende Bildinhalte zu "erraten" versucht und selbstständig ergänzt: