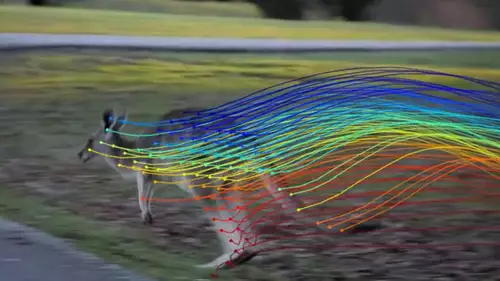

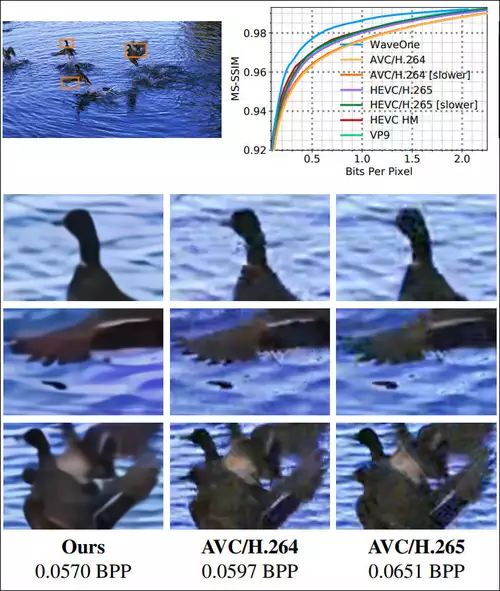

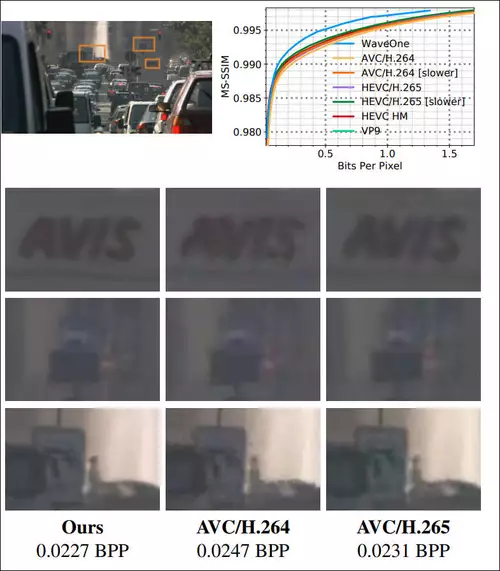

Noch ist die Encodingzeit etwas zäh, aber ein neues Paper belegt, was von vielen Beobachtern aktueller KI-Algorithmen schon länger erwartet wurde. Ein auf neuronalen Netzen beruhender Codec schlägt in diesem Versuch alle bisher bekannten Codecs im Bezug auf Bildqualität und Effizienz. Einfach erklärt: Es wird dabei eine Folge von Frames in ihrer Struktur "verstanden", was deren Reproduktion ohne die üblichen Artefakte ermöglicht. Stattdessen wirken die feinsten Details eher wie mit einem Aquarellpinsel gemalt:

Lässt man objektive Messwerte -wie den der Strukturierten Ähnlichkeit (MS-SSIM)- die Qualität beurteilen, so gewinnt der neue Codec im Paper schon durch die Bank. Offen bleibt allerdings, ob dies auch mit anderen Testvideos oder mit speziellen Problemen wie schnellen Schwenks gelingen würde.

// Top-News auf einen Blick:

- Erste Black Friday Angebote von Atomos, Nanlite, DZOFILM und mehr

- SanDisk stellt Extreme Fit vor: Aktuell kleinster 1TB USB-C-Speicherstick

- Apple plant OLED-MacBook Pro, Mac Studio M6 Ultra und Mini-LED Studio Display

- DJI Avata 360 - Leaks zeigen DJIs neue 360°-Drohne

- ARRIs Color KnowHow könnte Millionen Wert sein - als Workflow Lizenz für Dritte

- Canon EOS C50 im Praxistest: Kompaktes Arbeitstier mit 7K 50p Raw - die neue FX3 Konkurrenz