Generative Video-KIs haben erhebliche Fortschritte gemacht, kämpfen aber weiterhin oft damit, die Bewegungen von Menschen und Objekten realistisch, also kausal korrekt, darzustellen. Meta hat jetzt mit VideoJAM ein neues Framework vorgestellt, durch das sich diese Probleme beheben lassen sollen, indem laut Meta-Forschern anders als bei den konkurrierenden Video-KIs beim Training nicht die Qualität der Darstellung gegenüber der Bewegung bevorzugt wird.

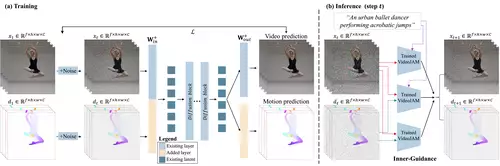

VideoJAM besteht aus zwei zentralen Komponenten: Während des Trainings werden sowohl die einzelnen Pixel, als auch deren zugehörige Bewegung von einem Einzelbild zum nächsten vorausgesagt. Später beim Generieren kann dann auf die gelernten Bewegungsvorhersagen als dynamisches Leitsignal Bezug genommen werden.

Interessanterweise kann VideoJAM mit minimalen Anpassungen auf jedes Videomodell angewendet werden, ohne dass Änderungen an den Trainingsdaten oder der Skalierung erforderlich sind - es erreicht so den aktuellen Stand der Technik in Bezug auf Bewegungsstimmigkeit und verbessert gleichzeitig die visuelle Qualität. VideoJAM zeigt somit, dass die Integration von Erscheinungsbild und Bewegung sowohl die Kohärenz als auch die Gesamtqualität von Videos verbessern kann.

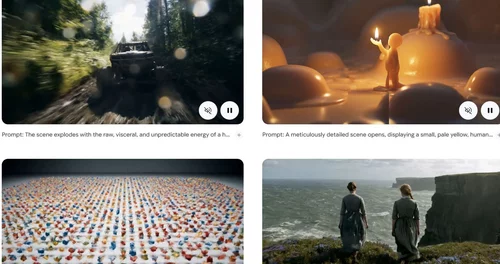

Dass VideoJAM tatsächlich aktuell konkurrierende Modelle übertrifft, soll anhand eines qualitativen Vergleichs mit den führenden KI-Modellen (den proprietären Modellen Sora, Kling und Runway Gen3) sowie einem Basismodell, von dem aus VideoJAM feingetunt wurde (DiT-30B) anhand repräsentativer Prompts demonstriert werden (allerdings wurde inzwischen Kling 1.6 veröffentlicht, welches sich ebenfalls durch eine sehr gute Bewegungsdarstellung auszeichnet):

// Top-News auf einen Blick:

- Neue Gerüchte: Nvidia soll die GPU-Produktion 2026 um 3040% runterfahren

- Adobe Firefly bekommt Upscaling per Topaz, Editing per Prompt und mehr

- Leak: Samsungs plant SATA-Aus - Kommt der Preisschock auch bei SSDs?

- Kompaktkameras wieder im Trend - trotz Smartphones

- Von Mickey Mouse bis Darth Vader - Disney lizenziert seine Figuren an OpenAIs Sora

- Verstehen Video-KIs die Welt? Physik-IQ enthüllt Grenzen der Modelle

Still not available but soon.

𝚉𝚊𝚎𝚜𝚊𝚛 𝚊𝚒𝚏𝚒𝚕𝚖𝚜.𝚊𝚒 (@zaesarius) February 5, 2025

VideoJAM: Enhancing Motion Generation in Video Models

VideoJAM is a novel framework that improves motion generation in video models by addressing the limitations of conventional pixel reconstruction objectives.

It introduces a joint pic.twitter.com/3fQZJAoWB3

Die Democlips sind tatsächlich beeindruckend, zeigen sie doch komplizierte Bewegungsabläufe wie etwa eine Piroutte, Breakdancing oder einen Skateboardsprung, welche bei anderen Video-KIs oft zu Darstellungsproblemen an den Extremitäten führen.