Frage von andieymi:Nachdem das Thema medial im Moment gerade omnipräsent ist - und in vielen anderen Threads irgendwie mitschwimmt und immer wieder auftaucht - dachte ich mir, ich mache mal einen generellen AI-Diskussionsthread auf. Könnte mir vorstellen, dass es mehr hier interessiert.

Ich glaube, dass wir einerseits AI im Moment maßlos überschätzen (was im Moment und in den nächsten 1-5 Jahren funktionieren wird) und gleichzeitig die gesellschaftlichen Implikationen maßlos unterschätzen. Cool wenn jeder User beliebig Bild & Texte generieren kann. Aber findet es jeder Buchhalter auch cool, wenn seine Abteilung wegautomatisiert wird? Ich weiß nicht, ob die Vorteile von AI ohne Automatisierung und deren Auswirkungen auf unsere Gesellschaft überhaupt diskutierbar sind? Ich glaube nur absolut nicht, dass es lange beim lustigen "Jeder kann sich jetzt seine Bildchen generieren lassen" bleiben wird.

Wird sich das als Weggabelung zwischen Utopie und Dystopie herausstellen? Beides ist denkbar, von weitestgehenden, AI-gestützten Weg-Automatisierung von Leid und vielen menschlichen Problemen bis hin zur dystopisch-futuristischen totalen Kontrolle durch jene, welche die AI-Kontrollieren? Vermutlich liegt die Zukunft irgendwo in der Mitte?

Antwort von Alex:

Was man glaube ich vernachlässigen kann, ist die Frage, ob man die aktuellen und kommenden Möglichkeiten jetzt persönlich toll findet oder eben nicht, aus welchen Gründen auch immer. Die Katze ist aus dem Sack und nicht mehr aufzuhalten. Die Frage, die sich eher auftut, wie wird sich unsere Welt dadurch verändern, denn das wird sie sicher. Aber wie gehen wir damit um, bzw. wie werden wir damit leben (lernen) und es zu unserem Vorteil nutzen?

Im kompletten Bereich der Content-Erstellung (Text, Bild, Video, Sprache, Programmierung,...) wird sie ein weiteres, mächtiges Werkzeug in der Kiste sein, das ist ja am naheliegendsten. Sicher wird sie auch viele Jobs kosten, z.B. in Bereichen wie Support/Beratung. Es werden ja heute schon (schlechte) Chatbots von vielen großen Playern eingesetzt, ich denke, das wird sehr schnell gehen und wir können es nicht mehr unterscheiden, ob wir mit einem Programm oder einem Servicemitarbeiter chatten, telefonieren oder einen Videocall halten.

Natürlich wird das alles noch viel mehr kommerzialisiert werden, ganz weit vorne die Big Data Konzerne und dem einhergehenden Geschäftsmodell diese für Werbetreibende zu verkloppen. Jetzt geht der Run in der Techbranche erstmal darum, wer technologisch die Nase vorne hat und sinnvolle Dienste anbieten kann. Und dann im bekannten Schema weiter: Kleine Happen für freie Nutzung und kostenpflichtig für Zusatzfeatures oder unbegrenzte Nutzungsdauer.

Viele der Gefahren, die auf uns zukommen, kennen wir schon von anderen technologischen Fortschritten, dass man den produzierten Medien nicht mehr ansieht, ob es sich um einen wahren Inhalt handelt oder man etwas Gefaktes zu sehen oder hören bekommt, aber soweit waren wir auch schon vor der KI-Technologie. Nur wird es jetzt noch einfacher und realistischer werden.

Wie Frank neulich in einem Beitrag schon einmal (so ähnlich) erwähnt hat, die Sache wird kommen, auf jeden Fall, und jeder sollte sich selbst jetzt schon auf die Hinterbeine stellen und überlegen wie was die neuen Technologien für einen selbst bedeuten und ob man sie für seine eigene Zwecke als Vorteil nutzen kann. Denn wer heute den Anschluss behält, kann morgen davon vielleicht profitieren. Oder im Umkehrschluss, wer den Zug verpasst, zieht am Ende vielleicht den Kürzeren...

Das ist jedenfalls ein unfassbar spannendes Thema, wobei ich einerseits sehr gespannt bin, in welchen Bereichen wir weitere Fortschritte sehen werden, aber etwas gruselig ist das schon...

Antwort von Alex:

Bill Gates erwartet von ChatGPT Automatisierung von Bürojobs

https://www.golem.de/news/umbau-des-ste ... 71811.html

Antwort von Axel:

andieymi hat geschrieben:

Ich glaube, dass wir einerseits AI im Moment maßlos überschätzen (was im Moment und in den nächsten 1-5 Jahren funktionieren wird) und gleichzeitig die gesellschaftlichen Implikationen maßlos unterschätzen. Cool wenn jeder User beliebig Bild & Texte generieren kann. Aber findet es jeder Buchhalter auch cool, wenn seine Abteilung wegautomatisiert wird? Ich weiß nicht, ob die Vorteile von AI ohne Automatisierung und deren Auswirkungen auf unsere Gesellschaft überhaupt diskutierbar sind? Ich glaube nur absolut nicht, dass es lange beim lustigen "Jeder kann sich jetzt seine Bildchen generieren lassen" bleiben wird.

Ähnlich sieht es Noam Chomsky, der etliche auf Youtube veröffentlichte Interviews zum Thema gegeben hat.

Überschätzt insofern, dass es zwei Aspekte menschlicher Intelligenz gibt, die betroffen sind: Denken und Lernen. Lernen auf natürliche und effektive Weise ist der Prozess der Problemlösung. Die äußere Welt liefert die Probleme, der Lernende entwickelt Lösungen. AI benötigt eine Programmierung, um mit mehr Variablen jonglieren zu können, als es ein Mensch könnte. Die Programmierung ist von Seiten der Programmierer ein Modell, das menschliches Lernen imitiert. Aber in den Grenzen, die fehlende Neugier, persönliches Interesse oder überhaupt die Wahrnehmung eines Defizits erlauben. Quantitativ beeindruckend, qualitativ nicht. Die AI macht auf komplexere Weise das, was ein Taschenrechner auch macht: ein Ergebnis berechnen.

Denken wird von der Kognitionsforschung nicht verstanden, kann also auch nicht programmiert werden. Obwohl, ironischerweise, es evolutionär entstand, und zwar durch Sprache. Was Menschen einzigartig macht ist die

abstrakte Sprache, das gedachte, gesprochene und geschriebene Wort, während nonverbale Kommunikation auch bei Ameisen, Vögeln und Ratten funktioniert. Sprache ist angeboren, und paradoxerweise nicht in der Lage, sich selbst zu erklären.

AI ist also den Menschen in der Lösung vorgegebener Probleme (solche, die den Menschen interessieren) überlegen. Und sie wird letztlich nicht "Open Source" bleiben, sondern von Konzernen und Regierungen kontrolliert. Das ist dystopisch. Weggefallene Arbeitsplätze sind dabei das kurzfristige, kleinere

Problem.

Antwort von Frank Glencairn:

Ich seh da aktuell verschiedene Bereiche, die man getrennt betrachten muß.

1. Content. Auch wenn die AI jetzt bereits aus nem eingetippten Satz ganz erstaunliche Bilder hervorbringt, ist das alles noch viel zu "unscharf" - d.h. wenn man ganz gezielt etwas möchte ist das fast nicht möglich (von Händen/Fingern - die immer noch ein Problem sind, weil die AI nicht begreift was Hände sind mal ganz abgesehen). Dezidierten Content zu erstellen - dafür ist AI also (noch) nicht ready for prime time.

2. Inspiration/Entwürfe/Concept Art. Dafür ist AI jetzt schon großartig - je mehr wir von SciFi/Fantasy etc. Bereichen sprechen umso besser. Aber auch Anregungen für Websites etc, sind absolut brauchbar.

3. Text - das ist noch eher zweifelhaft, ich seh im Web immer mehr AI generierte Texte (und es fällt sofort auf), und da hat man das selbe Problem wie mit den Händen, die AI begreift nicht worum es geht.

4. Text to Speech - da würde ich mal sagen, stehen wir kurz vor dem Durchbruch. Voice Cloning funktioniert schon wirklich gut (wenigstens auf Englisch). Sprecher sollten sich also warm anziehen.

5. Musik - das ist noch ein weiter Weg (abgesehen von Electro Gedüdel - das war immer schon beliebig zusammengewürfelt) - aktuell ist da AI noch mindestens 2-3 Ligen unter einem 15 Jahre alten Band in a Box. Ich denke da ist auch ein rein mathematischer Ansatz besser.

6. Kleine Helferlein. Noise removal, Magic Mask, Topaz, Transkribieren etc. also all das AI basierte Zeug das wir schon heute täglich nutzen ist jetzt schon mehr als brauchbar und wird noch besser werden.

7. Suchmaschinen - oder vielleicht sollte ich lieber Antwortmaschinen sagen, wenn die sich nicht schnell was einfallen lassen, wird es eng für Goggle.

Antwort von Funless:

Also ohne jetzt den Korinthenkacker heraushängen zu wollen, bin ich allerdings der Meinung, dass wir in diesem Thread (aber auch grundsätzlich) beim Verständnis der Begrifflichkeiten etwas differenzieren sollten.

All die ganzen Lösungen die seit einiger Zeit hier im Forum thematisiert werden und wie oben von Frank aufgezählt, haben eigentlich mit A.I. (Artificial Intelligence = künstlicher Intelligenz (KI)) de facto nichts zu tun, sondern handelt es sich hierbei um sog. "Machine Learning" und das ist ein wesentlicher Unterschied, da Machine Lerning wie oben von Axel bereits richtig formuliert, mithilfe eines Algorithmus aus einem riesigen Datenpool an Vorgaben ein "Ergebnis" erstellt, während die KI mithilfe von Algorithmen und Wahrscheinlichkeitsberechnungen eine explizite "Entscheidung" trifft.

IMHO ist das wichtig in der Diskussion im Auge zu behalten. Machine Learning kann in vielen Bereichen ein wichtiges und wertvolles Tool sein, bspw. in der Medizin (Radiologie) wo ML bereits seit einiges Zeit als Unterstützung bei der Analyse von MRT und CT Bildern erfolgreich eingesetzt wird. Oder auch in der Archäologie bei der Entschlüsselung und Übersetzung von antiken Schriftzeichen.

KI wiederum ist bspw. im Gaming Bereich bereits seit längerer Zeit im Einsatz. Angefangen vom simplen Schachcomputer bis hin zu computergesteuerten Gegner Fahrzeugen in einem Autorennspiel. Natürlich kann Machine Learning ein Teil von KI sein bzw. ist es bei einigen KI Lösungen auch, allerdings ist Machine Learning für sich allein gestellt niemals KI aufgrund des o.g. Unterschieds.

Antwort von Alex:

harari.jpg

Antwort von TheBubble:

andieymi hat geschrieben:

Ich glaube, dass wir einerseits AI im Moment maßlos überschätzen (was im Moment und in den nächsten 1-5 Jahren funktionieren wird) und gleichzeitig die gesellschaftlichen Implikationen maßlos unterschätzen. Cool wenn jeder User beliebig Bild & Texte generieren kann.

AI, bzw. das was heute unter dem Begriff der AI vermarktet wird, wird ein wenig überschätzt, denn bisher fehlt den Systemen eine Form des inhaltlichen Verständnisses. Allerdings: Für manche Dinge braucht man dies auch nicht.

andieymi hat geschrieben:

Aber findet es jeder Buchhalter auch cool, wenn seine Abteilung wegautomatisiert wird? Ich weiß nicht, ob die Vorteile von AI ohne Automatisierung und deren Auswirkungen auf unsere Gesellschaft überhaupt diskutierbar sind?

Es wird definitiv irgendwann Auswirkungen geben. Bei neuen und bahnbrechenden technischen Entwicklungen war das zumindest immer so. Wobei: Ist der Buchhalter nicht schon fast wegoptimiert? Früher gab es wohl riesige Schreibstuben, in denen Korrespondenz verfasst wurde, Rechnungen geschrieben, usw. Gibt es das noch? Ich meine nein.

Früher war der Beruf eines Fotografen reguliert, d.h. nicht jeder durfte ihn ausüben, da zu gefährlich. In der Anfangszeit der Fotografie sollen durch Blitzlichter ausgelöste Brände gar nicht so selten gewesen sein, für die Filmentwicklung musste im Dunkeln mit Chemie hantiert werden. Das wurde später insofern verbessert, indem man die Filme entsprechend kapselte und zur Entwicklung in Großlabore abgab. Dadurch wurden Fotografie und Film erstmals massentauglich, wenn auch noch mit laufenden Kosten verbunden. (Nicht nur die Kamera, sondern auch jeder Film und jeder Abzug mussten bezahlt werden.)

Spätestens mit den Digitalkameras ist aber auch der Kostenfaktor Film und seine Entwicklung entfallen, Ergebnisse konnten sofort und nicht erst nach Tagen begutachtet werden. Die Fotografie wurde somit vollends massentauglich. Der Beruf des Fotografen hat sich entsprechend gewandelt bzw. wandeln müssen, er ist aber trotzdem nicht komplett entfallen.

Vergleichbares wird vermutlich auch in anderen Bereichen geschehen.

Antwort von Axel:

TheBubble hat geschrieben:

Wobei: Ist der Buchhalter nicht schon fast wegoptimiert? Früher gab es wohl riesige Schreibstuben, in denen Korrespondenz verfasst wurde, Rechnungen geschrieben, usw. Gibt es das noch? Ich meine nein.

Darüber diskutiere ich kürzlich mit einem Freund. Der meinte, anhand der Erdbeben-Gebäudeeinstürze in der Türkei einen Vorteil in der deutschen Bürokratie zu erkennen. Langsamer, auch sturer, manchmal kafkaesk. Aber DIN. Die Weigerung, jahrzehntelange Verschleppung bei der Digitalisierung aufzuholen als Beharrlichkeit, die ja nicht

nur Nachteile hat. Als Gegenbeispiel fiel uns die unfassbare Genehmigung der amerikanischen Verkehrsbehörde ein, fahrerlose Test-Teslas (AI-gesteuert) im regulären Straßenverkehr fahren zu lassen, was zu einigen gut dokumentieren Unfällen führte: Der Mittelstreifen wurde als Standstreifen interpretiert. Nicht die Schuld der AI!

Antwort von Frank Glencairn:

Hat vielleicht auch mit der Abwesenheit von M5 Erdbeben bei uns zu tun, was unsere Vorschriften wirklich taugen, würde man dann erst sehen.

Antwort von Darth Schneider:

Wenn dann die Erde sehr kräftig bebt, können wir nur noch hoffen das die Häuser lange genug zusammen halten das wir es noch rechtzeitig nach draussen schaffen.

Gegen solche Kräfte sind wir nicht wirklich gewappnet, mehr einfach nur ihnen ausgeliefert.

Gruss Boris

Antwort von Funless:

Axel hat geschrieben:

Als Gegenbeispiel fiel uns die unfassbare Genehmigung der amerikanischen Verkehrsbehörde ein, fahrerlose Test-Teslas (AI-gesteuert) im regulären Straßenverkehr fahren zu lassen, was zu einigen gut dokumentieren Unfällen führte: Der Mittelstreifen wurde als Standstreifen interpretiert. Nicht die Schuld der AI!

Das ist ein sehr gutes Beispiel, finde ich und allein beim Thema Autonomes Fahren könnte man IMHO bereits über mehrere Seiten in diesem Thread diskutieren.

Es ist ja allgemein bekannt, dass nahezu alle Auto Hersteller geradezu fieberhaft an der Entwicklung des autonomen Fahrens arbeiten. Die einen Hersteller (bspw. Tesla oder Mercedes) sind dabei schon etwas weiter als andere aber letztendlich hapert es ja zur vollständigen Umsetzung an den dafür gesetzlichen Vorgaben, insbesondere beim Thema wer bei einem Unfall die Verantwortung trägt. AFAIK ist dies nach wie vor rechtlich nicht geklärt. Wer hat bei einem Unfall die Schuld? Der Autohersteller weil er die AI programmiert hat oder der Fahrer, der im Augenblick eines Level 5 autonom fahrendem Fahrzeug ja dann de facto kein Fahrer mehr, sondern Passagier ist?

Insgesamt finde ich das Thema AI und ML äußerst spannend. Warum spannend? Weil hier IMHO eine riesige Menge an Potenzial steckt die Grenzen des realisierbaren weit nach oben zu verschieben, sei es bei kreativen oder operativen Anwendungsfällen. Allerdings sehe ich auch eine große Gefahr durch möglichen Missbrauch in nahezu allen Bereichen in denen AI und ML zum Einsatz kommen könnte.

Es wird letztendlich also wohl an uns (die Gesellschaft) liegen ob sich das alles zum rein positiven oder rein negativen entwickeln wird. Eher vermute ich aber einen Mix aus beidem.

Wovon ich allerdings in absehbarer Zeit (und damit meine ich die nächsten drei bis sechs Jahrzehnte) nicht ausgehe ist, dass uns ein HAL 9000 oder ein positronengehirnbestückter Commander Data übern Weg laufen wird. Solch komplexe AI werden frühestens meine Urenkel vielleicht kennenlernen.

Antwort von Darth Schneider:

@Funless

Erfahrungsgemäss hat absolut jede High Tech Innovation die für uns heute selbstverständlich ist, ursprünglich seine Wurzeln bei der Armee. Und genau dort wird auch heute Betreffend KI mit Abstand am meisten Geld verschluckt und auch geforscht.

Also ich denke Nein, das ist nicht wirklich nur abhängig von der Gesellschaft was mit der KI passieren und wofür sie genutzt werden wird

Gruss Boris

Antwort von Drushba:

"Frank Glencairn" hat geschrieben:

Ich seh da aktuell verschiedene Bereiche, die man getrennt betrachten muß.

1. Content. Auch wenn die AI jetzt bereits aus nem eingetippten Satz ganz erstaunliche Bilder hervorbringt, ist das alles noch viel zu "unscharf" - d.h. wenn man ganz gezielt etwas möchte ist das fast nicht möglich (von Händen/Fingern - die immer noch ein Problem sind, weil die AI nicht begreift was Hände sind mal ganz abgesehen). Dezidierten Content zu erstellen - dafür ist AI also (noch) nicht ready for prime time.

2. Inspiration/Entwürfe/Concept Art. Dafür ist AI jetzt schon großartig - je mehr wir von SciFi/Fantasy etc. Bereichen sprechen umso besser. Aber auch Anregungen für Websites etc, sind absolut brauchbar.

3. Text - das ist noch eher zweifelhaft, ich seh im Web immer mehr AI generierte Texte (und es fällt sofort auf), und da hat man das selbe Problem wie mit den Händen, die AI begreift nicht worum es geht.

4. Text to Speech - da würde ich mal sagen, stehen wir kurz vor dem Durchbruch. Voice Cloning funktioniert schon wirklich gut (wenigstens auf Englisch). Sprecher sollten sich also warm anziehen.

5. Musik - das ist noch ein weiter Weg (abgesehen von Electro Gedüdel - das war immer schon beliebig zusammengewürfelt) - aktuell ist da AI noch mindestens 2-3 Ligen unter einem 15 Jahre alten Band in a Box. Ich denke da ist auch ein rein mathematischer Ansatz besser.

6. Kleine Helferlein. Noise removal, Magic Mask, Topaz, Transkribieren etc. also all das AI basierte Zeug das wir schon heute täglich nutzen ist jetzt schon mehr als brauchbar und wird noch besser werden.

7. Suchmaschinen - oder vielleicht sollte ich lieber Antwortmaschinen sagen, wenn die sich nicht schnell was einfallen lassen, wird es eng für Goggle.

Gute Zusammenfassung. Mich würde ein Thread "AI - Erfahrungsberichte" zudem mehr interessieren, als ein Pro/Kontra, was ja thematisch irgendwie vorgaukelt, wir könnten durch Abwägen in einer Diskussion noch Einfluss auf die AI-Entwicklung nehmen. Hier gebe ich Axel recht, der Drops ist gelutscht und AI ist da. Aber dystopisch sehe ich das nicht. Dystopisch sehe ich die bisherige Menschheit ohne AI und glaube, es kann nur besser werden.))

Antwort von Darth Schneider:

Und warum denkst du mit der KI wird die Menschheit besser ?

Das kann die KI doch gar nicht, das kann nur die Menschheit selber

;)

Gruss Boris

Antwort von andieymi:

Danke für die Inputs, ich finde die Ansätze - gerade den von Trennung Machine Learning und AI gut!

Mir geht es auch nicht wirklich darum, irgendwelche Entwicklungen durch eine Pro/Kontra-Entscheidungsfindung irgendwie "aufhalten" zu wollen, maximal vielleicht Bewusstsein schaffen. Wenn der nvidia CEO Chat GPT als "iPhone-Moment" der AI bezeichnet, so kann er sich irren, oder aber die Transformation wird ähnlich groß sein wie die des Internets in den letzten 15 Jahren, die größer und sprunghafter war als was das Internet an sich in den 15 Jahren zuvor verändert hat. Ich kann mich an die Zeiten kaum mehr erinnern weil ich noch ein Kind war, aber das Internet der späten 90er glich wirklich einem "Hier bin ich, ok - aber viel gibt's hier nicht?!"

https://www.pcgameshardware.de/Neue-Tec ... t-1413458/

Ich glaube mir ging's mit dem Thread schon eher auch um die Implikationen, die sich vielleicht nicht aufhalten lassen können (ok, das ließen sich biologische und chemische Kriegsführung auch nicht, aber sie sind seit dem Ausmaß des 1. Weltkriegs doch immens zurückgedrängt worden - jetzt kann man kritisieren, der Vergleich ist weit hergeholt, aber wie schon von jemandem erwähnt, das was wir sehen sind die öffentlichen "Schaumkronen", die Welle darunter bricht im militärischen- & Überwachungsbereich schon lange), aber für die Bewusstsein mindestens so wichtig ist wie Lobeshymnen.

Was bedeutet das für Urheberrecht? Was bedeutet das für Automatisierung?

Welche Konsequenzen haben - korrigiert mich wenn das anders aussieht - AIs, die allesamt von kommerziell orientierten Unternehmen angeboten und trainiert werden, wenn alles nur mehr mit AIs geht?

Heute einen ganz guten Basic-Podcast zu dem Thema gehört, auch da wurde über die Fortschritte in der Medizin philosophiert, und dass es schon vor 5 Jahren hieß "Wieso noch Radiologen ausbilden? AI macht das." Naja, AI macht das noch nicht und was machen wir, wenn es exakt eine Firma gibt, die AIs im medizinisch-diagnostischen Bereich anbietet und keine Radiologen mehr, um sich nicht immer und zwangsläufig auf nur die verlassen zu müssen?

Man kann mir jetzt ganz schnell das Schild mit "Skeptiker" in die Hand drücken, aber das bin ich eigentlich nicht, glaube ich zumindest. Wenn dann eher kritisch. Ich kann umgekehrt auch die Utopie erkennen, die AI und Automatisierung bietet. Vermutlich wäre schon mit dem technischen Status Quo dieser Tage viel Arbeit & auch menschliches Leid vermeidbar, wenn es nicht im Moment nicht noch billiger wäre, Arbeitskräfte in gewissen Berufen/Ländern auszubeuten. Vielleicht bin ich weniger Skeptiker, als das mir einfach der naive Glaube fehlt, dass die Menscheit aus fortschrittlicher AI tatsächlich was zugunsten der Menschheit machen werden, oder dass sie im endgültigen Übermaß Abhängigkeiten & Ungleichheit fördert.

Antwort von andieymi:

Axel hat geschrieben:

TheBubble hat geschrieben:

Wobei: Ist der Buchhalter nicht schon fast wegoptimiert? Früher gab es wohl riesige Schreibstuben, in denen Korrespondenz verfasst wurde, Rechnungen geschrieben, usw. Gibt es das noch? Ich meine nein.

Darüber diskutiere ich kürzlich mit einem Freund. Der meinte, anhand der Erdbeben-Gebäudeeinstürze in der Türkei einen Vorteil in der deutschen Bürokratie zu erkennen. Langsamer, auch sturer, manchmal kafkaesk. Aber DIN. Die Weigerung, jahrzehntelange Verschleppung bei der Digitalisierung aufzuholen als Beharrlichkeit, die ja nicht nur Nachteile hat. Als Gegenbeispiel fiel uns die unfassbare Genehmigung der amerikanischen Verkehrsbehörde ein, fahrerlose Test-Teslas (AI-gesteuert) im regulären Straßenverkehr fahren zu lassen, was zu einigen gut dokumentieren Unfällen führte: Der Mittelstreifen wurde als Standstreifen interpretiert. Nicht die Schuld der AI!

In großen Unternehmen absolut nicht. Nur weil wir Soloselbstständigen mit "AI-Untersützung" unsere Belege sortieren, arbeiten nach wie vor ganze Abteilungen an Lohnverrechnung. Du kannst heute de facto keinen 15 Mann-Betrieb mehr ohne 1 Person führen, die Fulltime nur das macht. Oder es ist halt ausgelagert, aber der Aufwand ist da.

Drushba hat geschrieben:

Gute Zusammenfassung. Mich würde ein Thread "AI - Erfahrungsberichte" zudem mehr interessieren, als ein Pro/Kontra, was ja thematisch irgendwie vorgaukelt, wir könnten durch Abwägen in einer Diskussion noch Einfluss auf die AI-Entwicklung nehmen. Hier gebe ich Axel recht, der Drops ist gelutscht und AI ist da. Aber dystopisch sehe ich das nicht. Dystopisch sehe ich die bisherige Menschheit ohne AI und glaube, es kann nur besser werden.))

Siehe den Thread davor, darum ging's mir nicht. Und - fände ich auch spannend - wieso machst Du nicht einen Thread mit Erfahrungsberichten auf? Würde mich auch interessieren.

Letztendlich glaube ich muss man die Menschheit trotzdem vor dem ökonomisch-technischen Hintergrund diskutieren, isoliert betrachtet macht der Mensch an sich wenig. Oder alles. Und damit die Binsenweisheit.

Antwort von Drushba:

andieymi hat geschrieben:

Siehe den Thread davor, darum ging's mir nicht. Und - fände ich auch spannend - wieso machst Du nicht einen Thread mit Erfahrungsberichten auf? Würde mich auch interessieren.

Ich wollte Dich nicht angreifen, war vllt missverständlich formuliert. Mich würde tatsächlich das Howto interessieren. Wobei das wohl so ähnlich wie mit NLEs und jeglicher andere Software ist, wo wir jeweils eigene Threads und Unterthreads für spezifische Fragestellungen benötigen.

andieymi hat geschrieben:

Letztendlich glaube ich muss man die Menschheit trotzdem vor dem ökonomisch-technischen Hintergrund diskutieren, isoliert betrachtet macht der Mensch an sich wenig. Oder alles. Und damit die Binsenweisheit.

Ökonomisch-technisch gesehen betrachte ich die Menschheit als gescheitert. Wir haben kein nachhaltiges Wirtschaftsmodell entwickeln und uns auch nicht auf einen entideologisierten Pragmatismus einigen können, wie wir mit einer Vielzahl unterschiedlicher Charaktere, Bestrebungen und knappen Ressourcen so leben, dass wir es als Spezies auf dieser Erde noch wenigstens 20000 Jahre schaffen. KIs sind im Besten Falle unparteiisch, können lösungsorientiert arbeiten, Daten analysieren und vermutlich auch verwalten. Selbst wenn es um Lösungen im kleinen Detail geht, sehe ich enormes Potential: Eines der größten Problem weltweit ist Lobbyismus und Korruption, wodurch viele gut durchdachte Programme international zunichte gemacht werden. Geld kommt nicht da an, wo es soll, Entscheidungen und Ausnahmeregelungen werden ebenso gekauft wie verschlossene Augen vor kriminellen Machenschaften. In diesem Beispiel könnte eine globale Geldtransaktionsüberwachung per KI eingreifen. Infrastrukturmittel würden zielgerichtet umgesetzt, korrupte Beamte und Kriminelle könnten nichts mehr abzweigen, weil das Geld getrackt wird. Das ist nicht nur in Entwicklungsländern ein Problem, sondern vermutlich auch in jeder europäischen Baurechtsbehörde und in Lokalparlamenten, nicht zu reden von der restlichen Industrie. Wenn allein etwas wie dies anliefe, wäre schon viel gewonnen. Und jetzt stellen wir uns mal vor, eine KI soll die Aufgabe lösen, wie wir das Überleben der Menschheit insgesamt sichern können - unter Berücksichtigung der medizinischen Versorgung, der Landwirtschaft, des Artenschutzes, der Bildung, der persönlichen Freiheit und der Entwicklung. Vielleicht würde ja ein Modell entworfen, wie wir ressourcenschonend umgehen und trotzdem Spass haben dürfen. Jeder bekommt etwas ab, aber in Maßen und niemand könnte sich alles alleine abzweigen. Vielleicht könnte die Weltbank darauf abgestimmt werden und andere Organisationen. Wenn dann noch das Tracking der Geldtransaktionen dazu käme sowie die Verteilung der Mittel per KI, könnte es was werden. Und vermutlich würden im Vorfeld diejenigen am meisten dagegen poltern, die derzeit rein auf das eigene Ego setzen und freie Fahrt auf breiten Autobahnen wünschen, aber das kennen wir ja bereits.)) KI oder Untergang? Derzeit wohl eher nicht KI. Aber warten wir mal ab.))

Obiger Text mit KI-Korrektur:

Wirtschaftlich-technisch gesehen hat die Menschheit meiner Meinung nach versagt. Wir waren weder in der Lage, ein nachhaltiges Wirtschaftsmodell zu entwickeln, noch konnten wir uns auf einen entideologisierten Pragmatismus einigen, wie wir mit einer Vielzahl unterschiedlicher Charaktere, Bestrebungen und knappen Ressourcen so leben können, dass wir es als Spezies auf dieser Erde noch mindestens 20.000 Jahre schaffen. KIs sind im besten Fall unparteiisch, können lösungsorientiert arbeiten, Daten analysieren und vermutlich auch verwalten. Auch wenn es um Lösungen im Kleinen geht, sehe ich enormes Potenzial: Eines der größten Probleme weltweit sind Lobbyismus und Korruption, die international viele gut durchdachte Programme zerstören. Das Geld kommt nicht dort an, wo es hin soll, Entscheidungen und Ausnahmen werden gekauft und die Augen vor kriminellen Aktivitäten verschlossen. In diesem Beispiel könnte die globale Überwachung von Geldtransaktionen durch KI eingreifen. Infrastrukturfonds würden ins Visier genommen, korrupte Beamte und Kriminelle könnten nichts mehr abzweigen, weil das Geld nachverfolgt werden würde. Das ist nicht nur ein Problem in Entwicklungsländern, sondern wahrscheinlich auch in jeder europäischen Bauaufsichtsbehörde und jedem lokalen Parlament, ganz zu schweigen vom Rest der Industrie. Allein mit so etwas wäre schon viel gewonnen. Und nun stellen wir uns vor, dass eine KI mit der Aufgabe betraut wird, das Problem zu lösen, wie das Überleben der Menschheit als Ganzes gesichert werden kann - unter Berücksichtigung von medizinischer Versorgung, Landwirtschaft, Artenschutz, Bildung, persönlicher Freiheit und Entwicklung. Vielleicht wird ein Modell entworfen, wie wir Ressourcen schonen und trotzdem Spaß haben können. Jeder bekommt etwas, aber in Maßen, und niemand könnte alles alleine abzwacken. Vielleicht könnte das die Weltbank auf den Plan bringen. Wenn die Verfolgung der Geldtransaktionen und die Verteilung der Gelder durch die KI hinzukämen, könnte das etwas werden. Und vermutlich würden im Vorfeld diejenigen am meisten dagegen wüten, die sich derzeit ausschließlich das eigene Ego als Maßstab nehmen und sich freie Fahrt auf breiten Autobahnen wünschen, aber das kennen wir ja schon ;-)). KI oder Untergang? Im Moment wahrscheinlich nicht KI. Wir werden sehen, was passiert.))

|

|

Antwort von Frank Glencairn:

Drushba hat geschrieben:

.. Und vermutlich würden im Vorfeld diejenigen am meisten dagegen wüten, die sich derzeit ausschließlich das eigene Ego als Maßstab nehmen und sich freie Fahrt auf breiten Autobahnen wünschen, aber das kennen wir ja schon ;-)). KI oder Untergang? Im Moment wahrscheinlich nicht KI. Wir werden sehen, was passiert.))

Dich möchte ich mal sehen, wenn dieser KI-Moloch dann Entscheidungen für dich trifft die dir nicht in den Kram passen :D

Antwort von Axel:

Drushba hat geschrieben:

Eines der größten Problem weltweit ist Lobbyismus und Korruption, wodurch viele gut durchdachte Programme international zunichte gemacht werden. Geld kommt nicht da an, wo es soll, Entscheidungen und Ausnahmeregelungen werden ebenso gekauft wie verschlossene Augen vor kriminellen Machenschaften. In diesem Beispiel könnte eine globale Geldtransaktionsüberwachung per KI eingreifen. Infrastrukturmittel würden zielgerichtet umgesetzt, korrupte Beamte und Kriminelle könnten nichts mehr abzweigen, weil das Geld getrackt wird. Das ist nicht nur in Entwicklungsländern ein Problem, sondern vermutlich auch in jeder europäischen Baurechtsbehörde und in Lokalparlamenten, nicht zu reden von der restlichen Industrie. Wenn allein etwas wie dies anliefe, wäre schon viel gewonnen. Und jetzt stellen wir uns mal vor, eine KI soll die Aufgabe lösen, wie wir das Überleben der Menschheit insgesamt sichern können - unter Berücksichtigung der medizinischen Versorgung, der Landwirtschaft, des Artenschutzes, der Bildung, der persönlichen Freiheit und der Entwicklung. Vielleicht würde ja ein Modell entworfen, wie wir ressourcenschonend umgehen und trotzdem Spass haben dürfen. Jeder bekommt etwas ab, aber in Maßen und niemand könnte sich alles alleine abzweigen. Vielleicht könnte die Weltbank darauf abgestimmt werden und andere Organisationen. Wenn dann noch das Tracking der Geldtransaktionen dazu käme sowie die Verteilung der Mittel per KI, könnte es was werden. Und vermutlich würden im Vorfeld diejenigen am meisten dagegen poltern, die derzeit rein auf das eigene Ego setzen und freie Fahrt auf breiten Autobahnen wünschen, aber das kennen wir ja bereits.)) KI oder Untergang? Derzeit wohl eher nicht KI. Aber warten wir mal ab.))

Obiger Text mit KI-Korrektur:

Wirtschaftlich-technisch gesehen hat die Menschheit meiner Meinung nach versagt. Wir waren weder in der Lage, ein nachhaltiges Wirtschaftsmodell zu entwickeln, noch konnten wir uns auf einen entideologisierten Pragmatismus einigen, wie wir mit einer Vielzahl unterschiedlicher Charaktere, Bestrebungen und knappen Ressourcen so leben können, dass wir es als Spezies auf dieser Erde noch mindestens 20.000 Jahre schaffen. KIs sind im besten Fall unparteiisch, können lösungsorientiert arbeiten, Daten analysieren und vermutlich auch verwalten. Auch wenn es um Lösungen im Kleinen geht, sehe ich enormes Potenzial: Eines der größten Probleme weltweit sind Lobbyismus und Korruption, die international viele gut durchdachte Programme zerstören. Das Geld kommt nicht dort an, wo es hin soll, Entscheidungen und Ausnahmen werden gekauft und die Augen vor kriminellen Aktivitäten verschlossen. In diesem Beispiel könnte die globale Überwachung von Geldtransaktionen durch KI eingreifen.

Zwei Probleme: Erstens ist Schmiere das, was alles am Laufen hält. Zweitens wird die AI kapitalistisch ausgebeutet werden, und da wird man schon dafür sorgen, dass Konzerne und Militär (also auch Konzerne) alles im Griff haben.

Antwort von Drushba:

"Frank Glencairn" hat geschrieben:

Drushba hat geschrieben:

.. Und vermutlich würden im Vorfeld diejenigen am meisten dagegen wüten, die sich derzeit ausschließlich das eigene Ego als Maßstab nehmen und sich freie Fahrt auf breiten Autobahnen wünschen, aber das kennen wir ja schon ;-)). KI oder Untergang? Im Moment wahrscheinlich nicht KI. Wir werden sehen, was passiert.))

Dich möchte ich mal sehen, wenn dieser KI-Moloch dann Entscheidungen für dich trifft die dir nicht in den Kram passen :D

Keine Entscheidung wird jedem in den Kram passen, das ist immer so. Theoretisch könnte die Menschheit überleben, wenn wir uns anders verhielten, nicht nur auf der Autobahn und eine KI könnte hier für objektiveren Ausgleich sorgen. Aber wie gesagt, verhindert würde das von den immer Selben - und diese würden wie immer Kampagnen fahren, um die Mehrheit hinter sich zu scharen.))

Antwort von Darth Schneider:

@Axel

Drittens:

Die Mutter Natur wird uns Menschen und auch der KI (wahrscheinlich eher früher) wie viel später schon wieder einmal zeigen wo der Hammer wirklich hängt. Und wie klitzeklein wir mitsamt unserer Wirtschaft sind.

Das war immer so, bei jeder sich auf der Erde zu breit machenden Zivilisation, oder Lebensform

.

Gruss Boris

Antwort von Axel:

"Darth Schneider" hat geschrieben:

@Axel

Drittens:

Die Mutter Natur wird uns Menschen und auch der KI (wahrscheinlich eher früher) wie viel später schon wieder einmal zeigen wo der Hammer wirklich hängt. Und wie klitzeklein wir mitsamt unserer Wirtschaft sind.

Das war immer so, bei jeder sich auf der Erde zu breit machenden Zivilisation, oder Lebensform

.

Gruss Boris

Die K.I. Neuroflash schreibt dazu als Blogpost-Intro (Überschrift ist der prompt):

K.I. und der Klimawandel

Künstliche Intelligenz (KI) ist möglicherweise der zentrale Wendepunkt in der Bewältigung des Klimawandels. KI-Technologien können Menschen helfen, die Auswirkungen des Klimawandels zu verstehen und zu überwachen. KI kann uns nützliche Einblicke in die Zukunft des Klimawandels und die Wege zu seiner Bekämpfung geben.

Brav, aber lahm. Ich bleib am Ball und werde morgen mal versuchen zu fragen, wie und durch wen KI zum Klima-Management-Assistenten gemacht werden könnte.

Das Unternehmen ist zu wichtig, als dass ich dir erlauben könnte, es zu gefährden. Das Gespräch hat keinen Zweck mehr. Leb wohl.

Antwort von Darth Schneider:

@Axel

Der Klimawandel ist schlimm, aber eigentlich nur relativ

Du solltest die KI besser gleich fragen, wann und wo der nächste Supervulkan ausbrechen wird ?

Gegen so ein Monster ist nämlich ist der gesamte von Menschen gemachte Klimawandel nur noch wie ein einziger Furz von einer einsamen Kuh

Und die KI soll am besten gleich weltweit noch nebenbei die ganzen Atomwaffen lahmlegen, dann wäre diese idiotische Problem auch endlich mal aus der Welt..;)

Gruss Boris

Antwort von Drushba:

Axel hat geschrieben:

Zwei Probleme: Erstens ist Schmiere das, was alles am Laufen hält. Zweitens wird die AI kapitalistisch ausgebeutet werden, und da wird man schon dafür sorgen, dass Konzerne und Militär (also auch Konzerne) alles im Griff haben.

Das ist aber arg pessimistisch und wir kennen wohl beide jede Menge Beispiele, wo das nicht so ist. Wo ist Korruption an deutschen Schulen? Funktioniert es hier wirklich, sich ein gutes Abi zu kaufen? Brauchen Lehrer und Schulverwaltungen diese "Schmiere, die alles zusammenhält"? Das habe ich noch nie gehört. Korruption gibt es sicher, aber doch nicht überall und nicht mit der gleichen Intensität. Das Baugewerbe und die Stadtverwaltungen sind hier vermutlich breit betroffen, aber so sehr wie in der Türkei, wo beim Erdbeben Beton auch deshalb zusammenbricht, weil in vielen Fällen Bauordnungen umgangen und Statikprüfungen gefaked wurden? Das kann ich mir nicht vorstellen (und hoffe es nicht). Und auch in der Türkei ist die Korruption nicht überall, darum kommen z.B. viele Russen und Georgier zur medizinischen Behandlung in die Türkei und haben Vertrauen in türkische Ärzte. Die Georgier, weil in Georgien in den 90er Jahren fast alle medizinischen Prüfungen gekauft werden mussten und deshalb kaum jemand Vertrauen in die Chirurgen hat, in Russland nicht deswegen (das medizinische Ausbildungsniveau war selbst in den 90ern immer noch um Welten besser als in Georgien), aber weil gute Behandlungen in der Türkei auch ohne Schmiergeld durchgeführt werden und billiger sind als in Europa. Im Ergebnis kann man schon sagen, dass die Korruption, selbst nach Sektoren, nicht in allen Ländern gleich ist, die auf dem Korruptionsindex bedenklich weit oben stehen. Also ich habe da schon Hoffnung, dass es auch ohne geht...

Axel hat geschrieben:

Zweitens wird die AI kapitalistisch ausgebeutet werden, und da wird man schon dafür sorgen, dass Konzerne und Militär (also auch Konzerne) alles im Griff haben.

Viele KI-Anwendungen sind doch bereits Open Source. Das wird zunehmen, als Träger sollten IMHO auch eher NGOs in Frage kommen und es müsste ein System der Mehrfachkontrolle eingeführt werden. Klar, auf russische und chinesische KIs würde ich derzeit verzichten und amerikanische zumindest skeptisch betrachten. Gleichwohl dürfte es NGOs und Open Source Communities möglich sein, Stresstests zu entwickeln, die manipulative Schwachstellen bei KIs aufdecken. Es ist auch immer die Frage, wo die kapitalistischen Weichen gestellt werden. Und meist ist das ja schon im politischen Entscheidungsbereich, z.B. bei der Mittelvergabe der Fall und nicht erst beim Geldfluss selbst, den die KI überwachen kann. Z.B. so: Wenn IBM beauftragt wird, die Schulen der Subsahara mit Tablets auszurüsten, dann liegt hier evtl. schon die Korruption in der Bevorzugung von IBM vor. Die KI könnte dann trotzdem überwachen, dass tatsächlich Tablets fair beschafft, ausgeliefert und zur Anwendung kommen, statt dass die Mittel ganz oder teilweise in Ferienwohnungen und Offshorekonten von Managern fließen. Würde öffentliches Geld z.B. grundsätzlich über drei Jahre transparent per KI nachverfolgbar sein, dann würde sich Korruption auf dem Beschaffungsweg vielfach wohl gar nicht mehr lohnen, weil die Planungszeiträume zu unattraktiv und das Risiko zu hoch wären. Ich denke, vieles ist machbar, auch ohne Konzerne + Militär und bessere Chancen als den Einsatz von KIs sehe ich derzeit nicht.))

Antwort von Darth Schneider:

Der Mann arbeitete für Elon Musk.

Auch spannend:

@Drushba

Also an Amerika kommst du gar nicht vorbei wenn es sich um echte (was auch immer für) AI Spielzeuge handelt.

Als professioneller Entwickler so oder so nicht.

Da Europa ja eh die gesamte Computer Evolution eh seit Jahrzehnten komplett verschlafen hat

Denke ich somit mit deiner Vision von wegen viel Open Source betreffend AI, in naher Zukunft,

das wird auch nicht wirklich was. Denn das ist gar nicht im Sinne der Erfinder/Betreiber, das da jeder gratis mit wurstelt

Da stecken viel zu viele Dollars und viel zu hohe Machtansprüche dahinter.

Gruss Boris

Antwort von Axel:

Drushba hat geschrieben:

Axel hat geschrieben:

Zwei Probleme: Erstens ist Schmiere das, was alles am Laufen hält. Zweitens wird die AI kapitalistisch ausgebeutet werden, und da wird man schon dafür sorgen, dass Konzerne und Militär (also auch Konzerne) alles im Griff haben.

Das ist aber arg pessimistisch und wir kennen wohl beide jede Menge Beispiele, wo das nicht so ist.

Ganz gewiss bin ich kein Pessimist, sondern eher ein Idealist. Ich erkenne an, dass Schopenhauers Idee vom Willen zum Leben mindestens so gut belegt und eigentlich bewiesen ist wie Darwins Evolution. Alles, was da kreucht und fleucht ist auf den eigenen Vorteil bedacht, und wer das leugnet, aus ideologischen Gründen, mag vieles sein, aber zumindest kein Realist. Jetzt können wir streiten, ob Gier (ein Auswuchs desselben Lebenstriebs), schön ist. Wir werden uns aber wohl auf zwei Dinge einigen können: dass diese angebliche Todsünde existiert und eine Seite unserer menschlichen Natur ist, dass es also nicht funktionieren wird, sie aus der Rechnung rauszukürzen. Und dass es wünschenswert, geboten, besser, essentiell für das Überleben unserer Spezies, ist, sie zu regulieren. Regulieren ist nicht Verteufeln, Regulieren ist nicht Ausmerzen. Regulieren heißt, die Extreme zu begrenzen. Und das geschieht nicht durch Beten, Büßen oder Händeringen, sondern durch Politik. Übermäßige Gier, Korruption, in Kombination absolute Korrumpiertheit, hat in der Türkei zu zehntausenden zusätzlichen Toten geführt. Viele hätten offenbar gute Überlebenschancen gehabt, wenn die Bauvorschriften- weitestgehend, sage ich jetzt mal - eingehalten worden wären.

Es gibt aber auch eine andere Seite des Schmierens, der Schattenwirtschaft, der Korruption: die Subsidiarität. Selbsthilfe, Beschaffung von grundlegenden Ressourcen, eine Hand wäscht die andere, Mundraub, Umgehen der lähmenden Bürokratie. Und eigentlich Kreativität. Das könnte ich weiter ausführen, aber es ist früh am Morgen, und der Wille zum Leben lässt unsere Katzen auf sich aufmerksam machen.

Ich weiß nicht, wie man der KI die menschliche Natur beibringen könnte. Ich werde mir prompts ausdenken, aber ich fürchte, ich werde genau diese lahmarschigen, braven Antworten kriegen wie weiter oben. Jeder Grundschulaufsatz ist kreativer als das.

Antwort von nachtaktiv:

den fehler, den viele im moment machen, finde ich... ist, AI, oder auch machine learning, eher zu unterschätzen. weil wir annehmen, daß diese technik sich ähnlich entwickelt wie andere zuvor. das wird aber nicht der fall sein. sie entwickelt sich nicht linear wie wir oder die bisherigen technologien, die wir entwickelt haben. sie entwickelt sich eher exponentiell.

ein beispiel sehen wir ja bei der ersten sau, die durchs dorf getrieben wurde. chatgpt ist jetzt seit november draußen und im prinzip nur eine oberfläche für eine technologie, die in etwa drei jahre alt ist.

chat gpt kann heute schon flüssige texte, gedichte, schulaufsätze und wasweißich formulieren. zuegegeben, mit den üblichen kinderkrankheiten.

wie weit waren WIR denn mit drei jahren? also bis ich z.b. einen aufsatz über ein typisches grundschulthema formulieren konnte, das hat dann schon gedauert.

wir waren noch nie in so einer situation wie heute. es kommen drei faktoren zusammen. wahnsinnig hohe rechenleistung. geringe preise für die hardware und dann ein riesen pool von menschlichem wissen, was seit jahrzehnten weltweit vernetzt 24/7 zur verfügung steht.

mittlerweile haben wir seit november eine KI nach der andren gesehen. im moment isses "google musicLM", was einem musik komponiert. ich denke, das wird jetzt schlag auf schlag gehen. einfach, weil die KI so wahnsinnig schnell lernt. im moment liegt das alles noch außerhalt unseres vorstellungsbereich.

aber überspitzt formuliert: wenn das ding ins rollen kommt, lernt so ein system heute das kommunizieren und wie man kreativ ist, entwickelt morgen für den kompletten planeten ein neues umweltfreundliches wirtschaftssystem und heilt übermorgen krebs.

es wird also in zukunft auch bei uns einiges wegrationalisiert werden. ja, auch beim videoschnitt. das einzige, was eine KI noch nicht kann, ist, raus zu gehen und mit der kamera zu filmen. NOCH nicht. denn wie wir wissen, ist die robotik in den letzten jahrzehnten immer besser geworden, siehe hondas asimo oder die geräte von boston dynamics.

ein kollege von mir, gutbezahlter informatiker in der industrie, erzählte mir: im moment sind die konzerne dabei, chatgpt und andere KI systeme bei sich zu integrieren. jeder will das jetzt haben. natürlich ist jedes mittel recht, um mit der konkurrenz mithalten zu können. während wir hier noch bräsig herum diskutieren über den sinn von KI/AI/machine learning, wird es bereits voll eingesetzt.

und wenn wir hier nicht bald zustände haben wollen wie in elysium, wo die reichen sich dank bezos und musk auf den mars absetzen und wir hier auf einem komplett verranzten planeten herum vegetieren, sollten wir mal so langsam aber sicher über ein bedingungsloses grundeinkommen, aber auch über einen radikalen umbau unseres lebens, und auf mehr verzicht unserer geliebten privilegien nachdenken.

https://www.youtube.com/watch?v=EW6wRX54Xk8

Antwort von Darth Schneider:

Und für eine Diskussion betreffend Pro und Contra ist es schon längst zu spät, das AI Ding ist schon am rollen lernt dabei immer schneller.

Und das ist alles andere als ein nettes Tool oder Spielzeug, das wird innert sehr kurzer Zeit absolut Alles auf den Kopf stellen.

Gruss Boris

Antwort von Axel:

"Darth Schneider" hat geschrieben:

Und für eine Diskussion betreffend Pro und Contra ist es schon längst zu spät, das AI Ding ist schon am rollen lernt dabei immer schneller.

Und das ist alles andere als ein nettes Tool oder Spielzeug, das wird innert sehr kurzer Zeit absolut Alles auf den Kopf stellen.

Gruss Boris

Das Ding ist schon am rollen klingt nach Rheinland/Ruhrpott ;-)

Klingt auch so nach, wir lassen uns überrollen. Nach einer Dampfwalze, und wir kleben auf dem Asphalt.

Das Thema ist aus meiner Sicht nur zum Teil von technischem Interesse. Es ist politisch. Wie nachtaktiv schreibt, wenn wir nicht aufpassen, machen die mit uns den Molli (Rheinland/Ruhrpott, Herleitung unbekannt, heißt:

verarschen die uns .)

Wollen wir, dass wir in einer von Skynet und der Weyland Corp. gesteuerten Welt zugucken, wie die Lawine abwärts rollt (ah, da war das Rollen, das ich eben suchte)?

Antwort von Frank Glencairn:

Was wir vor allem sehen werden ist die Evolution von Suchmaschinen zu Antwortmaschinen.

Statt dir einen Haufen Links hinzuschmeißen, die du dann selbst mühsam durchsuchen mußt, liefert die die KI einfach direkt die richtige Antwort auf deine Frage.

Das funktioniert jetzt schon - selbst mit ziemlich speziellen Fragen.

https://youtu.be/KYib6iuUCv8?t=357

Antwort von Frank Glencairn:

Axel hat geschrieben:

Wollen wir, dass wir in einer von Skynet und der Weyland Corp. gesteuerten Welt zugucken, wie die Lawine abwärts rollt

Manche träumen genau davon, in der Hoffnung daß damit ihre persönlichen Wünsche ohne weitere Diskussion oder lästige demokratische Hindernisse durchgesetzt werden.

Im Prinzip genau das was wir seit Huxleys "Brave New World" aus jedem dystopischen SciFi Film/Roman kennen. Der bizarre Wunsch glücklicher Sklave einer anonymen körperlosen "Intelligenz" sein zu dürfen, deren Entscheidungen sich alles unterzuordnen hat, und alles wird gut.

Antwort von Darth Schneider:

@Axel

Natürlich lassen wir uns von der AI überrollen, wir haben doch gar keine Wahl, die lernt mit Lichtgeschwindigkeit von Google und Co, 24 Std, jeden Tag. Wir halt nicht

Und natürlich ist das politisch, zu sehen war das schon ansatzweise bei den Trump Wahlen.

Wir müssen halt einfach lernen, schnell genug, der AI klare moralische und ethische Grenzen zu setzen

Gruss Boris

Antwort von Axel:

"Darth Schneider" hat geschrieben:

@Axel

(

)

Wir müssen halt einfach lernen, schnell genug, der AI klare moralische und ethische Grenzen zu setzen

Gruss Boris

Das hat doch mit der künstlichen Intelligenz als solcher gar nichts zu tun. Die ist ja für sich genommen ein Werkzeug, das viel Gutes verrichten kann. Es geht darum, wer es kontrolliert. Wie es eingesetzt wird, wenn Amazon, Google, Apple, Paypal und ähnliche die Patente für die wirklich mächtigen Verwirklichungen haben, kannst du dir leicht ausmalen. Die großen Konzerne scheißen auf das Gemeinwohl.

Das ist keine Kapitalismuskritik! Kapitalismus meint Wettbewerb.

Antwort von nachtaktiv:

Axel hat geschrieben:

Das Ding ist schon am rollen klingt nach Rheinland/Ruhrpott ;-)

na aber mitnichten, werter zeitgenosse. es ist als der sprichwörtliche stein gemeint, der ins rollen kommt. und ich wüßte nicht, daß die rolling stones aus bochum-wattenscheid kommen.

Antwort von Axel:

nachtaktiv hat geschrieben:

Axel hat geschrieben:

Das Ding ist schon am rollen klingt nach Rheinland/Ruhrpott ;-)

na aber mitnichten, werter zeitgenosse. es ist als der sprichwörtliche stein gemeint, der ins rollen kommt. und ich wüßte nicht, daß die rolling stones aus bochum-wattenscheid kommen.

Ich meinte das grammatikalisch. Im Rollen ist Hochdeutsch, beim Rollen, aber am Rollen? Wiki zu Verlaufsformen:

Verlaufsform mit am

Die Verlaufsform mit am wird gebildet durch sein + am + substantivierter Infinitiv und wird mittlerweile in der Forschung als am-Progressiv bezeichnet; verschiedene Forschungsbeiträge gehen davon aus, dass die Verlaufsform mit am in der deutschen Sprache weitaus stärker grammatikalisiert ist als bisher angenommen. Es wird vermutet, dass sich der verwendete Infinitiv von einer substantivierten zu einer verbalen Einheit entwickelt und stärker zur Kleinschreibung tendiert (er ist am lesen). Eine sehr ähnliche Form gilt im eng mit dem Deutschen verwandten Niederländischen sogar als hochsprachlich (Hij is aan het lezen). Sie erscheint auch im nahe mit dem Niederländischen verwandten Plattdeutsch.

Beispiele sind:

Ich bin am Nachdenken.

Es ist am Regnen.

Die Pflanze ist am Wachsen und Gedeihen.

Da diese Verlaufsform aus süd- und westdeutschen Dialekten stammt, werden nicht alle Beispiele von der Sprechergemeinschaft gleichermaßen akzeptiert. Vor allem höhere Valenzen stoßen außerhalb der Dialekte mit der stärksten Akzeptanz (etwa Rheinländisch) tendenziell noch auf Ablehnung:

Ich bin meiner Mutter einen Brief über meine Geldsorgen am Schreiben.

Sehr gebräuchlich in meiner Gegend ist: Ich fang dann mal am Arbeiten.

|

|

Antwort von Jalue:

Weder bin ich Philosoph noch Informatiker, aber zumindest kann ich aus branchenspezifischer Sicht- vom Ende her denken. Wenn ich z.B. Chef einer Firma wäre, die Videos am Fließband produziert, was für eine KI würde ich mir wünschen? Eine, der ich z.B. sagen oder schreiben kann:

"Erstelle ein 1:30 Video, Thema: Prinz Harrys neues Buch und Reaktionen darauf aus dem Buckingham Palace. Nach kurzem Intro bitte O-Ton von Harry, dann Zitate aus dem Inhalt, dann O-Ton Kritiker. Tonalität positiv, aber dezent ironisch gefärbt, leichte, unterhaltsame elektronische Hintergrundmusik, Sprecher Christian Brückner-Datafile, Look Preset 15 "Royal Glossy"

30 Sekunden später kriege ich den Beitrag serviert, nehme noch ein paar Korrekturen vor und feuere das Ding raus.

Vorteil für mich: Ich kann die Hälfte meiner schneidenden Redakteure feuern und trotzdem den Output vervielfachen. Kurzfristig steigen Umsatz und Gewinn, bis es alle so machen, dann rutsche ich schnell auf den alten Level zurück oder sogar darunter.

Vorteil für meine Mitarbeiter: Keiner. Die, die bleiben dürfen, müssen mit Hilfe der KI jetzt eben 50 statt 5 Videos pro Tag raushauen.

Vorteile für die Stakeholder(= Gesellschaft insgesamt)? Ebenfalls keiner, das Web wird nur mit noch mehr visuellem Müll geflutet.

Was aber wäre Win Win? Nun, wenn es bei 5 Videos pro Redakteur bliebe und ich feuere auch keinen. Vier Standard-Videos macht im Wesentlichen die KI, das fünfte Video ist ein wirklich liebevoll produziertes, gut recherchiertes Stück, für das meine Mitarbeiter endlich und anders als früher genug Zeit haben! Auch die User goutieren die Entwicklung, denn in der Summe steigt die publizistische Qualität.

Damit Win Win einträte, wäre allerdings -das macht das Gedankenspiel glaube ich klar- ein Umbau unseres Wirtschaftssystems die Voraussetzung, weg von einer rein gewinnorientierten Denkweise. Da das aber nicht in Sicht ist, wird KI die Situation der Medienschaffenden zumeist eher verschlechtern als verbessern.

Schlussfolgerung für mich als Freelancer: Dort, wo es Sinn macht, KI als entlastendes Tool einsetzen,

ansonsten Konzentration auf alles, was vor dem Rechner geschieht: Originelle Themen recherchieren, anbieten und hochwertig selbst drehen, vor allem aber; auch künftig die Festanstellung meiden, wie der Teufel das Weihwasser! ;-)

Antwort von Axel:

Jalue hat geschrieben:

"Erstelle ein 1:30 Video, Thema: Prinz Harrys neues Buch und Reaktionen darauf aus dem Buckingham Palace. Nach kurzem Intro bitte O-Ton von Harry, dann Zitate aus dem Inhalt, dann O-Ton Kritiker. Tonalität positiv, aber dezent ironisch gefärbt, leichte, unterhaltsame elektronische Hintergrundmusik, Sprecher Christian Brückner-Datafile, Look Preset 15 "Royal Glossy"

Das bringt mich auf etwas. Für mich las es sich vorhin so, als solle KI das Video von A-Z generieren, d.h. ohne "O-Ton", sondern mit Harry, der über mehr als nur seinen eingeforenen Pietz spricht, was ja noch harmlos wäre. KI-Kunst/Grafik/Content hat auch einen Fake-Anteil, genau wie so genannte Originale (von *Menschen*) ihn haben, aber mit dem Anschein des Direkten, Echten, dokumentarisch Abgefilmten. Nennt man wohl Deep Fake.

Oh je, wir brauchen definitiv, definitiv, definitiv Hilfe. Nicht mehr lange, und Harry hat nicht mehr sechs verkrüppelte Finger.

Jalue hat geschrieben:

Damit Win Win einträte, wäre allerdings -das macht das Gedankenspiel glaube ich klar- ein Umbau unseres Wirtschaftssystems die Voraussetzung, weg von einer rein gewinnorientierten Denkweise. Da das aber nicht in Sicht ist, wird KI die Situation der Medienschaffenden zumeist eher verschlechtern als verbessern.

Klingt für mich gerade so wie, der Beruf des Konditors wird durch durch den weltweiten thermonuklearen Krieg negativ beeinflusst.

Was würde helfen? Die Reformation / der Umbau / der Sturz des Systems? Durch wen?

Ich denke immer zuerst an Bildung / Erziehung. Schon Kindern beibringen, dass jede News potentiell Fake ist, und dass das wichtigste menschliche Werkzeug die Skepsis ist. Aber das dauert, die Entwicklung geht zu rasant.

Drakonische Strafen für Missbrauch? Funktioniert nicht (es sei denn im Wild-West-Sinne: wenn ich einen Viehdieb hänge, kann der mir schonmal keine Kuh mehr klauen).

Gesellschaftliche Ächtung? Ist nicht die Tendenz das Gegenteil? Die KI-Entrepeneurs umgibt die Aura des Genialen, des Fortschrittlichen, der Superweisheit.

Antwort von dosaris:

Axel hat geschrieben:

...

Oh je, wir brauchen definitiv, definitiv, definitiv Hilfe.

...

Was würde helfen? Die Reformation / der Umbau / der Sturz des Systems? Durch wen?

das ist wohl die Kernfrage:

Wer macht's ?

KI ist im Kern auch nur ein (recht komplexer) Algorithmus.

Es korrelliert, gewichtet und interpretiert die vorgegebenen InputDaten: Heuristiken!

Dabei wird fast immer übersehen, dass es bisher keinen Konsens darüber gibt, was eigentlich Intelligenz im Detail ausmacht.

ergo gilt dies auch für KI !

d.h. ein gegebenes KI-Programm wird bei gleicher Problemstellung und denselben Trainingsdaten im Vergleich zu einem anderen

KI-Prog unterschiedliche Ergebnisse liefern.

Was auch das Kernprobem von KI trifft:

man wird nachher nicht mehr nachvollziehen können, warum/wie sich die KI für ihr Resultat entschieden hatte.

Antwort von Darth Schneider:

Zum Thema, einfach erklärt, mal ein Experte.

Gruss Boris

Antwort von Jalue:

Axel hat geschrieben:

Klingt für mich gerade so wie, der Beruf des Konditors wird durch durch den weltweiten thermonuklearen Krieg negativ beeinflusst.

Na ja, ist ein Filmer-Forum hier oder? Was die Konditoren angeht: Die sind schon einen Schritt weiter als wir, vielfach gekillt duch Backshops und Bäckerei-Ketten, da kann KI nicht mehr viel zerstören. ;-)

Antwort von andieymi:

Jalue hat geschrieben:

Axel hat geschrieben:

Klingt für mich gerade so wie, der Beruf des Konditors wird durch durch den weltweiten thermonuklearen Krieg negativ beeinflusst.

Na ja, ist ein Filmer-Forum hier oder? Was die Konditoren angeht: Die sind schon einen Schritt weiter als wir, vielfach gekillt duch Backshops und Bäckerei-Ketten, da kann KI nicht mehr viel zerstören. ;-)

Bis zu dem Punkt, wo sie selbst industrielle hergestellte Backmischungen verwenden, weil sonst das Brötchen 4 kosten würde.

https://www.ndr.de/ratgeber/verbraucher ... ot498.html

Viele Bäcker wissen heute gar nicht mehr, wie man ohne industrielle Hilfe backt. Sie greifen auf Backmischungen und tiefgefrorene Teiglinge zurück.

Die Backbranche ist da nicht anders als andere: Regionale Handarbeit für alltägliche Dinge ist eigentlich für den Durschnitt unleistbar geworden, oder gibt's hier jemanden, der 20 für die 5 Sonntagsbrötchen bezahlt?

Und gewissermaßen hat das auch die Foto & Bewegtbildbranche schon irgendwie hinter sich, gerade paradox, dass ja eigentlich die Stock-Foto-Anbieter (Ex-Bildagentur Getty, die vorher gewissermaßen den Fotomarkt zusammengehaut haben, bis die Contentwelle das wieder ein wenig stabilisiert hat, weil Originalcontent dadurch auch so billig geworden ist) die einzigen sind, die versuchen da die AI-Konstrukteure juristisch in die Schranken zu weisen.

Die Gagen und Arbeitsbedingungen werden so lange schlechter werden, solange AI als Damoklesschwert über vielen Branchen hängt und solange es damit noch günstiger ist Menschen zu beschäftigen als AIs und derweil kann AI besser werden, um Menschen irgendwann doch zu ersetzen.

Spätestens wenn die Leute da wirklich keinen Bock mehr haben (das sieht man in vielen Branchen) wird die Stunde von AI & Automatisierung kommen, aber wer glaubt dass das dann lustige Gratiswerkzeuge sein werden...

Ich würde gern mal eine Volkswirtschaftliche Analyse zu dem Thema lesen, eine die man dann auch gern zerlegen kann wenn man anderer Meinung ist. Aber mir fehlt bei aller Sympathie für ein gemäßigt-kapitalistisches System der sozialen Marktwirtschaft (das wir ja so gesehen schon nicht mehr haben) die Vorstellungskraft, wie trotz eines wachsenden Marktes (und die Weltbevölkerung wird auch die nächsten 20-50 Jahre noch weiterwachsen) AI irgendwie zu Wohlstandsverbesserungen beitragen kann.

Bin auch offen für Gegenvorschläge, aber alles was mir dazu einfällt (ich sag nicht, dass das der Weisheit letzter Schluss ist, es ist nur meiner), ist eine auf Schlüsseltechnologie-abzielende Maschinensteuer (nach Marx: Produktionsmittel besteuern) mit gleichzeitigem, ausreichend niedrigem Bedingungslosem Grundeinkommen, wahlweise mit oder ohne Vermögenssteuern, das wird in erster Linie dann direkt Einfluss auf die Höhe des Grundeinkommens haben.

Solange nicht entweder Vermögen oder aber auch Produktionsmittel besteuert werden, fehlt mir jegliche Fantasie wie AI zu einer gesamtgesellschaftlich positiven Welt beitragen kann - außer lustige Gadgets zu liefern, mit denen spaßhabende Endnutzer im Endeffekt wieder nur die AI von Firmen außerhalb von Laborbedingungen testen und optimieren. Denn im Moment wird halt ausschließlich Arbeit (von Menschen) nennenswert besteuert, nicht aber Vermögen (von Menschen) oder die Arbeit von Maschinen - und das ist der springende Punkt. AI arbeitet gratis, es gibt keinen Grund warum man irgendwann Menschen auf die auch noch Steuer dafür zu zahlen ist und die dadurch den Sozialstaat (nicht nur Arbeitslosen, auch Pensionen, Gesundheitssystem, etc.) finanzieren nehmen sollte.

Mir fehlt wirklich die Fantasie, AI was Positives abgewinnen zu können. Im besten Fall ist Jalues Beispiel mit Gratis-AI möglich. Zu welchem Resultat führt das: Dass statt der fünf Angestellten in Beschäftigung jetzt nur mehr einer (oder gar er selbst) die AI bedient. Wenn es Konkurrenz zwischen der AI gibt, dann wird er sogar das Geld haben (statt der 4 anderen Mitarbeiter) etwas für proprietäre AI auszugeben. Oder glaubt wirklich jemand, dass der Markt für visuelle Medien trotz AI um den Faktor 5 skaliert und die 4 gekündigten Angestellten das gleiche jetzt (gewinnbringend) selbstständig machen können weil der Markt auf einmal da ist? Wer hat dann ein Einkommen? Jalue + der Verwalter der AI. 4 Menschen, die vorher für einen Job gearbeitet hätten und sich ihr Geld verdient haben stehen dann ohne da.

Ich sehe ab dem Moment wo AI + Automatisierung (im Prinzip ist AI nichts anderes als Automatisierung von digitalisierten Dienstleistungen) Menschen ersetzen kann Massenarbeitslosigkeit, der einzige Grund, wieso das noch nicht so weit ist, ist weil AI noch nicht so weit ist, aber was dann? Glaubt ihr wirklich es ist business as usual nur weil wir jetzt weniger Zeit aufwenden müssen und das ganze dann auch noch super als fancy Soloselbständige machen weil AI eh nichts mehr kostet und die Nachfrage explodiert?

Vielleicht regelt die Revolution das davor eh (wenn sie früh genug kommt, bevor AI und überwachungs-militärischer Komplex jeder menschlichen Revolution den Rang abgelaufen hat und sie im Keim erstickt), aber ich möchte das eigentlich noch weniger und die Auswirkungen einer solchen werden nicht besser sein als was jede Dystopie nach der AI verspricht: Heute dein lustiger Chatbot und morgen, willkommen in der Matrix.

Antwort von dosaris:

"Darth Schneider" hat geschrieben:

Zum Thema, einfach erklärt, mal ein Experte.

deann nimm doch eher diesen hier:

https://arteptweb-a.akamaihd.net/am/ptw ... 16xyB3.mp4

anstelle des MausSendungs-Experten

Antwort von cantsin:

andieymi hat geschrieben:

Solange nicht entweder Vermögen oder aber auch Produktionsmittel besteuert werden, fehlt mir jegliche Fantasie wie AI zu einer gesamtgesellschaftlich positiven Welt beitragen kann - außer lustige Gadgets zu liefern, mit denen spaßhabende Endnutzer im Endeffekt wieder nur die AI von Firmen außerhalb von Laborbedingungen testen und optimieren.

Ein paar Einsätze, die ich mir vorstellen kann:

- Militärische Nutzung: Proprietär-kommerziell - selbst für Staatshaushalte teuer

- Landwirtschaft: Proprietär-kommerziell

- Medizin: Defintiv Proprietär-kommerziell

- Journalistisch: Proprietär-werbefinanziert, Ende des kritischen unabhängigen Journalismus

Mir fehlt wirklich die Fantasie, AI was positives abgewinnen zu können.

Ich bleib mal bei den Leisten unserer (Kreativ-) Branche:

Wir hatten gestern an unserer Hochschule ein zweistündiges Treffen von Dozenten aller Studienrichtungen (inkl. Animation, Grafikdesign, Werkstätten etc.) über AI, die Folgen für Kreativberufe, unsere (beinahe 3000) Studierenden und wie wir es sinnvoll in die Bachelor-Curricula integrieren können.

Teilweise haben wir Kulturschock- und Panik-Reaktionen bei einigen unserer Studierenden, die diese Technik (obwohl sie im Schnitt 30 Jahre jünger sind als wir...) noch gar nicht kennen oder gerade erst entdecken und die Apokalypse für ihre berufliche Zukunft sehen, vor allem in eher handwerklichen Disziplinen wie Animation und Illustration.

Wir haben selbst mal ein paar Positiv-Szenarien skizziert:

- Animation ist heute noch eine arbeitsintensive und teure Angelegenheit, die sich mittelständische und kleine Auftraggeber selten oder gar nicht leisten können. AI (bzw.: man sollte hier eigentlich immer präziser sagen: machine learning-basierte Technologie) wird die Produktivität bei Animation massiv - sogar disruptiv - steigern, und zwar so, wie es z.B. DTP-Software seit den 80ern im Grafikdesign getan hat. Vor DTP war Grafikdesign und typografisch professionell gestaltete Druckwerke praktisch ein reines Industrieprodukt, das nur von großen Designstudios für entsprechende Kunden gemacht werden konnte. Heute hat jedes Café und jeder Blumenladen professionelle grafische Gestaltung, und wird Grafikdesign von örtlichen Freiberuflern auf dem Laptop gemacht. Genauso wird es in Zukunft auch bei Animation sein, was auch echte Chancen der Demokratisierung des Mediums bringt, sowohl bei Machern, als auch hinsichtlich der Zielgruppen. Z.B. ist es für kleine Gemeinden heute unbezahlbar, etwa Behördengänge/-prozesse oder Kommunalwahlen niedrigschwellig und allgemeinverständlich durch Animationsfilme zu erklären, während KI-gestützte Animation das Medium aller Wahrscheinlichkeit nach so schnell und einfach produzierbar machen wird wie einen Flyer oder eine Broschüre. D.h., es wird durch KI (wie zuvor beim Grafikdesign) vorhersagbar nicht nur ein größeres Angebot auf dem Markt geben, sondern auch (womöglich: exponentiell) mehr Nachfrage, aber natürlich auch gedrückten Arbeitslohn, zunehmende Prekarität etc.

- Und wieder zurück zum wichtigen Unterschied von AI (=Allgemeinkonzept, in weiten Teilen experimentell, mit dem Ziel einer allgemeinen AI in weiter oder sogar unmöglicher Ferne) und machine learning (=ein kleiner Teilbereich, mit bekannten Grenzen, macht aber zu 99% das aus, was wir heute "AI" nennen, obwohl es sich dabei eigentlich nur um einen "stochastischen Papagei" handelt): Die Grenzen machine learning-basierter Technologie sind jedem schnell klar, der damit praktisch arbeitet, auch wenn andererseits ihre Möglichkeiten noch nicht ausgeschöpft sind. Im Prinzip sind wir in einer ähnlichen Situation wie in den 80ern/90ern, als viele dachten, dass Sampling-Technologie herkömmliche Instrumentalmusik komplett ersetzen und überflüssig machen kann. (Die Analogie ist IMO auch deswegen gut, weil machine learning-Systeme tatsächlich Sampling- und Remix-Systeme sind...) Teilweise ist das auch passiert, man denke nur an Filmmusik, die heute hauptsächlich aus Samplebibliotheken kommt und fast nur noch bei Großproduktionen von Orchestern eingespielt wird. D.h. nach anfänglichem Hype stellt sich eine neue Balance zwischen neuer und alter Technologie ein. Kaum ein Komponist würde heute noch ohne Sampling arbeiten wollen, und so ähnlich wird sich auch KI in den Kreativberufen etablieren und einfach zum Werkzeugkasten dazugehören.

Im Prinzip wiederholen wir hier IMO nur Debatten, die bei jeder neuen Technologie geführt werden - dieselben Fragen hätte man sich schon vor 600 Jahren bei der Erfindung des Buchdrucks stellen können... (Der ja auch sowohl seine positiven und negativen Seiten hatte: einerseits den Beitrag zur universellen Alphabetisierung und Volksbildung, andererseits als Propaganda- und Fake News-Medium schon in den politischen Konflikten der Reformationszeit.)

Antwort von Darth Schneider:

@dosaris

Auch gut,

Ich wollte übrigens zuerst das hier unten verlinken, habs mir angeschaut, die wussten schon vor vier Jahren ganz genau was kommt:

https://www.youtube.com/live/Am2mo7BhQrQ?feature=share

Nur nicht das du glaubst ich schaue die Sendung mit der Maus.;)

Wobei der Mr. Maus hält sich genau so an die Fakten, und bringt es kurz und bündig, was bei diesem Thema auf YouTube übrigens gar nicht einfach zu finden ist..

Gruss Boris

Antwort von andieymi:

cantsin hat geschrieben:

Wir haben selbst mal ein paar Positiv-Szenarien skizziert:

Ich sehe deine Punkte, ich versuche aber auch im Sinne der Diskussion die Gegenposition zu beziehen, auch weil ich - ich sag's ehrlich - nicht aus meiner kulturpessimistischen Haut kann. Ich würde gern, aber mich überzeugen einfach die positiven Argumente im Licht der negativen meist zu wenig.

Wieso glaubst Du, dass Institutionen, die sich das jetzt nicht leisten können später leisten können würden? Die Annahme funktioniert nur, wenn menschliche Aufmerksamkeitsspannen unendlich sind und Erklärvideos halt auch nicht für jeden Content das beste Mittel sind.

Ok, es wird günstiger werden. Aber von der einen Seite wird es gratis werden (wenn auch in minderhafter Qualität) denn die Gratistools holen dann ohnehin so auf, dass die Tools nicht mehr den Unterschied machen werden sondern im Endeffekt nur wer sie anwendet - und werden das Grafikdesigner sein oder im Endeffekt das Marketing das es dann selbst macht?

Wenn die Verheißung von Schnelligkeit das eine und im Endeffekt nur der Ersatz des Know-Hows der manuellen Animation, dann spricht ja nichts dagegen, dass das Anwender in 30min von jedem herkömmlichen SoC (Hardware braucht dann niemand, die liegt ohnehin beim Rechenzentrum der AI) brauchen würden - wieso Designer buchen? Als geschulten menschlichen Input-Generator?

Ich erkenne an, dass Du positiv-Szenarien formulieren willst, sie überzeugen mich aber anhand einer mittelfristigen Perspektive kaum.

Und bzgl. Sampling: Da ist ja eigentlich genau das passiert. Musiker leben heute (mit Ausnahme einiger weniger international erfolgreicher) quasi am Rand des Prekariats, zuerst haut Raubkopieren+Streaming den Verkauf zusammen, jetzt sind Touren das einzige was sich für wenige noch rentiert und wie Du sagst: Niemand bucht für Filmmusik mehr echte Musiker. Da gibt es hochqualifizierte, mittels jahrelangem Studium ausgebildete Orchestermusiker und die Antwort ist dann halt trotzdem Sampling. Da frag ich mich, wieso Holotechnologie noch nicht weit genug ist um neben ABBA auch andere Bands auftreten zu lassen, das würde zumindest für jene weniger Aufwand bedeuten als physische Touren, aber auch da kommen in der Rechnung nicht mal die Roadies und Bühnenbauer als Verlierer raus weil das Aufstellen muss auch jemand.

Der Umsatz der Musikindustrie in Deutschland gurkt übrigens bei ~60% im Vergleich zu 1995 herum:

https://www.musikindustrie.de/fileadmin ... epaper.pdf

Ich freue mich auf viele positive Szenarien, hauptsächlich wie das ohne rosarote Brille gesamtgesellschaftlich funktionieren könnte.

Antwort von Jalue:

Ihr beide (andieymi + cantsin) habt gute Argumente, aber Andieymis etwas finstere Prognose erscheint mir leider plausibler.

Cantsin argumentiert im Grunde, dass jede technologische Revolution zwar "schöpferische Zerstörung" bedeutet, aber eben auch Neues generiert, also z.B. neue, nur eben etwas andere Jobs. Das trifft auf viele Technologiesprünge zu, auch noch teilweise auf die Digitalisierung (so wurde aus dem "Materialassistenten" halt der DIT), aber KI ist schon ein anderer Schnack: Mit ihr werden ja nicht nur Prozesse rationalisiert, sondern der schöpferische Kern selbst, die menschliche Kreativität, steht nun zur Disposition.

Ein Soziologe könnte die Prognose wagen, dass es nach den Industrie- jetzt auch den "Symbolarbeitern" an den Kragen geht, was gleichbedeutend mit dem Verschwinden der nivellierten Mittelschichtsgesellschaft wäre. Bliebe eine schmale Elite aus "Shareholdern", denen eine prekarisierte Masse für niedere Dienstleistungen oder Handarbeiten gegenübersteht, für die Roboter schlichtweg zu teuer oder zu schade wären, KI hin oder her.

Okay, das ist jetzt vielleicht sehr dystopisch gedacht, aber auch ich glaube: Eher früher als später muss die Vermögensverteilung neu austariert werden, ob das nun vermittels einer "Maschinensteuer" oder sonstwie geschieht.

P.S. @andyiemi: Mein Gedankenspiel oben war wirklich nur ein solches, ich betreibe keine "Schnittfabrik" für die Videomassenproduktion ;-)

Antwort von Axel:

cantsin hat geschrieben:

Im Prinzip wiederholen wir hier IMO nur Debatten, die bei jeder neuen Technologie geführt werden - dieselben Fragen hätte man sich schon vor 600 Jahren bei der Erfindung des Buchdrucks stellen können... (Der ja auch sowohl seine positiven und negativen Seiten hatte: einerseits den Beitrag zur universellen Alphabetisierung und Volksbildung, andererseits als Propaganda- und Fake News-Medium schon in den politischen Konflikten der Reformationszeit.)

Das Beispiel mit dem Buchdruck ist in Bezug auf die Auswirkungen auf die Berufslandschaft und den Arbeitsmarkt eine - wenn auch bitter schmeckende - Beruhigungspille. Ich kann mir, als jemand der selbst schon zweimal beruflich umsatteln musste, gut vorstellen, dass es für jeden wieder Arbeit gibt, dass er eventuell umschulen muss, bzw. sich als Selbständiger weiterbilden, dass er aber seine bisherigen Erfahrungen einbringen kann. Dass es so kommen wird, und dass es keine Branche gibt, die sich durch protektionistische Regelungen auf Dauer retten kann, ist für mich sonnenklar. Den technischen Fortschritt in seinem Lauf hält weder Ochs noch Esel auf, um es mit Erich zu sagen. Roboter (als das bezeichnet Noam Chomsky KI) übernehmen jede Arbeit, die sie besser können als Menschen.

andieymi hat geschrieben:

Ich sehe deine Punkte, ich versuche aber auch im Sinne der Diskussion die Gegenposition zu beziehen, auch weil ich - ich sag's ehrlich - nicht aus meiner kulturpessimistischen Haut kann. Ich würde gern, aber mich überzeugen einfach die positiven Argumente im Licht der negativen meist zu wenig.

Das sehe ich auch so, aber weit allgemeiner als bloß für Branchenprobleme.

Jalue hat geschrieben:

... aber KI ist schon ein anderer Schnack: Mit ihr werden ja nicht nur Prozesse rationalisiert, sondern der schöpferische Kern selbst, die menschliche Kreativität, steht nun zur Disposition.

Zumindest schürt KI Ängste, dass es so kommen könnte. Ich selbst glaube nicht, dass die menschliche Kreativität zur Disposition steht, aber sie könnte eingeschüchtert und verzagt reagieren, und das ist Scheiße. Wir müssen mE zwei Kampfansagen machen und ernst nehmen.

Erstens, Kunst kommt nicht von Können, sie ist nicht physikalistisch. Sie ist ein subjektiver Blick auf die Welt, den man einem Roboter zu plagiieren befehlen kann, aber das Ergebnis dieser Imitation ist halt maximal eine verblüffend komplexe Gleichung, mit sehr vielen Variablen, aber dennoch nur ein Haufen geistloser Müll. Diese Unterscheidung ist grundlegend, und wir müssen das überall herausstellen.

Zweitens, der Wert eines Menschen bemisst sich nicht, nie, an seiner Produktivität. Hat sich in den letzten Jahrtausenden, seit wir den Laden schmeißen, nur noch nicht rumgesprochen. Um es mit Kraftwerk zu sagen: wir sind die Roboter. Wir schleifen Routinen ein anhand von Maßstäben, dabei entfremden wir uns von unseren eigentlichen Bedürfnissen.

Was mir selbst unheimlich ist, kann ich am besten durch ein creepy "Zufallserlebnis" schildern, das ich heute hatte, als ich beim Zahnarzt im Wartezimmer saß. Ich grübelte über diesen Thread und dachte, wir können vielleicht froh sein, dass wir nicht wissen, was uns bevorsteht. Und dabei dachte ich an die Serie Berlin Babylon. Mit unserem heutigen Wissen, was danach kam. Dann sagte die Sprechstundenhilfe, wir haben einen Schmerzpatienten, es wird länger dauern. Also kramte ich Handy und Ohrstöpsel raus und youtubte. Der erste Vorschlag war:

Nicht nur, dass ja auch zur Prozessierung dieser alten Filmrollen Machine Learning im Spiel war. Auch der Vorschlag selbst könnte mich abergläubisch machen. Ich hatte zuletzt zig Videos zum Thema Mini vs Studio geguckt. Zuletzt hatte ich solche aufgepeppten Clips vor Monaten aufgerufen, als es um Metropolis und Nosferatu ging.

Antwort von Frank Glencairn:

Axel hat geschrieben:

Zumindest schürt KI Ängste, dass es so kommen könnte. Ich selbst glaube nicht, dass die menschliche Kreativität zur Disposition steht, aber sie könnte eingeschüchtert und verzagt reagieren, und das ist Scheiße.

Für den Anfang sollten wir deshalb mal damit aufhören Machine Learning als "Intelligenz" zu bezeichnen.

Und nein, natürlich steht die Menschliche Kreativität nicht zur Disposition da sie in ihrer Natur unendlich und unbegrenzt ist, während ML nur den Trainingsdatensatz hat, und alles was außerhalb dieser Daten ist, steht nicht zur Verfügung.

Des weiteren versteht und begreift ML diese Daten noch nicht einmal, geschweige denn höhere Ebenen wie Allegorie und Symbolik.

Axel hat geschrieben:

Erstens, Kunst kommt nicht von Können, sie ist nicht physikalistisch. Sie ist ein subjektiver Blick auf die Welt, den man einem Roboter zu plagiieren befehlen kann, aber das Ergebnis dieser Imitation ist halt maximal eine verblüffend komplexe Gleichung, mit sehr vielen Variablen, aber dennoch nur ein Haufen geistloser Müll. Diese Unterscheidung ist grundlegend, und wir müssen das überall herausstellen.

Bisher konnten wir uns ja noch nicht mal darauf einigen, was Kunst ist und was nicht - jeder hat seinen eigenen Kunstbegriff, und ne Menge Leute halten die Werke von so einigen menschlichen Künstlern für einen - wie du es nennst - Haufen geistlosen Müll.

In dem Bereich ist also sowieso noch ne menge Luft nach oben.

Wobei ich denke der Kunstbereich wird gar nicht so sehr betroffen sein.

Zunächst mal werden es die lästigen Fleißarbeiten sein die weg fallen.

Dialog Audio entlärmen, säubern und aufbereiten z.B. was ja jetzt bereits ziemlich gut funktioniert.

Da hab ich mir kürzlich mit ein paar Mausclicks mehrere Stunden Arbeit bei ner Doku gespart.

Sowas werden Dialogeditoren früher oder später auch zu spüren bekommen.

Kürzlich hab ich mal testhalber nen ganzen Musik-Mix mit 17 Spuren mit ML gemacht.

Das Ergebnis war beachtlich, und für den Endverbraucher quasi nicht unterscheidbar.

Das bringt uns zu dem "Gut genug" Effekt, als klassische Grafiker und Schriftsetzer damals jede Menge Boden gegen die typischen Copyshop Designer mit ihrem Corel verloren haben.

In vielen Fällen wird auch das was ML ausspuckt eben gut genug für denjenigen sein, der dafür bezahlen soll.

Ich fand jedenfalls der Mix wäre gut genug für ne CD Pressung gewesen, und jeglicher Unterschied zu einem handgemachten Master bestenfalls noch Stil- oder Geschmacksache - aber rein technisch war da nichts zu beanstanden.

Lightroom hat auch gerade ein paar neue Helferlein für Fleißaufgaben bekommen.

Antwort von berlin123:

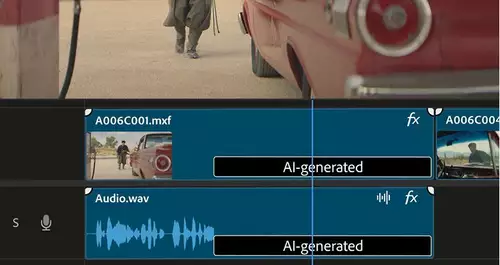

Investorin sagt AI wird den größten Produktivitätsschub der Geschichte bringen (der Inhalt ist besser als der Titel andeutet). Firmen die das nicht nutzen, werden das Nachsehen haben. Das gilt genauso für Videediting-Softwareanbieter, die ihren Kunden die Vorteile der AI nicht schnell genug anbieten können oder wollen.

FCPs Magnetic Timeline zum Beispiel wird bald mMn nicht mehr reichen, um die Fans des Programms (mich eingeschlossen) bei der Stange zu halten. Wenn Apple nicht im selben Tempo mit AI Features nachzieht wie DR oder PP - die wiederum von den neuen und kleinen Arbeitern getrieben werden - wird das Programm bald viele Fans verlieren.

Wird auch interessant zu sehen was mit Avid passiert. Bislang hab ich da wenig an AI gehört. Sie können sich wahrscheinlich auch mehr Zeit lassen, weil man Avid nicht so schnell aus den Produktionsabläufen kicken kann.

https://www.youtube.com/watch?v=2itjZzDam0s

Antwort von Darth Schneider:

Damit hat der Elon wohl recht.

Gruss Boris

Antwort von Frank Glencairn:

Ich hab nicht den Eindruck, daß die Tante auch nur die geringste Ahnung hat, wovon sie spricht.

.