Echte Stimmen klonen

Viele weitere Anwendungsgebiete ergeben sich dadurch, dass schon vorhandene Stimmen in überraschend guter Qualität (zum Beispiel auch Akzente) geklont werden können. Die geklonte Stimme kann einen beliebigen Text sprechen oder alternativ auch Gesprochenes aus einer anderen Stimme konvertieren:

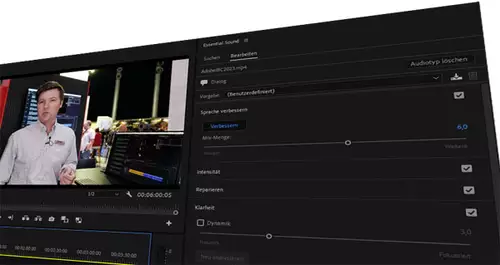

Für Filmemacher bieten sich dadurch interessante Möglichkeiten. So lassen sich nachträgliche Stimmaufnahmen - zum Beispiel zum Dubbing oder zur Korrektur von Versprechern beim Dreh - im Studio machen, ohne dass die Schauspieler vor Ort sein müssten. Da allerdings bisher keine besondere Berechtigung nötig ist, kann im Prinzip jede beliebige Stimme, von der man etwas Audiomaterial hat, simuliert werden, was natürlich schon zu einem kleinen Skandal geführt hat.

Der Missbrauch ist nicht weit

Denn User der berüchtigten Internetplattform 4chan haben Elvenlabs Sprach-AI dazu genutzt, Audiofakes mit den Stimmen von bekannten Persönlichkeiten zu produzieren. So zirkulieren unter anderem Clips, in welchen die Schauspielerin Emma Watson einen Auszug aus Adolf Hitlers "Mein Kampf" liest und der amerikanische Präsident Joe Biden ankündigt, Truppen in die Ukraine zu schicken - zum Teil auch noch per DeepFake als Video einigermaßen realistisch animiert.

Hier eine Demo dieser Fähigkeit, Stimmen zu klonen:

Dieser - wenig überraschende - Missbrauch der Technik hat dazu geführt, dass Elvenlabs den bisher anonymen kostenlosen Zugang jetzt beschränkt hat. Zwar gibt es noch die Möglichkeit, kostenlos Sprechersamples zu generieren (mit bis zu 10.000 Zeichen pro Monat), aber User müssen sich davor samt Kreditkarteninformationen registrieren, um nicht mehr ganz so anonym wie bisher zu sein und können nur noch vorgefertigte Stimmen verwenden. Zudem ist die Voice Lab Funktion, mit deren Hilfe beliebige Stimmen nachgeahmt werden können, nurmehr im bezahlpflichtigen Dienst zugänglich. Überlegt wird auch, in Zukunft das Klonen von Stimmen nur noch anhand eines speziellen, extra einzusprechenden Textes zu erlauben, also nicht mehr über x-beliebige Samples.

ElevenLabs versieht ferner jeden Audioclip mit einem Wasserzeichen, um ihn bei Missbrauch zu dem User zurückzuverfolgen, welcher ihn generiert hat und diesen zu sperren. Auch soll demnächst ein Tool veröffentlicht werden, mit dessen Hilfe geprüft werden kann, ob ein Audioclip einer Stimme mit mittels der Elvenlab Technologie erstellt wurde.

Es wird sich zeigen, ob diese Schutzmaßnahmen ausreichen, um Missbrauch zu vermeiden. Allerdings gibt auch noch weitere Sprach-KIs, die sich nicht diese Beschränkungen auferlegen. Es ist also nur eine Frage der Zeit, bis zum nächsten Skandal mit einer Fakestimme.

Individueller gefährlicher sind Stimmfakes aber im privaten Bereich, wo die Möglichkeiten durch die neue Technologie auf noch größtenteils ahnungslose Menschen trifft, welche nicht vorbereitet sind auf täuschend echt gefälschte Stimmen.

Da wenige Sekunden Audiomaterial reichen, um eine Stimme realistisch nachzuahmen (heutzutage leicht in Videos in den sozialen Netzwerken zu finden), könnten AudioFakes bald allgegenwärtig sein, etwa in Form eines Liebesgeständnisses, das jemandem in den Mund gelegt wird, oder Hasstiraden, falschen Aussagen uä. Noch realistischere Enkeltricks mit der Originalstimme oder andere Betrügereien sind ohne viel Phantasie denkbar. Die Stimme hat damit als untrügliches Authentifizierungsmerkmal ausgedient - erst recht im Zusammenspiel mit per ChatGPT (bzw. einer zukünftig noch besseren Text-KI) in Echtzeit erzeugten Dialogtexten.