Wie in den letzten Jahren üblich nützt Adobe die IBC zur Vorstellung neuer Funktionen in den Creative Cloud Applikationen für Video und Audio. Wir führen die wichtigsten Neuerungen auf, die Adobe in einer Pressevorstellung im Vorfeld der IBC 2017 im Schnelldurchlauf präsentierte.

Premiere Pro

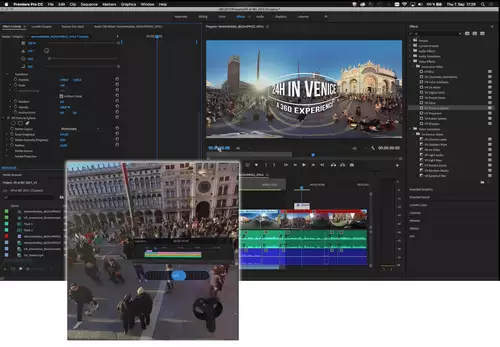

Die auffälligsten Neuerungen fanden im Bereich des VR/360Grad-Editings statt. So gibt es nicht nur neue Tools um Ausrichtung/Entzerrung oder spezielle Filter in einer sphärischen Umgebung korrekt zu berechnen. Es wurde auch eine neue Headmount-Preview-Möglichkeit implementiert, mit der man unter einem VR-Helm seinen Schnitt zur Vorschau betrachten kann. Der VR-Controller dient dabei zur Steuerung der Timeline (die auch vereinfacht in die VR-Umgebung als Overlay eingeblendet werden kann).

So muss der Helm beim Editing weniger oft abgenommen werden. Hinzu kommen Tools um Sounds im VR-Raum zu platzieren (Schlagwort Ambisonic Audio) sowie spezielle Effekte und Übergänge für den VR-Schnitt. Gerade in virtuellen Umgebungen sind Transitions wegen der Simulatorkrankheit ja eine kniffelige Sache, weshalb wir besonders gespannt sind was Adobe hier konkret für die Praxis anbieten wird.

Kleine Neuerungen für einen schnelleren Workflow finden sich in den Templates. So können diese nun eine feste Intro- und Outtro-Länge besitzen. Kürzt oder verlängert man diese Templates auf der Timeline, so bleiben Ein- und Ausblenden unangetastet, sprich gleich lang. Ähnlich können auch Rahmen im Titler an einen Textlänge gekoppelt sein, damit eine veränderte Schriftlänge nicht über den Rahmen hinausschießt. (Adobe nennt dies in Anlehnung an Webtechnologien Responsive Design in Motion Graphics).

Um solche Templates zu nutzen (die After Effects erstellt wurden) muss in der kommenden Premiere Version AFX nicht mehr auf dem Rechner installiert sein denn die AFX-Engine selber ist nun auch in Premiere vorhanden. Dazu finden sich nun auch Motion Graphics Templates in der Adobe Stock Library und können aller Voraussicht nach dort auch von Anwendern zum Kauf angeboten werden. Nebenbei erwähnt: Adobe verweist mit Stolz darauf, dass sich mittlerweile über 90 Millionen Assets (Video, Bilder, Illustrationen und Vektorgrafiken) in der hauseigenen Stock-Library befinden. Diese wird zur Monetarisierung auch immer tiefer in die Applikationen verzahnt.

Weiters lassen sich nun mehrere Projekte gleichzeitig öffnen um zwischen diesen leichter Assets oder Timeline-Elemente auszutauschen. Für gemeinschaftliches Arbeiten lassen sich Projekte locken (sozusagen Read-Only schalten). Und die Versionsverwaltung wurde deutlich komplexer und erinnert nun mehr an GitHub, weil es nun ebenfalls ein Check- und Check-Out Verfahren gibt.

Als weitere kleinere Neuerungen wurde gezeigt wie sich Lücken in der Timeline in einer Clipauswahl schließen lassen (oder mit Platzhaltern eben offen gelassen werden können) oder wie Workspaces mit einem Doppelklick auf den Ursprungszustand zurückgesetzt werden können.

After Effects

Die große Neuerung in After Effects schimpft sich Data-Driven Animation. Hierbei können JSON-formatierte Datensätze als Input für After Effects Kompositionen genutzt werden. Diese können dann Textinhalte, Balkengrößen sowie praktisch jede animierbare Element dynamisch verändern. Infografiken lassen hiermit ebenso leicht aktuell halten, wie der aktuelle Wetterbericht im Hotelfernsehen. Auch bewegte Chart-Grafiken können hiermit deutlich vereinfacht erstellt werden. Im Zusammenspiel mit Templates dürften sich hier interessante, neue Vermarktungsmöglichkeiten für Motion-Designer ergeben.

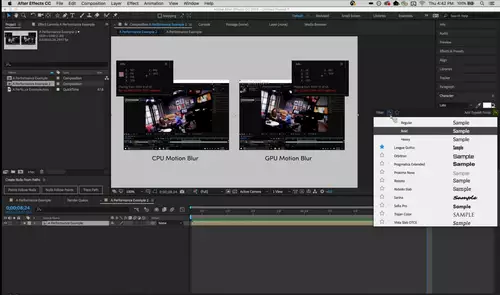

Auch die interne Beschleunigung wurde weiter vorangetrieben: So sind nun auch einige Blurs sowie die Transform Layers GPU-beschleunigt. Für Entwickler dürfte interessant sein, dass After Effects nun auch die beschleunigten Effekte aus dem Premiere Mercury GPU SDK unterstützt. Es ist also zu erwarten, dass hieraus letztlich eine gemeinsame GPU-Engine für Premiere und After Effects erwachsen wird.

Waschechte Typographen dürfen sich noch darüber freuen, dass die Type-Engine von After Effects stark überarbeitet wurde. So gibt es nun schon bei der Font-Auswahl eine Vorschau im Stil der Schrift und es werden (hört, hört) erstmals Ligaturen korrekt unterstützt, was für eine deutlich edlere Anmutung im Satzbild sorgen kann.

Audition

Das Killerfeature in Audition ist diesmal Auto-Ducking, also das automatische ausblenden von Musik wenn auf einem anderen Track eine Sprecherstimme zu Wort kommt. Soetwas gab es zwar schon zu Super8-Zeiten mit analoger Technik im Heimschnitt zu bestaunen, aber nun sorgt Adobes künstliche Intelligenz Sensei für das gefühlvolle herunter- und herauffahren der Musikuntermalung. Nach dem KI-Vorschlag kann man natürlich noch selber mit Keyframes von Hand nachbessern.

Gut gefallen haben uns die neuen symmetrischen Fades, die gleichzeitig an Clipbeginn und Ende wirken sowie die Timecode-Overlay Möglichkeiten im Videovorschau-Fenster bei einer Synchronisation in Audition.

Stolz ist Adobe auch auf die verbesserte Performance der Audition-Oberfläche, auf der sich beispielsweise nun Clips auch während des Abspielens herumschieben lassen.

Character Animator

Tja und das heimliche Steckenpferd Charakter Animator hat es nun geschafft. Mit der Vorstellung auf der IBC entwächst das Programm nach einer gefühlten Ewigkeit seinem Beta-Status und erhält die stolze, finale Versionsnummer 1.0. Tatsächlich wirkte die Präsentation erstaunlich rund. Während man mit dem Gesicht vor der Kamera in erster Linie die Mimik und die Lippenbewegungen kontrolliert lassen sich über frei definierbare Tasten oder selbst definierte Maus-Buttons Formen in der animierten Figur umschalten. Wem hier die Tasten ausgehen, der darf jetzt sogar Midi-Controller anschließen und frei belegen.

Zum Feintuning der Lippensynchonisation gibt es nun die lang geforderte Wellenformdarstellung in der Timeline. Was uns jedoch am meisten reizt ist die nun vorhandene Integration von Collusion Physics womit sich Objekte gegenseitig mit einfachen physikalischen Gesetzen beeinflussen können