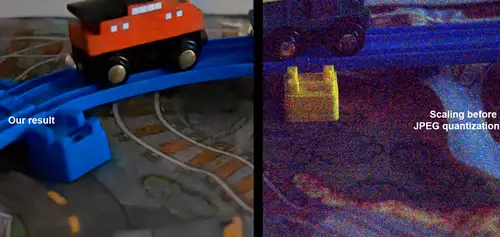

Tja, ein weiteres cooles Betätigungsfeld für KI-Algorithmen in der Bildbearbeitung scheint die RAW-Entwicklung von Low-Light-Aufnahmen zu werden. Schon bisher gab es funktionierende Denoising-Ansätze mit Autoencodern, jedoch geht der nun in einem Projekt vorgestellte Ansatz noch einmal deutlich weiter. Zur Veranschaulichung vielleicht erst einmal das zugehörige Video:

Der Trick bleibt mal wieder faszinierend einfach: Das Netz bekommt kurz belichtete RAW-Aufnahmen und lernt daraus Aufnahmen abzuleiten, die aus Lerndaten durch lange Belichtung des selben Motivs entstanden sind. Gelernt wird dabei mit einer ziemlich normalen Convolution-Topologie. Die Projektdaten liegen zum selber ausprobieren auf GitHub. Das Netzwerk arbeitet direkt mit rohen Sensordaten und ersetzt einen Großteil der traditionellen Bildverarbeitungspipeline, die laut den den Autoren bei extremen Low-Light-Verhältnissen sowieso nur schlecht funktioniert.

// Top-News auf einen Blick:

- ByteDance Vidi2 produziert selbstständig fertige Videos aus Rohmaterial

- Blackmagic DaVinci Resolve 20.3 bringt Support für 32K-Workflows und mehr

- Bis zu 1.000 Euro sparen: Cashbacks auf Kameras von Sony, Nikon, Canon und Panasonic

- Sony und slashCam verlosen eine FX2 Cinema Line Kamera

- DJI Neo 2: Verbesserte Mini-Drohne für Solo-Creator und Einsteiger

- Blackmagic PYXIS 12K - Sensor-Test - Rolling Shutter und Dynamik

Wenn man sieht um wie viel besser mit dieser Methode nochmal die Aufnahmen einer Low-Light Spezialistin wie der A7SII werden, darf man schon staunen.