Lightricks hat mit LTX Video eine neue Video-KI samt Quellcode vorgestellt, die schon auf Heim-PCs mit einer starken Grafikkarte wie einer Nvidia 4090 läuft und das erste Open Source Video-Modell ist, welches in Echtzeit Videosclips generieren kann. Das nur 2 Milliarden Parameter umfassende Video-Modell generiert per Image-to-Video oder Text-to-Video 5 Sekunden Video mit einer Auflösung von 768x512 Pixeln mit 24 Bildern pro Sekunde in nur 4 Sekunden, also sogar etwas schneller als in Echtzeit. Voraussetzung für diese Geschwindigkeit ist allerdings eine Nvidia H100 GPU; per Nvidia 4090 dauert die Generierung aber immerhin auch nur 20 Sekunden.

LTX Video ist als Preview samt ComfyUI-Integration auf Hugging Face, GitHub und Fal.ai verfügbar und kann heruntergeladen bzw. online ab sofort von jedermann ausprobiert werden. Mindestvoraussetzung dafür sind 12 GB VRAM. Auf einer Nvidia 3060 dauert ein Clip ungefähr 80 Sekunden. Die offene, aber akademische Lizenz für die Preview-Version schließt aktuell noch die kommerzielle Nutzung aus, die finale Version dagegen soll sowohl für die private wie auch kommerzielle Nutzung kostenlos sein.

(1/13) Weve been working on something special ✨

LTX Studio (@LTXStudio) November 22, 2024

Introducing LTX Video, Lightricks new open-source, community-driven model for video generation. Create breathtaking videos in moments, blazing past traditional playback speedsthis is LTX Video.

Learn more below. pic.twitter.com/HWSVvT8P77

Geschwindigkeit vs. Qualität

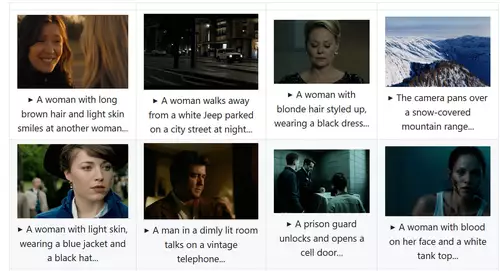

Die hohe Geschwindigkeit von LTX Video ist allerdings erkauft durch eine Verringerung der Parameteranzahl des KI-Modells, was oft zu suboptimalen Ergebnissen führt. Auf GitHub gibt es auch eine Reihe von recht gut aussehenden Democlips, die allerdings stark vorausgewählt zu sein scheinen - User berichten online von teilweise bizarren Ergebnissen bei ihren selbst generierten Clips. Die Qualität scheint auch stark vom gewählten Motiv/Prompt abzuhängen - besondere Probleme bereiten anscheinend komplizierte Bewegungen wie beim Kämpfen oder Tanzen. Bessere Ergebnisse als per Text-Prompt scheint das Image-to-Video Modell zu erzeugen.

LTX test pic.twitter.com/3GkfUYNrHW

ρŁ𝐀𝔰Mʘ (@plasm0) November 24, 2024

// Top-News auf einen Blick:

- Neue Gerüchte: Nvidia soll die GPU-Produktion 2026 um 30-40% runterfahren

- Adobe Firefly bekommt Upscaling per Topaz, Editing per Prompt und mehr

- Leak: Samsungs plant SATA-Aus - Kommt der Preisschock auch bei SSDs?

- Kompaktkameras wieder im Trend - trotz Smartphones

- Von Mickey Mouse bis Darth Vader - Disney lizenziert seine Figuren an OpenAIs Sora

- Sony A7 V in der Praxis: Mix aus Sony A1 und FX3 zum halben Preis?

"Something Yellow"

ρŁ𝐀𝔰Mʘ (@plasm0) November 25, 2024

an LTX masterpiece pic.twitter.com/YYqCOAVnT4

Andere freie Video-KIs wie PyramidFlow, CogVideoX oder Genmo Mochi 1 scheinen eine deutlich bessere Qualität aufzuweisen, sind aber deutlich langsamer. Wer also kostenlos auf seinem PC Videos generieren will, hat jetzt die Wahl zwischen mehreren höherqualitativen Video-KIs und LTX Video, dessen extrem schnelle Generierungszeit allerdings viele Versuche statt nur einem in der gleichen Zeit ermöglicht. Das finale Modell könnte natürlich auch noch einmal verbessert werden.

LTX Studio

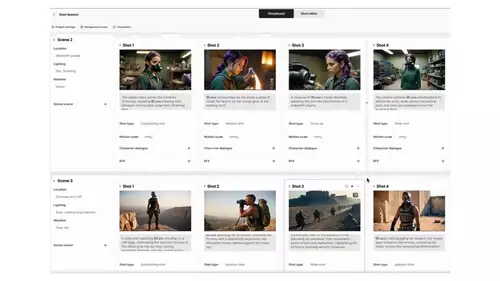

Wir hatten bereits letzten März über das von Lightricks entwickelte LTX Studio berichtet, eine erste umfassende, browserbasierte Lösung fürs Filmemachen per KI, welche unter einer Oberfläche sämtliche Funktionalität zur KI-Filmerstellung bietet, angefangen mit der Storyentwicklung über die (Pre-)Produktion bis hin zur Nachbearbeitung. Hierfür integriert LTX Studio KI-Tools für Storyentwicklung, Storyboarding, Casting (in diesen Zusammenhang ist damit eine konsistente Charaktergeneration gemeint), Soundeffekte, Voiceover, Re-Lighting, Betitelung und automatischen Schnitt sowie natürlich - als Basis - die Generierung von Videos.

LTX Studio nutzt für die verschiedenen Funktionen eine Mischung aus Open Source Modellen, lizenzierten Diensten von Drittanbietern sowie eigene Technologien und ist seit August öffentlich zugänglich. Bisher ähnelten die per LTX Studio erzeugten KI-Videos mit ihren maximal 4 Sekunden langen bewegten Bildern eher einer animierten Diashow als echtem Video und sie wiesen auch noch arge Morphingartefakte auf. Das soll sich ändern, sobald die finale Version von LTX Video in LTX Studio integriert wird.