Wie rasant die Entwicklung im Bereich KIs voranschreitet, zeigt sich u.a. gerade im Feld "Text-to-Music", also von KIs, welche per Textbeschreibung beliebige Musik generieren: hatte Google gerade noch MusicLM vorgestellt, folgt nun wenige Tage später AudioLDM eines Forscherteams der University of Surrey und des Imperial College. Ein auch für Filmemacher sehr vielversprechendes Projekt, denn es synthetisiert nicht nur Musikstücke samt Instrumenten per Textprompt, sondern auch Geräusche (SFX aka Sound Effects). So kann AudioLDM auf Wunsch auch ganze Geräuschkulissen, ideal für die Sounduntermalung von Filmen, produzieren.

Zudem will das Team von AudioLDM das Programm samt Modell per Open Source online stellen, was hieße, dass es nicht nur frei auf dem eigenen Computer genutzt, sondern auch verbessert und in andere Programme eingebunden werden könnte. So könnte es zum Beispiel in Form eines Plugins in Videoschnittprogrammen wie Adobe Premiere oder Blackmagics DaVinci Resolve zur Generierung von Soundkulissen genutzt werden. Für die Nutzung zuhause spricht auch, dass AudioLDM sehr effizient sein soll (d.h. dass es relativ wenig Rechenleistung erfordert) und das Training - zum Beispiel mit eigenen Soundbeispielen - mittels nur einer GPU (wie zum Beispiel einer NVIDIA RTX 3090) erfolgen kann.

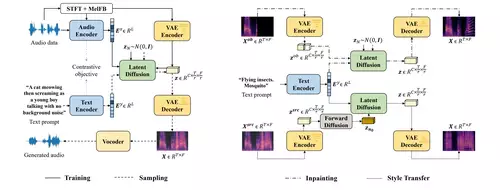

Zudem beherrscht AudioLDM praktische Funktionen, welche schon von den Bild-KIs her bekannt sind, wie InPainting (ein Teil einer Audioaufnahme wird passend zum Rest per Textprompt durch einen anderen Sound ersetzt), Styletransfer (eine Melodie wird von einem anderen Instrument gespielt) oder Super Resolution (d.h. bei einer Audioaufnahme von Musik oder Sprache mit geringer Samplingauflösung, wird die Auflösung und damit die Audioqualität per Upsampling erhöht).

Hier ein Beispiel für Styletransfer: Trompete zu Kindergesang

Neben der Beschreibung der Töne, die generiert werden sollen, lassen sich auch noch andere Parameter eingeben, welche den Sound beeinflussen, wie etwa die Art der akustischen Umgebung (Hall), welche Art Objekte die Töne machen sollen (etwa das Material, z.B. Holz, Blech) sowie die zeitliche Reihenfolge.

Der Klang einer Dampfmaschine:

Fleisch auf einem Holztisch schneiden:

Für komplexere Geräuschkulissen greifen die Forscher auf die Hilfe der Text-KI ChatGPT zurück, welche zum Beispiel auf den Prompt "Beschreibe den Sound des Weltalls" mit einer ausführlichen Beschreibung antwortet ("Radioemissionen von Sternen, Planeten, Galaxien und anderen Himmelskörpern, High Fidelity, sowie die Geräusche von Sonnenwinden und kosmischer Strahlung"), welche dann als Prompt für MusicLDM verwendet werden kann und folgnden Output generiert:

// Top-News auf einen Blick:

- Blackmagic DaVinci Resolve 20 Beta 2 bringt neue Funktionen und Bugfixes

- Blackmagic Camera for Android 2.1 bringt neue Features

- Neuer superschneller PoX Flash-Speicher könnte DRAM und SSDs ersetzen

- Achtung: Verpixelte Videos können wieder kenntlich gemacht werden

- KI-generierte Fake-Trailer: Wie Hollywood an der Irreführung der Zuschauer ...

- Beleuchtung für Foto und Video lernen mit kostenlosem Tool von Google

Eigentlich sollte der Quellcode schon zusammen mit der Forschungsarbeit am Montag veröffentlicht werden, das Team hat jedoch aufgrund der gerade angekündigten Urheberrechtsklagen gegen mehrere Bild-KIs jetzt noch davon abgesehen, das Modell (also das Ergebnis des Trainingsprozesses) online zu stellen. Denn zum Training wurde u.a. die bekannte BBC SFX Bibliothek verwendet, welche zwar zum nichtkommerziellen Gebrauch frei verwendet werden darf. Aufgrund der noch ungeklärten Rechtslage ist allerdings nicht klar, ob das auch für das Training von KIs gilt. Nach Klärung soll der Code aber samt Modell veröffentlicht werden.

Beispiele von Musikgenerierung:

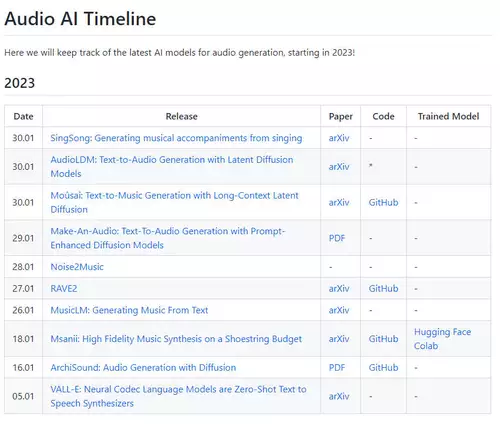

Weitere Audio KI Projekte - Video-to-Audio

Wie rasant gerade die Entwicklung im Bereich Audio-KIs voranschreitet, demonstriert die folgende

Innerhalb weniger Tage wurden gleiche mehrere Text-to-Audio KIs ganz unterschiedlicher Qualität wie etwa

Noise-to-Music und Moûsai: Text-to-Audio with Long-Context Latent Diffusion veröffentlicht. Besonders erwähnenswert erscheint uns auch das chinesische Make-An-Audio: Text-To-Audio Generation with Prompt-Enhanced Diffusion Models Projekt, denn es ermöglicht neben Audio-to-audio auch Image-to-Audio und Video-to-Audio, d.h. es werden Sounds passend zu einem Videoclip produziert.

Hier etwa generiert "Make-An-Audio" automatisch(!) zum Videoclip eines vorbeifahrenden Zuges (Video oben) den entsprechende Sound (Audioclip darunter):