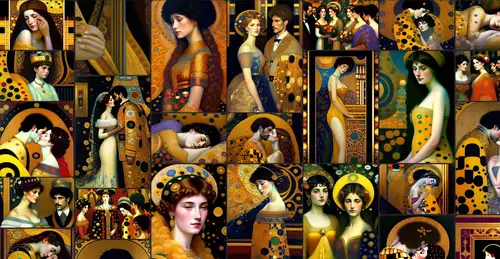

Wir haben ja schon immer mal wieder über der Photo Style Transfer mit neuronalen Netzen berichtet, der schon länger ein Steckenpferd der KI-Forscher im Bereich Deep Learning ist. Nun ist ein aktuelles Paper veröffentlicht worden, dass noch einmal signifikante Fortschritte zeigt.

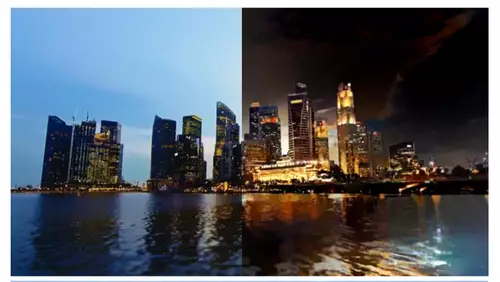

Gegenüber bisherigen Arbeiten ist die neue Methode praktisch frei von den typischen, formverzerrenden Artefakten und lässt die Struktur des Bildes weitgehend unangetastet.

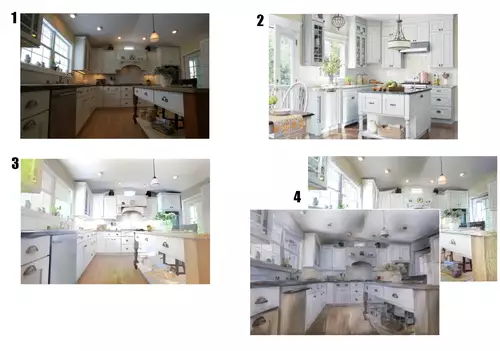

Hier einmal ein beeindruckendes Beispiel, wie eine Küche (Bild 1) anhand einer zweiten Bildvorgabe (Bild 2) automatisiert die Lichtstimmung übernimmt (Bild 3):

// Top-News auf einen Blick:

- DJI Mini 5 Pro soll so viel wie die Mini 4 Pro kosten

- Nikon Z6III bekommt u.a. Auto-Capture, USB-Streaming, Vogelmodus

- Blackmagic senkt Preise für URSA Cine 12K und 17k Kits radikal

- Google Gemini 2.5 Flash Image Nano Banana bringt Charakterkonsistenz und Multi-Imag

- Neue Sony FX3 und FX30 Firmware bringt BIG6-Startbildschirm, RAW-Video per HDMI und ...

- Google Pixel 10 Pro (XL) kommt mit Generativer KI direkt in der Kamera

Die bisherigen Ergebnisse sahen dabei immer wie gemalt aus (Bild 4). Bemerkenswert ist dabei auch, dass an diesem Paper zwei Adobe-Mitarbeiter mitgemischt haben, was offensichtlich bedeutet, dass Adobe dieses heiße Thema auch auf dem Schirm hat. Es dürfte daher nur eine Farge der Zeit sein, bis man entsprechende Funktionen auch in Photoshop und vielleicht sogar in den Videoapplikationen finden wird.

Der Einsatzzweck ist dabei weit gestreut. Grundsätzlich wird es wohl mit solchen Methoden mittelfristig möglich sein, dass man dem Computer einfach sagt, ich möchte dass mein Bild "irgendwie so aussieht wie dieses hier". Die Bildbeispiele im verlinkten PDF sind jedenfalls schon sehr beeindruckend...