Zur Zeit tut sich viel bei der Forschung zur Manipulation und Simulation von Gesichtern und deren Mimiken. Erst kürzlich wurde vom Max Planck Institut ein Verfahren vorgestellt, um die Gesichtsausdrücke einer Person in einem Video durch eine andere in Echtzeit "fernzusteuern", dann das Verfahren von Disney Research zur Synthese einer Gesichtsperformance aus mehreren Takes und jetzt ein von der University of Washington (zusammen mit Samsung, Google und Intel) entwickelter Algorithmus, mit dessen Hilfe sich ein Gesicht aus Photos erst als 3D-Modell rekonstruieren und dieses daraufhin "animieren" läßt. Letzteres durch eine Videoaufnahme einer anderen Person, deren Mimik dann genau auf dem rekonstruierten Gesicht abgebildet wird.

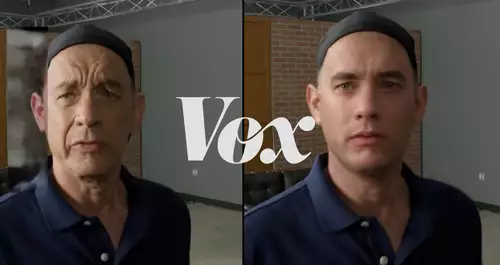

So kann etwa, wie im Beispielvideo, mithilfe der Aufnahme einer Rede von George Bush diese scheinbar von zB. Schwarzenegger oder Tom Hanks oder Ian McKellen gehalten werden - lippensynchron und inklusive der speziellen Manierismen des Vorbildes. Alles was gebraucht wird, um ein Gesicht so zu steuern, sind mehrere Photos sowie ein Video des Gesichts-"Puppenspielers" sowie Photos des Gesichts der "Puppe" - die Qualität des resultierenden Clips steigt mit der Anzahl und Qualität der zur Verfügung stehenden Photos. Der Ausdruck eines Gesichts kann auch nur mittels Photos auf ein anderes kopiert werden. Die Ergebnisse können etwas seltsam wirken - wenn das für eine Person charakteristische Minenspiel von einer anderen Person quasi gespiegelt wird.

Mithilfe dieses Verfahrens wäre es noch leichter als bisher schon möglich, etwa verstorbene Schauspieler oder Verwandte zu neuem Leben zu erwecken oder ein Gesicht in einem Film samt Mimik durch ein anderes zu ersetzen. Ziel der Forschung ist es, jedem die scheinbare Interaktion mit Berühmtheiten zu ermöglichen, die sich "echt" anfühlen, deswegen (und wegen ähnlicher Anwendungen) sind wohl auch führende Technologiefirmen an der Forschung beteiligt. Aber natürlich ist auch die gezielte Fälschung von Aufnahmen und Aussagen einer Person damit in Zukunft immer leichter möglich, je ausgefeilter der Algorithmus funktioniert.

Das Verfahren stellt keine außerordentlichen Anforderungen an die Rechenpower: die Tests wurden mit einer Intel i7-4770 mit 3.40GHz durchgeführt. Hier findet sich die ausführliche Veröffentlichung der Forschungsergebnisse mit dem schönen Titel "What Makes Tom Hanks Look Like Tom Hanks".

// Top-News auf einen Blick:

- Blackmagic DaVinci Resolve Beta 2 Update verbessert u.a. Fotoverarbeitung

- Adobe kündigt Firefly AI Assistant an - Agent steuert Creative Cloud Apps per Prompt

- Tilta Khronos Cine-Adapter soll PL-Objektive an das iPhone bringen

- Manfrotto ONE: Das vielseitigste Hybrid Stativsystem für Video + Foto seiner Klasse?

- Cartoni Hyperroll - modulares Roll-Rig für kreative Kamerafahrten

- GoPro MISSION 1 Pro - 8K-Actioncam-Modelle erklärt