Bewegte Objekte in Videos zu maskieren, um sie getrennt von allen anderen Inhalten zu bearbeiten, war früher eine extrem zeitaufwändige Arbeit. Inzwischen wurde sie dank neuer DeepLearning Algorithmen immer einfacher - oft muss nicht einmal mehr eine Maske um ein Objekt gezeichnet werden, sondern es reicht das Setzen mehrerer Punkte, um ein Objekt auszuwählen, welches dann vom Algorithmus selbstständig erkannt und über die nächsten Frames weiterverfolgt und maskiert wird.

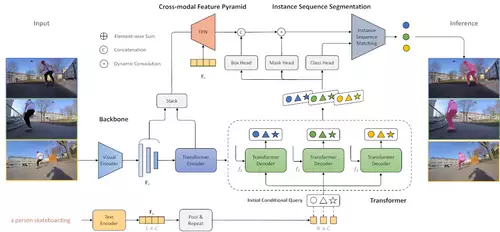

Der neue Deep Learning Algorithmus ("Language as Queries for Referring Video Object Segmentation") eines Teams aus der University of Hong Kong vereinfacht diese Arbeit noch weiter: hier kann das gewünschte Objekt einfach per Text beschrieben werden, um es auszuwählen, wie zum Beispiel "ein Pferd, welches hohe Sprünge macht":

Aufgrund dieser simplen Beschreibung wird das Objekt im Video erkannt und von einer dynamischen Maske über alle folgenden Einzelbilder verfolgt. Die kombinierte Sprach- und Bildanalyse des Algorithmus funktioniert dabei so gut, daß die Beschreibung des gewünschten Objekts auch recht komplex sein kann. So identifiziert der Algorithmus etwa auch ein Objekt durch seine dynamischen Beziehungen zu anderen Objekten oder seiner Lage im Raum, wie etwa "die Person, die auf einem Skateboard fährt".

Der KI-Algorithmus erledigt dazu eine ganze Reihe komplexer Aufgaben aus den Bereichen Text- und Videoverständnis: erst muss er den eingegebenen Text "verstehen", dann alle Objekte in einem Video samt dynamischer Beziehungen erkennen und aufgrund der vom User gegebenen Beschreibung das korrekte Objekt identifizieren (samt seiner Eigenschaften, wie etwa der Farbe und Beziehungen zu einem anderen Objekt wie etwa "der Tennisschläger in der Hand des Spielers mit dem roten Hemd").

// Top-News auf einen Blick:

- Blackmagic DaVinci Resolve und Fusion 21 Beta 2 Update verbessert u.a. Fotoverarbeitu

- Adobe kündigt Firefly AI Assistant an - Agent steuert Creative Cloud Apps per Prompt

- Tilta Khronos Cine-Adapter soll PL-Objektive an das iPhone bringen

- Manfrotto ONE: Das vielseitigste Hybrid Stativsystem für Video + Foto seiner Klasse?

- Cartoni Hyperroll - modulares Roll-Rig für kreative Kamerafahrten

- GoPro MISSION 1 Pro - 8K-Actioncam-Modelle erklärt

Dann muss das Objekt vom Hintergrund getrennt und über alle Frames, in denen es auftaucht, verfolgt und daraus eine dynamische Maske gebildet werden - auch wenn das Objekt sein Aussehen durch Bewegungen und Perspektivwechsel verändert. Die Maske muss idealerweise nicht mehr per Hand nachträglich angepasst werden. Sogar dynamische Handlungen, die sich über eine Videosequenz erstrecken, werden korrekt in einem längeren Video erkannt, wie etwa "die Hand, die dem Hund einen Ball gibt".

Der neue Algorithmus verbessert vorhergehende ähnliche Methoden nochmals und demonstriert sehr anschaulich, welche komplexen Aufgaben durch die Kombination verschiedener Deep Learning Methoden inzwischen bewältigt werden können. In seinem jetzigen Zustand könnte die Methode zum Beispiel verwendet werden, um in einem Videoarchiv bestimmte Objekte zu finden und sie zu extrahieren. Ein kleiner weiterer Schritt würde zum Beispiel auch die Suche per natürlicher Spracheingabe ermöglichen, ein größerer weiterer Schritt könnte das Editieren von Objekten samt deren Austausch in einem Video per Spracheingabe ermöglichen.

Der Programmcode kann wie immer auch selbst ausprobiert werden - das entsprechende Vorwissen vorausgesetzt. Wer mehr zur Methode lernen will, kann die zugehörige Forschungsarbeit lesen.