Newsmeldung von slashCAM:Dezember 2021

Realistischer Film Grain hat immer wieder Saison. Allerdings muss man für eine Simulation nicht gleich mehrere hundert Euro ausgeben. Mit etwas Handarbeit kann man in Resolve auch kostenlos ein virtuelles Filmentwicklungslabor einrichten...

Hier geht es zum slashCAM Artikel:

Workshop: Film Grain in Resolve mit eigenen Fotoemulsionen simulieren

Antwort von -paleface-:

Das Problem an dieser Technik sowie bei vielen anderen Grain Techniken. Es fehlt an Referenz.

Man kann einfach Grain drauf hauen und sagen....ja geil.

Aber ohne echtes Referenz Grain ist es immer nur ein künstliches "ungefähr".

Die Firma Livegrain scheint das NON PLUS ULTRA der Hollyood Grain Spezialisten zu sein.

Jedenfalls gehen da momentan alle hin.

https://www.livegrain.com

Und so wie ich deren Patent deute gehen die nicht über die RGB Layer sondern rein über die Helligkeiten.

Sprich die splitten sich die Helligkeits Zonen aus dem Material und setzen dann ihre Grain Keys.

Hier mal der Link:

https://patents.google.com/patent/US20160373659A1/en

Mann muss sich also vermutlich erst einmal die Frage stellen, wie reagiert der Filmstock den ich versuche zu simulieren in der und der Situation.

Antwort von cantsin:

Wahrscheinlich wird man das Problem in naher Zukunft via machine learning/KI lösen. Man müsste ja nur ein neuronales Netzwerk mit digitalen Bildern trainieren, die auf Film ausbelichtet und dann gescannt wurden, und zwar sowohl mit dem rein digitalen Ausgangsbild und dem gescannten Resultat. Wenn das Netzwerk dann diese Unterschiede 'gelernt' hat, kann es digitales Material entsprechend transformieren.

Antwort von andieymi:

-paleface- hat geschrieben:

Und so wie ich deren Patent deute gehen die nicht über die RGB Layer sondern rein über die Helligkeiten.

Sprich die splitten sich die Helligkeits Zonen aus dem Material und setzen dann ihre Grain Keys.

Macht ja eigentlich wenn man sich jedes Bild in Luma + Chroma überlegt, auch nur Sinn, beim Luma anzusetzen, oder? Aber interessante Sache, danke für das Teilen vom Patent!

cantsin hat geschrieben:

Wahrscheinlich wird man das Problem in naher Zukunft via machine learning/KI lösen. Man müsste ja nur ein neuronales Netzwerk mit digitalen Bildern trainieren, die auf Film ausbelichtet und dann gescannt wurden, und zwar sowohl mit dem rein digitalen Ausgangsbild und dem gescannten Resultat.

Würde da nicht sogar der unendliche Fundus aus analogen Bildern alleine reichen? Letztendlich geht es ja nicht darum, am Ende das wahrnehmungsmäßige Resultat "Digitales Bild + simuliertes Grain" zu haben, sondern lediglich die KI das Resultat lernen zu lassen?

Die "Hausmittel" kennt die KI ja, was sie nicht kennt ist das erwünschte Resultat.

Zu sagen, das ist eine Gesicht, das ist menschliche Haut, das sind feine Haardetails macht ja dann nur in einem schon auf Film-basierten Kontext Sinn, es muss nicht zuerst das digitale Resultat erlernt werden?

Ich bin wirklich kein machine learning Experte, gar nicht sogar. Mich interessiert das nur im Hinblick auf dieses Thema. Und da hab ich mich gefragt, ob das wirklich den trainingsmäßigen Ausgang im Digitalen Bild nehmen muss, oder ob das bei entsprechend etablierter Software nicht eigentlich die Differenz errechenbar macht.

Antwort von cantsin:

andieymi hat geschrieben:

Würde da nicht sogar der unendliche Fundus aus analogen Bildern alleine reichen? Letztendlich geht es ja nicht darum, am Ende das wahrnehmungsmäßige Resultat "Digitales Bild + simuliertes Grain" zu haben, sondern lediglich die KI das Resultat lernen zu lassen?

Die "Hausmittel" kennt die KI ja, was sie nicht kennt ist das erwünschte Resultat.

Zu sagen, das ist eine Gesicht, das ist menschliche Haut, das sind feine Haardetails macht ja dann nur in einem schon auf Film-basierten Kontext Sinn, es muss nicht zuerst das digitale Resultat erlernt werden?

Am besten wäre es natürlich, wenn man eine ganze Reihe Testaufnahmen machen würde, bei denen man eine analoge Filmkamera und eine digitale Videokamera parallel laufen und dieselben Motive aufnehmen lässt, und dann mit den Resultaten das neuronale Netzwerk trainiert. Es muss aber Vergleichsbilder bzw. Vorher-/Nachherbilder haben, um zu einer Heuristik zu kommen, wie man von a nach b transformiert.

Antwort von Frank Glencairn:

-paleface- hat geschrieben:

Und so wie ich deren Patent deute gehen die nicht über die RGB Layer sondern rein über die Helligkeiten.

Sprich die splitten sich die Helligkeits Zonen aus dem Material und setzen dann ihre Grain Keys.

Ist das nicht sowieso bei den meisten Plugins Standard?

Selbst das Resolve On-Board Grain OFX macht das so.

IMHO ist das "Particlecloud" Grain von Dehancer - vor allem was Komplexität, Qualität und Realismus betrifft - bisher bisher das beste.

This model is based on physical properties of real emulsion. Here are some of them:

- Grain isnt just overlaid on the image. Image consists of grain. One of the key points (but not the only one) that follows from this is that image detail depends on grain size, and usually visible details do not exceed grain size.

- Film emulsion has a certain thickness, i.e. it is not flat. When passing through multiple layers of emulsion, light is reflected, refracted and diffused in many ways.

- Silver halides (as well as dye granules) have volume. Accordingly, they are turned differently relative to film plane and therefore inevitably cast shadows.

- There are different shapes of granules classical rounded and flat grain, also called T-grain.

- Silver halides are distributed unevenly in the depth of emulsion layer. Tiny grains do not exist alone, forming complex conglomerations.

There is always considerable amount of grain in highlights because these areas correspond to maximum negative density, i.e. maximum accumulation of silver halides (Dmax). These always affect positive image printed from film to film or from film to photo paper. At the same time, due to the nature of human perception, grain is less noticeable in the highlights (but cannot be null).

- Grain is always found in deep shadows too, as these areas correspond to minimum exposure, i.e. minimal amount of silver halides (Dmin, most transparent areas of the negative). Accordingly, when printing from film to film (or from film to paper), print media is getting maximum amount of light in the shadows of the final image. In this way, the grain of print media itself becomes visible, along with slight grain of the source negative film.

Our algorithm generates grain based on local colour and brightness characteristics of the image, and thus is always related with it.

The granules are in fact 3D particles in the volume. Each granule is rotated relative to the image plane by a certain angle. Granules are randomly shifted and sometimes grouping in clusters. The resulting structure of halides is superimposed over the original image (not vice versa like with traditional approach), taking into account the reflection, refraction and diffusion effects in the layers of emulsion.

In the process of printing simulation, the initial negative grain becomes positive and is built into the image as an integral part of it, that is, it does not look like overlaid on top.

|

Antwort von roki100:

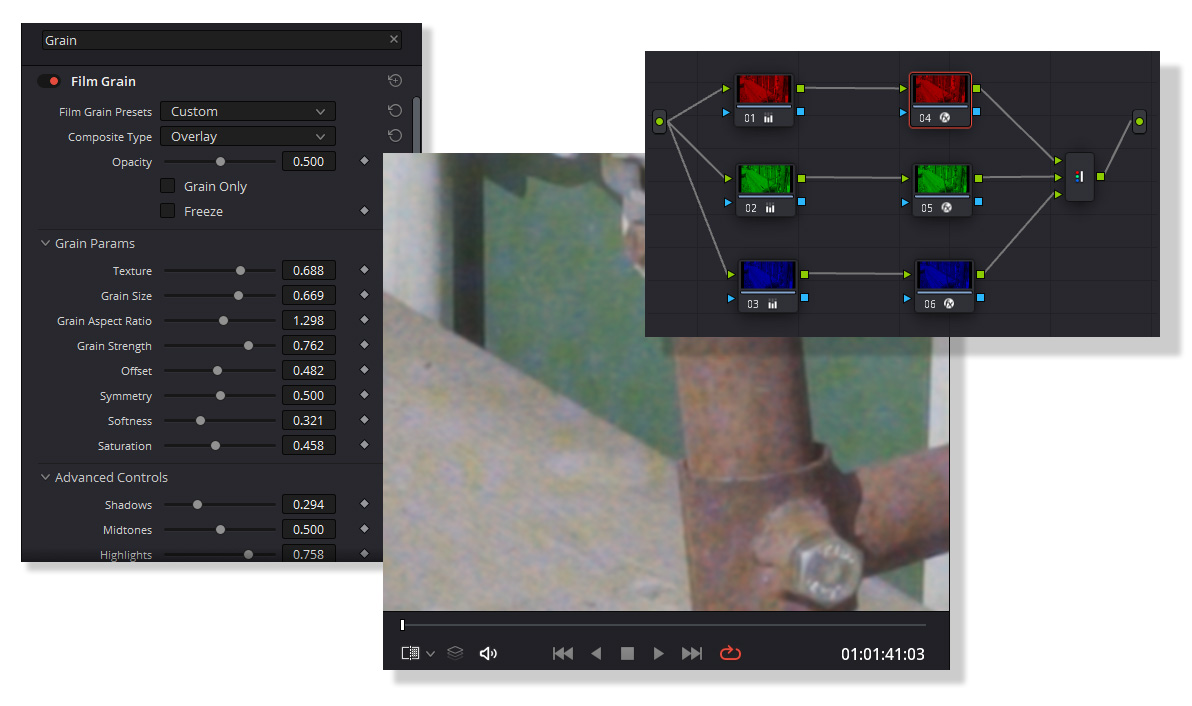

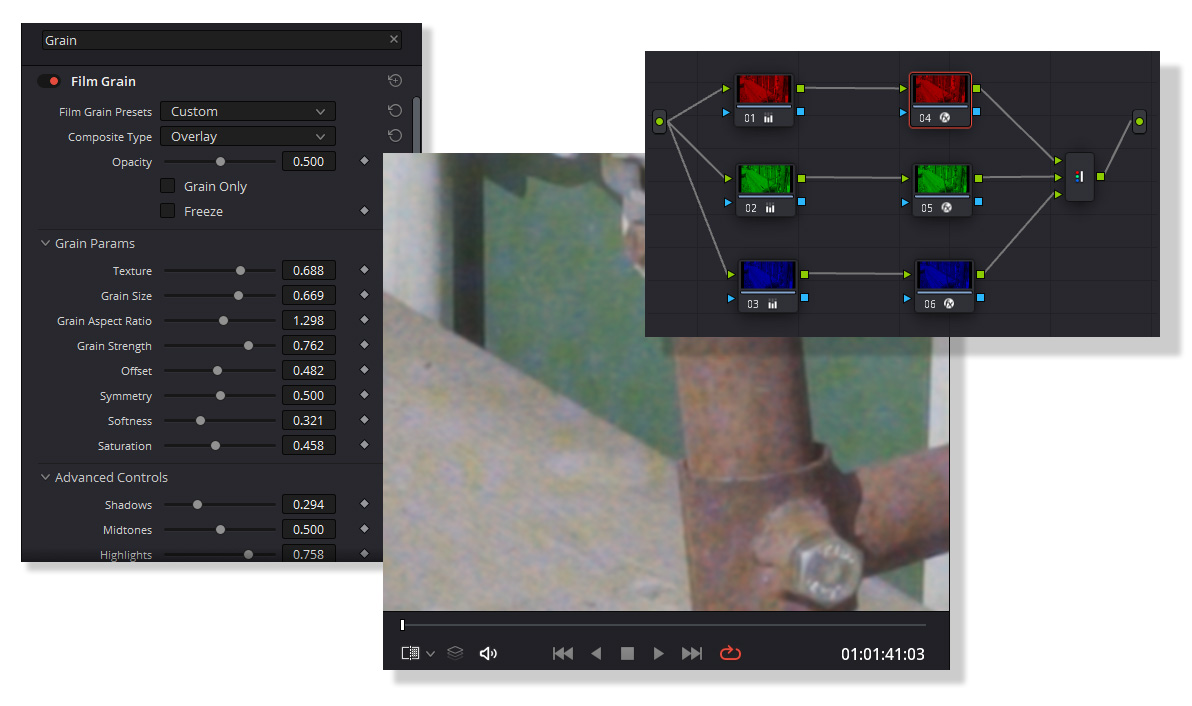

Also ich finde BMD OFX Film Grain besser und zwar wenn Composite Type auf "Linear Light" eingestellt ist. Der Rest ist denke Geschmacksache. Ich mache es immer so:

Bildschirmfoto 2021-12-02 um 21.23.51.png

Grain Strenght habe ich aber meistens bei: 0.123 und Opacity auf default / 0.500

Antwort von cantsin:

Sowieso kann man jede Grain-Simulation vergessen, wenn man für YouTube & Co. rausrendert, weil das die schmalbandigen Codecs überfordert und zu Kompressionsartefakten und schlechter Bildqualität führt.

Antwort von roki100:

Vimeo geht. Hier ein vergleich zwischen BMD Film Grain und Dehancer Film Grain (Grain ist natürlich nicht übertrieben drauf, nur bisschen):

https://vimeo.com/652646903

(Unter Qualität auf höhere Auflösung umstellen)

Wie man sieht, ist BMD Film Grain mit Composite Type "Linear Light" eigentlich das selbe wie Dehancer bzw. Dehancer verwendet wahrscheinlich die selbe Technologie (Composite Type Linear Light)?

Antwort von mash_gh4:

eherlich gestanden versteh ich wirklich nicht, wie man sich im jahr 2021, wo sich eigentlich herumgsprochen haben sollte, dass sich ein primitives hinzufügen von grain nicht sonderlich gut mit den alten kompressionstechniken verträgt und die neuden codecs ohnehin entsprechende indirekte übertragung bzw. empfängerseitige-korn-synthese vorsehen, noch mit derart unbefriedigenden ansätzen herumschlagen kann?

zum Bild

Antwort von cantsin:

mash_gh4 hat geschrieben:

eherlich gestanden versteh ich wirklich nicht, wie man sich im jahr 2021, wo sich eigentlich herumgsprochen haben sollte, dass sich ein primitives hinzufügen von grain nicht sonderlich gut mit den alten kompressionstechniken verträgt und die neuden codecs ohnehin entsprechende indirekte übertragung bzw. empfängerseitige-korn-synthese vorsehen, noch mit derart unbefriedigenden ansätzen herumschlagen kann?

Naja, dieser Ansatz läuft ja - wenn ich ihn richtig verstehe - darauf hinaus, dass man dem Softwareplayer per Metadaten sagt "füge beim Abspielen xy Prozent Bildrauschen als Kornsimulation hinzu", was erstens die Browser-internen Videoplayer wahrscheinlich nicht (oder nicht vorhersagbar gut) beherrschen, und was zweitens bedeutet, dass man null Kontrolle über die Qualität der Kornsimulation hat. Und so gut wie die von Dehancer & Co. kann sie ja nicht sein.

Antwort von mash_gh4:

cantsin hat geschrieben:

Naja, dieser Ansatz läuft ja - wenn ich ihn richtig verstehe - darauf hinaus, dass man dem Softwareplayer per Metadaten sagt "füge beim Abspielen xy Prozent Bildrauschen als Kornsimulation hinzu", was erstens die Browser-internen Videoplayer wahrscheinlich nicht (oder nicht vorhersagbar gut) beherrschen,...

unterstützung dafür ist zwingend erforderlich bzw. ein fix eingeforderter bestandteil der spezifikation praktisch aller neuen video codecs -- also nicht nur AV1 spezifisch --, aber dort eben gegenwärtig am ehesten praktisch nutzbar, weil das bereits fast alle browser und player bzw. die dafür meist benützte 'libdav1d' bereitstellen. die netflix-auslieferung nutzt das auch bereits ganz praktisch im produktionsbetrieb.

cantsin hat geschrieben:

und was zweitens bedeutet, dass man null Kontrolle über die Qualität der Kornsimulation hat. Und so gut wie die von Dehancer & Co. kann sie ja nicht sein.

keine sorge, die entsprechenden eingriffs- und gestaltungsmöglichkeiten bzw. konfigurationsparameter sind ausreichend umfangreich und kompliziert, dass man ohnehin auch so einmal tief luft holen muss, um diesen möglichkeiten gewachsen zu sein bzw. sie gestalterisch souverän zu meistern.

https://github.com/AOMediaCodec/SVT-AV1 ... nthesis.md

https://medium.com/@nasirhemed/a-quick- ... dffbdb5cc4

und natürlich ist es wieder nur ein praktischer kompromiss, aber halt zumindest eine deutlich verbesserung gegenüber allen unholfenen versuchen, diese dinge mit dem holzhammer bzw. ohne jede berücksichtigung der umgebenden rahmenbedingungen auf anderem weg erzwingen zu wollen.

ein wichtiger punkt an der ganzen geschichte ist ja auch die tatsache, dass z.b. die übertragung und auslieferung im kino-umfeld etwas anderen gesetztmäßigkeiten gehorcht bzw. etwas andere möglichkeiten und einschränkungen aufweist als die diversen videoplattformen im netz. man sollte also besser nicht völlig blind und unreflektiert in diesen verteilungskanälen, die gänzlich anders geartete eigenschaften und grenzen aufweisen, großes kino zu imitieren versuchen. was in manchen high-end produktionszusammenhängen durchaus sinn machen kann, ist nicht unbedingt gleich auch ein guter ratschlag für alle angehenden und uns umgebenden youtube stars bzw. die ganz realen distributionsmöglichkeiten für das gemeine volk.