Newsmeldung von slashCAM:

Z-Puffer kommen eigentlich aus der Welt des 3D-Renderings, doch dank KI lässt sich diese Technologie in Resolve auch sehr einfach für hippe Titel-Effekte nutzen.

Hier geht es zum slashCAM Artikel:

Praxis: DaVinci Resolve 20 Workshop - AI Depth Map unkompliziert für Titel-Effekte nutzen

Antwort von Jörg:

Für Nutzer, die gerne tiefer in die Materie schauen wollen, den Weg über Fusion nicht scheuen:

Bernd Klimm hat zwei sehr anschauliche Tutorien zum Thema verfasst:

https://www.youtube.com/watch?v=Rx5MgsFH6Ds

https://www.youtube.com/watch?v=WThVHPqJNs4

Hat mich im vorigen Jahr zum Spielen animiert...

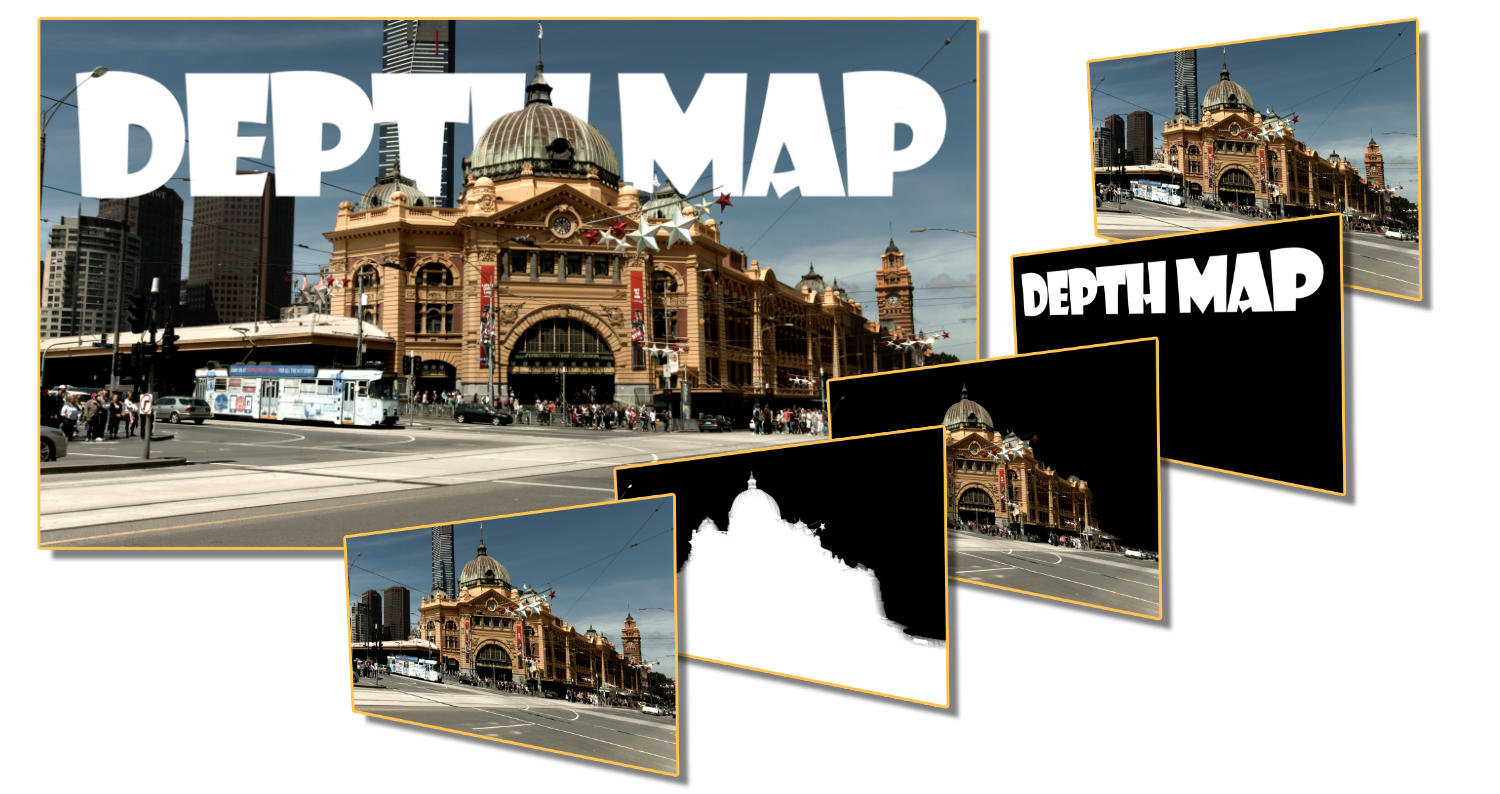

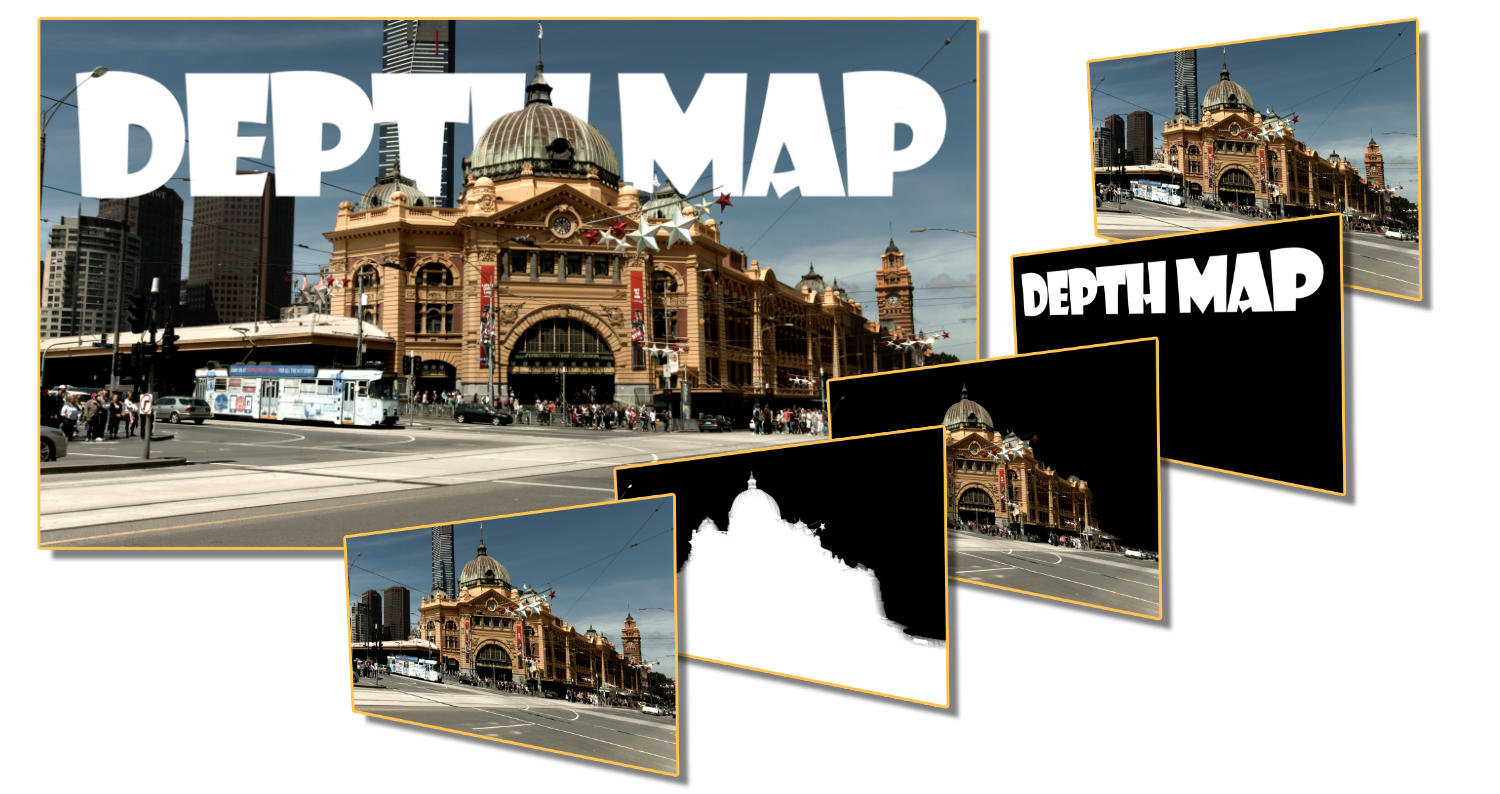

depth map.jpg

Antwort von CameraRick:

Ja hm. Ich verstehe die Intention, aber das Ergebnis der Maske ist einfach sehr schlecht. Bei so einem Schuss kommt man mit einem Key+einfache Garbagematte ja ähnlich schnell zu einem besseren Ergebnis; zumindest die Graubereiche kann man ja noch etwas crunchen um da nicht die Schrift auch im Dach zu haben.

Also versteht mich nicht falsch: nutzt neue Technik wie es beliebt, und auch für sowas. Aber in einem Schaubeispiel, "schau was tolles geht", und es dann schlecht bei einem einfachen Schuss machen... na ja :/

Antwort von Axel:

In Fusion funktioniert die Depth Map 2 aus Resolve 20 Color noch nicht. Die ist wesentlich besser, benötigt auch nur noch einen Node. Sie ist sehr sinnvoll, wie der Name suggeriert, für Tiefeneffekte, wie sie ja auch Bernd Klimm im ersten Video zeigt. Um eine Alternative zum sDoF zu haben und Bilder malerischer aussehen zu lassen. Dabei geht es dann nicht darum, eine bestimmte Tiefenschärfe zu isolieren, sondern einen realistisch anmutenden Verlauf mit Grauabstufungen zu bekommen. Man kann entweder das Entfernte, den Hintergrund, subtil in Kontrast und Sättigung herabsetzen, was einen starken 3D-Effekt bewirkt:

zum Bild

.. oder, statt einen Raum mit Nebelmaschinen relativ aufwändig mit Dunst zu füllen, mit einem Plugin wie Hazy (das u.a. auch die Filter "Haze" und "Smoke" hat) gezielt und dosiert mit (durch Depth Map) volumetrischen Dunst füllen:

zum Bild

Im Vergleich dazu sind Texte hinter Objekten heutzutage nichts Besonderes mehr.

Antwort von rudi:

CameraRick hat geschrieben:

zumindest die Graubereiche kann man ja noch etwas crunchen um da nicht die Schrift auch im Dach zu haben.

Das ist natürlich immer abhängig vom Material, aber im Video unter dem Artikel hatten wir die Maske deutlich knackiger eingestellt, als in den Screenshots aus dem Projekt. Und das Edge Refinement geht auch in der neuen Depth Map recht zuverlässig. Da funktionieren auch so Sachen, wie Lampe ganz links über dem Titel, während die Drähte dahinter landen.

Antwort von patfish:

Axel hat geschrieben:

In Fusion funktioniert die Depth Map 2 aus Resolve 20 Color noch nicht. Die ist wesentlich besser, benötigt auch nur noch einen Node. Sie ist sehr sinnvoll, wie der Name suggeriert, für Tiefeneffekte, wie sie ja auch Bernd Klimm im ersten Video zeigt. Um eine Alternative zum sDoF zu haben und Bilder malerischer aussehen zu lassen.

Es geht in Wahrheit noch um viel mehr. Eine Pixelgenau Depth Map ist quasi seit jeher der heilige Gral des Compsitings und wäre neben RGBA der 5. wichtige Kanal von Compostiong Formaten :D Im idealen Fall braucht es damit (also in Perfektion) keinen Greenscreen mehr (mit kleinen Ausnahmen), es können Day for Night Effekte in Perfektion umgesetzt werden usw. ... Aber alles das ist ja sowieso bald kein großes Thema mehr im Zeitalter der KI.

Antwort von patfish:

patfish hat geschrieben:

Axel hat geschrieben:

In Fusion funktioniert die Depth Map 2 aus Resolve 20 Color noch nicht. Die ist wesentlich besser, benötigt auch nur noch einen Node. Sie ist sehr sinnvoll, wie der Name suggeriert, für Tiefeneffekte, wie sie ja auch Bernd Klimm im ersten Video zeigt. Um eine Alternative zum sDoF zu haben und Bilder malerischer aussehen zu lassen.

Es geht in Wahrheit noch um viel mehr. Eine pixelgenaue Depth Map ist quasi seit jeher der heilige Gral des Compsitings und wäre neben RGBA der 5. wichtige Kanal von Composting Formaten :D Im idealen Fall braucht es damit (also in Perfektion) keinen Greenscreen mehr (mit kleinen Ausnahmen), es können Day for Night Effekte in Perfektion umgesetzt werden usw. ... Aber alles das ist ja sowieso bald kein großes Thema mehr im Zeitalter der KI.

PS: Das BMD Fusion im Vergleich zu Resolve so schleifen lässt (z.B. noch immer Singel threated) ist traurig. Ich habe große Hoffnungen in das Tool gelegt.

Antwort von CameraRick:

rudi hat geschrieben:

CameraRick hat geschrieben:

zumindest die Graubereiche kann man ja noch etwas crunchen um da nicht die Schrift auch im Dach zu haben.

Das ist natürlich immer abhängig vom Material, aber im Video unter dem Artikel hatten wir die Maske deutlich knackiger eingestellt, als in den Screenshots aus dem Projekt. Und das Edge Refinement geht auch in der neuen Depth Map recht zuverlässig. Da funktionieren auch so Sachen, wie Lampe ganz links über dem Titel, während die Drähte dahinter landen.

Im Video scheint der Text halt noch immer durchs Dach - mit nem einfachen Key wäre man an der Stelle sicher weiter gekommen. Wie gesagt: grundlegend ist es schön, dass ich euch mit diesen Themen beschäftigt, aber vielleicht dann doch lieber für Einsatzzwecke wo die Technik nicht a) die schlechtere Wahl ist und b) einfach nicht hinterher kommt :/

Antwort von speedy gonzales:

Feiner Artikel, vielen Dank. Zu diesem Abschnitt:

Nutzt man jedoch die Tiefenmaske im Color-Raum, so funktioniert die hierbei erzeugte Alpha-Maske nicht im Editor - wahrscheinlich, weil die Color Effekte in der Renderreihenfolge nach den Edit-Effekten berechnet werden.

Doch, das funktioniert: in der Color Page Rechtsklick auf den Node-Bereich, dann "Add Alpha Output" auswählen, danach noch den blauen Alpha-Socket vom AI-Depth-Map-Node mit diesem neuen Alpha-Output verbinden. In den Depth Map Einstellungen die "Depth Map Preview" abschalten und auf die Edit Page wechseln, hier ist der Clip jetzt prima mit Alpha-Kanal freigestellt.

Die Qualität des Alphakkanals hängt von den Depth Map Einstellungen unter "Resulting Map Adjustment" ab. Inbesondere bei unruhigen Hintergründen, von denen man nur schwer nen guten Key ziehen kann, sind hiermit sehr saubere und scharfe Freistellungen möglich :)

Um eine generierte Alpha-Maske im Editor nutzen zu können, muss diese folglich auch ebendort generiert worden sein

ist m.E. nicht korrekt siehe oben