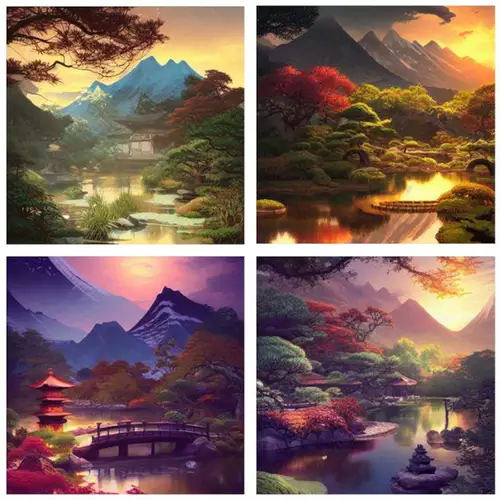

Mit DragNUWA 1.5 hat ein Team mit Verbindungen zu Microsoft ein neues KI-Modell vorgestellt, mit dem sich aus Standbildern Videos erzeugen lassen. Im Gegensatz zu bisherigen Ansätzen, lassen sich bei DragNUWA "einfach" Pfeile in das Bild malen, welche der KI Hinweise liefern sollen, wie und wohin sich ein Objekt im Video bewegen soll.

In der Vorgängerversion DragNUWA 1.0 durfte noch ein zusätzlicher Text-Prompt formuliert werden, der sogar dafür sorgen konnte, dass zuvor nicht im Bild vorkommende Objekte anschließend ins Bild wanderten. Dieser Prompt scheint bei der nun aktuellen Version 1.5 im Interface nicht vorhanden zu sein. Zumindest auf Hugging Face, wo eine Demo-Version zur Verfügung gestellt wird. Man kann sich das Modell jedoch auch selber auf dem heimischen Rechner installieren und ausprobieren.

DragNUWA 1.5 benutzt interessanterweise kein eigenes Modell, sondern basiert auf den Gewichten von Stable Diffusion, welches von den Programmieren auf die neuen Bewegungspfade getuned wurde. Wer sich für Details interessiert, findet das zugehörige Paper hier als PDF bei arxiv.org.

// Top-News auf einen Blick:

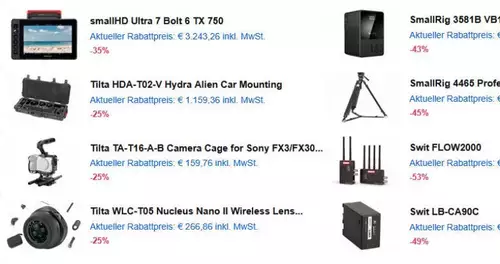

- Blackmagic Resolve Studio für 236,81 bei Teltec - und weitere Angebote

- Bis zu 1.000 Euro sparen: Cashbacks auf Kameras von Sony, Nikon, Canon und Panasonic

- Ausgewählte Angebote - DJI Mavic 4 Pro, Canon R5 C, Sachtler aktiv12T...

- Die besten Black Friday Deals für Sony und Canon DSLMs und Objektive

- Blackmagic bietet bis zu 30% Rabatt auf seine 6K Kameras

- Große Übersicht - Black Friday Deals 2025 für Foto+Video - Kameras, Objektive, Zubehör usw.

Klickt man sich durch die RAW GIFs, so sieht man dann auch schnell, dass DragNUWA 1.5 keine neuen Lösungen für die typischen KI-Bewegungs artefakte ins Spiel bringt. Dafür aber immerhin bereits einen schönen Eindruck, wie die Oberfläche zu einem KI-Animations Tool in naher Zukunft einmal funktionieren könnte.