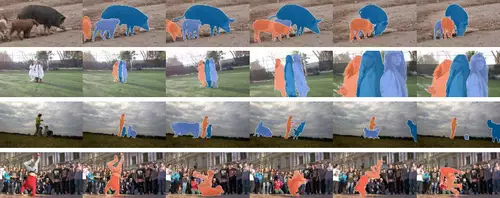

Normalerweise können Gegenstände auf Photos nur zweidimensional bearbeitet werden - denn darüber, welche räumliche Form ein Objekt hat, und wie es folglich von einer anderen Perspektive aus betrachtet aussieht, fehlen einfach die Informationen. Dieses Hindernis umgeht der demnächst auf der Siggraph 2014 vorgestellte Algorithmus eines Teams der Carnegie Mellon und der University of Berkley, indem aus einer Datenbank von 3D Modellen ein passendes ermittelt wird, um die fehlenden Informationen über ein Objekt zu erhalten.

Damit wird es dann möglich, die Orientierung des Gegenstands auf dem Photo beliebig zu ändern, ihn woanders zu platzieren oder ihn auch zu animieren. Der Algorithmus sorgt auch für die korrekte Textur, Farbe, Schattenwurf und Beleuchtung des Objekts - inklusive einer stimmigen Extrapolation von eventuell nicht mehr verdecktem Hintergrund und einer halbautomatischen Anpassung des 3D-Modells an das Objekt, falls es etwas vom Modell abweichen sollte. Die Technik kann auch auf gemalte Bilder oder Zeichnungen angewendet werden. Auf der Webseite des Projekts kann auch der Programmcode (für OS X) runtergeladen werden.

// Top-News auf einen Blick:

- Affinity Photo, Designer und Publisher ab sofort in einer kostenlosen App

- DJI Neo 2 bringt Rundum-Hinderniserkennung samt LiDAR

- Künftige Xbox Next: Vollwertiger Windows-PC mit Potenzial für Videobearbeitung

- LG UltraFine 40U990A-W - 40 5K2K Monitor mit Thunderbolt 5

- Neue Firmware für Panasonic LUMIX S5 II, S5 IIX, S9, GH7 und G9 II