Newsmeldung von slashCAM:

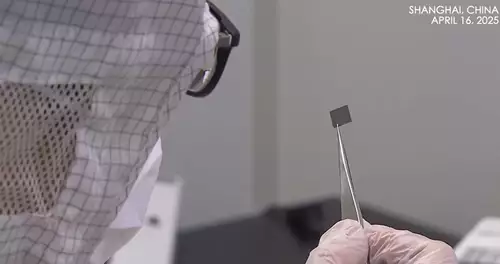

Nach einem Bericht von Nikkei Asia hat Apple diesen Monat mit der Massenfertigung einer neuen Version seines M1-Chips begonnen. Der neue - vermutlich M2 oder M1X getaufte...

Hier geht es zur Newsmeldung auf den slashCAM Magazin-Seiten:

Hier geht es zur Newsmeldung auf den slashCAM Magazin-Seiten:

Neuer MacBook Pro mit M2-Chip schon im Juli?

Antwort von teichomad:

m2, m3 und m4 liegen locker schon im schrank. ich behaupte es gibt einen gewissen puffer bei den herstellern damit es kalkulierbar bleibt.

Antwort von MrMeeseeks:

Die M1 Chips sind so sparsam dass Apple auch einfach die doppelte Menge an Kernen verbauen könnte mit einer aktiven Kühlung.

Jedes Jahr ein neuer Chip a la M2, M3, M4 usw. ist natürlich profitabler.

Die sollen aber mal schön das passive Macbook Air im Programm behalten, lautlos rechenintensive Aufgaben zu erledigen ist wirklich ein Luxus.

Antwort von teichomad:

Ich hab ein 13 Zoll Macbook Pro von 2017. Hammerhart wie laut und heiß das Teil manchmal wird. Am besten finde ich, dass man nach nem normalen Start gerne mal neu starten muss damit der bereits per thunderbolt angeschlossende monitor endlich mal erkannt wird.

Antwort von markusG:

MrMeeseeks hat geschrieben:

Jedes Jahr ein neuer Chip a la M2, M3, M4 usw. ist natürlich profitabler.

Vorausgesetzt Apple bleibt nicht in der Fertigungstechnik stecken (deswegen sind die doch eigentlich weg von Intel...) muss das TSMC erstmal liefern können. Ganz so trivial ist es nicht...

Wäre aber natürlich gut wenn es wahr werden würde und man nicht wie zu Intelzeiten ständig hinterher hinkt.

Und das gute ist auch dass sie es ja praktisch beliebig skalieren können, wie wir nun beim iMac gesehen haben (okay, minus den Anschlüssen vielleicht)

Antwort von Axel:

Von den 14er und 16er MBP weiß man überhaupt nur Genaueres durch den Blaupausenklau von der Apple-Zuliefererfirma Quanta durch die russischsprachige Hacker-Gruppe REvil, die prahlte, nun täglich neue Details leaken zu wollen, solange Apple ihnen nicht 50 Millionen Lösegeld zahlen würde. Der immer in Prollpantoffeln rumsitzende Youtuber von LaterClips fragte sich, nachdem weitere Enthüllungen ausgeblieben sind, ob ...

1. ... Apple die 50 Millionen gezahlt hat.

2. ... das Ganze ein Bluff war (dann wäre freilich auch die geleakte Information wenig wert).

3. ... das ein Job für John Wick war.

Antwort von Funless:

Ich hätte John Wick losgeschickt ..

Antwort von Drushba:

Nachdem der M1 schon mit dem 8K RAW der Canon R5 einspurig ohne dropped frames klarkommt, wäre ein 1,5-fach bis doppelt so schneller M2 wohl ausreichend zukunftssicher für die nächsten Jahre. Wirklich neue Industrie-Codecs gibt es wohl erst, wenn die Macbooks dann in 5+ Jahren wieder hinüber sind (und Apple ja bei VVC an Board ist und diesen Codec hoffentlich noch in den M2 implementiert.))

Antwort von rdcl:

Drushba hat geschrieben:

Nachdem der M1 schon mit dem 8K RAW der Canon R5 einspurig ohne dropped frames klarkommt, wäre ein 1,5-fach bis doppelt so schneller M2 wohl ausreichend zukunftssicher für die nächsten Jahre. Wirklich neue Industrie-Codecs gibt es wohl erst, wenn die Macbooks dann in 5+ Jahren wieder hinüber sind (und Apple ja bei VVC an Board ist und diesen Codec hoffentlich noch in den M2 implementiert.))

RAW abspielen zu können ist ja jetzt nicht die Messlatte, oder? Das 10bit h265 wäre ein fordernder Codec.

Antwort von Axel:

rdcl hat geschrieben:

RAW abspielen zu können ist ja jetzt nicht die Messlatte, oder? Das 10bit h265 wäre ein fordernder Codec.

Ist wohl weniger eine Frage der Pferdestärke. 8k H.265 kann der M1 auch, nur verschluckt er sich mW an H.265 10 bit 4:2:

2. So war es anfangs auch mit H.264 10-bit der GH5. Eine Frage der Codec-Konformität.

Antwort von rdcl:

Axel hat geschrieben:

rdcl hat geschrieben:

RAW abspielen zu können ist ja jetzt nicht die Messlatte, oder? Das 10bit h265 wäre ein fordernder Codec.

Ist wohl weniger eine Frage der Pferdestärke. 8k H.265 kann der M1 auch, nur verschluckt er sich mW an H.265 10 bit 4:2:2. So war es anfangs auch mit H.264 10-bit der GH5. Eine Frage der Codec-Konformität.

10bit aus der r5 ist immer 4:2:2 wenn ich mich nicht täusche.

Antwort von Axel:

rdcl hat geschrieben:

Axel hat geschrieben:

Ist wohl weniger eine Frage der Pferdestärke. 8k H.265 kann der M1 auch, nur verschluckt er sich mW an H.265 10 bit 4:2:2. So war es anfangs auch mit H.264 10-bit der GH5. Eine Frage der Codec-Konformität.

10bit aus der r5 ist immer 4:2:2 wenn ich mich nicht täusche.

Sorry, ich hab das verwechselt. Der M1 spielt offenbar noch nicht einmal 8k 8-bit aus der R5, dafür 8k 10-bit aus der A1,

hier war das. Wobei man sagen muss, dass diese kurzen Clips nicht viel besagen. Wenn ich mich recht erinnere, gibt es auch 10-bit 4k HEVC mit der R5, und damit hat der M1 wohl keine Probleme.

Antwort von R S K:

rdcl hat geschrieben:

RAW abspielen zu können ist ja jetzt nicht die Messlatte, oder?

8K? In

voller Qualität und nicht in PPros "

? FTW!"? Ja. Allerdings. Vor allem wenn wir von dem unsäglichen

Canon RAW reden. Oder meinst du etwa das hat nur was mit

Datenrate zu tun?

Ok. Wie ist es dann mit

12K 16Bit 30p Material der Ursa Mini Pro ohne Dropped Frames und in voller Auflösung? Vermutlich auch nicht genug? 😏

Antwort von Jott:

Zu wenig für einen Einsteiger-Consumer-Mac. Da muss mehr gehen.

Antwort von R S K:

Jott hat geschrieben:

Zu wenig für einen Einsteiger-Consumer-Mac.

Für die Uber-Pros hier, ja. Vergess ich immer. Sorry. 😞

Es muss endlich ein echter

Profi Mac her für die dringend benötigten 12K

Multicams!!

(um es auseinander zu nehmen und für völlig unzureichend und

sowieso völlig überteuert zu erklären

yadda yadda yadda)

🤷🏼???

Antwort von markusG:

"R S K" hat geschrieben:

und sowieso völlig überteuert zu erklären

Wenn das so weiter geht mit dem weltweiten Chipmangel dürfte sich das "Argument" von alleine lösen^^

Antwort von egmontbadini:

"Das neue System weist durch die hohe Integration der verschiedenen Komponenten ein extrem gutes Verhältnis von Leistung pro Watt auf und liefert dieselbe Performance wie etwa ein Intel Dual Core MacBook Air."

....ähem, wie ein DUALCORE MAC BOOK AIR?

Antwort von andieymi:

egmontbadini hat geschrieben:

"Das neue System weist durch die hohe Integration der verschiedenen Komponenten ein extrem gutes Verhältnis von Leistung pro Watt auf und liefert dieselbe Performance wie etwa ein Intel Dual Core MacBook Air."

....ähem, wie ein DUALCORE MAC BOOK AIR?

Hab ich mir auch gedacht. Die Performance ist defintiv um Welten besser als ein Dual-Core.

Mein Eindruck ist: Es kommt tatsächlich im Fall von M1 eher auf die verwendete Software an. Resolve läuft nativ (ohne Rosetta2), funktioniert für 6K Raw super. Premiere ist noch nicht portiert und innerhalb der Emulation und der sonstigen relativen "Unperformance" von Premiere sieht es da schon etwas schlechter aus.

Also die Leistung wäre an sich da. Es liegt wieder mehr an der Software, die Leistung zur Verfügung zu stellen. Manche tun das schon, andere brauchen dafür noch. Mittelfristig sieht das aber gut aus.

(Darauf deuten auch die diversen Ungereimtheiten was Kompressionen, Codecs, unterschiedliche Subsamplingstufen angeht hin, da ist softwareseitig noch vieles im Argen.

Antwort von egmontbadini:

andieymi hat geschrieben:

egmontbadini hat geschrieben:

"Das neue System weist durch die hohe Integration der verschiedenen Komponenten ein extrem gutes Verhältnis von Leistung pro Watt auf und liefert dieselbe Performance wie etwa ein Intel Dual Core MacBook Air."

....ähem, wie ein DUALCORE MAC BOOK AIR?

Hab ich mir auch gedacht. Die Performance ist defintiv um Welten besser als ein Dual-Core.

Mein Eindruck ist: Es kommt tatsächlich im Fall von M1 eher auf die verwendete Software an. Resolve läuft nativ (ohne Rosetta2), funktioniert für 6K Raw super. Premiere ist noch nicht portiert und innerhalb der Emulation und der sonstigen relativen "Unperformance" von Premiere sieht es da schon etwas schlechter aus.

Also die Leistung wäre an sich da. Es liegt wieder mehr an der Software, die Leistung zur Verfügung zu stellen. Manche tun das schon, andere brauchen dafür noch. Mittelfristig sieht das aber gut aus.

(Darauf deuten auch die diversen Ungereimtheiten was Kompressionen, Codecs, unterschiedliche Subsamplingstufen angeht hin, da ist softwareseitig noch vieles im Argen.

Vielleicht ist die Aussage auch irreführend, weil so eine Art PS/kg - Vergleich wie vom Mofa zum Sportwagen gezogen wird.

Ich arbeite seit den vorletzten Käsereiben von 2012 auf PCs und die M-Prozessoren klingen nach einer interessanten Entwicklung, die mich vielleicht wieder zum Mac zurückbringen könnte. Da ich Premiere auch in letzter Zeit sehr nervig finde, ist auch der Sprung zu Resolve denkbar. Vor allem die Navigation im Explorer und das Fehlen von Time-Machine nerven am PC(es gibt anscheinend keine wirklichen adäquaten Programme für Windows, jaaaa 1 Mio Backup-Programme, aber eben nicht so easy und komfortabel wie Time-Machine).

Antwort von andieymi:

egmontbadini hat geschrieben:

Ich arbeite seit den vorletzten Käsereiben von 2012 auf PCs und die M-Prozessoren klingen nach einer interessanten Entwicklung, die mich vielleicht wieder zum Mac zurückbringen könnte. Da ich Premiere auch in letzter Zeit sehr nervig finde, ist auch der Sprung zu Resolve denkbar. Vor allem die Navigation im Explorer und das Fehlen von Time-Machine nerven am PC(es gibt anscheinend keine wirklichen adäquaten Programme für Windows, jaaaa 1 Mio Backup-Programme, aber eben nicht so easy und komfortabel wie Time-Machine).

Ich hatte bisher nur PCs und die Entwicklungen bei Mac lassen mich bei einem Umstieg ernsthaft Mac in Erwägung ziehen. Bei Laptop sowieso, in Zukunft darf man auch gespannt sein, was da für den Desktop kommt.

Habe das Macbook Air meiner Freundin (Basisversion) vor ein paar Tagen gegen meinen Desktop (3700X, 5700Xt, 32GB) cinebenched (R23), die gemessene Leistung war am Desktop noch ca. noch 1,7x höher, in Resolve war davon allerdings wenige zu merken.

Dabei allerdings auch kein Stresstest mit 20-fach-verzweigten Nodetrees und Denoisern, das ist ohnehin weniger wo ich das M1 MB Air/Pro sehen würde.

Aber als Universalgerät zwischen Wrangling am Set, evtl ein paar Proxy-Grades und Office ist die Preis-Leistung von M1-Geräten im Moment genial.

Antwort von markusG:

andieymi hat geschrieben:

in Zukunft darf man auch gespannt sein, was da für den Desktop kommt.

Das wird wohl noch eine Weile dauern, also ich würde 2021 nicht mehr damit rechnen.

Ich werde mir deswegen wohl erstmal einen neuen PC holen und entspannt abwarten bis a) sämtliche relevanten Programme/Plugins gescheit laufen bzw. portiert wurden (Blender...) und b) das Portfolio von Apple dann auch "vollständig" ist (also nicht nur Einstiegs-APUs zum Einsatz kommen). So spannend/genial der M1 im mobilen Bereich ist, für den Desktop finde ich ihn abseits vom Front Office bissl "underwhelming". Mal schauen ob der M2 das bereits ändert, gerade in punkto GPU...

Ich denke v.a.D. 2022 wird spannend :)

Antwort von R S K:

markusG hat geschrieben:

Das wird wohl noch eine Weile dauern, also ich würde 2021 nicht mehr damit rechnen.

Nee, klar. Weil die auch ganz sicher noch

ewig für den 30" iMac und die MBPs brauchen werden. Es fehlen schließlich

sämtliche Komponente. Und für die Weihnachtssaison reichen die 24" sicher dicke. Zu den 2-3 noch zu erwartenden Events werden sie sich bestimmt nur auf

AirTag Accessoires konzentrieren.

😏👍🏼

Antwort von egmontbadini:

markusG hat geschrieben:

andieymi hat geschrieben:

in Zukunft darf man auch gespannt sein, was da für den Desktop kommt.

Das wird wohl noch eine Weile dauern, also ich würde 2021 nicht mehr damit rechnen.

Ich werde mir deswegen wohl erstmal einen neuen PC holen und entspannt abwarten bis a) sämtliche relevanten Programme/Plugins gescheit laufen bzw. portiert wurden (Blender...) und b) das Portfolio von Apple dann auch "vollständig" ist (also nicht nur Einstiegs-APUs zum Einsatz kommen). So spannend/genial der M1 im mobilen Bereich ist, für den Desktop finde ich ihn abseits vom Front Office bissl "underwhelming". Mal schauen ob der M2 das bereits ändert, gerade in punkto GPU...

Ich denke v.a.D. 2022 wird spannend :)

das mit den PCs mache ich so seit 2012 ;) und habe mich schon fast daran gewöhnt;)

der Trashcan-Mac war nicht so überzeugend und die neue Käsereibe war tatsächlich zu teuer und durch die langen Wartezeiten ist die Hardware dann ja auch schon immer eine Generation veraltet (das Basismodell hat ja eine 170 GPU und kostet über 5000). Ich hoffe, dass Apple den Vorteil, selbst Chiphersteller zu sein, ausnutzt, um den MacPro auch wieder erschwinglicher zu machen.

Dabei sind mir die Design-Elemente, wie 400-Rollen und 1000-Monitor-Ständer nicht so wichtig und ich denke, das Design-Gehampel geht vielen Pro-Usern auch auf den Geist. Meine Mac Pros haben vor 2012 immer um die 4000-5000 gekostet, meine PC-DUAL RTX 2080ti-Workstation hat knapp 5000 gekostet und läuft sehr gut. Für die Apple-Qualität und die Vorteile des Betriebssystems bezahle ich auch gerne 500-1000 mehr, aber eben nicht 5000.

Antwort von markusG:

egmontbadini hat geschrieben:

meine PC-DUAL RTX 2080ti-Workstation hat knapp 5000 gekostet und läuft sehr gut.

Na dann scheinst du ja zumindest keinen Leidensdruck zu haben ;)

Antwort von sehmoment:

Axel hat geschrieben:

rdcl hat geschrieben:

RAW abspielen zu können ist ja jetzt nicht die Messlatte, oder? Das 10bit h265 wäre ein fordernder Codec.

Ist wohl weniger eine Frage der Pferdestärke. 8k H.265 kann der M1 auch, nur verschluckt er sich mW an H.265 10 bit 4:2:2. So war es anfangs auch mit H.264 10-bit der GH5. Eine Frage der Codec-Konformität.

Also was Premiere (native Beta Version) angeht, bin ich momentan vom M1 noch etwas enttäuscht. Playback in einer Premiere Timeline mit GH5 oder S5 h264 422 4k -Material geht leider nicht flüssig. Schnitt also auch nicht. Ist auch einiges schlechter als auf meinem 4 Jahre alten Desktop (AMD 2700x/nvidia 1060ti). Nach dem anfänglichem staunen über den M1 im Netz, hätte ich mir da viel mehr erhofft. Vielleicht wird ja noch irgendwas optimiert in Zukunft.

Antwort von cantsin:

sehmoment hat geschrieben:

Also was Premiere (native Beta Version) angeht, bin ich momentan vom M1 noch etwas enttäuscht. Playback in einer Premiere Timeline mit GH5 oder S5 h264 422 4k -Material geht leider nicht flüssig. Schnitt also auch nicht. Ist auch einiges schlechter als auf meinem 4 Jahre alten Desktop (AMD 2700x/nvidia 1060ti). Nach dem anfänglichem staunen über den M1 im Netz, hätte ich mir da viel mehr erhofft. Vielleicht wird ja noch irgendwas optimiert in Zukunft.

Premiere ist - im Vergleich zu FCPX und Resolve - kaum GPU-optimiert, und die Stärken der M1-Architektur liegen wohl eher in der GPU- als in der CPU-Performance. Insofern würde ich da nicht mehr viel erwarten und für Premiere eher bei Deinem Desktop bleiben (und den nötigenfalls aufrüsten).

Antwort von R S K:

sehmoment hat geschrieben:

Nach dem anfänglichem staunen über den M1 im Netz, hätte ich mir da viel mehr erhofft.

Hat ja auch herzlich wenig mit dem M1 zu tun. PPro auf einem M1 ist als wenn du Kerosin in einen Käfer füllen würdest. Schon auf einem INTEL ist es ein Trauerspiel.

Antwort von Axel:

Hier gibt es schon drei slashCAMer, die ich, äh,

followe, die mit M1-Rechnern und FCP und/oder Resolve über beste Erfahrungen berichten. Aber natürlich

gibt es Grenzen, und darüber wurde berichtet. Spannend wird nun sein zu sehen, ob M2 bzw. M1X diese Grenzen in nennenswerter Weise überwindet. Ich habe meine Zweifel, dass das für mich ein relevanter Unterschied sein würde, der für sich genommen einen mehr als doppelt so teuren Rechner

*(s.u.) rechtfertigen würde. Ich warte aber noch ab, weil ich von anderen Verheißungen angetan bin, so zum Beispiel dem XDR-Display. Sehr wahrscheinlich wird der Preis mich mein Mütchen kühlen lassen. Also z.B. iMac 30 Zoll XDR, wahrscheinlich also 6k, und dann eine Leistung, bei der selbst Data von STNG blass wird?

*Das wäre uuungefähr so wie das seit eineindrittel Jahr erhältliche XDR-Display (5000 Kracher, als ich zuletzt wegskippte) mit intern verbautem NMP. Welches arme Purzel glaubt denn ernsthaft, dass das bei 3000 anfängt? Wenn Schweine fliegen.

Antwort von Funless:

Also ich formuliere es mal ganz platt: So überwältigt ich nach wie vor von der Leistung/Performance/Energieverwaltung meines M1 MB Air nach nun fast drei Monaten exzessiver Dauernutzung bin, bin ich mir absolut sicher, dass der M2 SoC - oder wie er sonst heißen möge - nochmal eine

extrem ordentliche Schippe drauflegen wird. Wie gesagt, platt formuliert.

Antwort von R S K:

Axel hat geschrieben:

Ich warte aber noch ab, weil ich von anderen Verheißungen angetan bin, so zum Beispiel dem XDR-Display. Sehr wahrscheinlich wird der Preis mich mein Mütchen kühlen lassen. Also z.B. iMac 30 Zoll XDR, wahrscheinlich also 6k

Wer Apple auch nur die letzten fünf Jahre halbwegs verfolgt hat, der/die wird wissen, dass die nächste Generation (mit Ausnahme vielleicht des MPs) sich bei allen Basismodellen preislich an der

momentanen Generation ausgerichtet haben. Macht ja auch Sinn, da sie ja nicht ausersehen so viel kosten wie sie kosten. Bei den M1er sind die einen oder anderen sogar ein bisschen

billiger geworden. Wirklich nennenswerte Sprünge (nach oben) gab es aber noch nie. Ergo: sind die momentanen preislich nichts für dich, dann werden es die neuen mit Sicherheit auch nicht sein.

Dass der 27er zum 30er und damit auch zum 6K wird, denke ich ist auch völlig logisch. Ich vermute als iMac mit "normalem" Schirm, als Pro evtl. mit bereits integriertem XDR als BTO? Vielleicht auch ein XDR mit "nur" 1000 nits peak (nur "DR"? 😛) um es eben in einer vertretbaren Preisregion zu halten und sich nicht selbst das Geschäft mit dem "großen" abzugraben.

Aber wem die momentanen rein von der Performance her gesehen für 99% was heute in der Videobearbeitung typisch ist nicht ausreichen, die dürfen mir gerne verraten was es ist was sie anstellen. Und ja, sobald die M-xyz irgendwas kommen die NICHT im Ursprung für Telefone und Pads, sondern tatsächlich für

Desktops gedacht und konzipiert sind, also u.a. ordentlich AKTIV gekühlt werden können, dürfte es denke ich erst recht richtig abgehen.

Wir werden's sehen. 🤷🏼???

Antwort von sehmoment:

cantsin hat geschrieben:

sehmoment hat geschrieben:

Also was Premiere (native Beta Version) angeht, bin ich momentan vom M1 noch etwas enttäuscht. Playback in einer Premiere Timeline mit GH5 oder S5 h264 422 4k -Material geht leider nicht flüssig. Schnitt also auch nicht. Ist auch einiges schlechter als auf meinem 4 Jahre alten Desktop (AMD 2700x/nvidia 1060ti). Nach dem anfänglichem staunen über den M1 im Netz, hätte ich mir da viel mehr erhofft. Vielleicht wird ja noch irgendwas optimiert in Zukunft.

Premiere ist - im Vergleich zu FCPX und Resolve - kaum GPU-optimiert, und die Stärken der M1-Architektur liegen wohl eher in der GPU- als in der CPU-Performance. Insofern würde ich da nicht mehr viel erwarten und für Premiere eher bei Deinem Desktop bleiben (und den nötigenfalls aufrüsten).

Da Premiere auf Apple-Basis ab jetzt ja "nur" noch für M1-Platformen optimiert werden dürfte, erwarte ich da schon was. Zumal das gleiche h264 4k 422 Gh5/S5-Footage im Quicktime-Player gut läuft. In Premiere läufts auch in Echtzeit ruckelfrei. Aber sobald da zb ein einfaches Grading draufliegt, wirds schwieriger, was ich nicht erwartet habe. Meinen PC Desktop werde ich auch weiter als Hauptrechner mit Premiere nutzen. Aber gerade für die Vorarbeit unterwegs oder im Homeoffice (Rohschnitte etc) hab ich mir das Macbook geholt. Zum ernsthaften Schneiden gehts im Premiere aktuell nur mit Proxies leider. Und genau das wollte ich mit dem M1 eigentlich umgehen.

Antwort von R S K:

sehmoment hat geschrieben:

Da Premiere auf Apple-Basis ab jetzt ja "nur" noch für M1-Platformen optimiert werden dürfte, erwarte ich da schon was. Zumal das gleiche h264 4k 422 Gh5/S5-Footage im Quicktime-Player gut läuft. In Premiere läufts auch in Echtzeit ruckelfrei. Aber sobald da zb ein einfaches Grading draufliegt, wirds schwieriger, was ich nicht erwartet habe

Auch da wieder: Kerosin. Du kannst auch breite Puschen an deinen Käfer machen, aber wenn alles andere unter der Haube nicht mithalten kann

wozu?

Es gehört eben

weit mehr als einfach nur eine

M1 Optimierung dazu und Adobe ist da noch weit von entfernt im Vergleich zu den meisten anderen. Höchstens AVID ist da noch schlechter dran.

Antwort von Axel:

sehmoment hat geschrieben:

Meinen PC Desktop werde ich auch weiter als Hauptrechner mit Premiere nutzen. Aber gerade für die Vorarbeit unterwegs oder im Homeoffice (Rohschnitte etc) hab ich mir das Macbook geholt. Zum ernsthaften Schneiden gehts im Premiere aktuell nur mit Proxies leider. Und genau das wollte ich mit dem M1 eigentlich umgehen.

Wenn man bedenkt, dass Adobe eine reine Software-Firma ist, die noch dazu das meiste für ihre gediegene Melange berappen, monatlich. Die hatten genau so lange Zeit wie alle anderen, sich auf den Chip einzustellen. Ist aber wohl auch nicht so banal. Man kann ein Haus nur so und so oft renovieren, bevor eine Kernsanierung nötig wird.

Antwort von andieymi:

Axel hat geschrieben:

Ist aber wohl auch nicht so banal. Man kann ein Haus nur so und so oft renovieren, bevor eine Kernsanierung nötig wird.

Bezogen auf Premiere ist das ja das eigentliche Problem. Da waren etliche andere einfach schon weiter, bevor dann die M1 Problematik dazukam.

Antwort von Jott:

Die Empörung, dass Apple genau das gemacht hatte - Software mit völlig veraltetem Code aus dem letzten Jahrhundert den Gnadenschuss zu geben - führte vor zehn Jahren zu einem riesigen Aufschrei und bring manche noch heute auf die Barrikaden.

Könnte mir schon vorstellen, dass Adobe daher Schiss hat, den gleichen Schritt zu gehen. Und so lange die Abozahlen nicht zurück gehen, interessiert Querulanten-Gemaule sowieso nicht.

Antwort von sehmoment:

Jott hat geschrieben:

Die Empörung, dass Apple genau das gemacht hatte - Software mit völlig veraltetem Code aus dem letzten Jahrhundert den Gnadenschuss zu geben - führte vor zehn Jahren zu einem riesigen Aufschrei und bring manche noch heute auf die Barrikaden.

Könnte mir schon vorstellen, dass Adobe daher Schiss hat, den gleichen Schritt zu gehen. Und so lange die Abozahlen nicht zurück gehen, interessiert Querulanten-Gemaule sowieso nicht.

Ich glaube, es wäre auch nicht klug für Adobe, es Apple nachzumachen, denn dann würde Sie ja Ihre Pro-Kunden verscheuchen, wie Apple das gemacht hat. Ich bin jedenfalls froh dass es nicht so gekommen ist. Apple konnte sich diesen Fehler erlauben, da die ja für lange Zeit eher hochpreisige Lifestyle-Produkte verkaufen wollten, die die Kohle einbrachten. Vielleicht ändern die sich ja mal irgendwann. So ganz glaub ich noch nicht dran ;-)

Antwort von Jott:

Da ist sie wieder, die zehn Jahre alte Geschichte. Werden auch noch unsere Enkel zu hören bekommen.

Adobe verscheucht auf Dauer die Profis ganz von selber, wenn sie ihren alten Tanker nicht auch flott machen.

Denn neben dem modernen fcp gibt es ja vor allem noch Blackmagic, die sich nicht zu schade sind, Apples Hardware-Strategie flott mitzugehen. Die obendrein sicher kopiert werden wird.

Man spricht gerne abfällig über die gerade mal 10% Marktanteil (PC) von Apple. In der Medienbranche ist er aber deutlich höher. Blackmagic weiß schon, warum sich das Kuscheln mit Apple lohnt. Und warum sie auf Messen nur Macs aufbauen.

Aber egal, Adobe ist selber erwachsen.

Antwort von markusG:

Jott hat geschrieben:

Man spricht gerne abfällig über die gerade mal 10% Marktanteil (PC) von Apple. In der Medienbranche ist er aber deutlich höher.

Das ist ebenso inzwischen nicht mehr so relevant. Zumindest außerhalb von Print ist Apple längst nicht mehr die "to go" Lösung die es mal war, wenn man sich mal in anderen Medienbereichen umschaut (z.B. auch Gaming Entwicklung). Scheinbar ist es Adobe auch egal, zumindest ist die stiefmütterliche Betreuung - abseits von iOS Bemühungen - nicht erst seit dem Umschwung auf den M1. Und spätestens mit Apples Abkehr von Nvidia oder OpenGL/Vulkan sind auch die 3D-Zöpfe abgeschnitten worden.

Wohin die Reise gehen wird ist jedenfalls ziemlich wirr. Da ist es dann erfreulich dass mit Blackmagic und Serif (Affinity) "neuerdings" interessante Partner auf der Bühne sind. Bei reinem Adobe würde ich persönlich von der Mac-Plattform abraten (wie gesagt mit Ausnahme von Print), es sei denn man hat andere Gründe die wichtig genug sind.

Antwort von Jott:

Warum aber bietet dann Adobe sein Zeug überhaupt für die Mac-Loser an? Könnten sie ja auch bleiben lassen, wie früher schon einmal.

Nur Adobe dürfte wissen, welchen Anteil die Mac-Versionen heute haben. Wurde das mal veröffentlicht? Wäre interessant zu wissen. Also quasi die Deppenquote! :-)

Antwort von Frank Glencairn:

markusG hat geschrieben:

Zumindest außerhalb von Print ist Apple längst nicht mehr die "to go" Lösung die es mal war,

Ich bin ja seit 2000/2001 von Apple weg, und beobachte das ganze deshalb nur am Rande,deshalb die Frage: was macht

Apple bei Print noch die to-go Lösung?

Antwort von motiongroup:

"Frank Glencairn" hat geschrieben:

markusG hat geschrieben:

Zumindest außerhalb von Print ist Apple längst nicht mehr die "to go" Lösung die es mal war,

Ich bin ja seit 2000/2001 von Apple weg, und beobachte das ganze deshalb nur am Rande,deshalb die Frage: was macht

Apple bei Print noch die to-go Lösung?

?? Sorry ?? aber das verstehe wer will, ich nicht

Ich bin nun seit 2011 von Windows weg und spar mir das beobachten.

Antwort von Frank Glencairn:

Ich bin da völlig OS agnostisch - an dem Tag an dem mir Apple irgendwas anbietet, was mein Leben gegenüber Windows verbessert, bin ich wieder zurück (und umgekehrt), deshalb hab ich immer auch ein Auge darauf. Was gibt's da nicht zu verstehen?

Antwort von motiongroup:

was macht Apple bei Print noch die to-go Lösung?

Dieses Konstrukt

Agnostisch beim Os ist natürlich eine persönliche Einstellung die ich privat gar nicht teile und Beruflich noch nicht beeinflussen kann und somit immer noch an Windows, MS Office usw. geknebelt bin. Langsam aber spürbar regt sich Widerstand und sie wechseln ins open source Lager und die Pakete die noch nicht ersatz bieten werden extern via citrix abgearbeitet.

Privat und im Homeoffice läuft alles auf Linux, MacOs und IpadOs weil ich damit alles abgedeckt habe und auch den Datenschutz so gut als möglich abgedeckt habe. Das ist mir LEIDER mit Android und MS nicht möglich und kann LEIDER nicht umschifft werden um gleichen Atemzug auch Apples Engagement in Sachen Datenschutz nicht unumstritten sehe.

Antwort von Cinemator:

Apple war und ist seit eh und je Print Domäne. In Werbeagenturen, Verlagen etc. Anfangs auch beim Pro Bewegtbild, bis man den Markt für zu klein hielt. Ich kann mir aber vorstellen, dass Apple demnächst mit einem großen M-Paukenschlag wieder aufholen wird. Der Klöppel hat mit M1 ja schon ausgeholt. Ich möchte sowieso mit nichts anderem arbeiten und die Deppenquote weiterhin unterstützen. Jetzt schon seit 25 Jahren :-)

Antwort von markusG:

Jott hat geschrieben:

Warum aber bietet dann Adobe sein Zeug überhaupt für die Mac-Loser an? Könnten sie ja auch bleiben lassen, wie früher schon einmal.

Adobes Wege sind unergründlich...aber selbst wenn sie in der Minderheit wären (Mac-User), wäre es ja immer noch Einnahmen. Ich gehe aber davon aus dass es mehr Print-Leute als im Videobereich gibt, von daher sehe ich da kein Problem.

Jott hat geschrieben:

Nur Adobe dürfte wissen, welchen Anteil die Mac-Versionen heute haben.

Wieso sollte das einen interessieren? Ist doch ne rein akademische Betrachtung. Für den Alltag muss man nur wissen ob es Inkompatibilitäten gibt, und die gibt es im Jahre 2021 tatsächlich immer noch (!).

"Frank Glencairn" hat geschrieben:

Ich bin ja seit 2000/2001 von Apple weg, und beobachte das ganze deshalb nur am Rande,deshalb die Frage: was macht

Apple bei Print noch die to-go Lösung?

Eine objektive Antwort kann ich dir nicht geben, ich habe nie in dem Bereich - zumindest auf professioneller Ebene - gearbeitet. Früher war es ja angeblich sowas wie PDF Integration oder überlegenes Farbmanagement und Software (QuarkXPress war ja anfangs Mac-only und marktdominierend). Subjektiv (in meinem Umfeld) ist es eher eine Gewohnheitsfrage, bzw. "Tradition". Die Ausbilder/Profs sind mit Apple quasi groß geworden und haben das an die Zöglinge weitergegeben.

Und ja, das geht über die Anwendungen hinaus. Das sind so vermeintliche Banalitäten wie der Finder. Bis heute gibt es keine adäquaten Ersatz (unter Windows) für das simple Taggen/Farbkodieren, oder die Columns View.; oder wo man Einstellungen findet. Dass man oben links die Fensterkontrollen hat (und in die andere Richtung: das Fenstermanagement von Windows). Oder inzwischen Gestensteuerung (Stichwort Muscle Memory). Das sind mMn hochgradig subjektive Dinge. Und wenn es im Gegensatz zu Videoanwendungen keine nennenswerten Nachteile gibt - wieso dann wechseln. "Hat man schon immer so gemacht". Eigentlich der gleiche Grund warum Windows im Corporate Bereich nach wie vor so beliebt ist (oder bei Ingenieuren).

Privat und im Homeoffice läuft alles auf Linux

Das wird auch demnächst mein Ziel. Allerdings mit Windows in einer VM (falls das nicht zu kompliziert ist) für Software die sonst nicht (gescheit) laufen wird. Soll ja leichter sein als MacOS da grundlegend dafür ausgelegt? Und da ich keine Ambitionen habe auf Final Cut umzusteigen...

Ich kann mir aber vorstellen, dass Apple demnächst mit einem großen M-Paukenschlag wieder aufholen wird.

Ich bin da noch total zwiegespalten. Auf der einen Seite finde ich dieses Leistung/Watt eigentlich total gut, gleichzeitig mag ich aber die Firmenphilosophie nicht; es ist für mich reines Greenwashing. Und auch das Walled Garden finde ich eigentlich eher nicht so geil. Dennoch bin ich gespannt was Apple da zaubert, beruflich kann ich mir das schon eher vorstellen und bin da wie Frank Systemagnostisch.

Das ist mir LEIDER mit Android und MS nicht möglich

Ersetze Android mal durch Google ;) Android an sich ist ja afaik FOSS und gibt es auch als datenschutzzentrische Distributionen.

Antwort von motiongroup:

Brauchst ja nicht auf fcp umzusteigen resolve, lwks und viele andere sind verfügbar

Android ist Foss oder irgendwie doch nicht und schon gar nicht praktikabel für die 0815 er wie mich. Das gilt ebenso für Linux bei mir.

Linux als Iso gezogen muss funktionieren wie osx outoffthebox, Konsole ist nett aber outdated

Der nächste Rechner wird ein PopOs clone auf Basis vom NUC und wenn die Gpus wieder erschwinglich werden kommt ne amd statt der NV in den alten Desktop

Antwort von markusG:

motiongroup hat geschrieben:

Brauchst ja nicht auf fcp umzusteigen resolve, lwks und viele andere sind verfügbar

Das war halt "damals" in meiner Ausbildung DER Grund für nen Mac. Genau wie 3DS Max für nen PC.

motiongroup hat geschrieben:

nicht praktikabel für die 0815 er wie mich.

Mit Verlaub - über das 0815 Stadium bist du wohl schon hinaus ;) 0815 Menschen installieren gar nix, da muss das vorinstalliert sein. Für Android wäre das z.B. /e/:

https://esolutions.shop/

Das gleiche gilt ja für Linux:

https://www.youtube.com/watch?v=tpXAnRJeGMU

ChromeOS macht es ja vor...

Antwort von cantsin:

markusG hat geschrieben:

"Frank Glencairn" hat geschrieben:

Ich bin ja seit 2000/2001 von Apple weg, und beobachte das ganze deshalb nur am Rande,deshalb die Frage: was macht

Apple bei Print noch die to-go Lösung?

Eine objektive Antwort kann ich dir nicht geben, ich habe nie in dem Bereich - zumindest auf professioneller Ebene - gearbeitet. Früher war es ja angeblich sowas wie PDF Integration oder überlegenes Farbmanagement und Software (QuarkXPress war ja anfangs Mac-only und marktdominierend). Subjektiv (in meinem Umfeld) ist es eher eine Gewohnheitsfrage, bzw. "Tradition". Die Ausbilder/Profs sind mit Apple quasi groß geworden und haben das an die Zöglinge weitergegeben.

Ich kann das zumindest aus Hochschulperspektive beantworten. Wenn Studenten auf Macbooks arbeiten, kann man einigermaßen sicher davon ausgehen, dass es eine konsistente Plattform gibt, die Bildschirmdarstellung gut ist und die Hardware adäquat. Würden die Studenten auf Windows-Laptops arbeiten, gäbe es allerlei Kompatibilitäts- und Supportprobleme, und vor allem das Problem, dass viele Studenten sich dann Laptops mit für graphisches Arbeiten ungeeigneten TN-Displays kaufen würden, mit zu schwachbrüstigen Atom/Celeron/Pentium-CPUs, eingeschränkten Windows-Versionen (wie Windows 10 S) etc.etc.

Der Alptraum der Apple-Platform wiederum ist, dass gefühlt mit jeder Macbook-Generation der Bildschirmanschluss wechselt und man in jedem Seminarraum ca. halbes dutzend verschiedener Dongles bereithalten muss, um Macbooks an einen Projektor oder Flatscreen-TV anzuschließen.

Ein weiteres Kriterium ist, dass die Schrift-/Fontdarstellung bei MacOS optisch maximal an die Printausgabe angelehnt ist - ein gestaltetes Dokument sieht auf dem Bildschirm aus wie später auf dem Papier -, während der Windows-Font-Renderer aggressiv für Bildschirmlesbarkeit optimiert und Schriften dadurch auf dem Bildschirm schlanker/schärfer/pixeliger macht als später auf dem Papier. Ich kenne einige Grafikdesigner, die sagen, dass sie aus diesem Grund nicht mit Windows arbeiten können.

Antwort von Frank Glencairn:

markusG hat geschrieben:

Das sind so vermeintliche Banalitäten wie der Finder.

Verstehe.

Solche Sachen tangieren mich allerdings kaum

Ich seh mein OS den ganzen Tag nicht (da kann man leicht OS agnostisch sein), bestenfalls bei sowas trivialen wie Dateien kopieren,

und da macht der Explorer (wenigstens für mich) auch was er soll - ist bei mir deshalb also eher ein no-brainer, ob Finder oder Explorer.

Aber mei - andere haben da halt andere Anforderungen, is ja schön daß es für jeden was gibt.

Antwort von markusG:

"Frank Glencairn" hat geschrieben:

Ich seh mein OS den ganzen Tag nicht (da kann man leicht OS agnostisch sein), bestenfalls bei sowas trivialen wie Dateien kopieren,

und da macht der Explorer (wenigstens für mich) auch was er soll - ist bei mir deshalb also eher ein no-brainer

In Adobe z.B. ist der Explorer ja "integriert" was Dateimanagement anbelangt. Da nervt allein sowas dass es die Favoriten aus Win7 unter Win10 nicht mehr gibt, man also angepinnte Ordner nicht umbenennen kann (außer die Ordner selbst). Das kann je nach Arbeitsweise richtig nerven - warum das vielfach beschriebene Problem bis heute (6 Jahre nach Veröffentlichung...) nicht gelöst wurde, stattdessen so tolle Dinge wie "News and Interests" implementiert werden...

Oder dass immer noch Dateien in Netzwerkfreigaben geblockt werden wegen der Thumbnail-Datei. In 2021. Standardmäßig keine langen Pfade eingeschaltet sind. Gibt da sicher noch zig andere Dinge die mir gerade nicht spontan einfallen. Also gaaaanz unwichtig finde ich es nicht.

"Frank Glencairn" hat geschrieben:

Aber mei - andere haben da halt andere Anforderungen, is ja schön daß es für jeden was gibt.

DAs stimmt prinzipiell. Ist halt blöd wenn der Arbeitgeber was anderes vorgibt als man gewöhnt ist (und bei dem man effizient arbeitet). Da gibt es dann Wachstumsschmerzen. Erfahrungsgemäß wird egal in welche Richtung immer der Schrei nach einer IT Abteilung kommen. Egal "woher man kommt" oder was eingesetzt wird.

Agnostik und Eigeninitiative ist aber auf jeden Fall wertvoll und hat mir schon hier und da den Arsch gerettet, während die Fraktion "ich will meinen Computer nur einschalten und nutzen" total verloren war.

p.s.: da du ja schon länger dabei bist - hast du auch früher mal mit dem Amiga gearbeitet?

Antwort von Frank Glencairn:

markusG hat geschrieben:

In Adobe z.B. ist der Explorer ja "integriert" was Dateimanagement anbelangt. Da nervt allein sowas dass es die Favoriten aus Win7 unter Win10 nicht mehr gibt, man also angepinnte Ordner nicht umbenennen kann (außer die Ordner selbst). Das kann je nach Arbeitsweise richtig nerven - warum das vielfach beschriebene Problem bis heute (6 Jahre nach Veröffentlichung...) nicht gelöst wurde, stattdessen so tolle Dinge wie "News and Interests" implementiert werden...

Ja. ich weiß was du meinst - nervt natürlich, aber trotzdem ist es für mich eigentlich keine Herausforderung meine Dateien zu finden.

Windows (10) geht mir allerdings seit einer ganzen Weile gehörig auf den Sack - nicht wegen der Oberfläche oder Bedienung, das ist mir eigentlich weitgehend wurscht, sondern weil es sich immer mehr zu einem Trojaner mit angeschlossenem Betriebssystem hin entwickelt.

Ich bin der altmodischen Auffassung, daß meine Rechner Redmond einen Scheißdreck angehen, und daß die ungefragt und ungewollt hinter meinem Rücken irgendwelche Dateien auf meinen Rechnern ändern (Updates) ist für mich ein absolutes no-go - jegliche Telemetrie sowieso.

Aktuell bin ich noch in der Lage das OS halbwegs so zu härten (und den meisten Bullshit abzustellen oder zu löschen), daß die da ihre Finger davon lassen müssen, und die Versuche ins Leere laufen, aber es wird immer schwieriger.

Ja, nach dem Synclair ZX81 (mein erster Rechner) hatte ich einen Amiga - ich glaub der hatte noch nicht mal ne Festplatte.

Antwort von mash_gh4:

"Frank Glencairn" hat geschrieben:

Ja, nach dem Synclair ZX81 (mein erster Rechner) hatte ich einen Amiga - ich glaub der hatte noch nicht mal ne Festplatte.

wunderbar! -- ich hab auf genau diesem gerät vor sehr langer zeit auch meine ersten programmiererfahrungen gesammelt, irgendwann auch Z80-assembler gelernt und sogar externe hardware dafür gebastelt, um einen alten elekromotorischen fernschreiber als drucker daran nutzen zu können...

später habe ich dann lange zeit auch auf macs gearbeitet, und die dort verbauten 68K prozessoren sehr geschätzt.

leider hat halt apple im zuge seiner häufigen prozessorerwechsel immer wieder gezeigt, dass es mit der jeweiligen wahl zwar im grunde ausgesprochen gute hardware herausgegriffen hat, die aber fast immer gerade zum zeitpunk des wechsels bereits den zenit überschritten haben. ähnlich würde ich den aktuellen wechsel zu ARM sehen, der zwar grundsätzlich natürlich spannend ist, aber eben gerade zu einem zeitpunkt passiert, wo die zunkunft dieser architektur durch die nvidia-übernahme relativ ungewiss ist, während das wirklich interessante und zukunftsweisende geschehen in puncto prozessorentwicklung sich gegenwärtig immer mehr rund um die verschiedensten RISC-V ausformungen konzentriert.

Antwort von markusG:

"Frank Glencairn" hat geschrieben:

Windows (10) geht mir allerdings seit einer ganzen Weile gehörig auf den Sack - nicht wegen der Oberfläche oder Bedienung, das ist mir eigentlich weitgehend wurscht, sondern weil es sich immer mehr zu einem Trojaner mit angeschlossenem Betriebssystem hin entwickelt.

Das ist leider ein generelles Problem 8auch beim Mac), insbesondere wenn es dann die Anwendungssoftware macht - ja ich rede von Adobe...

Deswegen auch meine "Idee" irgendwann Windows maximal in einer VM laufen zu lassen, für die Apps die es nicht unter Linux gibt, und dann auch maximal möglich gehärtet.

Antwort von mash_gh4:

markusG hat geschrieben:

Deswegen auch meine "Idee" irgendwann Windows maximal in einer VM laufen zu lassen, für die Apps die es nicht unter Linux gibt, und dann auch maximal möglich gehärtet.

ja -- das geht im prinzip schon. ich z.b. resolve lange zeite in dieser weise genutzt, bevor die linux-version allgemein zugänglich wurde.

von der performance her kommt man damit beinahe an die native nutzung heran. wirklich problematisch ist nur das durchreichen der GPUs an die virtuellen maschinen, das sich noch immer relativ kompliziert gestaltet.

leider sind ja macs auch für diese form der nutzung eine deutlich problematischere ausgangsbasis als linux-workstations, weil es unter macOS mit den paravirtualisierungsvoraussetzungen, wie man sie für eine befriedigend effiziente abwicklung derartiger szenarien unbedingt benötigt, vergleichsweise erbärmlich aussieht.

Antwort von cantsin:

"Frank Glencairn" hat geschrieben:

Ja, nach dem Synclair ZX81 (mein erster Rechner) hatte ich einen Amiga - ich glaub der hatte noch nicht mal ne Festplatte.

Oh Mann, langsam glaube ich, dass wir hier an einem Altherren-Stammtisch sitzen!

Bei mir: Sinclair ZX81 -> Atari ST (auch ohne Festplatte) -> Mac (MacOS 7, Motorola) -> Linux (ab Kernel 2.0/Debian 1.3) in agnostischen Kombis mit Windows + Mac OS.

Eigentlich nervt es nur noch, dass man wegen bestimmter Software bestimmte Betriebssysteme braucht, weil sich heutzutage eigentlich alle Software OS-unabhängig entwickeln lässt (es sei denn, sie ist wie z.B. FCPX hochgradig auf eine bestimmte Plattform optimiert, was aber fast nie der Fall ist).

Antwort von Frank Glencairn:

cantsin hat geschrieben:

Oh Mann, langsam glaube ich, dass wir hier an einem Altherren-Stammtisch sitzen!

Aber echt :D

Bei mir war's der Synclair (seitenweise Listings in 2 Punkt Schrift abgetippt. und dann die Tippfehler gesucht - auch 'n Hobby).

Danach der ST, und dann direkt zum original Macintosh (muß so um 1985 rum gewesen sein) - wir haben damals das erste deutsche Magazin in "Desktop Publishing" raus gebracht (Aldus PageMaker). Später war ich einer der ersten hier, der (mit einem völlig umgebauten Mac) 3D Animationen in einem Rutsch auf Betacam ausgeben konnte - vorher wurde jeweils immer nur ein Halbbild übertragen, mit entsprechenden Folgen für die Mechanik. Bin dann bis 2000 rum bei Apple geblieben, kurzer Abstecher auf einen DEC-Alpha (RISC) Rechner namens Raptor mit einem speziellen NT, und danach nur noch selbstgebaute Win Workstations bis heute.

Antwort von mash_gh4:

cantsin hat geschrieben:

Oh Mann, langsam glaube ich, dass wir hier an einem Altherren-Stammtisch sitzen!

Bei mir: Sinclair ZX81 -> Atari ST (auch ohne Festplatte) -> Mac (MacOS 7, Motorola) -> Linux (ab Kernel 2.0/Debian 1.3) in agnostischen Kombis mit Windows + Mac OS.

endlich einmal etwas, wo einem die langsam immer grauer werdenden, aber zumindest noch immer genauso langen und widerspenstigen, haare zum vorteil gereichen! ;)

bei mir war es nämlich noch MacOS 6 -- also noch vor der multitaskingfähikeit --, bald aber natürlich auf dem 68030 AUX und MPW (=macintosh programmers workshop) auf OS 7, was beides bereits fast so faszinierend war wie das frühe linux.

letzteres hab ich dann allerdings auch lange vor dem offizellen erscheinen der kernel version 1.0 kennengelernt.

konkret hat sich das so abgespielt, dass irgendwann einmal auf einem unserer point-treffen unter wiener fido-net-kumpanen, ein gewisser c.m. (der ein paar jahre später als ersten kommerzieller internetprovider für privartkunden hier in österreich in erscheinung getreten ist) dem a.t. (in dessen wohung damals ein ganzes zimmer voller telefonmodems den kern unserer spielereien bzw. die anknüfung an das weltweite fido-net gebildet hat, und der später leitend für die landesweite domainverwaltung und die mail server der uni-wien verantwortlich war, aber auch heute noch eine ganz zentrale rolle bei der absicherung und krisenbewältigung im nationalen wissenschaftsnetz und zentralen internetknoten spielt) eine kleine packung mit 3.5" diskettten zugeschoben hat -- so wie man sonst eher nur irgendwelche glücklichmachenden rauschmittel freundschaftlich geteilt hat --, und dazu gemeint hat: "das musst du unbedingt ausprobieren: linux!"

obwohl ich das eigentlich nur am rande mitbeobachtet hab, war natürlich auch meine neugierde geweckt, was sich damals aber leider, trotz SLS (= linux soft landing system), noch nicht ganz so einfach und benutzerfreundlich gestaltet hat, aber dafür hat man auf diesem weg wenigstens fast unvermeidlich auch als anwender ordenlich C programmieren gelernt. ;)

in meinen fall hat sich dann mehr od. weniger durch einen zufall eine weitere wende ergeben, die praktisch mein ganzes weiteres leben bestimmt hat:

ich bin wieder zurück in meine provinzheimat und wollte eigentlich nur mein philosophiestudium an der dortigen uni endlich zu einem abschluss bringen, aber dabene halt auch mit meiner freundin chatten, die in der ferne auf mächtigen SGIs in den EDV-labs der architektur als 3D- und visualisierungsexpertin ihr unwesen getrieben hat. so bin ich dann irgendwann zum ZID (zentralen informatikdienst) der hiesigen uni gepilgert, um mir einen account auf deren servern zu beschaffen. dort war man aber den geisteswissenschaftern gegenüber nicht besonders wohlwollend gesinnt, weil die großen zentralen server gefälligst dem ernsthaften rechnen im zusammenhang mit naturwissenschaftlichen aufgabenstellungen vorbehalten bleiben sollten und nicht von irgendwelchen chaoten zweckentfremdet werden sollten. also hat man mich an einen wintzgen arbeitsraum für die geisteswissenschaftliche fakultät verwiesen, wo ein paar PCs herumgestanden sind, die praktisch nur als elektrische schreibmaschine genutzt wurden, um texte bzw. abschlussarbeiten zu verfertigen. der dort zuständige betreuer hat mich zuerst recht fragend angeschaut, als ich meinen wunsch geäußert habe, einen zugang zum internet zu bekommen. dann hat er aber gemeint, dass es zwar vielleicht möglich sein könnte, dass die geräte tatsächlich mit dem großen netz verbunden wären, weil sie ja zumindest alle mit einem stecker bzw. coaxkabel an der wand verbunden wären, aber ob man damit wirklich auch mit anderen geräten außerhalb kontakt aufnehmen kann, hat bisher noch niemand ausprobiert. so hab ich dann einfach das nötigste an software auf einem alten rechner im eck installiert und alle zum stauen gebracht, was mit diesen geräten ineuerdings möglich ist. und weil alle so fasziniert davon waren, hab ich dann irgendwann einen abendlichen studentischen vortrag über dieses noch völlig unbekannte "internet" gehalten, wo ich dann quasi aus schrott und augesmusterten alten geräten zu demonstrationszwecken einen kleinen linux-server mit einem der allerersten WWW-server weltweit aufgesetzt habe, um das ein bisserl realistischer vorführen zu können. dieses ding hat so wunderbar funktioniert, dass wir es nach diesem event auch einfach weiterlaufen lassen und alle damit spielen lassen haben. mit der zeit wollten dann auch immer mehr kollegen von außerhalb zugang zu diesem winzigen server, weil selbst die nutzung per telnet auf einer solchen unix-server wesentlich praktischer und angenehmer war als die VAX am ZID. so ist das ganze dann relativ schnell zum zweitgrößten server an der uni mit ein paar tausend aktiven benutzern und einigen telefonmeodems dran herangewachsen. ich selber bin damit ganz ungeplant auch immer mehr in die rolle eines systemadministrators hineingewachsen, auch wenn ich daneben vor allem künstlerische performances im netzumfeld mit gleichgesinnten realisiert habe. so ist dann irgendwann aus dieser ganzen geschichte auch ein spin-off entstanden, dass künstlern und kulturinitiativen ähnliche arbeitsmöglichkeiten bzw. adäquaten anbindung ans österreichischen wissenschaftsnetzwerk erlauben sollte -- eine einrichtung, die es bis heute gibt...

cantsin hat geschrieben:

Eigentlich nervt es nur noch, dass man wegen bestimmter Software bestimmte Betriebssysteme braucht, weil sich heutzutage eigentlich alle Software OS-unabhängig entwickeln lässt (es sei denn, sie ist wie z.B. FCPX hochgradig auf eine bestimmte Plattform optimiert, was aber fast nie der Fall ist).

meiner beobachtung nach haben sich großen betriebsysteme mittlerweile so weit aneinander angenähert bzw. von einander gelernt, dass die unterschiede kaum mehr der rede wert sind. es ist wirklich fast nur den strategischen überlegungen der hersteller überlassen, die kompatibilität ständig wieder ein wenig einzuengen od. zu verunmöglichen. mir ist es also in der praxis auch ziemlich gleichgültig, welche geschmacksrichtung jemand persönlich bevorzugt und nutzt. auch viele jener heutigen linux- und GNU-software-user, die nicht wirklich programmieren können, aber ihre laptops mit umengen an pinguin-stickern schmücken, sind mir längst kaum weniger suspekt wie unkritische markengläubige apple-, sony-, BMD- od. XY-modefetischisten.

für mich ist noch immer jene "freiheit", dinge tatsächlich abzuändern und erweitern zu können bzw. spezielle software und werkzeuge für künstlerische aufgabenstellungen entwicken zu können, für die es noch nichts fertiges käuflich in den regalen gibt, das wirklich spannende an freier software und offen betriebsystemen.

dinge einfach nur zu "benutzen" und nicht auch in ihren inneren gesetzten zu hinterfragen, widerspricht einfach jener ganz substanziellen bestimmung der kunst, die spätestens seit kants kritik der urteilskraft gerade in ihrer losgelöstheit von einem vorgegeben zweck bzw. der bloßen erfüllung von vorgegebenen zielsetzungen und interessen ein freies spiel praktizieren muss. nur damit kann sie eine vorbildwirkung bzw. alternativen zum restlich uns umgebenden zweck-rationalen alltagsgetriebe aufzeigen.

Antwort von motiongroup:

Oh Mann, langsam glaube ich, dass wir hier an einem Altherren-Stammtisch sitzen!

Tun wir doch und schlecht find ich das überhaupt nicht

Ohh doch Markus, ich bin ein 0815er und habe in meinem Leben viel zu viel Zeit mit dem how to zugebracht.

Antwort von cantsin:

mash_gh4 hat geschrieben:

so bin ich dann irgendwann zum ZID (zentralen informatikdienst) der hiesigen uni gepilgert, um mir einen account auf deren servern zu beschaffen. dort war man aber den geisteswissenschaftern gegenüber nicht besonders wohlwollend gesinnt, weil die großen zentralen server gefälligst dem ernsthaften rechnen im zusammenhang mit naturwissenschaftlichen aufgabenstellungen vorbehalten bleiben sollten und nicht von irgendwelchen chaoten zweckentfremdet werden sollten. also hat man mich an einen wintzgen arbeitsraum für die geisteswissenschaftliche fakultät verwiesen

Tja, das sind Parallelen und deja vus unserer Altherren-Biografien. Genauso lief's bei mir auch, im Jahr 1991. Ich brauchte einen persönlichen Brief vom Dekan der philosophischen Fakultät, um in die Rechnerzentrale gelassen zu werden. Dort hatte man aber den Schritt zu Unix und SGI noch nicht gemacht, sondern es liefen IBM-Mainframes mit IBMs eigenem VM/CMS-Betriebssystem (nicht zu verwechseln mit VMS/Vax!), dessen Terminalinterface auf einer Lochkarten-Simulation beruhte, und das ich erst einmal wie eine Programmiersprache lernen musste, um überhaupt ins Netz zu kommen...

Antwort von mash_gh4:

cantsin hat geschrieben:

Tja, das sind Parallelen und deja vus unserer Altherren-Biografien. Genauso lief's bei mir auch, im Jahr 1991. Ich brauchte einen persönlichen Brief vom Dekan der philosophischen Fakultät, um in die Rechnerzentrale gelassen zu werden. Dort hatte man aber den Schritt zu Unix und SGI noch nicht gemacht, sondern es liefen IBM-Mainframes mit IBMs eigenem VM/CMS-Betriebssystem (nicht zu verwechseln mit VMS/Vax!), dessen Terminalinterface auf einer Lochkarten-Simulation beruhte, und das ich erst einmal wie eine Programmiersprache lernen musste, um überhaupt ins Netz zu kommen...

ja! -- das war bei mir auch exakt gleich. ich hab zu diesem zeitpunkt auch nur durch die fürsprache und schriftliche bestätigung eines philosophprofessors meinen ersten zugang zum mainframe auf der wiener uni bekommen, der damals noch ans "bitnet" -- also fast schon "internet" -- angebunden war und auch nur via IBM3270-terminalemulation bedienbar war, wo ich meine ersten eindrücke im zusammenhang mit diesen größeren maschinen erfahren sollte. ;)

allerdings ist das dann natürlich alles sehr schnell gegangen. in der praxis hat sich das so ausgewirkt, dass ich in einem größeren künstlerkollektiv genau diese kommunikation via TCP/IP, was zu diesem zeitpunkt ja noch die alleinige definition für das "internet" dargestelt hat, in unseren projekten genutzt habe, und damit schritt für schritt die zuvor verwendeten übertragungen per MIDI-protokoll getunnelt durch punkt-zu-punkt telefon-modem-links abgelöst habe. jener kollege in unsere gruppe, der diese MIDI-kommunikationsstrecken und ringe vor mir programmiert hat, hat übrigens in den letzten jahren für disney, intel und co. diese riesigen lichtshows mit drohnenschwärmen u.ä. realisiert.

ich selber war immer darum bemüht, mich von all diesen materialschlachten und unzugänglicher technologie zu befreien. mein ideal war eher, endlich irgendwelche performances ganz alleine live vom linux-laptop alleine mit einer vernünftigen netzanbindung abzuwickeln -- was dann ja irgendwann zum glück tatsächlich möglich geworden ist.

allerdings gibt's natürlich wenig grund, sich auf diesen alten ruhmtaten auszurasten, weil sich natürlich alles weiterentwicklt hat und die neuen herausforderungen sich völlig verschoben haben. heute bspw. machine learning tatsächlich nicht nur ganz kitschig und oberflächlich in kreativen gestaltungsprozessen zu nutzen, ist wieder genauso fordernd und anspruchsvoll, wie damals mit dem netz und den sich verändernden kommunikationsstrukturen zu experimentieren.

Antwort von markusG:

Kleines Update:

Neue Mac-Chips haben bis zu 32+8+128 Kerne

https://www.golem.de/news/apple-silicon ... 56592.html

Zum MBP 14 & 16:

Eine SoC-Variante soll 8+2+16 Kerne aufweisen, die schnellere sogar 8+2+32 Kerne.

&

Für den für 2022 angesetzten Mac Pro soll Apple noch einmal deutlich breitere Chips entwickelt haben: Neben einem Design mit 16+4+64 Kernen sei auch eines mit 32+8+128 Kernen geplant

Antwort von roki100:

den werde ich mir dann schnappen!