Newsmeldung von slashCAM:Februar 2024

Ein Planspiel zum Thema KI-Anwendungen und Rechenleistung: Wenn man Eins und Eins zusammenzählt, sieht man bereits heute sehr deutlich, wohin uns die Reise der Videobearbeitung in den nächsten Jahren führen wird...

Hier geht es zum slashCAM Artikel:

Meinung: Die Zukunft der Videobearbeitung 2026 - Alles Echtzeit in der Cloud (gegen Aufpreis)

Antwort von markusG:

Zukunftsmusik\? Heute vielleicht noch, aber nicht mehr lange.

Ist es das? Liegt doch alles aufm Tisch:

https://www.nvidia.com/de-de/data-cente ... ion-cloud/

https://www.nvidia.com/en-us/data-center/buy-grid/

https://www.youtube.com/watch?v=JEB4oJ9tzC4

Also - die Betrachtung vom Status Quo wäre mal interessant :)

Antwort von Frank Glencairn:

Unified Memory mit 5,3 TB/s Speicherdurchsatz - und wie schnell ist die Internet Leitung, die das ganze bedient? Da wird sich die GPU aber langweilen.

Echtzeit und Cloud schließen sich quasi aus, wenn ich erst mal 15 TB irgendwo hochladen muß, dauert das bei der durchschnittlichen deutschen Internet Leitung ein paar Tage.

Wenn ich jetzt sehe, wie viele hier nicht mal eine halbe Stunde warten können um nach dem Dreh zu schneiden, sehe ich da einen Interessenkonflikt.

Und finanziell - Cloud rechnet sich immer für den Cloudanbieter - und irgendwer muß ja die Räumlichkeiten, das Personal, die Klimaanlage, den Strom, die Hardware, und nicht zuletzt den Gewinn zahlen. Und das ist eben nicht der Cloudanbieter, sondern der Nutzer.

Ich frag mich bei solchen Hurrah Meldungen immer ob das mal jemand durchgerechnet hat.

Antwort von JosefR:

Das Hochladen der Quellmaterials ist aus meiner Sicht tatsächlich ein großes Problem. Die Datenmengen brauchen eine ziemlich schnelle Verbindung. Das nächste sind die Kosten für das Speichern und Archivieren, da entstehen hohe laufende Kosten. Und dann macht man sich von einem Anbieter abhängig, der jederzeit seinen Dienst ändern oder einstellen kann. Clouddienste mögen zwar bequem sein und ihre Berechtigung haben, aber man sollte sich der Nachteile bewusst sein.

Und ich finde die Zukunft für die lokale Alternative sieht eigentlich auch nicht schlecht aus. Ich gehe davon aus, dass mit 8k oder vielleicht 12k beim Quellmaterial erst einmal Schluss sein wird bei der Steigerung der Auflösung und damit der Datenmenge und den Anforderungen an die Rechenleistung. Ein NAS, mit 10 GBit/s angebunden, sollte vermutlich ausreichen um vernünftig arbeiten zu können und ausreichend schnelle und bezahlbare SSDs gibt es ja heute schon (Serial-ATA SSD mit 4TB für unter 250 z.B.). Ist natürlich etwas mehr Arbeit und initial auch mit einer höheren Investition verbunden. Aber ich kann mir vorstellen, dass das langfristig eigentlich fast immer eine Cloud-Lösung schlägt. Und ich sehe auch keinen Grund, warum Machine-Learning-Algorithmen nicht lokal auch vernünftig nutzbar sein sollen. Der meiste Rechenaufwand entsteht ja beim Trainieren der Modelle, das Nutzen des Modells braucht einen Bruchteil der Rechenleistung.

Antwort von Frank Glencairn:

JosefR hat geschrieben:

Clouddienste mögen zwar bequem sein

Zuerst alles was ich eigentlich vor Ort bereits im Echtzeit Vollzugriff hätte, erst mal langsam, umständlich, zeitintensiv und teuer irgendwo auf einen fremden Server laden, und dann wieder runter?

Welcher Teil davon ist jetzt der bequeme?

JosefR hat geschrieben:

Aber ich kann mir vorstellen, dass das langfristig eigentlich fast immer eine Cloud-Lösung schlägt. Und ich sehe auch keinen Grund, warum Machine-Learning-Algorithmen nicht lokal auch vernünftig nutzbar sein sollen. Der meiste Rechenaufwand entsteht ja beim Trainieren der Modelle, das Nutzen des Modells braucht einen Bruchteil der Rechenleistung.

Yup. Bis jetzt hat mir jedenfalls noch keiner das Gegenteil vorrechnen können.

Ich seh da hauptsächlich ein Kopfproblem.

Antwort von pixler:

Für extrem Effektlastige Arbeiten (Kino, Werbespots etc.) mag das ja Sinn machen.

Um eine Geschichte zu erzählen reicht in 90% der Fälle der harte Schnitt. Was soll ich jetzt da ein teures GPU-Cloud System bezahlen?

Antwort von iasi:

BMDs Relight läuft schon mal nicht in Echtzeit mit aktueller PC-Hardware. Das wird schnell zur Qual.

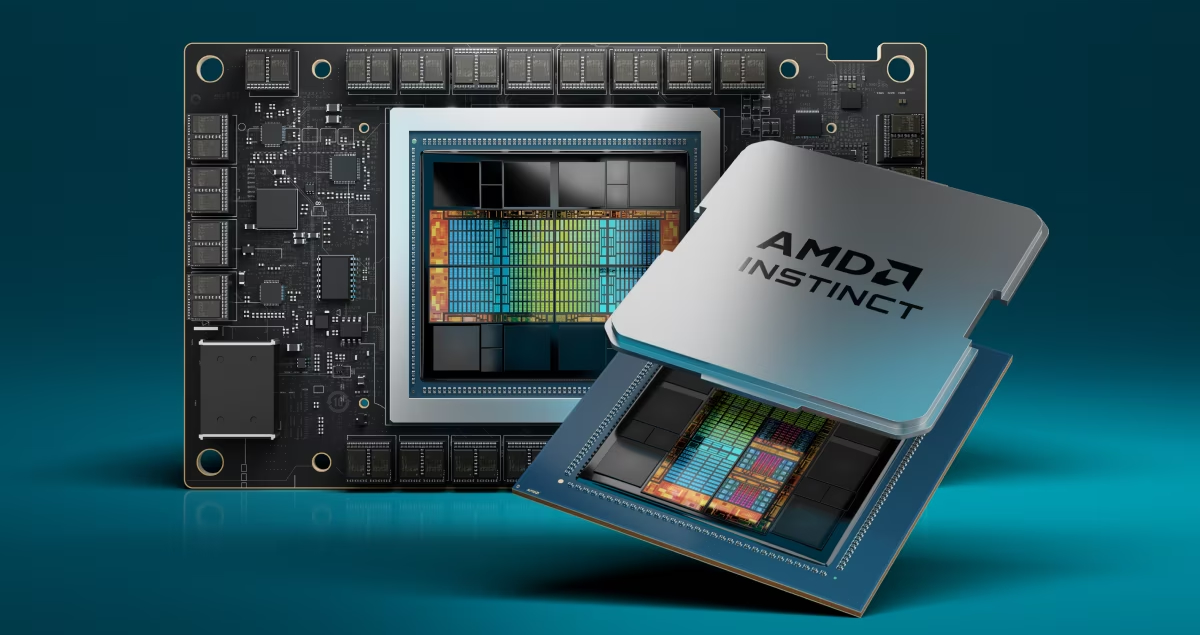

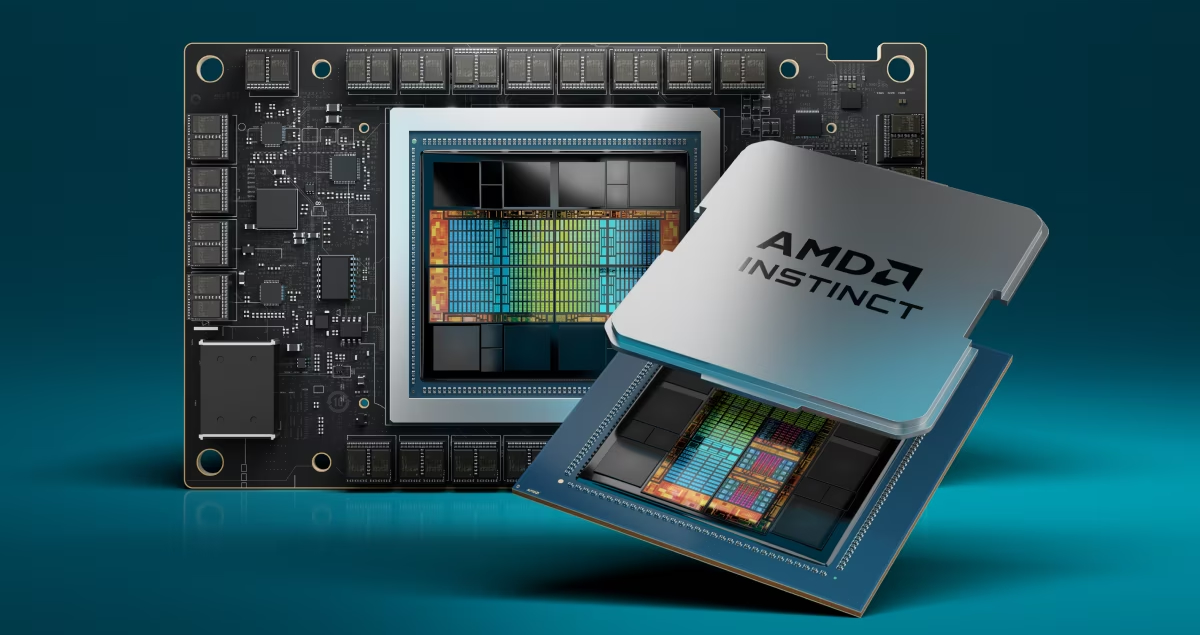

Viele KI-Anwendungen scheitern wiederum schon heute am begrenzten Speicher vieler Grafikkarten.

Was in Zukunft mit KI also möglich ist, hängt von der Rechnerleistung und dem Speicherausbau ab.

Die Cloud beseitigt diese Limitierungen.

Antwort von markusG:

"Frank Glencairn" hat geschrieben:

Zuerst alles was ich eigentlich vor Ort bereits im Echtzeit Vollzugriff hätte, erst mal langsam, umständlich, zeitintensiv und teuer irgendwo auf einen fremden Server laden, und dann wieder runter?

Nun der Reiz ist dabei ja das kollaborative arbeiten. Es wird also vor Ort schon mit Vollzugriff gearbeitet, während es im Hintergrund synchronisiert wird und dann zB am anderen Ende des Globus bearbeitet werden kann, und dann auch nur der Teil der muss. Arbeitsteilung halt. Die Alternative wäre asynchrones arbeiten.

Das ganze gibt es dann natürlich noch in allen Geschmackssorten (zB private Cloud, Hybridsysteme), je nach Gusto. Und für das eigentliche Thema - virtuelle (GPU-)Workstations - muss es ja auch kein öffentliches System sein.

Hat halt den Vorteil effektiver administrierbar zu sein und dass man Ressourcen dynamisch vergeben kann. Quasi das Pendant zu Renderservern.

Dürfte auch nicht für jeden rechnen, der vllt alle 5 Jahre

eine neue Workstation kauft. Aber für Studios die je nach Projekt skalieren wollen/müssen? Rechnen die sich sicherlich durch, auch hier - siehe Renderfarmen (die es ja auch in der Cloud gibt).

Antwort von Darth Schneider:

@iasi

Aber wir wollen doch Filme selber machen nicht die KI

Und man kann ja lokal arbeiten und die KI mit in der Cloud trotzdem als Werkzeug nutzen

Gruss Boris

Antwort von Bluboy:

"Darth Schneider" hat geschrieben:

@iasi

Aber wir wollen doch Filme selber machen nicht die KI

Gruss Boris

Das läuft dann unter der Rubrik "der besondere Film"

Antwort von Frank Glencairn:

markusG hat geschrieben:

Nun der Reiz ist dabei ja das kollaborative arbeiten. Es wird also vor Ort schon mit Vollzugriff gearbeitet, während es im Hintergrund synchronisiert wird und dann zB am anderen Ende des Globus bearbeitet werden kann, und dann auch nur der Teil der muss. Arbeitsteilung halt. Die Alternative wäre asynchrones arbeiten.

Das ist ein alter Hut - das machen wir ja sowieso schon seit Jahren.

Mein Punkt war die Diskrepanz zwischen Echtzeit und Cloud, und daß sich weder Cloud noch virtuelle Maschinen finanziell rechnen können.

Und ja, Renderfarmen sind ein Sonderfall, bei denen ja nur relativ kleine Projektdateien hoch geladen werden, und nicht zig Terabyte an Material.

Antwort von markusG:

"Frank Glencairn" hat geschrieben:

Mein Punkt war die Diskrepanz zwischen Echtzeit und Cloud

Die ja keinen Unterschied macht zu bisherigen Workflows, außer dass es mehr oder weniger automatisch läuft. Früher sind halt die Kuriere mit den Festplatten durch die Gegend gefahren. Heutzutage haben inzwischen Kameras Direktverbindungen zu frame.io - wer's braucht der braucht's eben.

"Frank Glencairn" hat geschrieben:

und daß sich weder Cloud noch virtuelle Maschinen finanziell rechnen können.

Wenn dem so wäre, wären die ganzen Anbieter doch längst vom Markt verschwunden. Für einige scheint es sich ja zu rechnen. Cloudlösungen lassen sich halt verhältnismäßig simpel skalieren, während Workstations ja nicht einfach mal so zum Arbeiten (nicht rendern!) kombiniert werden können.

Wie gesagt - spricht ja nichts gegen virtuelle Workstations, die on-premises laufen und über ne dicke Leitung an einem Fileserver hängen. Zumal man dann eben von überall aus arbeiten kann. Wie das Material auf den Server gelangt ist dabei ja überheblich.

Antwort von Frank Glencairn:

Klar gibt es immer irgendwelche Spezialanwendungen, aber der Artikel und die Überschrift suggerieren halt was völlig anderes.

Sie postulieren ganz allgemein "

Die Zukunft der Videobearbeitung" (nicht mal mit Fragezeichen), und behaupten "Echtzeit in der Cloud".

Und um diese Postulate ging es in meiner Antwort.

Der Kern des Artikels zielt nicht auf große Firmen ab, die plötzlich so große Jobs am Hals haben, daß sie virtuell skalieren müssen, sondern darauf, daß man selbst auf billigsten Laptops und völlig alterschwachen Rechnern mittels des - nach Jahrzehnten aus der Versenkung geholten - "Mainframe Konzepts", flüssig arbeiten kann.

Was der Artikel dabei nicht beantwortet ist der Elefant im Raum: Internetgeschwindigkeit und Datenmengen (und natürlich die tatsächlichen Kosten).

Antwort von iasi:

"Darth Schneider" hat geschrieben:

@iasi

Aber wir wollen doch Filme selber machen nicht die KI

Und man kann ja lokal arbeiten und die KI mit in der Cloud trotzdem als Werkzeug nutzen

Gruss Boris

Relight oder Depth Map machen nur, was man sie anweist.

Die Kombination von beiden ergibt ein beeindruckendes Gestaltungsmittel.

https://www.youtube.com/watch?v=h9U3rrvGa40

Leider braucht es dazu sehr viel GPU-Power und vor allem auch Grafikkartenspeicher.

Ich brauche jedenfalls eine neue Grafikkarte.

Die Nvidia 4080 schafft 14 fps in einem Relight-Test, während die AMD 7900 XTX nur auf 4 fps kommt.

Versuch doch mal, wie es sich mit deinem Rechner mit diesen FX arbeiten lässt.

Antwort von Frank Glencairn:

Beim Color Grading muß ja auch nicht zwingend alles immer in Echtzeit ablaufen, und notfalls gibt's dafür ja den Cache.

Alternativ kann man auch einfach gleich so leuchten wie man es haben will.

Ich sehe solche Tools - so nützlich sie auch sind - in erster Linie als Reparaturwerkzeuge an, wenn jemand am Set mal wieder was vergeigt hat, oder weil es aus irgend einem Grund nicht anders ging.

Antwort von markusG:

"Frank Glencairn" hat geschrieben:

sondern darauf, daß man selbst auf billigsten Laptops und völlig alterschwachen Rechnern mittels des - nach Jahrzehnten aus der Versenkung geholten - "Mainframe Konzepts", flüssig arbeiten kann.

Abgesehen vom Mainframe ist das doch längst Realität, spätestens seit Corona. Ich habe unterwegs nicht selten eine "Kartoffel" - ob am anderen Ende dann eine Workstation sitzt, die es ja auch nicht geschenkt gibt, oder ein Server mit einer virtuellen Workstation - kann mir völlig egal sein. Die Admins sehen das vlt anders, aber das ist nicht mein Bier.

Was aber nice wäre wenn entsprechend Kapazitäten frei werden dass dann zB mehr Speicher verfügbar wird. So gibt es entsprechend immer eine optimale Auslastung. Das wäre ja bei einzelnen Workstations afaik so nicht realisierbar, und dafür braucht es weder einen Mainframe noch eine riesen Firma.

Ob es dafür entsprechende Rechnungen gibt bzw wie das der Stand jetzt ist habe ich oben in Frage gestellt, finde es zumindest vom Konzept her interessant. Selbst wenn es am Ende Nischenanwendungen sein sollten...

Antwort von iasi:

"Frank Glencairn" hat geschrieben:

Klar gibt es immer irgendwelche Spezialanwendungen, aber der Artikel und die Überschrift suggerieren halt was völlig anderes.

Sie postulieren ganz allgemein "Die Zukunft der Videobearbeitung" (nicht mal mit Fragezeichen), und behaupten "Echtzeit in der Cloud".

Und um diese Postulate ging es in meiner Antwort.

Der Kern des Artikels zielt nicht auf große Firmen ab, die plötzlich so große Jobs am Hals haben, daß sie virtuell skalieren müssen, sondern darauf, daß man selbst auf billigsten Laptops und völlig alterschwachen Rechnern mittels des - nach Jahrzehnten aus der Versenkung geholten - "Mainframe Konzepts", flüssig arbeiten kann.

Was der Artikel dabei nicht beantwortet ist der Elefant im Raum: Internetgeschwindigkeit und Datenmengen (und natürlich die tatsächlichen Kosten).

Die Entwicklung geht schon recht flott voran. NR und Optical Flow nimmt man mittlerweile schon als selbstverständlich.

Die Datenmengen werden wohl eher nicht mehr so stark anwachsen. 8k sind reichlich. Aber die erforderliche Rechenpower wächst ziemlich an.

zum Bild

https://www.pugetsystems.com/labs/artic ... mizations/

Die Kosten für das Datenhandling vergleichsweise nicht sonderlich hoch.

Ein Glasfaseranschluss schafft bis zu 25 Gbit/s.

Ich rüste jetzt meinen Rechner auf, aber für Echtzeit wird es mit den neuen Funktionen die Resolve bietet, dennoch nicht reichen.

Und was die Zukunft an neuen Gestaltungsmöglichkeiten bringen wird, kann man kaum erahnen.

Gerade lese ich übrigens - und bin erstaunt:

Neuer Rekord bei Glasfaser Geschwindigkeit:

178 Tbit/s

https://dsl-ratgeber.net/ratgeber/glasf ... windigkeit

Antwort von iasi:

"Frank Glencairn" hat geschrieben:

Beim Color Grading muß ja auch nicht zwingend alles immer in Echtzeit ablaufen, und notfalls gibt's dafür ja den Cache.

Alternativ kann man auch einfach gleich so leuchten wie man es haben will.

Ich sehe solche Tools - so nützlich sie auch sind - in erster Linie als Reparaturwerkzeuge an, wenn jemand am Set mal wieder was vergeigt hat, oder weil es aus irgend einem Grund nicht anders ging.

Auch wenn man den Cache nutzt, muss zunächst gerendert werden. Magic Mask verlangt z.B. ständig nach neuen "Durchgängen".

Und versuch mal Relight. Da ist auch schnell mal Schluß mit flüssigem Arbeiten.

Warum sollte man denn nicht die neuen Möglichkeiten nutzen?

Ich nehme mal an, dass du aktuelle NR auch nicht mehr missen möchtest.

Das könnte man übrigens auch vermeiden, wenn man richtig leuchtet.

Diese Tools erweitern die Gestaltungsmöglichkeiten.

Antwort von macaw:

Jaja...Glasfaser fürn Arsch. Ich wohne als Erstmieter im Neubau - in Berlin (!) und habe bei der Telekom Magenta XL (250 Mbit). Angeblich, denn mein brandneuer Anschluss knickt nach wenigen Tagen auf 170 Mbit ein und beim Upload komme ich auf 30 statt 40 Mbit. Vodafone/Kabel Deutschland scheint hier und da die 1 Gbit Schwelle im Download zu reißen, schafft den Upload aber auch nur mit 40 Mbit.

Wo in dieser lausigen Stadt Glasfaser überhaupt geplant ist, konnte ich nicht einmal rausfinden, aber selbst wenn das irgendwo der Fall sein sollte, glaube ich den Versprechungen nicht.

2026. Dass ich nicht lache. In D wird schnelles, selbst halbwegs symmetrisches Internet für die breitere Masse noch lange "Neuland" bleiben...

Antwort von -paleface-:

Sehe da schon Potenzial.

Grad im VFX Bereich.

Du lädst das Footage hoch. Muss ja nur die szene sein. Die ist dann vielleicht 3GB groß.

Dann machst du in der Cloud deine VFX und compositing.

Dann hast du halt Zugriff auf Echtzeit 3d tracking, character animation und ai Retuschen.

Wonder Dynamics Macht es doch grad vor.

Und am Ende lädst du dir dein Prores mit 600mb runter und machst dein Grading darauf.

Antwort von macaw:

Du gehst dann auch davon aus, dass das Internet nie ausfällt. Wenn es großzügige Deadlines und/oder Geld für Redundanz der Leitung gibt, mag das noch gehen. Kleine/mittlerweile Firmen und erst recht Freelancer haben i.d.R. nicht solchen Luxus. Ganz besonders dann nicht, wenn man in der Werbung bzw. fürs TV tätig ist. Vor zwei Jahren hatte ich ein Projekt fürs ZDF (Online, Retusche, Motion Graphics), wo am Ende, 4 oder 5 (!) Stunden vor der Sendung entschieden wurde, dass sie die letzten Schritte selbst machen und ich die Dateien nach Mainz schieben soll, zum Glück war das Ding ein Trailer für das Sport Programm und entsprechend "klein"... aber wenn dann das Internet nicht mitspielt...Hallelujah...

Antwort von Frank Glencairn:

iasi hat geschrieben:

Gerade lese ich übrigens - und bin erstaunt:

Neuer Rekord bei Glasfaser Geschwindigkeit: 178 Tbit/s

Nur leider nutzen uns "bis zu" Geschwindigkeiten an einigen wenigen ausgewählten Standorten halt überhaupt nix. Grundlage ist immer die Mindestgeschwindigkeit an dem Standort an dem du gerade bist.

Und wie ich schon sagte, warte ich immer noch darauf, daß mir einer vorrechnet, wie das finanziell gehen soll.

Antwort von soulbrother:

Für mich gibt es mehrere Gründe, das Thema für meinen Kleinbedarf( d.h. völlig überschaubare Projekte, die ich oft ganz alleine stemme) als uninteressant abzulegen:

1. Datentransferzeit - wurde schon audführlich angesprochen - ich find es völlig "witzlos"

2. "Sicherheit" in allen möglichen Belangen:

-- Daten, Videos, Bilder, für die ich schon mehrmals Geheimhaltungsverträge unterzeichnen durfte - geht also gar nicht.

--Ausfall der Verbindung, sei es der Anbieter hat ein Problem, sei es mein Netzzugang streikt, sei es irgendetwas anderes... (Wenn mein PC ausfällt, hab ich Redundanz, oder in wenigen Stunden einen anderen besorgt)

Antwort von iasi:

"Frank Glencairn" hat geschrieben:

iasi hat geschrieben:

Gerade lese ich übrigens - und bin erstaunt:

Neuer Rekord bei Glasfaser Geschwindigkeit: 178 Tbit/s

Nur leider nutzen uns "bis zu" Geschwindigkeiten an einigen wenigen ausgewählten Standorten halt überhaupt nix. Grundlage ist immer die Mindestgeschwindigkeit an dem Standort an dem du gerade bist.

Und wie ich schon sagte, warte ich immer noch darauf, daß mir einer vorrechnet, wie das finanziell gehen soll.

Wir reden von der Zukunft.

Vor Jahrzehnten gab es die Diskussion, ob die Telekom statt den Kabeln besser Glasfasern verlegen sollte. Damals hatte man bei der Telekom zu kurzfristig gedacht. ;)

Wir kommen zudem von 64 kB-Anschlüssen. Über 16 MBit/s hatte man sich vor gar nicht so langer Zeit gefreut.

Und:

Das 6G-Netz soll etwa ab 2030 in Deutschland in Betrieb gehen.

Mit 5G hatte man in Hannover neulich 274 MBit/s Upload erreicht. Für ArriRaw ist das noch nicht ausreichend, aber in Zukunft ... :)

Antwort von Frank Glencairn:

iasi hat geschrieben:

Wir reden von der Zukunft.

Vor Jahrzehnten gab es die Diskussion, ob die Telekom statt den Kabeln besser Glasfasern verlegen sollte. Damals hatte man bei der Telekom zu kurzfristig gedacht. ;)

Die Telekom hatte da nix zu melden, weil das alles schon lange bevor es die Telekom überhaupt gab bereits entschieden wurde.

Der von Helmut Schmidt geplante Glasfaserausbau wurde von Kohl aus rein politischen Gründen (um der Opposition propagandatechnisch zu schaden), zugunsten von Privat-Kabelfernsehen gestoppt und auf Eis gelegt.

Heute - 40 Jahre später hab ich immer noch keine Glasfaser im Haus, und das quasi in der Innenstadt.

So wird "Zukunft" in Deutschland in Wirklichkeit gemacht - deshalb würde ich mich auf sowas an deiner Stelle nicht verlassen.

Immer wenn irgendjemand wieder mal behauptet, dies oder jenes sein unwiederbringlich "Die Zukunft" ist die erste Frage, die ich immer stelle:

Wie ist das denn damit die letzten paar mal in der Vergangenheit gelaufen - und was ist dabei raus gekommen?

Die Antwort ist dann meistens ernüchternd genug.

Antwort von iasi:

"Frank Glencairn" hat geschrieben:

iasi hat geschrieben:

Wir reden von der Zukunft.

Vor Jahrzehnten gab es die Diskussion, ob die Telekom statt den Kabeln besser Glasfasern verlegen sollte. Damals hatte man bei der Telekom zu kurzfristig gedacht. ;)

Die Telekom hatte da nix zu melden, weil das alles schon lange bevor es die Telekom überhaupt gab bereits entschieden wurde.

Der von Helmut Schmidt geplante Glasfaserausbau wurde von Kohl aus rein politischen Gründen um der Opposition zu schaden, zugunsten von Privat-Kabelfernsehen gestoppt und auf Eis gelegt.

Heute - 40 Jahre später hab ich immer noch keine Glasfaser im Haus, und das quasi in der Innenstadt.

So wird "Zukunft" in Deutschland in Wirklichkeit gemacht - deshalb würde ich mich auf sowas an deiner Stelle nicht verlassen.

Immer wenn irgendjemand wider mal behauptet, dies oder jenes sein unwiederbringlich "Die Zukunft" ist die erste Frage, die ich immer stelle:

Wie ist das denn damit die letzten paar mal in der Vergangenheit gelaufen - und was ist dabei raus gekommen?

Die Antwort ist dann meistens ernüchternd genug.

Dass die Deutschen immer geschoben werden müssen, ist ja auch nichts neues. Immerhin liefern sie dann ordentlich ab, wenn sie schon zu spät dran sind.

Arri ist ja auch so ein Beispiel. :)

Man kann ja nicht sagen, dass sich in D gar nichts tut.

5G hast du doch zumindest nun auch. Und Glasfaser bauen sie nun endlich aus.

Ich denke da auch immer an einen jungen Unternehmer in Rumänien, der mal eben in der ganzen Stadt Kabel von Mast zu Mast und recht wild in die Häuser verlegt hatte. Er bot High-Speed-Internet an, von dem ich in D nur träumen konnte. Aber in RO sitzt man eben auch mal ganz ohne Strom da, weil alles wild verlegt und verkabelt wurde. :)

|

Antwort von Frank Glencairn:

Kann ich bestätigen, immer wenn ich in Rumänien gedreht habe, hatte ich die schnellste Anbindung ever, und das in jedem Kuhkaff.

Antwort von iasi:

"Frank Glencairn" hat geschrieben:

Kann ich bestätigen, immer wenn ich in Rumänien gedreht habe, hatte ich die schnellste Anbindung ever, und das in jedem Kuhkaff.

Da sind die Rumänen eben ganz pragmatisch.

Der deutsche Hang zur Perfektion erlaubt eben nicht, dass ein Haus, zu dem nicht mal eine geteerte Straße führt, dennoch schnelle Internetanbindung mit einem Kabel, das von Dach zu Dach geht, bekommt.

Antwort von Bluboy:

iasi hat geschrieben:

Man kann ja nicht sagen, dass sich in D gar nichts tut.

5G hast du doch zumindest nun auch. Und Glasfaser bauen sie nun endlich aus.

Glasfaser in in den Keller und dann gehts fröhlich weiter mit Kupfer ;-))

Und es wird ständig teurer !!!!!

Antwort von markusG:

macaw hat geschrieben:

Jaja...Glasfaser fürn Arsch. Ich wohne als Erstmieter im Neubau - in Berlin (!) und habe bei der Telekom Magenta XL (250 Mbit). Angeblich, denn mein brandneuer Anschluss knickt nach wenigen Tagen auf 170 Mbit ein und beim Upload komme ich auf 30 statt 40 Mbit.

Künftig wird sich der Wert einer kommerziell genutzten Immobilie vermutlich zusätzlich zum restlichen Pipapo eben auch durch solche infrastrukturellen Bedingungen bestimmen.

Privat hatte ich von Anfang an ne fette Leitung, vermutlich wegen der Industrie in der Nähe. In der Innenstadt (viel Altbau) dagegen war lange Zeit Kupfer das Maß der Dinge, und das in Hamburg.

Es hat auch aber seitdem einiges getan, und so Dinge wie Stromausfälle hatte ich das letzte mal vor ca 15 Jahren erlebt. Und 5G als Redundanz ist sicher nichts, was sich Freelancer, geschweige den mittelgroße Firmen nicht leisten können.

macaw hat geschrieben:

2026. Dass ich nicht lache. In D wird schnelles, selbst halbwegs symmetrisches Internet für die breitere Masse noch lange "Neuland" bleiben...

Bis 2028 in Berlin :D

https://www.berlin.de/sen/web/presse/pr ... 339705.php - da gibt es sogar ne (grobe) Karte.

Aber dass es Standortvorteile / Ballungsgebiete gibt ist ja nun nix neues. Wer bestes Internet bis nach Hintertupfingen erwartet muss in DE wohl so oder so in die Röhre schauen.

p.s.:

We have a lot of customers using Resolve 17 on AWS, Azure or GCP services using VM's.

https://forum.blackmagicdesign.com/view ... 1&t=149591

Antwort von wolfgang:

Für mich kommt das nicht in Frage. Habe mein lokales 10GB raid, und sehr wohl einen breitbandigen Anschluss. Trotzdem - nein danke. Mag aber jeder gerne anders sehen.

Antwort von iasi:

wolfgang hat geschrieben:

Für mich kommt das nicht in Frage. Habe mein lokales 10GB raid, und sehr wohl einen breitbandigen Anschluss. Trotzdem - nein danke. Mag aber jeder gerne anders sehen.

Wenn neue Anwendungen gar nicht mehr laufen, weil die KI nach zu viel Grafikkartenspeicher verlangt oder es mit weniger als 1fps bei Berechnungen vorangeht, wird die Breitband-Frage weniger bedeutsam.

Einfach mal Relight testen - das gibt einen gewissen Vorgeschmack.

Antwort von Frank Glencairn:

iasi hat geschrieben:

Einfach mal Relight testen - das gibt einen gewissen Vorgeschmack.

Vielleicht solltest du dir doch mal ne Nvidia kaufen ;-)

Antwort von wolfgang:

Relight? Braucht man das unbedingt? Aber ja, die KI ist sicher bei den GPUs ram hungrig. Aber auch dort sehen wir Preisverfälle.

Antwort von macaw:

markusG hat geschrieben:

https://www.berlin.de/sen/web/presse/pr ... 339705.php - da gibt es sogar ne (grobe) Karte.

Waaaaaaaasss...ich fasse es nicht!!! Danke für den Link, aber natürlich ist mein Bezirk (Reinickendorf) das Schlußlicht in beiden Kategorien mit 75,9% und 5,2%!! Egal ob östlich, westlich oder südlich, jeder Nachbarbezirk ist deutlich besser dran!! So eine sch*** Stadt!

Antwort von iasi:

"Frank Glencairn" hat geschrieben:

iasi hat geschrieben:

Einfach mal Relight testen - das gibt einen gewissen Vorgeschmack.

Vielleicht solltest du dir doch mal ne Nvidia kaufen ;-)

Ne´super ist bestellt. :)