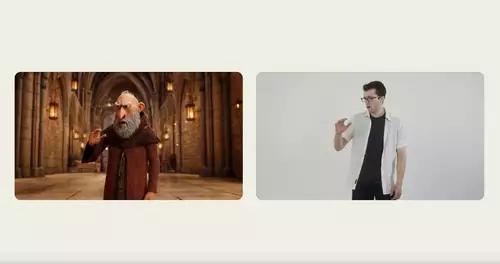

Mit generativer KI erstellte Figuren bewegen sich nicht immer so, wie man es selbst gerne möchte - wer mehr Kontrolle über animierte Charaktere haben möchte, greift zu Motion Capture und dafür hatte Runway bereits seit längerem ein KI-Tool. Es wurde vor kurzem aktualisiert und kann unter dem Namen "Act-Two" nun Bewegungsvorgaben aus einer Videovorlage noch besser auf eine Figur übertragen. Diese muss dafür nicht als 3D-Modell existieren, wie bei traditioneller Animation, sondern es reicht ein einzelnes (ggf. generiertes) 2D-Bild.

Unterstützt wird ein "Tracking" von Kopf, Gesicht, Körper und Händen - folgendes Video zeigt eindrucksvoll, was mit wenigen Klicks möglich ist:

// Top-News auf einen Blick:

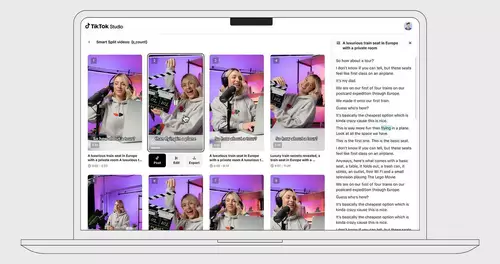

- ByteDance Vidi2 produziert selbstständig fertige Videos aus Rohmaterial

- Blackmagic DaVinci Resolve 20.3 bringt Support für 32K-Workflows und mehr

- Kommt die Sony Alpha 7 V am Dienstag?

- Bis zu 1.000 Euro sparen: Cashbacks auf Kameras von Sony, Nikon, Canon und Panasonic

- DJI Neo 2: Verbesserte Mini-Drohne für Solo-Creator und Einsteiger

- Blackmagic PYXIS 12K - Sensor-Test - Rolling Shutter und Dynamik

Dafür hat man bis auf einen Regler, mit dem sich einstellen lässt, wie eng sich die KI an die Vorgabe halten soll, keine Eingriffsmöglichkeiten. Die besten Resultate lassen sich laut Runway erzielen, wenn die Person im Vorlagevideo eine ähnliche Position im Bild einnimmt wie die Zielfigur, also aus dem gleichen Winkel zu sehen ist bei ähnlicher Einstellungsgröße.

Runway Act-Two soll ab sofort für alle Enterprise-Kunden sowie "Kreativpartner" zur Verfügung stehen (also wie es scheint noch nicht für normale Abonnenten).