Newsmeldung von slashCAM:Nachdem zuvor die 6- und 8-Core Mac Pro in Geekbench Tests aufgetaucht waren (die vor allem die Prozessorleistung und nicht die GPU) testen, scheinen nun auch Resultate für den kommenden 12-Core Mac Pro aufgetaucht zu sein. Wie erwartet liegt der Single-Core Test des neuen Mac Pro unterhalb der Einstiegs-Macs wegen der geringeren Taktfrequenz. Bei den Multi-Core Tests hingegen lässt der neue 12.Core Mac Pro die 6- und 8 Core Varianten hinter sich. Spannender als Prozessor-Tests in Benchmarks finden wir Praxis-Tests mit entsprechender Anwender-Software. Vor allem eine Antwort auf die Frage, was Apple mit angepassten Treibern aus der GPU für das ebenfalls für Dezember erwartete Final Cut Pro X Update (10.1) herausholen kann, dürfte interessant werden.

zur News

Antwort von gast5:

Cool, das nehme ich jetzt genauso ernst wie der den macpro 6.1 Eintrag als dual CPU Konfiguration oder Studiolondons selbstgezimmerte Tabelle zur Grafikartenleistung der aktuellen Grafikkarten ...das perlt so richtig..*gggg

Antwort von studiolondon:

Cool, das nehme ich jetzt genauso ernst wie der den macpro 6.1 Eintrag als dual CPU Konfiguration

Die Angaben sitzen genau wie erwartet.

~30000 geekbench sind das Leistungsniveau eines einzelnem intel 12er - in etwa die Leistung des 2010/11er macpros.

2012er systeme sind bei ~50.000 (dual xeon, 16 cores), aktuell sind ~60.000 (dual xeon, 24 core).

Der maximale imer/dosen-mapcro ist in etwa halb so schnell wie heutige upperclass systeme, logischerweise, da Kunden nur noch eine anstelle von zwei cpus pro system kaufen dürfen.

Bei der Grafik ist es allerdings noch übler - da das Apple maximal nur noch 2 veraltete grafikkarten mit gedrosselten 2011er AMD Tahiti gestattet, aktuell sind für anspruchsvolle Anwendungen wie davinci 4 ungedrosselte Karten mit 2013er Chips.

oder Studiolondons selbstgezimmerte Tabelle zur Grafikartenleistung der aktuellen Grafikkarten ...das perlt so richtig..*gggg

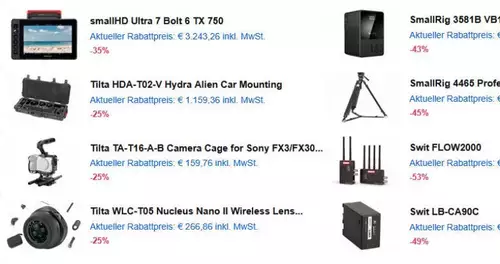

Gute Idee, hier noch mal die Rechenleistung der aktuellen Grafikkarten, alles die offiziellen und rechtlich bindenden Herstellerangaben.

zum Bild

Antwort von gast5:

Ganz genau so nehmen wir sie... Bis zu 7 Tflops und Dual AMD FirePro GPUs auf Workstation-Niveau Standard in jedem Mac Pro bieten bis zu 12 GB Videospeicher, mit bis zu 528 GB/s

Voll Banane solche Vergleiche zumal die geebenchs wie wir an der macpro 6.1 dualcpu variante in der Tabelle so oder so mit der Erkenntnis zurück lässt das es diese Konstellation gar nicht gibt.. Der Brüller schlechthin ..

Antwort von studiolondon:

Ganz genau so nehmen wir sie... Bis zu 7 Tflops und Dual AMD FirePro GPUs auf Workstation-Niveau

Aktuell sind über 22 Tflops (quad 2013er AMD Hawai), nicht 7 Tflops (dual gedrosselte 2011er AMD Tahiti) - und insbesondere für Systeme wie Davinci ist die Leistung sehr sinnvoll. Starke Davinci systeme nutzen bis zu 8 GPUs, nicht 2.

Zudem, grade am beispiel davinci siehr man apples fehlplanung (bzw. desinteresse) für viele professionelle Kunden. Davinci nutzt EINE gpu alleine nur für Bild ein-ausgabe. Daher nutzt man in der Prxis typisch eine schwächere Grafik für ein/ausgabe, und die anderen des 2,3,4er-Verbandes zu Berechnung.

Da apple keinerlei Konfiguration mehr erlaubt und keine grafikkarten mehr aufgerüstet weren können, bleibt davinci nur die leistung einer *einzelnen* rechenkarte, sprich 3.5 Tflops... aktuelle 4er sets brinngen wie gesagt über 22 Tflops - da ist apple jetzt gezwungernermaßen satte 80% schwächer :/

Standard in jedem Mac Pro bieten bis zu 12 GB Videospeicher, mit bis zu 528 GB/s

Falsch.

Erstens ist nicht die D700, sondern die D300 standard. Mit 2 Tflops. Nicht 3.5 wie gedrosselte 2011er karten oder über 5.5 wie aktuelle Karten.

Zweitens sind das nicht 2 * 6 GB standard Videospeicher - sondern 2 * 2.

Zudem addieren sich weder speicherbandbreite noch verfügbarer speicher - jede grafikkarte kann NUR ihren speicher nutzen und NUR ihre bandbreite.

Wenn du so falsch rechnest hätten ein ~800 euro teurer quad Geforce 760 GTX verband 16 GB Videospeicher und ~ 780 GB/sek...

Voll Banane solche Vergleiche zumal die geebenchs wie wir an der macpro 6.1 dualcpu variante in der Tabelle so oder so mit der Erkenntnis zurück lässt das es diese Konstellation gar nicht gibt.. Der Brüller schlechthin ..

Nein, die Werte beziehen sich konkret auf das maximal von apple den kunden erlaubte imer-macpro system - single cpu xeon liefern eben um die 30000 geekbench, nicht 50000 wie 2012er duals oder 60000 wie 2013er duals.

Antwort von gast5:

Ich rechne nicht falsch ich bin auf deinen Hinweis die appleseite zu besuchen die Seite durchgegangen und habe wie von dir empfohlen die Daten kopiert und verwendet.. Da ist nichts mit rechnen ... Die D700 kommt in der dualkonfiguration auf 7 Tflops und maximal 528Gb/s Speicherdurchsatz mit 12 GB Grafikspeicher.

Nicht mehr nicht weniger das ist wie es ist ist..

Was anderes auf dem Markt möglich ist steht dabei nicht zur Debatte..

Die Chinesen sind am Mond die Russen und die Amis nicht und in Vorarlberg ist noch kein Ski umgefallen..

Antwort von Alf_300:

Zum Mekern findet man immer was,

Alles in Allem kann man aber davon ausgehen dass die Apple-User zufrieden und andere überrascht sein werden

Antwort von studiolondon:

Ich rechne nicht falsch ich bin auf deinen Hinweis die appleseite zu besuchen die Seite durchgegangen und habe wie von dir empfohlen die Daten kopiert und verwendet.. Da ist nichts mit rechnen ... Die D700 kommt in der dualkonfiguration auf 7 Tflops und maximal 528Gb/s Speicherdurchsatz mit 12 GB Grafikspeicher.

Nicht mehr nicht weniger das ist wie es ist ist..

Bei der Methodik hat demenstprechen ein günstiges aktuelles System mit 2013er Karten

11,2 Tflops und 640 GB/sek (bei dual R9 290X), bzw für davinci 22,4 Tflops mit 1280 GB/sek (quad R9 290X).

Beachte zudem, daß für davinci eine grafikkarte für display rausfällt, da bleiben dann selbst beim maximal konfigurierten imer-mac pro mit d700 grade mal 3.5 Tflops rechenleistung - anstelle 22,4 mit 4 dedizierten AMD R9. Das ist nicht mehr lustig.

Was anderes auf dem Markt möglich ist steht dabei nicht zur Debatte..

Genau das startete die Debatte:

Apple ist leistungsmäßig im Vergleich zu heutigen Systemen nur noch 2te und 3te Klasse.

Nicht mehr knapp unter den guten systemen wie es einst beim mac pro üblich war, sondern *JAHRE* hinter dem Wettbewerb.

Halbierte CPU-Leistung, geviertelte (und mehr) GPU-Leistung - und wegen der komplett gestrichenen Erweiterbarkeit mit schnellem pcie und nur noch solo-cpus auch keinerlei möglichkeit, die imermacpros auf aktuelles Niveau zu bringen.

Antwort von studiolondon:

Alles in Allem kann man aber davon ausgehen dass die Apple-User zufrieden und andere überrascht sein werden

Da bist du falsch informiert - für anspruchsvolle Appleanwender stellen die neuen systeme einen ÜBLEN rückschritt gegenüber ihren 2010/11ern mac pros dar.

Bspw konnte man für davinci auf osx 3 bzw 4 Grafikkarten mit den klasssichen mac pros nutzen - und aktuelle karten.

Jetzt gehen maximal nur noch 2 veraltete und zudem gedrosslete Grafikkarten maximal.

Und 12 core war 2010/2011 - der damalige 12 core macpro kostete weniger als der heutige 6 core und hatte zudem pcie. AKtuell sind 24 cores (bei Intel) bzw 64 (bei AMD).

Antwort von gast5:

Sollten die User mit der dualcpu d700 Variante nicht klar kommen, könnten sie eine externe GUI Grafikkarte die mit der tb2 harmonieren adaptieren und die zwei d700 würden mit voller Leistung dem renderprozess zu Verfügung stehen.. Wie gesagt sollten sie nicht auskommen..

Dar Rest ist was wäre wenn Geplänkel..

Antwort von studiolondon:

Sollten die User mit der dualcpu d700 Variante nicht klar kommen, könnten sie eine externe GUI Grafikkarte die mit der tb2 harmonieren adaptieren und die zwei d700 würden mit voller Leistung dem renderprozess zu Verfügung stehen..

Falsch.

OSX unterstützt GPU über Tbolt nicht.

Abgesehen davon daß Apple mit OSX Grafik über Tbolt nicht unterstützt ist Tbolt für Grafikkarten schnarchlahm - geachteltes Tenpo für pci3*16er karten.

Antwort von gast5:

Aha.. Na ich glaub das wars dann..

https://www.google.at/search?hl=de-AT&a ... as_rights=

Antwort von Valentino:

http://www.giga.de/laptops/macbook-air/ ... acbook-air

Das soll doch eine Witz sein oder? Der Depp adaptiert erst auf Express34 und beschneidet sich damit selber um ganze drei PCI-E Lanes ;-)))

Damit hat er maximal noch 5Gbit bzw. 900MB/Sekunde für eine Grafikkarte die mindestens acht PCI-E Lanes in der dritten Generation braucht.

Antwort von studiolondon:

Aha.. Na ich glaub das wars dann..

https://www.google.at/search?hl=de-AT&a ... as_rights=

ich zitiere mal deinen link:

"Diese Lösung funktioniert, wie gesagt, mangels vorhandener Mac-Treiber nur mit Windows"

Antwort von studiolondon:

Das soll doch eine Witz sein oder? Der Depp adaptiert erst auf Express34 und beschneidet sich damit selber um ganze drei PCI-E Lanes ;-)))

Damit hat er maximal noch 5Gbit bzw. 900MB/Sekunde für eine Grafikkarte die mindestens acht PCI-E Lanes in der dritten Generation braucht.

Allerfeinstes gebastel - anstelle dessen könnte er auch schlicht ein reguläres notebook mit dual gtx 780m etc nehmen, und waere schneller, besser, günstiger und zudem portabel geblieben....

Antwort von susanne geht zum film:

]]

Es wird nicht mehr stärker

sondern...dünner!!!

ÄBBL

]]

:)

Antwort von gast5:

Schmarren Studio

Wie so vieles hier und anderswo.. *lol

Für die GUI wird's reichen und zwar für die nächsten Jahre..und eben nur für die die meinen das das die d700 dual Konfiguration zu schwachbrüstig ist..*ggg

Antwort von studiolondon:

Lese dir doch einfach die Links durch, die du postest.

Das ist ein Treiberhack einer veralteten Grafikkarte - und der ist nötig, weil OSX Grafik via Tbolt nicht unterstützt.

Der gehackte Treiber ist nicht nur völlig veraltet - und nicht mehr für Davinci einsetzbar - sondern nvidia hat für die gehackte quadro 4000 nichtmal mehr osx 10.9 treiber.

Und sogar der mit veralteter Hardware und dem veralteten gehackten Treiber kommt die Bastellösung dann sofort an die Limits, da Tbolt schlicht zu lahm ist, Zitat von den Hackern selber:

As were essentially forcing the Quadro 4000 to work over a medium its not supposed to work over, please do not expect full performance from the GPU.you can reasonably expect around a quarter of the performance youd get running the card in a Mac Pro

75% Tempoverlust gegenüber einem 2010/11er mac pro, mit gehackten Treibern.

Und schließlich, weil osx eben nicht grafik über tbolt unterstützt, folgt der hinweis, ebenfalls von den machern:

This is a totally unsupported solution (in case you hadnt guessed that already!) weve created this as a proof of concept. do not contact us, or any of the vendors concerned for support.

Eine Machbarkeitsstudie, basierend auf treiberhacking, ohne support & garantie, mit 75% tempoverlust schon gegenüber veralteten pcie2.0 systemen wie 2010/11er macpros und ohne jegliche Unterstützung aktueller Grafikkarten etc. Zudem mit einem soliden tausender euro mehrpreis für die Bastellösung inkl. kabelsalat.

Wenn so deine Vorstellung für professionelles Arbeiten aussieht, bist du mit dem imer-macpro in der Tat hervorragend bedient.

Der Rest der Welt nimmt hingegen die zigfache Leistung, voll supported und ohne treiberhacking & kabelsalat, mit aktuellen und nicht völlig veralteten Grafikkarten - indem man einfach 2,3,4 grafikarten INTERN via pcie 3.0 mit voller bandbreite nutzt.

Antwort von gast5:

Eine Machbarkeitsstudie, basierend auf treiberhacking, ohne support & garantie, mit 75% tempoverlust schon gegenüber veralteten pcie2.0 systemen wie 2010/11er macpros und ohne jegliche Unterstützung aktueller Grafikkarten etc. Zudem mit einem soliden tausender euro Mehrpreis für die Bastellösung inkl. kabelsalat.

das wissen wir doch alles und ich habe auch nicht davon gesprochen eine Bastellösung einzusetzen. DU hast die Hackintoshbastellösung vorgeschlagen nicht ich. Ebenso ist die Verwendung von AMDs 280, 290er auch in der X Version als Bastellösung anzusehen da sich die Geschichte nur mit gehackter Kext Umgebung umsetzten lässt ebenso wie die Aussage das es sich mit AMD's FX und Opteronen verwirklichen lässt ein stabiles System ohne VM Umgebung zu kreieren. Es funktioniert nicht und das schon alleine aus dem Grund das es dir passieren kann, dass du bei jedem OSX Patch in der Angst leben musst das der Kübel nachher noch funktioniert.

Zum verlinkten Geekbench gibts nichts zu sagen. Die Best Off Liste strotzt vor gepumpten Einträgen, besondere Hervorhebung verdient ein Mac Pro 6.1 in DUAL CPU Variante... was soll das außer Schmunzeln generieren?

Ebenso die Luxmark Tabelle die single D700 zur schau stellt und mit einer GPU ID 280X prahlt...noch ein Schmunzler generiert.

viel Interessanter ist der Denkansatz ob der wie schreibst du so schön iMER egal in welcher Ausstattung auch immer überhaupt notwendig ist..

Redshark hat dazu einen Denkansatz geliefert.

http://www.redsharknews.com/business/it ... or-an-imac

Ach ja hier noch noch der aktuelle Chart den du immer so gerne einbindest. *lol

Antwort von studiolondon:

Eine Machbarkeitsstudie, basierend auf treiberhacking, ohne support & garantie, mit 75% tempoverlust schon gegenüber veralteten pcie2.0 systemen wie 2010/11er macpros und ohne jegliche Unterstützung aktueller Grafikkarten etc. Zudem mit einem soliden tausender euro Mehrpreis für die Bastellösung inkl. kabelsalat.

das wissen wir doch alles und ich habe auch nicht davon gesprochen eine Bastellösung einzusetzen. DU hast die Hackintoshbastellösung vorgeschlagen nicht ich.

Für high-end a la davinci ist OSX heute mit Abstand die schwächste Platform - linux und windows sind erheblich besser, sowohl wegen doppelter rechenleistung (dual cpu), drei-, sechs- und mehr-facher grafikleistung mit bis zu 8 GPUs, zudem ungedrosselt und aktuelle modelle, nicht 2011er.

Für einsteiger & mittelklasse a la fcp x & motion hingegen haben die intel-basuerenden hackintoshes bessere leistung, bessere erweiterbarkeit und sind erheblich günstiger.

Wer allen ernstes 2013/14 3000 euro für einen quadcore oder gar 4000 für einen sixcore rauswirft, und dafür dann dafür noch blockiertes pice, kein internes raid, keine internen bestückbaren 2,5/3,5 hdd/ssd laufwerken & optischen brennern und zu allem überfluß auch noch zwangsweise veraltete & gedrosselte 2011er grafik, und davon maximal 2 kauft, der hat es nicht anders verdient.

Ebenso ist die Verwendung von AMDs 280, 290er auch in der X Version als Bastellösung anzusehen da sich die Geschichte nur mit gehackter Kext Umgebung umsetzten lässt ebenso wie die Aussage das es sich mit AMD's FX und Opteronen verwirklichen lässt ein stabiles System ohne VM Umgebung zu kreieren.

Für OSX ohne VM sollte man die Komponenten kaufen, die Apple weiterverkauft - sprich Intel. AMD macht sinn für OSX auf VM, aber in der Leistungklasse 24, 32, 48, 64 cores etc geht man ja so oder so inzwischen typisch mit linux & windows.

Übrigens irrst du - 280, 290 etc brauchen nur kexts wenn man KEINE vm nutzt, ansonsten läuft das einfach mit den standardtreibern out of the box - für rendering a la AE/c4d/maya auch der beste weg. Wenn man nativ OSX fahren will macht es für einsteiger in die Materie mehr sinn, einfach 1 zu 1 die hardware die apple weiterverkauft zu erwerben, bzw. jeweils die besseren geschwister, sprich boards mit pcie, ungedrosselte grafikkarten usw usf. Spart typisch 60-70% des Preises und man bekommt bessere & zudem erweiterbare Hardware.

und wenn manEs funktioniert nicht und das schon alleine aus dem Grund das es dir passieren kann, dass du bei jedem OSX Patch in der Angst leben musst das der Kübel nachher noch funktioniert.

Blödsinn.

Man kauft schlicht nach einem der getesteten Konfigurationsguides wie bspw. von tonymac und wenn man updaten will liest man dort vorab durch ob alles (wie üblich) perfekt funktioniert oder man noch auf einen aktualisierten Treiber warten sollte.

Zum verlinkten Geekbench gibts nichts zu sagen. Die Best Off Liste strotzt vor gepumpten Einträgen, besondere Hervorhebung verdient ein Mac Pro 6.1 in DUAL CPU Variante... was soll das außer Schmunzeln generieren?

Tja, osx auf non-apple hardware ist eben schneller, und dual cpu unter osx geht ja problemlos - so man nicht apple kauft.

Ach ja hier noch noch der aktuelle Chart den du immer so gerne einbindest. *lol

Ähm, ist dir das nicht peinlich?

Du nimmst für deine Grafik jeweils ZWEI grafikkarten im vergleich mit einer einzelnen....

... und apple incl. imer ist da eben schluss mit lustig, während man unter windows & linux (und auch bei hackintoshes) 3,4 oder auch 8 gpus wunderbar betreiben kann.

Aktualisier deine Tabelle mal mit 2 zu 2, 2 zu 4 - dann bist du in der Realität angekommen.

Falls das zu komplex für dich ist - ich hab später heute ein wenig Zeit, dann nehme ich dir das gerne ab. 2 im vergleich zu 4 mach ruhig du, in deinem Fall pädagogisch wertvoll ;)

Antwort von gast5:

Ähm, ist dir das nicht peinlich?

Überhaupt nicht, ist es dir nicht peinlich deine Charts zu verwässern indem du eine dual GPU amd Grafikkarte aka 7990 eingepflegt hast und die Vergleichsparameter ab dem Wert 3000 GFlop/s angibst?

viewtopic.php?p=683260#683260

Du legst immer eigene Maßstäbe an und so einer etwas vergleichendes entgegnet wirst du pampig

Falls das zu komplex für dich ist - ich hab später heute ein wenig Zeit, dann nehme ich dir das gerne ab. 2 im vergleich zu 4 mach ruhig du, in deinem Fall pädagogisch wertvoll ;)

Nicht nötig, wir haben fertig... lachend Trapattoni

Antwort von studiolondon:

Ähm, ist dir das nicht peinlich?

Überhaupt nicht, ist es dir nicht peinlich deine Charts zu verwässern indem du eine dual GPU amd Grafikkarte aka 7990 eingepflegt hast und die Vergleichsparameter ab dem Wert 3000 GFlop/s angibst?

viewtopic.php?p=683260#683260

Du legst immer eigene Maßstäbe an und so einer etwas vergleichendes entgegnet wirst du pampig

dual gpus wie 7990 oder 690 sind eine feine sache - insbesondere wenn nur wenig pcie-slots frei sind.

Werden auch gerne mit hackintoshes und 2010/11er macpro eingesetzt btw.

Vergleich mal mit ZWEI von denen.

Skalen im messbereich erhöhen die lesbarkeit und präzision SEHR - was überhalb des größten und unterhalb des kleinsten wertes sitzt ist schlicht platzverschwendung.

Das ist alles sauber & sinnvoll.

Deine Tabelle hingegen vergleicht ZWEI grafikkarten mit einer einzelnen. Völliger nonsense. Wer 2,3,4 oder auch 8 GPUs braucht setzt die ein, das ist bei PC seit vielen Jahren standard.

Dementsprechend ist deine Tabelle schlicht info-Müll.

Du versuchst einfach die dir unangenehmen Tatsachen zu verdrängen.

Hier ist deine Tabelle mal korrigiert : dual im vergleich mit dual.

zum Bild

zum Bild

Und da Davinci Resolve ja exzellent von 4 oder 8 GPU profitiert, auch der Vergleich.

Um die D300/500/700 noch unterscheiden zu können bleiben wir bei 4 GPUs, beim imer gehen ja leider nur noch 2.

Wie eben auch single cpu anstelle dual cpu.

Damit du glücklich bist fängt die Skala extra für dich bei 0 an - und beinhaltet D300 & D500.

zum Bild

zum Bild

Wobei dein addieren der RAM-Bandbreite relativ witzlos ist - sowohl die Menge wie die Bandbreite des speichers addiert NICHT linear, da jede GPU NUR auf ihren lokalen Speicher zugreifen kann. Sprich, auch eine Dual D300 adressiert jeweils nur 2GB - nicht 4.

Antwort von gast5:

Skalen im messbereich erhöhen die lesbarkeit und präzision SEHR - was überhalb des größten und unterhalb des kleinsten wertes sitzt ist schlicht platzverschwendung.

Alter Schwede du bist ja ein echtes Verkaufgenie, fast so wie unsere Politiker.. Ab und an mal ne Tafel hochhalten mit verbogenen Zahlen und schon gibt es einen neuen Superstar am Himmel.... Du bist also der Meinung das eine Tabelle ein Umsatzplus von 100% bei Einem verkauften Stück des Produkt x im heurigen Jahr gegenüber NULL verkauften Stück im Vorjahr aussagekräftig darstellt? Nun wird einiges klarer..

Wobei dein addieren der RAM-Bandbreite relativ witzlos ist - sowohl die Menge wie die Bandbreite des speichers addiert NICHT linear, da jede GPU NUR auf ihren lokalen Speicher zugreifen kann. Sprich, auch eine Dual D300 adressiert jeweils nur 2GB - nicht 4.

Erde an Studiolondon, dass kommt nicht von mir.. Das kommt von Apple und du selbst hast den Fokus auf die Zahlen der Webseite des HERSTELLER's gelenkt..

Aberwitziges geblubbere wie ich erkennen darf.. *ggggg

Antwort von Jott:

Die 2. oder 3. Klasse in Aktion, leider in L.A.:

"Talk is cheap, and as editors, we believe in showing rather than telling. So, if you want to see a new version of Final Cut Pro X in action running on a new Mac Pro playing back 6K RED Dragon footage on a 4K projector via AJA hardware; cutting an absurd number of streams of multicam 4K footage natively in realtime; moving in and out of DaVinci Resolve seamlessly in a high end Quantum SAN environment (as well as some other things we havent released yet) you'll want to come to the FCPWORKS launch event on Saturday, January 25th at Unici Casa in Los Angeles.

Well be offering our presentation 3 times during the day at 11:00 AM, 3:00 PM and at 7:00 PM to accommodate your schedule. For more information and to reserve your free admission ticket, please visit:

http://www.fcpworks.com/special_event/

Antwort von studiolondon:

Die 2. oder 3. Klasse in Aktion, leider in L.A.:

"Talk is cheap, and as editors, we believe in showing rather than telling. So, if you want to see a new version of Final Cut Pro X in action running on a new Mac Pro playing back 6K RED Dragon footage on a 4K projector via AJA hardware; cutting an absurd number of streams of multicam 4K footage natively in realtime; moving in and out of DaVinci Resolve seamlessly in a high end Quantum SAN environment (as well as some other things we havent released yet) you'll want to come to the FCPWORKS launch event on Saturday, January 25th at Unici Casa in Los Angeles.

Well be offering our presentation 3 times during the day at 11:00 AM, 3:00 PM and at 7:00 PM to accommodate your schedule. For more information and to reserve your free admission ticket, please visit:

http://www.fcpworks.com/special_event/

Tja, und das system

- kann kein 4k uncompressed - schlicht weil die tbolt busse zu langsam sind

- die "high end" SANs sind vermutlich veraltete langsame FC &/ 10 Gbe - weil das schnelle Infiniband a) für tbolt VIEL zu schnell ist (da brauchts pcie3 *8/16) und B9 apple es bis heute nicht hinbekommt, osx infniband-treiber klassen zu integrieren

Und dann staunen die kunden über 4k multistream - was seit JAHREN usus & standard ist. Seit dem letzten Jahrzehnt, um genau zu sein.

Wo die Kunden AUCH staunen werden - wenn sie zum ersten mal mastergüte rendern, ein 3000 apple quadcore oder ein 4000 apple sixcore sind dafür hoffnungslos untermotorisiert. Aktuelle workstations, bspw. die ganz regulären 24 core xeons sind alleine schon cpu-seitig locker 5-6 mal schneller.... Und bei 4K macht das täglich einen riesenunterschied, ob man 10 minuten wartet - oder eine stunde.

Das apple für die verbliebenen osx-kunden mit bedarf an leistung keinen 2013er mac pro bringt - mit dual cpu und pcie - sondern nur den "cube2-imer" demonstriert eindrucksvoll, das der Firma die einst wichtigen professonellen Anwender inzwischen schlicht egal sind - solange sich genug 300 schnittsoftware-user zu einem 3000 quadcore oder 4000 sixcore bequatschen lassen. Ich stell heute abend oder morgen, je nachdem wann zeit über ist noch einen soliden 2000 24 core hier im forum ein - mit genug pcie auch für 4 gpus, internem raid, bluray ohne kabelsalat, potentem netzteil für schnelle & ungedrosselte 2,3,4er 2013er grafikbestückung usw usf - was heute eben standard für kunden ist - ausser man kauft 2te wahl ohne all das bei apple.