Nicht wenige Menschen bezweifeln immer noch, dass künstliche Intelligenz jemals eine ähnliche Stufe wie die menschliche Intelligenz erreichen könnte. Die gängige Argumentation hierfür: Unser Bewusstsein ist mit unserer Wahrnehmung von Realität unabdingbar verknüpft. Und dass "echtes" Bewusstsein in einem Netzwerk aus einfachen mathematischen Formeln entstehen kann, erscheint den meisten renommierten KI-Forschern höchstens eine wirre utopische Idee zu sein.

Doch nun wurde in einem Paper eine ziemlich bemerkenswerte Eigenschaft von neuronalen Netzen beschrieben, die sich schwer erklären lässt. Hierfür erst einmal drei Schritte zurück.

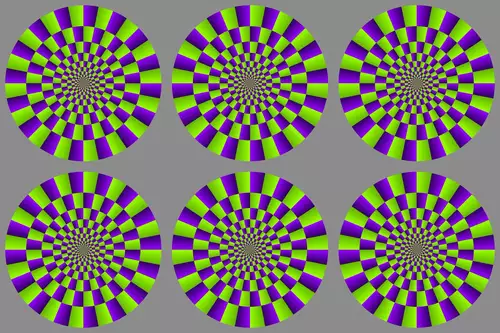

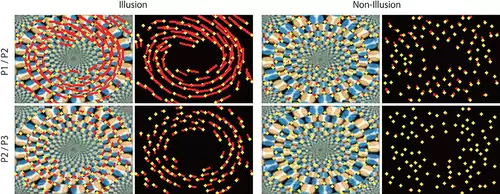

Viele Leser dürften die optische Illusion der Bewegung schon einmal im Internet gesehen haben. Hier einmal zwei schöne Beispielbilder von Akiyoshi Kitaoka, der für diese Art optischer Bewegungsillusionen berühmt ist:

Nein, diese Kreise drehen sich nicht und sind keine animierten GIFs. Alle Pixel stehen still, wie sich z.B. im Photoshop sehr leicht mit einem Picker nachprüfen lässt. Das menschliche Gehirn wird hier einfach mit einer optischen Illusion getäuscht, eine Bewegung in das Bild zu interpretieren. Allerdings nur an Orten, die man mit dem Auge nicht direkt fixiert, sondern einzig in Bereichen die man "im Augenwinkel" wahrnimmt.

Interessanterweise gilt dies nicht nur für Menschen, sondern auch für einige Tiere. Kaum zu glauben? Hier ein empirischer Beleg:

// Top-News auf einen Blick:

- DaVinci Resolve 21 Photo ausführlich im Screencapture Workshop erklärt

- Cartoni Hyperroll - modulares Roll-Rig für kreative Kamerafahrten

- Adobe erklärt die Details zum neuen Premiere Color Mode

- Sennheiser HD 480 PRO - neuer geschlossener Referenzkopfhörer für Studio und Live

- Insta360 Mic Pro - Funkmikro mit farbigem E-Ink-Display und 32-Bit Audio Float

- GoPro MISSION 1 Pro - 8K-Actioncam-Modelle erklärt

Halten wir also fest: Menschen und einige Tiere sehen bei solchen Motiven eine Bewegung im Bild, die objektiv nicht vorhanden ist. Man darf daher annehmen, dass ein "objektiver" Computer auf so einen Irrtum nicht hereinfallen kann. Und auch das stimmt: Lässt man eine Folge solcher (gleicher, unbewegter) Bilder von einem Motion Tracker in einem Compositing-System analysieren, so erhält man... nichts. Es werden keinerlei Bewegungs-Vektoren erkannt. Logisch. Schließlich bewegt sich in dem Bild ja auch nichts. Aber nun wird es spooky...

Lässt man das Motion Tracking von einem neuronalen Netz kalkulieren, dann erkennt dieses plötzlich in dem stehenden Motiv Bewegungsvektoren. Es verhält sich also in der Wahrnehmung wie ein Mensch oder eine Katze und lässt sich von der optischen Illusion täuschen:

Was dies für unsere Zukunft bedeuten könnte, darf sich jeder slashCAM-Leser nun selber ausmalen.