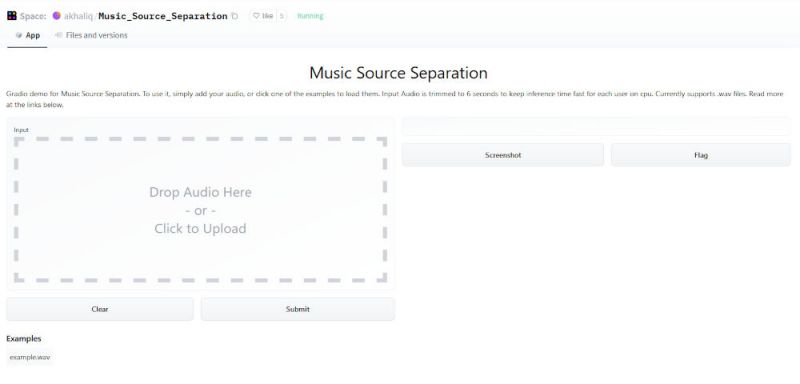

Ein Team vom AI Lab von ByteDance, der Muttergesellschaft von TikTok, hat eine neue, auf neuronalen Netzen basierende Methode vorgestellt, um Musikaufnahmen in mehrere einzelne Tonspuren zu zerlegen. Das folgende Beispiel demonstriert eindrücklich, was der neue Algorithmus vermag: er kann ziemlich sauber die Gesangsspur von der musikalischen Begleitung trennen oder auch das Schlagzeug oder den Bass - und die Musik ohne Bass und Schlagzeug anspielen.

Einsetzen läßt sich die Methode für verschiedene Zwecke: natürlich ist sie perfekt zum Remixen von Musik, wenn man nicht über die einzelnen Spuren der Originalaufnahme verfügt - bei Gesangsaufnahmen in Videos könnten so theoretisch auch nachträglich noch die Stimmen in einer anderen Sprache gedubbt werden. Interessant wäre ein Versuch, ob der Algorithmus auch in der Lage ist, Stimmen aus Aufnahmen vor einer Geräuschkulisse zu extrahieren - er ließe sich dann wie ein intelligenter Rauschfilter nutzen, um nachträglich klarere Aufnahmen zu produzieren.

// Top-News auf einen Blick:

- Sony A7R VI vorgestellt mit 66,8MP, Dual Gain und bis zu 120min 8K-Videoaufnahme

- Canon stellt EOS R6 V und RF 20-50mm F4 als PowerZoom-Kombination vor

- Panasonic Lumix L10 - Kompaktkamera mit GH7-Sensor und V-Log vorgestellt

- ZineControl - Monitoring und Fernsteuerung per App für die Nikon ZR

- Insta360 Luna Ultra mit dualer 8K-Kamera und abnehmbarem Display geleakt

- DJI Osmo Pocket 4P mit Dual-Kamera und 3x Zoom kommt am 14. Mai - nach Cannes

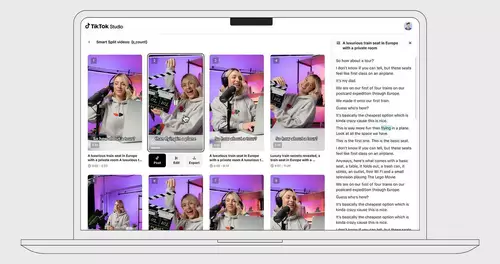

Wer nicht über die erforderlichen Kenntnisse verfügt, kann den Algorithmus hier mit einem kleinen Audioschnipsel seiner Wahl selbst ausprobieren (als Input wird eine maximal 10 Sekunden lange Sounddatei im .Wav-Format benötigt) - bei unserem Test hat die Trennung in Stimm- und Begleitspur sehr gut funktioniert.

Musik separieren zum selbst ausprobieren