Newsmeldung von slashCAM: Hier geht es zur Newsmeldung mit Link und Bildern auf den slashCAM Magazin-Seiten:

Hier geht es zur Newsmeldung mit Link und Bildern auf den slashCAM Magazin-Seiten:

Magic Lantern - mehr Dynamik als Canon kann?

Antwort von Serge:

Die Dual-ISO-Funktion ist wohl nur für Fotos zufriedenstellend. Leider

Die Auflösung in den hellen Bildbereichen war zumindest bei meinem Videomaterial (und nach dem nötigen Prozedere) unbrauchbar.

Antwort von BLNeos:

Soweit ich das verstanden habe, kann Canon den Sensor nicht mit den geraden ISO Werten auslesen. Was Canon nun tut ist, dass sie ein Bild mit weniger ISO auslesen und das dann digital aufhellen.

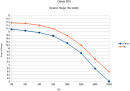

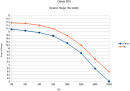

Das sieht im folgenden ungefähr so aus: (Tabelle von a1ex vom ML-Forum)

Wenn man die Kamera auf 100 ISO einstellt, liest sie das Bild vom Sensor mit ISO88 und hellt es um 0,18EV nachträglich auf. Dadurch geht Dynamik verloren.

Das sind, so glaube ich, die Werte der 60d

Base ISO With low ADTG gain Highlights gained

100 88 0.18 EV

200 158 0.34 EV

400 311 0.36 EV

800 633 0.34 EV

1600 1260 0.34 EV

3200 2515 0.35 EV

6400 2515 1.35 EV

Liege ich da richtig oder klärt mich jemand eines besseren auf?

Machen das die anderen Kamerahersteller auch? mich würde ein krummer ISO wert jetzt so ziemlich überhauptnicht stören. Interessant ist auch dass die highISO"s mit dem gleichen Gain vom Sensor gelesen werden und nachträglich "analog" nocheinmal auf den entsprechenden ISO Wert aufgehellt werden?

Antwort von WoWu:

Also mehr, als man in den linearen 14 RAW-Bit des Sensor-Outputs speichern kann.

Auch wenn ML das Wort "magic" führt, werden sie nicht zaubern können denn der max. Dynamikumfang der Kamera wird ausschliesslich durch den Sensor bestimmt. und liegt zwischen den werten des Sensorrauschens und der maximalen Ladungsmenge.

Was ML da tut, ist eine andere Aufteilung der Quantisierung, die dann zwar zu einer scheinbar neuen Blende führt, innerhalb der Blenden aber die Werteabstufung verkleinert.

Das kann man natürlich machen aber ist ein Taschenspielertrick und ausserdem wird der gesamte Störabstand reduziert, weil jede zweite Zeile in der Verstärkung höher liegt.

Mehr, als der Sensor hat, geht nun mal nicht ... sonst müsste man gar keine neuen Sensoren mehr entwickeln.

Canon weiss schon, was sie da tun denn schliesslich müssen sie für die technischen Parameter auch (nachprüfbar) gerade stehen.

Antwort von chmee:

Ich gehe natürlich davon aus, dass Du im Thread bei ML schon gelesen hast, WoWu.. Angenommen:

* Canon hat konservative Werte für die AD-Verstärkung gewählt..

(A) Es hätte Niemand erfahren. eigentlich.. Wer kramt schon in den ADTG-Registern des Digic..

(B) Wäre darauf basierend die Annahme, da wäre noch was zu holen.

* Ist die "andere Aufteilung der Quantisierung" ein wirkliches Problem oder nur ein akademisches?

Antwort von WoWu:

Die 2-Zeilen Geschichte mit unterschiedlichen IS) Werten ist schlechter denn sie verschlechtert den Störabstand selbst in Bereichen, wo es nicht nötig gewesen wäre.

Canon ist eine der wenigen Firmen, die eine 2-kanalige Verarbeitung macht, die diverse Vorteile mit sich bringt und die Canon schon so nutzt, wie es am Sinnvollsten ist, indem im unteren Bereich eine dafür spezialisierte Verstärkungskurve und im oberen Bereich der entsprechend zweite Verstärkungsweg mit optimierten Werten genutzt wird. So erreicht man das Optimum des Sensors. Mische ich jetzt diese Beiden Wege durch diese schwachsinnige Zeilentrennung, reduziere ich mir die Werte in beiden Bereichen.

Alles was ich erreiche ist eine optische Mischung von dunklen und hellen Werten, aber bei geringerem Störabstand und .... wenn die Trennung konsequent erfolgt (und ich sehe keinen andern Weg), dann schiebe ich mir die beiden ungewollten Phasen (Schwarz und Sättigung) noch zusätzlich ins Bild, die bei der Originalmethode unterdrückt werden, also dort keine Verfälschungen ergibt.

Eine Zeilenweise (individuelle) Verstärkung ist nur in einem völlig anderen Abtastkonzept gewinnbringend, das mit der Belichtungsmessung verkoppelt ist.

Aber das ist hier nicht der Fall.

Sowieso ist auch die Grafik komisch denn einen Unterschied bei ISO 100 kann es gar nicht geben, weil das der Punkt ist, an dem 1 Photon=1 Elektron=1 EV darstellt.

Wo also soll das andere Proton bei ML hergekommen sein ? Und ausserdem liegt der Punkt so oder so tief im Rauschen, weil die meisten Sensoren dieser Klasse so um die 7-10 e- Rauschen haben, also haben sie vergessen, die nutzbaren Blenden ab dem Punkt zu messen, an dem der Sensor aus dem Rauschen kommt, wie man das üblicherweise tut.

Sie hätten mal lieber den Störabstand statt der Blenden angeben sollen. Die Blenden sind da Schall und Rauch.

Antwort von iasi:

aber aber - bei der Magie geht es um Täuschung und Illusion - und das machen sie hier schon richtig ...

Antwort von chmee:

wir reden gerade aber nicht von der Dual-ISO-Geschichte, die schon im Spätsommer "gebaut" wurde..

Ich weiß, dass wir beide nur schwer zueinander finden, WoWu, Dein Wissen aber könntest Du besser anlegen.. in positiveren Worten.

BLNeos

Quasi kein Sensor hat nen nativen geraden ISO-Wert. Es gibt dafür die REI (Recommended Exposure Index), die das standardisiert, eine Umrechnungstabelle quasi, um wieviel die Sensordaten aufgehellt/abgeschwächt werden.

Antwort von WoWu:

Ich hatte das so verstanden ... aber es bleibt die Frage ... woher soll die (jeweils) doppelte Photonenmenge kommen, um sich im Störabstand entsprechend zu verbessern ?

Wie gesagt ... mit Magie geht das nicht. Da muss schon Licht her oder rauschärmere Verstärkungen.... und selbst dann kommt man an den Sensortasten nicht vorbei.

Antwort von chmee:

Tatsächlich ist es doch so, dass die Sache frisch "gefunden" wurde. Die Erkenntnis, ob es gut ist oder negative Seiteffekte mit sich bringt, kann in so einem frühen Stadium noch nicht gesagt werden. Vielleicht waren die Canon-Werte konservativ - und vielleicht hatte das irgendeinen Sinn, der uns noch offenbar wird..

In der Regel liegen die Canon-RAW-Daten in einem Nutzwertebereich zw. 2048 und ~15.000. Sprich, es gibt durch eine "aggressivere" Verstärkung auch noch was zu holen. Und letztlich ist der interessante Bereich der in den Tiefen.

Antwort von WoWu:

Ja, nur den "tiefen Bereich" nutzt Canon ja bereits durch die Benutzung de "Low Konversion Gains".

Und wenn man bedenkt, welchen Aufwand die Firmen mit ihren Log Kurven getrieben haben, nur um den unteren Bereich höher aufzulösen und damit letztlich auch nur etwa eine halbe Blende (auf kosten der oberen Dynamik verändert haben, dann wäre so ein Gewinn von 1/2 bis einer Blende schon signifikant. ... Nur sie kommen eben auch nicht an der Sensordynamik vorbei.

Die ist nun mal in Silizium gemeisselt.

Antwort von Drushba:

Also ich nutze Dual Iso zum Fotografieren in Extremsituationen, z.B. bei gegenlichtigen Aufnahmen - das funktioniert ganz gut. Im Gegensatz zu den Fixed noise patterns, die entstehen, wenn ich ohne Dual Iso in Lightroom die Tiefen anhebe, bleiben die dunklen Bereiche so einigermassen rauschfrei. Die DR steigt zumindest gefühlt stark an. Dass hier etwas Auflösung verloren geht - was solls. Ich vergrössere maximal auf 30x40 oder DIN A4 und da sehe ich keinen Schärfeunterschied. Wenn jetzt noch etwas DR dazukommt, ist das gut. Ich werds auf jeden Fall mal ausprobieren und freu mich wenns klappt, auch wenn es das aus technischer Sicht (die ich nicht wirklich verstehe - das gebe ich gerne zu) eigentlich nicht darf;-). Schade nur, dass man beim Filmen so aufpassen muß, dass gerade Linien nicht flirren...

Antwort von WoWu:

... von "dürfen" kann nicht die Rede sein. Selbstverständlich "dürfen": Bilder rauschen und bei diversen Einstellungen auch Rauschverminderungen einsetzen, die die Bildinhalte verändern.

Nur sollte man in solchen Artikeln nicht den Eindruck erwecken, es ginge "ohne Nebenwirkungen" und man habe das "goldene Ei" gelegt.

Darum geht es nur.

Ob man damit nun leben kann - oder nicht- ist dabei zweitrangig.

Viele Anwender können auch mit Rauschen ganz prima leben und sehen darin sogar den Grainersatz des Films ...

Welcher Anwender hat also Recht ? Der der 14 (oder mehr) Blenden braucht, um das Bild als "gut" anzusehen oder der, der mit 8 Blenden auskommt und sich über das Grein freut ?

Beide haben Recht nur der nicht, der sagt, er können mehr als der Sensor hergibt.

Antwort von chmee:

WoWu, Du gehst in Deiner Position stets davon aus, dass Canon das Optimum bereits herausgeholt hat. Und ich sehe da immer noch ganz viel Potential, "halbherzig" klingt bezüglich mancher Eigenschaften noch nett. Theoretisch kann das auch auf die Sensorverarbeitung zutreffen, praktisch kann die ML-Crew uU(!) Hinweise darauf geben.

Antwort von WoWu:

Die "Crew" von ML kann in Softwarelisten herumstochern, wo sie an Parameter drehen kann. Sie kann nicht in die bestehende Hardware eingreifen, auch nicht in die Betriebssoftware des Sensors und schon gar nicht in dessen physikalische Eigenschaften.

Ein Sensor hat feststehende Rahmenparameter, die die Leistungsfähigkeit der Kamera festlegen.

Die ML Crew kann auch nicht zaubern und wenn Canon den einen oder andern Parameter so, und nicht anders gewählt hat, wird das seine Gründe haben.

Du wirst es mir sicher nicht verübeln, wenn ich den Konstruktionsingenieuren von Canon da etwas mehr zutraue, als den Bastlern von ML, zumal sie nicht mal vernünftig dokumentieren sondern mit solchen obskuren Grafiken aufwarten, wie in dem Artikel gezeigt.

Das ist einfach unsolide, um es einmal gemässigt auszudrücken.

Antwort von chmee:

:) Die Canon-Ingenieure haben

* einen fast nutzlosen SD-Card-Slot in die 5DIII gebaut.

* einen rudimentären Auto-ISO-Mode implementiert.

* WLAN und GPS-Funktionalität ähnlich solide umgesetzt.

* der ALL-I Mode bringt in Sachen BQ quasi keinen Fortschritt.

* der HDMI-Out bringt per se nur einen Vorteil, nämlich gleich in einem anderen Format zB ProRes zu speichern. Ansonsten der gleiche Kladderadatsch.

Ganz ehrlich, so ganz unfehlbar sind diese Typen nicht. Ich mecker Hier auf hohem Niveau, dennoch ist mE diese Glorifizierung n bisschen zu viel des Guten.

..zumal sie nicht mal vernünftig dokumentieren sondern mit solchen obskuren Grafiken aufwarten, wie in dem Artikel gezeigt. ..

Nachtrag: Von welchem Artikel sprichst Du? Dieses gezeigte Diagramm ist eine(!) Darstellung in der Diskussion - und für den DAU die aussagekräftigste.. Ich fragte Dich schon anfangs, ob Du im ML-Forum gelesen hast und ob da nicht zufälligerweise Infos stehen, die Du vermisst.

http://www.magiclantern.fm/forum/index.php?topic=9867.0

Antwort von WoWu:

Danke für die Auflistung ... wer hat solche Beurteilungen getroffen, bzw. formuliert ?

Nach wie vor baut Canon gut funktionierende Kameras auf einem zeitgemässen Niveau. Vergessen werden darf auch nicht, dass der Konstruktionvorlauf -wenn man sich auf die Angaben der chipherstellenden Industrie verlassen darf- rd. 2 Jahre beträgt.

Von den ML Leuten habe ich, bis auch ein paar Pasches bisher keine solche Konstruktion gesehen ... oder hab ich was verpasst ?

Nein, ich bin in solchen Foren nicht unterwegs weil ich kein Bastler sondern Anwender bin.

Was den Artikel betrifft, beschwer Dich bei Slashcam, die das, ohne den entsprechenden Einschränkungsvermerk, veröffentlicht haben.

- Aber mal die Frage nebenbei- was gibt es an Messungen eigentlich zu diskutieren ?

Entweder habe ich gemessen ... und stelle das Ergebnis in einer korrekten Grafik dar ... oder ich habe nicht gemessen.

Inwieweit sind also Messergebnisse diskutierbar. Sie mögen interpretierbar sein ... und das habe ich getan. Aber sie sind nicht diskutierbar, denn durch die Erörterung werden ja wohl keine andern Messungen dabei entstehen ?

Oder wird das so in dem Forum gehandhabt ?

Antwort von dienstag_01:

* der ALL-I Mode bringt in Sachen BQ quasi keinen Fortschritt.

Muss er das? Kling eher nach dem Wunschdenken der Gläubigen.

Antwort von chmee:

@WoWu

die Liste habe ich ad hoc zusammengestellt. Dinge, die "ich" verwundenswert finde - aus/in der Anwendung erfahren. Bitte nicht auf Foristentum plädieren..

Dennoch, hast Du denn jetzt inzwischen mal in den Thread reingeschaut? Oder möchtest Du weiter über fehlende Daten meckern, die Du uU dort findest? Deine Kritik basiert weiterhin auf der Aussage, Canon hätte schon alles optimal gemacht - und ich erwähne, dass ich an deren Perfektionswillen nicht glaube.. Wer von uns beiden hat mehr recht?

@dienstag_02

Ich habe weniger Probleme mit dem Arbeiten mit den IPB-Videos. Warum sollte ich also auf ALL-I bei dreifacher Datenrate ausweichen? Gibt es denn noch so schwache Rechner, wo es so einen derben Unterschied gibt?

Antwort von Angry_C:

Ganz nebenbei, wer weiß denn überhaupt, ob Canon ihre Sensoren bis an die Grenzen fährt? Der gemessene Dynamikumfang in der DXO-Datenbank muss ja nicht gleichzeitig auch der maximal mögliche sein, weil Canon ihn eben nicht voll ausnutzt um noch "sauber" zu bleiben. Oder bin ich jetzt voll von der Spur?

Antwort von Jan:

Das ist die gleiche Sache wie bei Panasonic damals mit der Bitrate.

Findige Tüftler bliesen die damals auf, nur kam nicht sonderlich viel Mehrwert daraus.

Panasonic hätte die Datenrate genau so steigern können, aber denen waren die geringen Vorteile und der daraus entstehende Nachteil in Sachen Kühlung & saubere Verarbeitung / Speicherverwaltung bekannt.

VG

Jan

Antwort von dienstag_01:

Die Unterstellung ist ja, dass die Firmen (hier Canon) bewusst ihre Hardware nicht ausreizen, um ihre Kategorisierung und Abgrenzung zu höherpreisigen Produkten nicht aufgeben zu müssen. Also keine Canibalisierung in eigener Sache.

Die Frage daraus ist, wären solche schlummernden Potentiale durch ein paar Softwareanpassungen zu heben?

Die BMCC ist ja so eine Kamera, die völlig losgelöst von solchen firmeninternen Abhängigkeiten entwickelt wurde. Beweist die nun so eine Art *Schwachhalten* der Consumerklasse bei anderen Firmen? Oder beschränkt sich das rein auf das RAW-Format?

Antwort von chmee:

@Jan

Das sieht bei Canon genau so aus, die Veränderung der h264-Kodierungswerte im Body hat nichts (deutlich zu wenig) gebracht und ist deswegen seitens ML so ziemlich auf Eis gelegt. C'est la vie. Nur, sollte man erstmal diese News pauschal verneinen, obwohl das Magiclantern-Team nachweislich genug positive Gadgets für die Canonwelt zusammengestückelt hat? Sie sind die einzigen Reverse Engineer'er und die anderen Hersteller-Hacker kommen jetzt erst aus den Pötten..

@Angry_C

DxO stellt gewisse Forderungen an die Daten, oder besser: an die SNR. Ich habe selbst mal nen unwissenschaftlichen(!) Test gemacht, und ich habe auch mit ner 5D noch Unterschiede zwischen Schwarz und -13LW gesehen. Die Werte so weit unten in den Schatten rauschen aber so derbe, dass sie eben nicht mehr als "Nutzsignal" aufgefasst werden. Wie es zB Sony macht kann ja egal sein, sie schaffen es, mit ihrem Sensor auch da noch Nutzdaten herauszuholen.

http://www.phreekz.de/wordpress/2013/04 ... -5d-5diii/

Antwort von Rick SSon:

Die Unterstellung ist ja, dass die Firmen (hier Canon) bewusst ihre Hardware nicht ausreizen, um ihre Kategorisierung und Abgrenzung zu höherpreisigen Produkten nicht aufgeben zu müssen. Also keine Canibalisierung in eigener Sache.

Die Frage daraus ist, wären solche schlummernden Potentiale durch ein paar Softwareanpassungen zu heben?

Die BMCC ist ja so eine Kamera, die völlig losgelöst von solchen firmeninternen Abhängigkeiten entwickelt wurde. Beweist die nun so eine Art *Schwachhalten* der Consumerklasse bei anderen Firmen? Oder beschränkt sich das rein auf das RAW-Format?

Hm, also wenn ich mir ansehe was aus meiner BMPC für unter 1000 Euro so raus kommt, dann kann ich Vieles von dem, was diverse Firmen für deutlich mehr Geld an den Mann bringen wollen nur als Frechheit gegenüber dem Kunden abtun.

Antwort von WoWu:

Es gibt zwei Werte, an denen kommt weder Canon, noch ML vorbei:

Der Wert für "Dark current" und FullWell und egal, wie hoch Dark current liegt, bei einem Phroton liegt die Skalierung für ISO100.

Entsprechend dem Abstand zwischen ISO100 und dem realen DC Wert liegen nicht nutzbare EV Werte, oberhalb derer erst der nutzbare Bereich beginnt und am FullWell endet.

Diesem Bereich wird der wesentliche Teil der Quantisierung gewidmet, mit unterschiedlichen Ansätzen.

Da gibt es nichts, was Canon nicht ausnutzen würde, um ggf. noch irgendwelche Reserven zu haben.

Das sind Phantasien derer, die erklären müssen, woher ihr "pseudo Gewinn" kommt.

Auch für Canon ist 1 Proton das erste gewonnene e-, genau so wie für Sony, Nikon, BMD und alle andern Hersteller und FullWell ist FullWell, auch wie bei allen andern Herstellern.

Ganz im Gegenteil, sie versuchen mit der Optimierung von Gammakurven auch noch das optisch Mögliche aus den paar Werten heraus zu holen, um auch einen "durchsichtigeren" Bildeindruck zu schaffen, der näher am Sehempfinden liegt.

Sie wären mit dem Klammerbeutel gepudert, wenn sie sich auch nur ein einziges Elektron entgehen lassen würden.

Messen kann man nun natürlich noch von der oberen DC Grenze, hinein ins Rauschen und das als EV Wert deklarieren, um so pseudo Blenden zu schaffen, wie das oben in einer der Tabellen vorkommt, wo dann 0,xx EV Werte auftauchen, also weniger als 1 Photon pro Blende .... dann kann man bis Unendliche Blenden erzeugen ... leider Schwachsinn.

Durch Re-Engineering hat noch niemand auf der Welt geschafft, Hardware zu verändern. Man kann dadurch nur Rückschlüsse auf bestehende Hardware/Software gewinnen.

Re-Engineering heisst, aus der Performanz, oder dem, wie das Gerät sich verhält, auf das Verfahren oder die benutzte Hardware zu schliessen, um dann mit den "gekupferten" Erkenntnissen ggf. mit ähnlicher Hard/Software ein anderes Produkt zu bauen.

Mir ist aber nicht bekannt, dass ML irgendwelche Hardware neu eingebaut hat, die die Leistung der Kameras verbessert.

Antwort von Angry_C:

Hm, also wenn ich mir ansehe was aus meiner BMPC für unter 1000 Euro so raus kommt, dann kann ich Vieles von dem, was diverse Firmen für deutlich mehr Geld an den Mann bringen wollen nur als Frechheit gegenüber dem Kunden abtun.

Und soll ich mal anfangen, die Dinge aufzuzählen, die bei Blackmagic und deren Cinema Cameras an einer Frechheit grenzen?

Die Liste wäre ziemlich lang, aber das weißt du sicherlich als BMPCC Besitzer.

Antwort von chmee:

WoWu, Du drehst Dich im Kreis. Das hast Du schon geschrieben.

Re-Engineering heisst auch, ein Produkt nachbessern zu können. Wie dem auch sei, Dir gefällt Dein Standpunkt, mir ist er zu engstirnig, zu naiv.. Naiv mag auch mein Glaube sein, jedenfalls gibt es noch genug Platz für Veri- und Falsifikationen. Der RAW-Mode hat Dir ja auch schon nicht mehr gefallen - alles zu hanebüchen..

mfg chmee

Antwort von WoWu:

@chmee

Gib mir doch ein paar Fakten statt Der Beschimpfungen.

Das würde die Sache weiterbringen.

Ach, und zum Thema Reverse-Engineering:

Reverse Engineering (engl., bedeutet: umgekehrt entwickeln, rekonstruieren, Kürzel: RE), auch Nachkonstruktion, bezeichnet den Vorgang, aus einem bestehenden, fertigen System oder einem meistens industriell gefertigten Produkt durch Untersuchung der Strukturen, Zustände und Verhaltensweisen, die Konstruktionselemente zu extrahieren. Aus dem fertigen Objekt wird somit wieder ein Plan erstellt. Im Gegensatz zu einer funktionellen Nachempfindung, die ebenso auf Analysen nach dem Black-Box-Prinzip aufbauen kann, wird durch Reverse Engineering angestrebt, das vorliegende Objekt weitgehend exakt abzubilden. Häufig wird versucht, zur Verifikation der gewonnenen Einsichten eine 1:1-Kopie des Objekts anzufertigen, auf deren Basis es grundsätzlich möglich ist, Weiterentwicklung zu betreiben.

Wenn Du also von Re-Engineering sprichst, solltest Du vorher wissen, was es bedeutet.

Antwort von chmee:

Ja Und? Hier werden Teilbereiche des "Objekts Fotoapparat" analysiert, nämlich Firmware, OS und Funktionen. Was Du Dich so dagegen wehrst, ist mir ein Rätsel. ML ist eine funktionierende Software basierend auf Informationen, die es nicht öffentlich gibt, ergo mussten jene rekonstruiert(!) werden.

Deine Aussage:

Re-Engineering heisst .. um dann mit den "gekupferten" Erkenntnissen ggf. mit ähnlicher Hard/Software ein anderes Produkt zu bauen.

Blödsinn. Es geht primär um Erkenntnis um das analysierte Objekt oder Teilbereiche, in diesem Fall in Teilen Mainboarddesign, zum größten Teil Softwareumsetzung.

Welche Fakten willst Du denn hören? Die Obigen haben Dir nicht geschmeckt, klangen Dir zu Forengequatsche - sind aber leidige Tatsache. Das f/8 Update für 5DIII und 1DX sind gleichermaßen ein Zeichen für die Imperfektion des Entwicklerteams. Daraus lässt sich -rein logisch- ableiten, dass es eine Teilmenge von Dingen gibt, die nicht auffallen bzw. nicht kritisiert werden, aber optimierbar wären. Andersrum: Dinge, die funktionieren, beweisen mit ihrer Funktionalität noch lange nicht, dass sie optimal sind. In Deiner Argumentation ist nirgends bewiesen, dass der Arbeitsablauf Sensor-Verstärkung-Wandlung-Ausgabe optimal ist..

Antwort von WoWu:

Schau Dir die Sensortasten an, dann kannst Du es (vielleicht) selbst nachrechnen.

Ausserdem kannst Du jetzt dieses Unsabstatielle ohne mich weiter führen.

Sowas ist nämlich genau der Grund, warum ich auf solchen Fanfaren nicht zu finden bin.

Antwort von Bergspetzl:

WoWu,

bitte sieh doch einfach ein ,dass weder Canon noch Andere alles, was möglich "wäre", auch möglich machen.

Es mag schon sein, dass nicht jeder versteht was du weisst und du ärgerst dich, dass Menschen Infos über Dinge bekommen, die sie im Grunde nicht verstehen. So wie wenn es heißt die ML Crew hat eine halbe Blende gewonnen.

Hier liegt es an der Definition. ML kann natürlich nicht mehr aus dem Chip herauskitzeln, als er physikalisch leisten kann. Darauf hast du auch vermehrt hingewiesen. Ebenso auf dein Vertrauen in die Canon Ingenieure. Sie werden wissen was sie tun. Richtig.

Aber du siehst auch ein, das so ein Chip softwareseitig kontrolliert und ausgewertet wird. Hier fängt der beeinflussbare Teil an. Hier kommt die ML Crew ins Spiel.

Und es ist wohl im Rahmen des denkbaren, dass diese ML-Leute sich in der Softwareumgebung so bewegen, dass sie aus dem vorliegenden Gerät "mehr" rauskitzeln als bisher von Canon zugänglich gemacht wurde.

Auch du wirst doch folgendes einsehen: Der Ingenieur bei Canon würde aus dieser Kamera evtl. einen "Gamechanger" bauen können. Wenn er dürfte. Nur darf er nicht. Er hat in einem gesteckten Rahmen zu entwickeln und zu bauen, und mit etwas Glück kann er etwas mehr dazu geben als zuerst abgemacht. Aber es wird nicht das letzte bisschen Möglichkeit der Technik sein.

Vielleicht ist die Hardware so eng angeschneidert, das kaum Spielräume sind, vielleicht liegen aber auch noch irgendwo ungenutze Reserven. Auch Canon kauft seine Einzelteile ein, oder gibt sie in Auftrag und irgendwo kann (wird) (vllt) etwas verbaut sein, dass etwas mehr leisten kann als in dieser Funktion aktuell benötigt.

Die ML Jungs gehen durch dieses Haus und probieren mal jede Türe aus. Was liegt dahinter. Und ab und an finden sie mal einen Raum, der noch nicht bis an die Decke vollgestellt ist. Trial and Error, wie du bemerkst. Keiner behauptet was anderes.

Nachdem zum Beispiel ML-Raw nun seit einiger Zeit beschwerdefrei läuft darf man davon ausgehen, dass es die Kamera stabil leisten kann. Deiner Logik nach müsste es also schon verbaut sein. Die Ingeneure gehen ja bereits ans vertretbare Limit. Die 5DMKIII wurde speziell mit ihrer professionellen Videofunktion beworben, sie wurde implementiert. Stelle sie nicht als Abfallprodukt der Kamera hin ;) Warum also kein RAW wenn es möglich ist, von Werk? Und warum also nicht die volle softwareseitge Möglichkeit der Sensordatenverarbeitung?

Ich glaube, das die Kamera hardwareseitig nicht voll ausgereizt ist, wie das Meiste am Markt. Siehe doch Thema Grafikkarten, Prozessoren, oder auch durch Chips in ihrer Leistung beschnittene Automotoren. Das ist doch nichts neues und warum glaubst du also nicht, dass dort noch Reserven zu finden sind? Das kratz doch nicht an der Leistung der Ingeneure, die sicher ganz andere Dinge könnten, mit der Technik, wenn sie dürften...?

Antwort von WoWu:

Du unterstellst in Deiner wortreichen Ausführung einfach Dinge, die nirgendwo belegt sind, wohingegen die Daten des Sensors als Fakt nachzulesen sind und von ML keine transparenz besteht, was für Daten sie verändert haben und in welcher Abhängigkeit diese zu andern Parametern der Bildperformanz stehen.

Anders als die Gläubigen gehe ich nicht davon aus, dass die HW/SW Kombination der Kamera mehr kann, als Canon benutzt hat, ohne dass andere Bildparameter darunter leiden.

Solche Kamera sind designed, geschmacklich gute Bilder zu machen.

Also... zeig her die gesamten Messprotokolle und man wird sehen, wie das Ergebnis an welcher Stelle aussieht.

Floskeln ersetzen keine Fakten, von denen nicht ein Einziger in Deiner Ausführung zu finden war.

Edit:

Aber ich will Dir ein Beispiel sagen, weil Du so softwargläubig bist:

Du kannst mit Software die Übertragungskurve so gestalten, dass sie im oberen Bereich total flach verläuft. Dadurch kannst Du quasi unendlich viele Lichtverdopplungen (Blenden) erreichen, ohne dass Du ein einziges Proton mehr auf dem Sensor hast. Erfolg ist, dass Deine Übertragungsschritte in dem Bereich immer kleiner werden und deine Abstufungen zwischen den Stufen immer gröber.

Du kannst mit Software keinen einzigen Parameter an der Leistungsfähigkeit Deines Sensors und damit an der Dynamik der Kamera ändern.

Und Canon muss auch das erste Proton für ISO 100 nutzen und kann oberhalb von FullWell auch keine Elektronen mehr differenzieren. Und ML wird auch beim ersten Proton anfangen und kann oberhalb von FW auch nix mehr machen.

Software hin oder her.

Antwort von Tiefflieger:

Man kauft sich eine Kamera, weil sie genau das bietet was man braucht.

Alles andere was nicht spezifiziert ist, ist experimentell und kann Langzeitfolgen haben (thermische Alterung, Arbeitspunkte, ein Lüfter wie ein Föhn....)

Antwort von WoWu:

Das Problem ist hier nur, dass jemand behauptet, in ein 1 l Mass noch 10 ccm mehr hinein zu bekommen, nur weil er die Skalierung ändert.

Antwort von Bergspetzl:

@ Tiefflieger

mag sein, davon redet ja auch niemand, wie gesund das für die hardware am ende ist

@ WoWu

http://www.magiclantern.fm/forum/index. ... 8#msg96488

Ich las dem Thread nach bestem wissen und gewissen und verstand nicht alles. aber was numal fakt ist, ist das diese Jungs versuchen zu verstehen wie sie die Ergenisse zu interpretieren haebn, wie sie daraus folgern sollen und wie man es verarbeiten kann. Und das sie dort ein phänomen vorgefunden haben, dass man vielleicht in eine richtung biegen kann.

Anstelle so zu wettern könntest du dich ja einbringen, aber nicht dass dann dein ganzes Weltbild zusammen bricht, wenn sich dynamiken entwickeln würden, für die diese welt nicht gedacht wäre. weil diese Welt ist nur für ihre festen Rahmen gebaut, so wie diese Kamera.

entschuldige das trollen jetzt, aber du weisst doch eigentlich selber wie es läuft. ich arbeite ab und an in der sendetechnik, und wir haben schon das eine oder andere gerät umgelötet oder sachen überbrückt um fähigkeiten zu entfesseln, die zwar in den geräten steckten, aber so nicht zugänglich waren,w eil es es aber gerade so brauchten. obwohl das teure geräte waren, gibt es fast immer beipässe die man legen kann, wenn man weiss wie. ich gebe zu, ich bin nicht der, der das rausfindet, aber ich habe das jetzt schon einige male mitgemacht. so wird eigentliche leistung maximal entfacht, aber niemand zaubert.

Warum um alles in der welt sollte das nicht auch in so einer hundsnormalen (drecks) kamera möglich sein, die für einen massenmarkt produziert wird? wir reden hier ja nicht von den kronjuwelen und handgearbeiteten unikaten sondern einfach von einem (hochklassigem) foto-film hybriden. glaub doch das man durch spielen an registerkärtchen eine andere zusammensetzung der daten(!) erreichen kann, zuerst einmal als messkurve, und zweitrangig mal das "geschmakliche" bild. Vielleicht erreicht man ja auch nur theoretisch bessere werte, und später wird das bild aber grottig, weil etwas anderes querschießt. mag alles sein, aber das ändert doch nichts an der tatsache, das die ML Crew abseits von Canons programierung die daten aus dem chip anders entfesselt bzw ausliest und interpretiert. wie du sagst ist der chip ja nur ein signalwandler. wie sie die grütze hinten raus anfassen ist doch jedem sein bier. keiner sagte, dass das ausgangssignal der ml jungs auf einer anderen physikalische größe haraus besteht, als der chip leisten kann, sondern nur, dass sie bei der interpretation deselektrischen bildes eine halbe blende mehr rausgekitzelt haben (vielleicht auf kosten von was weiss ich denn.)

Wenn ich dem besten chip der welt beschissen progammiere kann ein 25blenden chip nachher nur 5blendenan meinen signalinterpretierer weitergeben, und dieser berechnet daraus das endprodukt. wer hat jetzt recht? der hersteller, der sagt: meine kamera hat einen umfang von 5 blenden, oder der hacker der draufkommt, der chip könnte 25blenden?

Antwort von WoWu:

Anstelle so zu wettern könntest du dich ja einbringen, aber nicht dass dann dein ganzes Weltbild zusammen bricht, wenn sich dynamiken entwickeln würden, für die diese welt nicht gedacht wäre. weil diese Welt ist nur für ihre festen Rahmen gebaut, so wie diese Kamera.

Ich brauch gar nicht weiter lesen.

Wie ich immer so gern sage:

Polemische Beißreflexe sind vor Allem ein Zeichen mangelnden Argumentationsvermögens.

Antwort von chmee:

@WoWu

witziges Wortspiel. Nur hat weder Canon gesagt, dass es ein 1L-Messbecher ist, noch, dass sie immer auf 1L vollmachen.

(Auf Deinen letzten Beitrag: Dennoch hat er recht, mit Deinem Wissen könntest Du auch behilflich sein, das bist Du aber nicht. Hast Du den Beitrag im ML-Forum inzwischen überflogen?)

@bergspetzl

das wiederum ist noch ne andere Geschichte. Ich sehe es ein, wenn Geräte nicht mit allem vollgestopft wird, was man theoretisch aus der Kombination der Einzelteile herausholen könnte. Nicht mal die C500 wirft 14bit Sensor-Raw-Daten raus, sondern "nur" 10 und 12bit über 3G-HD/SDI. So betrachtet ist die 5DIII, wie sie ist, ein Arbeitstier ohne große Makel. Dennoch ist dies kein Grund zu denken, die schon verbauten "Eigenschaften" wären bis aufs Letzte optimiert.

Bis zur 5DII leuchteten die AF-Punkte rot während des AF-Vorgangs, nun muß man ahnen/wissen, wo die Punkte liegen, denn die Punkte leuchten nur noch bei "AF-confirm" auf. Auch eine Sache, die denen eben nicht gelungen ist.

Ein Grund, warum sie auf den Sinn der Register gekommen sind, ist uA der DigitalGain bei lichtstarken Linsen >f/2.8.

In Anbetracht dieser kleinen Dinge ist es witzig, darauf zu beharren, die Canon-Nerds hätten alles richtig gemacht :)

Antwort von Bergspetzl:

man könnte jetzt drüber streiten, wer so dem solchen unterliegt :D

Antwort von WoWu:

witziges Wortspiel. Nur hat weder Canon gesagt, dass es ein 1L-Messbecher ist, noch, dass sie immer auf 1L vollmachen.

Sag mal liest Du eigentlich gar nicht was ich schreibe oder verstehst Du es nicht.

1 Photon= 1e- = 1EV=ISO 100

Hat Canon das nicht ?

FullWell ist der maximale Ladezustand einer Photozelle, nach der keine weiter Differenzierung bei zunehmendem Photonenanteil mehr festzustellen ist.

Ist das bei Canon nicht der Fall ?

Oder was, ausser einer grundlosen Vermutung veranlasst Dich, zu glauben, dass Canon auf 50% Übertragungskapazität im Dynamikbereich verzichtet, wenn es FullWell nicht ausnutzt.

Unten haben sie gar keine Wahl, denn das wäre nicht nur strohdumm, den wert nicht so niedrig wie möglich zu legen sondern der wird sowieso vom Rauschen überdeckt und ist daher ein Selbstgänger bei jedem Sensor.

Und nun begründe mal, warum Canon so dämlich sein sollte, wie Du behauptest.

Antwort von chmee:

Ich lese es und verstehe es zum Teil.

* 1 Photon = 1e- auf was bezogen? auf 1µm? Ladungsträger pro Sensel?

* Wozu dann eine REI?

Nachtrag: Wenn es um die Verbesserung der Daten in den Tiefen geht, müssen es keine 50% Ladungserhöhung sein. Und ML spricht von 1/2 bis 2/3 Verbesserung lediglich durch "Optimierung" des DigitalGain.

UND(!)

Ich halte sie nicht für dämlich, sondern für fertig, wenn es funktioniert und vor Allem wenn der Marketingchef schreit, das Produkt soll raus. Ich habe Dir genug Patzer seitens Canon (allein in der 5DIII) vorgelegt, dass ich ihnen den von Dir gepredigten Perfektionismus abspreche.

Aber Hey, bleib bei Deiner Meinung. Du bist in diesem Forum der Weise und ich der schnöde Schwätzer. Darf so bleiben.

Antwort von WoWu:

1 Photon = 1e- auf was bezogen? auf 1µm?

Alles klar, es ist der zweite, von mir genannte Grund.

Ich habe Dir genug Patzer seitens Canon (allein in der 5DIII) vorgelegt

Das war:

* einen fast nutzlosen SD-Card-Slot in die 5DIII gebaut.

* einen rudimentären Auto-ISO-Mode implementiert.

* WLAN und GPS-Funktionalität ähnlich solide umgesetzt.

* der ALL-I Mode bringt in Sachen BQ quasi keinen Fortschritt.

* der HDMI-Out bringt per se nur einen Vorteil, nämlich gleich in einem anderen Format zB ProRes zu speichern. Ansonsten der gleiche Kladderadatsch.

Das sind:Dinge, die "ich" verwundenswert finde -

Alles klar. Du redest über ein Thema so, wie ich über die chemische Zusammensetzung einer Backmischung reden würde.

Lassen wir das, ich habe keine Ahnung von Backmischungen.

Antwort von chmee:

und wieder mal qed mein Bester, in Sachen Dialogführung bist Du ein Stümper. Gar nicht Willens, ein wenig herabzusteigen von Deinem Thron.

Dein Quote ist stümperhaft, ich sprach noch andere Dinge an (dass die 5DIII kein GPS und WLAN hat ist jetzt schon nebensächlich)

Antwort von WoWu:

Da leide ich aber jetzt sehr unter Deiner Beurteilung. aber es lassen sich nunmal nicht alle auf das Niveau der inneren Ereignislosigkeit herabzieht.

Antwort von philbird:

Ist doch wie früher WOWU nicht wahr...

Das Thema wird von dir einseitig aufgekündigt, weil das was ganze Communitys sehen von dir nicht anerkannt wird.

Ich erinnere mich da an den Bitraten Hack bei der GH2, der ja auch schon rein physikalisch keine Verbesserung mit sich bringen konnte.

Da wurdest du dann auch gerne ausfällig.

Es ist auch nach Jahren immernoch sehr schade, dass du dein grosses Wissen nicht in eine Gemeinschaft einbringen kannst ohne ständig Streit zu provozieren.

Die Ergebnisse im ML Forum sind eindeutig, ob das nun sein kann, darf oder whatever...aber das passt halt nicht in deine Welt.

Irgendwann kommt wieder ein Frank daher, der dir einen Fehler bescheinigt und dann bist du wieder weg, bis die Laus auf deiner Leber an Altersschwäche gestorben ist.

Schadeschadeschade, ein Mann mit deinem Wissen, sollte doch einiges erreichen können. Aber ich glaube dir geht es immernoch nur um intelektuelle Masturbation.

Antwort von WoWu:

Ich freue mich, dass Du Dich jetzt besser fühlst.