In unserem allgemeinen Jahresrückblick fand KI nur eine kurze Erwähnung, dennoch hat sich eine Menge getan. Viele Modelle waren im letzten Jahr schnell wieder ein alter Hut, weil sie von neueren, aufregenden Modellen verdrängt worden waren. Große Neuigkeit war vor allem Googles Veo 3, welches erstmals oft gut funktionierende Audio-Tracks zu den KI-Videoclips generieren konnte. Mittlerweile ist auch dies kein Alleinstellungsmerkmal mehr und das Feld der generativen Video KIs gleicht sich gefühlt gerade tendenziell mehr an. Offene Modelle, wie das kürzlich geöffnete LTX-2 können nun mit normalen Gaming-GPUs am heimischen Rechner beachtliche Ergebnisse erzielen. Und auch die Konsistenz von Charakteren und Objekten über die Zeit kann mittlerweile sogar über mehrere Clips hinweg funktionieren.

Doch richtig praktikabel wird das ganze natürlich erst, wenn der Anwender noch mehr direkte Eingriffs- bzw. Korrekturmöglichkeiten erhält. Und genau in dieser Richtung bahnen sich gerade ein paar technische Revolutionen an, welche KI auch im professionellen Umfeld produktiv nutzbar machen werden.

Role Model: Generative KI Audio

Ein interessanter Vorgeschmack findet sich dabei im KI-Audiobereich: Hier stehen unter anderem mit Udio und Suno zwei generative KI-Musik-Generatoren bereit, mit denen sich mittlerweile professionell klingende Songs jeder Musikrichtung per Prompt generieren lassen. Und dennoch gab es bislang eher wenig reale Musiker, welche generative Audio-Generatoren in ihren Musik-Workflow eingebettet haben.

Denn tatsächlich schaffen diese generativen Modelle erst einen wirklichen Mehrwert in der Produktion, wenn man als Produzent noch relevante Eingriffsmöglichkeiten am Endprodukt erhält. Der Stereo-Output-Mix eines Audio Generators ist als fertiger Audio-Track allerdings wenig hilfreich. Nützlicher ist für Musiker und Produzenten dagegen eine Multrack-Timeline, in der man den Song noch in großen Teilen modifizieren kann - also Tracks neu schneiden und mischen, durch Alternativen ersetzen oder Track-Effekte modifizieren.

Stem Separation

Und nun öffnet sich dieser Weg seit geraumer Zeit im Audiobereich. So haben sich sogenannte Stem Separation Tools zu wirklich nutzbaren Werkzeugen für die Musikproduktion entwickelt. Hiermit kann eine gemixte Audiospur nachträglich wieder in einzelne Tracks, in die sogenannten Stems zerlegt werden. So lässt sich beispielsweise Gesang, aber auch die E-Gitarre oder das Schlagzeug aus einem Song extrahieren und nachträglich noch einmal "separat" bearbeiten.

Diese Stem-Separatoren stehen übrigens nicht nur als Webservice unter Suno und Co zur Verfügung, sondern sind auch in vielen DAWs wie Logic Pro oder als Plugin verfügbar. Fakt ist dabei, dass diese mittlerweile auch vermehrt dazu eingesetzt werden, um KI-Songs zu zerlegen - was für ein weiteres "Feintuning" nützlich ist.

Einen besonders aufregend neuen Weg bietet seit kurzem Suno in der Cloud: In Suno Studio sollen traditionelle DAW-Funktionen mit KI-gestützter Musikproduktion vereint werden. Eine Mehrspur-Timeline ermöglicht es, wie in einer klassischen DAW Musik mit voller kreativer Kontrolle zu layern, zu arrangieren und umzugestalten. Mit Suno Studio können die einzelnen Tracks jedoch auch aus KI-Stems stammen. So lassen sich neue Instrumentenspuren wie Basslinien, Percussion oder Melodien durch generative Befehle hinzufügen. Dies kann ein Prompt sein, aber ebenso eine gesummte Melodie, die man dann beispielsweise in ein Saxophon "rendert".

Im folgenden Youtube-Video kann man sich einmal näher ansehen, wie das in der Praxis funktioniert:

KI ist schon in der Musikproduktion angekommen

Jede generierte Instrumentenspur soll in Suno Studio anschließend zu Stil, Tonart und Tempo Ihrer bestehenden Komposition passen. Dies kann die typische Suche in Sample-Bibliotheken ersetzen oder sogar das Engagement von Studiomusikern für benötigte Parts einsparen. Erst kürzlich sprachen wir mit einem an dieser Stelle nicht genannt werden wollenden professionellen Produzenten/Musiker, der für Session-Musiker eine komplett düstere Zukunft prognostiziert. Er selbst nutzt KI-Technologien bereits aktiv, will dies aber nicht offen kommunizieren.

Trotzdem bleibt der Faktor Mensch noch bis auf weiteres im Spiel. Denn einen Song nach den eigenen Ansprüchen verfeinern und finalisieren ist bis auf weiteres noch besser in Menschenhand aufgehoben. Die "Freigabe" wird noch lange eine menschliche Entscheidung sein, sofern man nicht plant, das Netz mit automatisiertem KI-Schund zu fluten.

Das sieht übrigens auch Microsoft-Chef Satya Nadella so. Ihm zufolge liegt die Zukunft der Projektarbeit in der Makrodelegation und der Mikrosteuerung. D.h. man macht bei einem Projekt weniger selbst, sondern splittet die Aufgaben eines Projektes in einzelne KI-Jobs auf. Man steigt also quasi in der Management-Ebene auf und beurteilt nur noch die Ergebnisse seiner KI-Mitarbeiter und fügt diese zusammen. So auch bei einer Audio-Produktion. Wenn ein Teiljob nicht zufriedenstellend ausfällt, promptet man diesen einfach neu. Also "das Gitarrensolo noch etwas rythmischer und das Saxophon etwas weniger dramatisch bitte".

Bald auch für Video?

Was sich hier in der Audioproduktion gerade etabliert, steht dem Videobereich größtenteils noch bevor. Nicht nur in unseren Augen ist die "Take-it-oder leave-it"- Video-Ausgabe aktueller KI-Systeme eine Sackgasse für professionelle Ergebnisse. So genügen ein oder zwei kleine Schnitzer im Video, um den kompletten Output unbrauchbar zu machen.

Hilfreich wäre dagegen manuell noch veränderbarer Output, wie beispielsweise eine Komposition oder eine Timeline, in der man Details noch weiter von Hand ändern kann.

Solange dies nicht der Fall ist, sehen wir auch keine Gefahr von KI für Medienschaffende. Allerdings sehen wir ebenfalls, dass die von uns dargestellten Optionen nicht mehr in allzu ferner Zukunft liegen. Denn im Bildbereich sind bereits entsprechende Entwicklungen auf dem Weg.

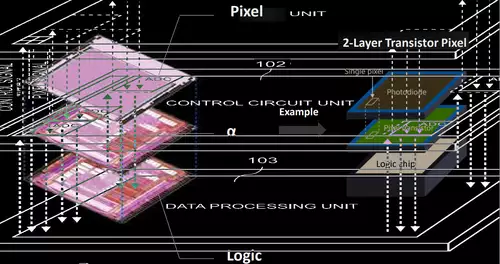

So gibt es für Bilder seit kurzem ebenfalls eine Art Stem Separation, welche ein Bild in einzelne Layer aufsplitten kann. Und bei manchen Modellen können überdeckte Hintergründe sogar bei Bedarf automatisch generativ ergänzt werden. D.h. man kann in einem Bild plötzlich Dinge verschieben oder anders anordnen, ohne zu Masken oder Fill-Tools greifen zu müssen.

Der Schritt zum Bewegtbild scheint technisch zwar eine andere Liga, aber wer KI-Weltmodelle vor Augen hat, darf stark annehmen, dass wir Video-Layer-Separation schon bald erleben werden. Und diese neuen Funktionen werden letztlich auch in die professionelle Videobearbeitung einziehen. Der Medienschaffende wird damit noch mehr zum "ausführenden Produzenten" und lässt seine Videos mit diversen Layern separat von KI-Agenten per Prompt ändern, bis das Ergebnis passt. Und es würde uns schon sehr überraschen, wenn es nicht so kommen wird...