Hollywood arbeitet schon lange daran, Stars künstlich zu verjüngen oder altern zu lassen, um in Filmen die Entwicklung von Figuren über große Zeitspannen darzustellen. Früher wurde dies durch Make-up, Prothesen und Beleuchtungstricks realisiert. Mit dem Aufkommen der digitalen Filmtechnik wurden diese Alterungseffekte mittels computergenerierter Bilder (CGI) umgesetzt. Allerdings ist dieser Prozess extrem aufwendig, denn diese Methode des Faceswappings in der Postproduktion (also des nachträglichen Austauschs samt Alterstransformation) benötigt die Erstellung eines möglichst perfekten 3D-Modells des Gesichts samt Simulation der Haut mitsamt aller Muskeln, Blutgefäße und Barthaare, um echt auszusehen.

Und da dies alles zeitaufwendig in der Postproduktion geschieht, ist das Ergebnis vollkommen entkoppelt von der eigentlichen Performance der Schauspieler, die nicht am Set sehen, wie ihre Figur letztendlich im Alter transformiert wirkt.

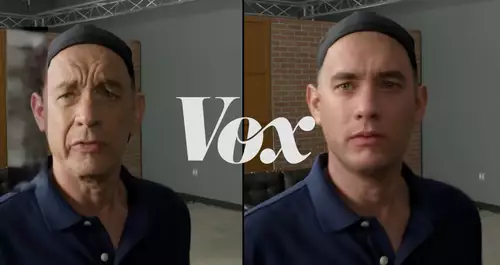

Dank KI jedoch gibt es in der jüngsten Zeit bessere Alternativen zur Nachbildung per 3D. So wird in Here (2024) des bekannten Filmemachers Robert Zemeckis (u.a. Zurück in die Zukunft, Forrest Gump) mit Tom Hanks, Robin Wright, Paul Bettany und Kelly Riley eine Geschichte erzählt, die sich über mehrere Generationen spannt, sodass die Hauptdarsteller sowohl künstlich verjüngt als auch gealtert werden müssen.

Es muss nicht immer 3D sein

Das Team entschloss sich, auf ein neues Verfahren zu setzen, welches auf Machine Learning basiert und das statt einer perfekten 3D-Nachbildung ein neuronales Netzwerk nutzt, um das Alter der Darsteller zu ändern. Statt aufwändiger 3D-Modelle musste das Tool nur mit Bildern der Schauspieler aus ihren verschiedenen Lebensphasen trainiert werden. Die Wahl fiel auf das State-of-the-Art Tool Metaphysic, das in letzter Zeit schon für verschiedene digitale Rekreationen genutzt wurde, wie etwa einen Werbespot mit Dr. Dre, Snoop Dogg und den digitalen Kopien von Frank Sinatra und Sammy Davis Jr.

Der VFX-Supervisor Kevin Baille von Here demonstriert und erklärt im folgenden Clip die neue Methode ( hier mehr dazu):

Metaphysic

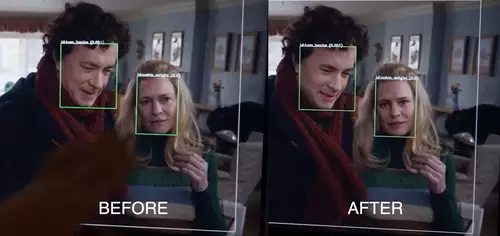

Der Clou an Metaphysic: Die Anwendung erfordert nicht nur sehr viel weniger Aufwand zum Trainieren, sondern die Transformation eines Gesichts in seine verjüngte oder gealterte Version erfolgt per Proxy-Version in Echtzeit, d. h., die Schauspieler können sich nach jedem Take ansehen, wie ihre Performance mit dem neuen Gesicht aussieht und sie entsprechend anpassen, zum Beispiel um Dissonanzen zwischen der Mimik und dem körperlichen Acting zu vermeiden. Ein Vorschaumonitor am Set zeigt die Szene unverändert, ein anderer zeigt eine Version mit transformierten Gesichtern (Live Face Swap) alles live.

// Top-News auf einen Blick:

- Blackmagic Resolve Studio für 236,81 bei Teltec - und weitere Angebote

- Bis zu 1.000 Euro sparen: Cashbacks auf Kameras von Sony, Nikon, Canon und Panasonic

- Ausgewählte Angebote - DJI Mavic 4 Pro, Canon R5 C, Sachtler aktiv12T...

- Die besten Black Friday Deals für Sony und Canon DSLMs und Objektive

- Blackmagic bietet bis zu 30% Rabatt auf seine 6K Kameras

- Große Übersicht - Black Friday Deals 2025 für Foto+Video - Kameras, Objektive, Zubehör usw.

In der Postproduktion wird noch mehr Rechenpower eingesetzt, um dann nicht mehr in Echtzeit die Transformation noch besser und detaillierter durchzuführen. Das neuronale Netz von Metaphysic versucht nicht, das Gesicht physikalisch explizit zu simulieren, sondern es funktioniert ähnlich wie auch unser eigener kognitiver Erkennungsmechanismus einfach durchs Lernen anhand von genügend Beispielen ganz analog zu LLMs.

Warum ist die Simulation von lebensechten Gesichtern so schwer?

Berüchtigt ist bei der Simulation von Gesichtern der Uncanny Valley Effekt, der auftritt, wenn ein künstlich erstelltes Gesicht irgendwie echt aussieht, aber eben nicht völlig. Es wirkt unheimlich, weil wir schon viele echte Gesichter gesehen haben und so unbewusst gelernt haben, wie diese aussehen müssen. Simulierte oder gerenderte Gesichter, die nicht vollkommen die Realität treffen und auch nur feinste Fehler aufweisen, werden von uns unbewusst erkannt und resultieren in dem Gefühl unheimlich, d. h., irgendetwas stimmt nicht, ohne dass wir sagen können, was es exakt ist die Blickrichtung der Augen bei einer Interaktion? Die Mundbewegung in Relation zu den übrigen Gesichtsbewegungen? Die Bewegung der Gesichtsfalten?

Selten sind die Probleme so offensichtlich wie bei Robert De Niros und Al Pacinos verjüngten Figuren in Martin Scorses The Irishman (2019), in dem sich die jungen Figuren irritierenderweise wie die (echten) alten Schauspieler bewegen:

Abschließen hier noch der per Metaphysic produzierte G.I.N. Werbespot mit Dr. Dre, Snoop Dogg und dem digital auferstandenen Frank Sinatra und Sammy Davis Jr. Doch soll immer gemacht werden, was durch neue Technik gemacht werden kann? Dazu auch unser Artikel Ist es ok, tote Schauspieler für die Leinwand auferstehen zu lassen?.