Als erste der aktuellen Video-KIs hat Runway gerade ein Video-to-Video KI-Modell veröffentlicht, mit dem sich der Stil oder der Inhalt eines eigenen Videos über ein Prompt gezielt ändern läßt. Bestechend ist die Möglichkeit, mittels des vorgegebenen Videos genau den Inhalt, die Bildkomposition und die gewünschten Bewegungen von der "Kamera" oder den Objekten zu bestimmen, was bisher nur per Text- oder Bildprompt nicht so exakt möglich war.

Die Option Video-to-Video gab es zwar schon seit der ersten Generation von Runway Anfang 2023, aber erst jetzt ist die Qualität ausreichend gut und auf dem Stand der Zeit.

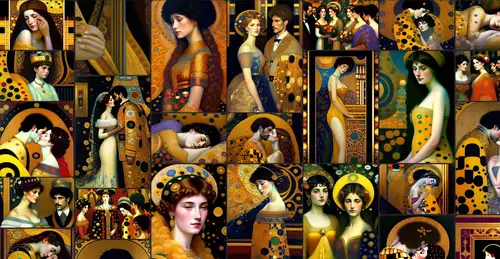

Runway Gen-3 Alpha Video-to-Video ist ab sofort für alle zahlenden Anwender zugänglich. Um es zu nutzen, lädt man einfach sein eigenes Video hoch und beschreibt per Prompt was ästhetisch daran geändert werden soll. Alternativ kann auch einer der vorgegebenen Stile auswählt werden, in welchem das Video dann neu gerendert wird. Laut ersten Berichten von Usern soll die Generierung ziemlich schnell vonstatten gehen. Die Demos von Runway selbst und die ersten Clips in den sozialen Medien sehen schon ziemlich vielversprechend aus und zeigen das enorme Potential des neuen Video-zu-Video Modus.

VFX per KI

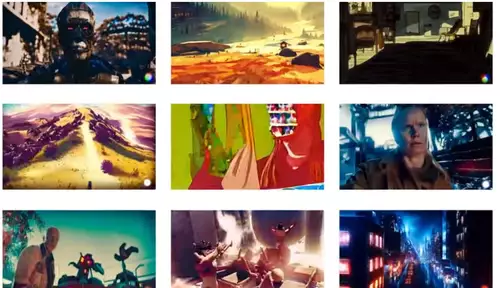

Das neue Modell bietet Filmemachern jetzt eine einfache Möglichkeit, aufwändige VFX in ihren Videos zu nutzen, ohne das sonst dafür nötige Spezialwissen. So kann ganz einfach ein Objekt oder eine Person gegen eine andere ausgetauscht werden, deren Aussehen gezielt verändert werden oder gar das gesamte Setting oder der Stil des Clips geändert werden. So kann eine alltägliche Szene (samt Garderobe, Props und Umgebung) in ein Mittelalter- oder in ein Cyberpunk-Setting transformiert werden.

Ebenso kann auch einfach die Jahreszeit oder die Lichtstimmung gezielt beeinflusst, oder ein Reafilm in einen Animationsfilm in jedem beliebigen Stil transformiert werden. Jeder Darsteller läßt sich mit der Hilfe von Gen-3 auch in einen beliebigen anderen Charakter verwandeln, wobei die Mimik und alle Bewegungen übernommen werden. Vereinfacht wird so auch die sonst komplizierte Synchronisation von Lippenbewegungen virtueller Charaktere mit den gesprochenen Worten.

// Top-News auf einen Blick:

- Sony Alpha 7 V ist da: 33MP Partially Stacked Sensor, 4K 60p ohne Crop und 16 Stops

- ByteDance Vidi2 produziert selbstständig fertige Videos aus Rohmaterial

- Blackmagic DaVinci Resolve 20.3 bringt Support für 32K-Workflows und mehr

- Bis zu 1.000 Euro sparen: Cashbacks auf Kameras von Sony, Nikon, Canon und Panasonic

- Sony und slashCam verlosen eine FX2 Cinema Line Kamera

- DJI Neo 2: Verbesserte Mini-Drohne für Solo-Creator und Einsteiger

(2/6) pic.twitter.com/JepROp3C8D

Runway (@runwayml) September 13, 2024

(4/6) pic.twitter.com/N69IzABWoW

Runway (@runwayml) September 13, 2024

(6/6) pic.twitter.com/gq1Sr4nywF

Runway (@runwayml) September 13, 2024

This could be the biggest breakthrough in AI video right now.

Alex Patrascu (@maxescu) September 14, 2024

Gen-3 Video-to-Video from Runway gets you to control AI however you want, add VFX easily, and explore new ideas with video at the speed of thought.

Also, it&s VERY fast: pic.twitter.com/qv8AeCZ05T

Video-2-Video on Gen-3 Alpha is live! pic.twitter.com/eCPpUYXndG

Nicolas Neubert (@iamneubert) September 13, 2024

Video-2-Video on Gen-3 Alpha is live! pic.twitter.com/eCPpUYXndG

Nicolas Neubert (@iamneubert) September 13, 2024

Juristisch werden natürlich auch neue Probleme aufgeworfen werden - wem gehört ein neu gerenderter und stark verfremdeter Clip, der auf einem Video von jemand anders basiert, wie hier zum Beispiel anhand von zwei Szenen aus "300" demonstriert:

THIS. IS. @RUNWAYML ! pic.twitter.com/6xOjA467KR

Justin Hart (@justin_hart) September 14, 2024