Newsmeldung von slashCAM:

KI-Videomodelle werden zunehmend besser, die Qualität ihres Outputs hängt bekanntlich jedoch stark von dem Videomaterial ab, anhand dessen sie lernen, wie Videos auszuseh...

Hier geht es zur Newsmeldung auf den slashCAM Magazin-Seiten:

Hier geht es zur Newsmeldung auf den slashCAM Magazin-Seiten:

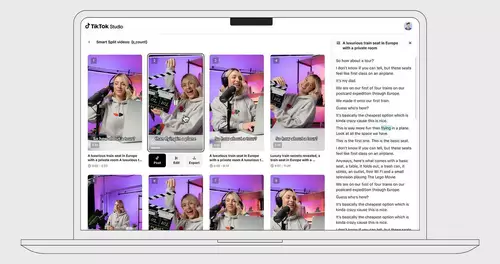

Runway Gen-3 Video-KI wurde an tausenden, ausgesuchten YouTube-Videos trainiert

Antwort von Blackbox:

"eine Voraussetzung dafür ist ja auch, dass es "versteht", was jeweils errechnet werden soll."

Ob es da wirklich ein 'Verstehen' gibt wage ich zu bezweifeln.

Es ist wohl eher ein 'Zuordnen' in ein jeweiliges Schubladensystem?

Das Dilemma des grundlegenden Nicht-Verstehens zeigt sich ja auch bei den Ergebnissen von Ki-Inzucht ohne ausreichenden menschlich kreativen Zustrom:

https://www.scinexx.de/news/technik/kue ... n-kollaps/

Antwort von Da_Michl:

@blockbox:

Pauschal kann (muss?) man wohl sagen, das die meisten KI-Anwender weit davon entfernt sind, (auch nur annähernd) zu verstehen, was ML Systeme und LLMs von konventionellen software-Algorithmen unterscheidet.

Ich nehme mich da persönlich auch nicht heraus (Hab zumindest den schritt geschafft, dass ich weiß, dass es fundamentale unterschiede gibt. :-) )

Antwort von iasi:

Demnächst darf Literatur auch nicht mehr zum Schulen von Kindern genutzt werden. :)

Sobald die lieben Kleinen in ihren Aufsätzen seine Formulierung nutzen, die in einem Buch zu finden ist, führt dies zu rechtlichen Problemen. ;)

Antwort von cantsin:

Da_Michl hat geschrieben:

@blockbox:

Pauschal kann (muss?) man wohl sagen, das die meisten KI-Anwender weit davon entfernt sind, (auch nur annähernd) zu verstehen, was ML Systeme und LLMs von konventionellen software-Algorithmen unterscheidet.

Ich nehme mich da persönlich auch nicht heraus (Hab zumindest den schritt geschafft, dass ich weiß, dass es fundamentale unterschiede gibt. :-) )

Ein konventioneller Algorithmus ist eine strukturierte Handlungsanweisung - im Prinzip wie ein Kochrezept -, während LLMs eigentlich nur Wahrscheinlichkeitstabellen bzw. Heuristiken auf der Basis von Trainingsdaten sind.

Der Unterschied ist der, als wenn (a) jemand z.B. einem Pizzabäcker bei der Arbeit zusieht, dessen Arbeitsschritte analysiert und zu verstehen versucht und auf Basis dieser Analyse ein genaues Rezept aufschreibt, (b) jemand hundert Pizzabäcker beobachtet, Gemeinsamkeiten bzw. Wahrscheinlichkeiten/Grundmuster ihres Vorgehens notiert, ohne wirklich zu verstehen, was sie machen, und auf Basis dieser Muster ein ungefähres Rezept mit diversen Variationsmöglichkeiten aufschreibt.

Antwort von Da_Michl:

Danke Cantsin!

Tatsächlich war ich in etwa schon so weit in meinem Verständnis...vielleicht hab ich vorher etwas untertrieben.

Jedenfalls sehr anschaulich erklärt, vielen Dank!

Antwort von Frank Glencairn:

cantsin hat geschrieben:

ohne wirklich zu verstehen, was sie machen ...

.. oder auch nur zu verstehen was eine Pizza überhaupt ist - könnte jetzt auch ne Fußmatte sein.

Antwort von iasi:

cantsin hat geschrieben:

Da_Michl hat geschrieben:

@blockbox:

Pauschal kann (muss?) man wohl sagen, das die meisten KI-Anwender weit davon entfernt sind, (auch nur annähernd) zu verstehen, was ML Systeme und LLMs von konventionellen software-Algorithmen unterscheidet.

Ich nehme mich da persönlich auch nicht heraus (Hab zumindest den schritt geschafft, dass ich weiß, dass es fundamentale unterschiede gibt. :-) )

Ein konventioneller Algorithmus ist eine strukturierte Handlungsanweisung - im Prinzip wie ein Kochrezept -, während LLMs eigentlich nur Wahrscheinlichkeitstabellen bzw. Heuristiken auf der Basis von Trainingsdaten sind.

Der Unterschied ist der, als wenn (a) jemand z.B. einem Pizzabäcker bei der Arbeit zusieht, dessen Arbeitsschritte analysiert und zu verstehen versucht und auf Basis dieser Analyse ein genaues Rezept aufschreibt, (b) jemand hundert Pizzabäcker beobachtet, Gemeinsamkeiten bzw. Wahrscheinlichkeiten/Grundmuster ihres Vorgehens notiert, ohne wirklich zu verstehen, was sie machen, und auf Basis dieser Muster ein ungefähres Rezept mit diversen Variationsmöglichkeiten aufschreibt.

Dein (a) und (b) unterscheiden sich doch nur durch die Anzahl der Pizzabäcker, die du beobachtest.

Mal ist es 1, mal sind es 100.

Die Chance, ein gutes Pizzarezept zu erhalten, ist bei 100 Beobachtungen höher.

Antwort von cantsin:

iasi hat geschrieben:

Dein (a) und (b) unterscheiden sich doch nur durch die Anzahl der Pizzabäcker, die du beobachtest.

Mal ist es 1, mal sind es 100.

Die Chance, ein gutes Pizzarezept zu erhalten, ist bei 100 Beobachtungen höher.

Nein, beim ersten Beispiel ist es eine strukturierte Beobachtung und Analyse, beim zweiten Beispiel ist es nur Abspicken bzw. Rate-Heuristik auf Grund sich wiederholender Handlungsmuster.

Du kannst den Algorithmus - also das strukturiert-analytisch abgeleitete Rezept - auch aus der systematischen Beobachtung und Analyse von 100 Bäckern entwickeln.

Die Heuristik lässt sich automatisieren, die Analyse nicht. Bei der Heuristik kannst Du daher im Handumdrehen einen Pizzaautomaten bauen und dafür Riesen-Datenmengen auswerten, die kein menschlicher Programmierer bewältigen bzw. analysieren kann - aber immer mit dem Risiko, dass der KI-/ML-Pizzabäcker Dir z.B. die Tomatensauce mit Hefe anrührt - genauso, wie Du beim ML-Bildgenerator das Risiko hast, dass Dir Hände mit sechs Fingern generiert werden.

Antwort von iasi:

cantsin hat geschrieben:

iasi hat geschrieben:

Dein (a) und (b) unterscheiden sich doch nur durch die Anzahl der Pizzabäcker, die du beobachtest.

Mal ist es 1, mal sind es 100.

Die Chance, ein gutes Pizzarezept zu erhalten, ist bei 100 Beobachtungen höher.

Nein, beim ersten Beispiel ist es eine strukturierte Beobachtung und Analyse, beim zweiten Beispiel ist es nur Abspicken bzw. Rate-Heuristik auf Grund sich wiederholender Handlungsmuster.

Du konstruierst da einen Unterschied, den es nicht gibt.

Wenn du deinen Pizzabäcker beobachtest, tust du nichts anderes, wie wenn es 100 Beobachtungen sind.

Ein Ereignis oder 100 - eine strukturierte Beobachtung und Analyse ist immer notwendig.

cantsin hat geschrieben:

Du kannst den Algorithmus - also das strukturiert-analytisch abgeleitete Rezept - auch aus der systematischen Beobachtung und Analyse von 100 Bäckern entwickeln.

Die Heuristik lässt sich automatisieren, die Analyse nicht. Bei der Heuristik kannst Du daher im Handumdrehen einen Pizzaautomaten bauen und dafür Riesen-Datenmengen auswerten, die kein menschlicher Programmierer bewältigen bzw. analysieren kann - aber immer mit dem Risiko, dass der KI-/ML-Pizzabäcker Dir z.B. die Tomatensauce mit Hefe anrührt - genauso, wie Du beim ML-Bildgenerator das Risiko hast, dass Dir Hände mit sechs Fingern generiert werden.

Deine Analyse funktioniert bei dir ebenso, wie bei einer KI. Du schätzt die Ergebnismenge ab.

Du kennst das Ziegenproblem?

Die intuitive Lösung ist hier nicht die richtige.

Deine Analyse beruht immer auch auf Daten, die du gesammelt hast und auswertest.

Und nicht immer ist diese Auswertung dann auch richtig.

Zudem:

Wer sagt dir denn, dass dein Pizzabäcker, den du beobachtest, gute Pizzen backt? :)

Antwort von Da_Michl:

Da_Michl hat geschrieben:

...

Pauschal kann (muss?) man wohl sagen, das die meisten KI-Anwender weit davon entfernt sind, (auch nur annähernd) zu verstehen, was ML Systeme und LLMs von konventionellen software-Algorithmen unterscheidet.

...

Q.e.d.?!

😐

Antwort von cantsin:

iasi hat geschrieben:

Deine Analyse funktioniert bei dir ebenso, wie bei einer KI. Du schätzt die Ergebnismenge ab.

Du kennst das Ziegenproblem?

Die intuitive Lösung ist hier nicht die richtige.

Deine Analyse beruht immer auch auf Daten, die du gesammelt hast und auswertest.

Und nicht immer ist diese Auswertung dann auch richtig.

Ich gebe Dir mal ein Zitat von Aleksander Madry, KI-Forscher am MIT, über den Unterschied zwischen Analyse und heuristischer Datenauswertung. Madry nennt letztere "faul" ("lazy"):

"Faul in dem Sinne wie ein gewitzter Student, der nicht wirklich für eine Prüfung lernen will. Stattdessen studiert er einfach alle Prüfungen der vergangenen Jahre und sucht nach Mustern. Anstatt zu versuchen, wirklich zu lernen, versucht er nur, die Prüfung zu bestehen. Und das ist genau die gleiche Art und Weise, in der die heutige KI faul ist."

https://news.mit.edu/2022/promise-pitfa ... dxmit-0111

Aus demselben Grund kann ChatGPT völlig absurde Rechenfehler machen, wenn Du ihm Excel-Sheets zur Berechnung gibst, weil es die Zahlen nicht wirklich berechnet, sondern Dir nur das wahrscheinliche Ergebnis gibt.

Antwort von iasi:

Da_Michl hat geschrieben:

Da_Michl hat geschrieben:

...

Pauschal kann (muss?) man wohl sagen, das die meisten KI-Anwender weit davon entfernt sind, (auch nur annähernd) zu verstehen, was ML Systeme und LLMs von konventionellen software-Algorithmen unterscheidet.

...

Q.e.d.?!

😐

Es sind Wahrscheinlichkeitsmodell, was konventionelle software-Algorithmen nicht sind.

Unser Denken funktioniert ebenso.

Antwort von markusG:

"Frank Glencairn" hat geschrieben:

cantsin hat geschrieben:

ohne wirklich zu verstehen, was sie machen ...

.. oder auch nur zu verstehen was eine Pizza überhaupt ist - könnte jetzt auch ne Fußmatte sein.

Oder eine Frau :D

https://www.youtube.com/watch?v=dKD8uTRs5ZM

Antwort von TheBubble:

iasi hat geschrieben:

Sobald die lieben Kleinen in ihren Aufsätzen seine Formulierung nutzen, die in einem Buch zu finden ist, führt dies zu rechtlichen Problemen. ;)

Zitate mit Quellenangabe sind erlaubt. Wer das "vergisst", hat schon jetzt eine Grenze überschritten, was u.a. immer wieder zum Nichtbestehen von Prüfungen führt, teils auch nachträglicher Aberkennung von Prüfungsleistungen.

Antwort von blip:

Blackbox hat geschrieben:

"eine Voraussetzung dafür ist ja auch, dass es "versteht", was jeweils errechnet werden soll."

Ob es da wirklich ein 'Verstehen' gibt wage ich zu bezweifeln.

Es ist wohl eher ein 'Zuordnen' in ein jeweiliges Schubladensystem?

Das Dilemma des grundlegenden Nicht-Verstehens zeigt sich ja auch bei den Ergebnissen von Ki-Inzucht ohne ausreichenden menschlich kreativen Zustrom:

https://www.scinexx.de/news/technik/kue ... n-kollaps/

Ja genau, da die aktuellen Systeme durch das Training kein echtes Verständnis erlangen (nach unserm Sinne), schreiben wir "verstehen" in Anführungszeichen - es ging hier darum, dass das KI-Modell lernt, Bildinhalte mit deren Bezeichnungen zu verknüpfen, damit über die Prompts entsprechende Bildausgaben erzielt werden.

Wie sich neuronale Netze vom herkömmlichen Programmieransatz unterscheiden, hatten wir in diesem Artikel versucht, einfach zu erklären

https://www.slashcam.de/artikel/Wissen/ ... -Loss.html

Antwort von Frank Glencairn:

Wie das Magazin 404 nun recherchiert hat, wurde die neueste Gen-3 des mit Sora konkurrierenden Videomodells Runway offensichtlich u.a. mit speziell ausgesuchten, hochqualitativen YouTube-Videos trainiert.

Wie Nvidia, Apple, Anthropic, Open AI/Sora und wahrscheinlich alle anderen auch.

YT ist halt nun mal die größte frei und öffentlich verfügbare AI-Trainingsmüllhalde - so what?