Newsmeldung von slashCAM:

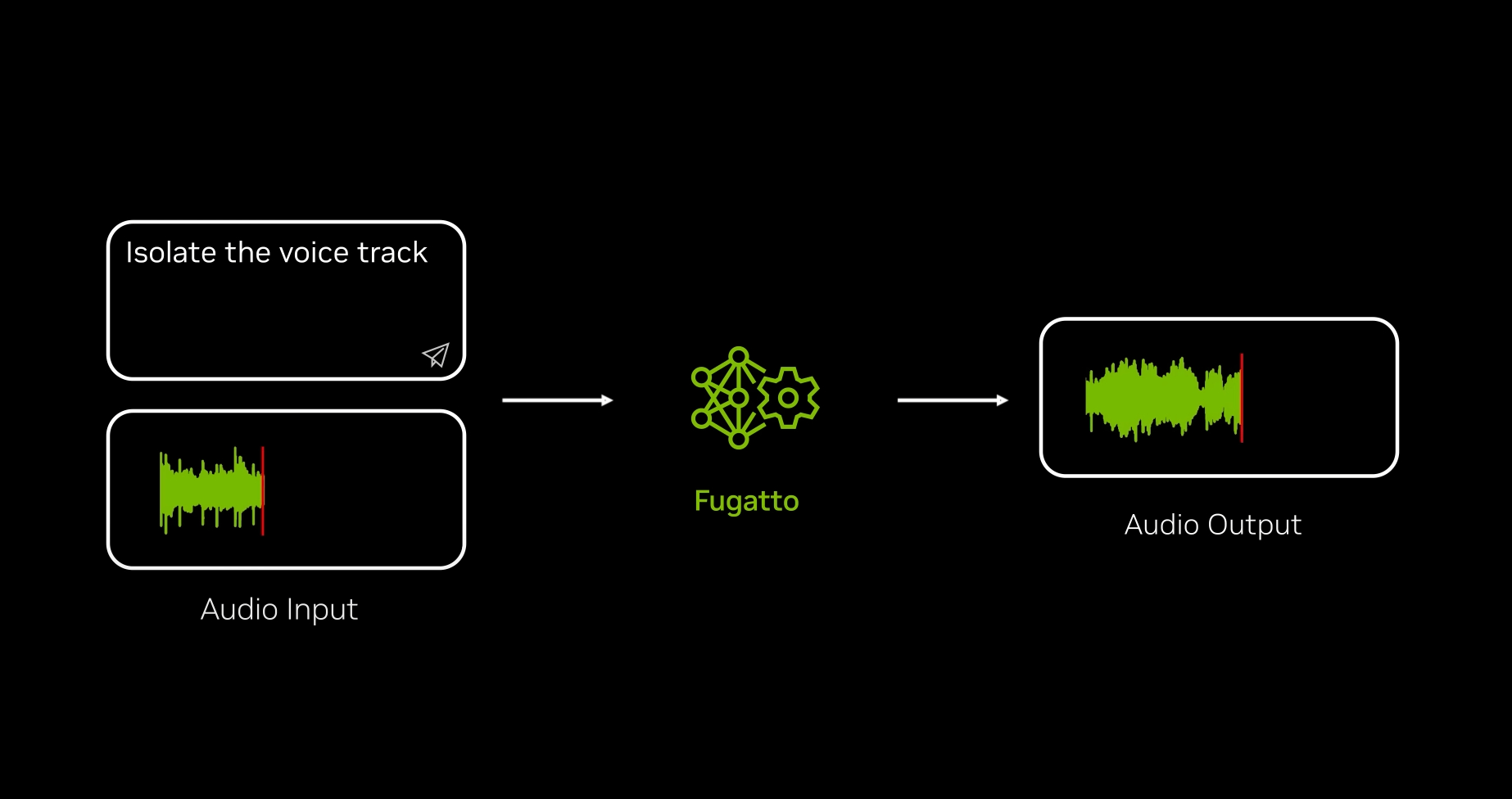

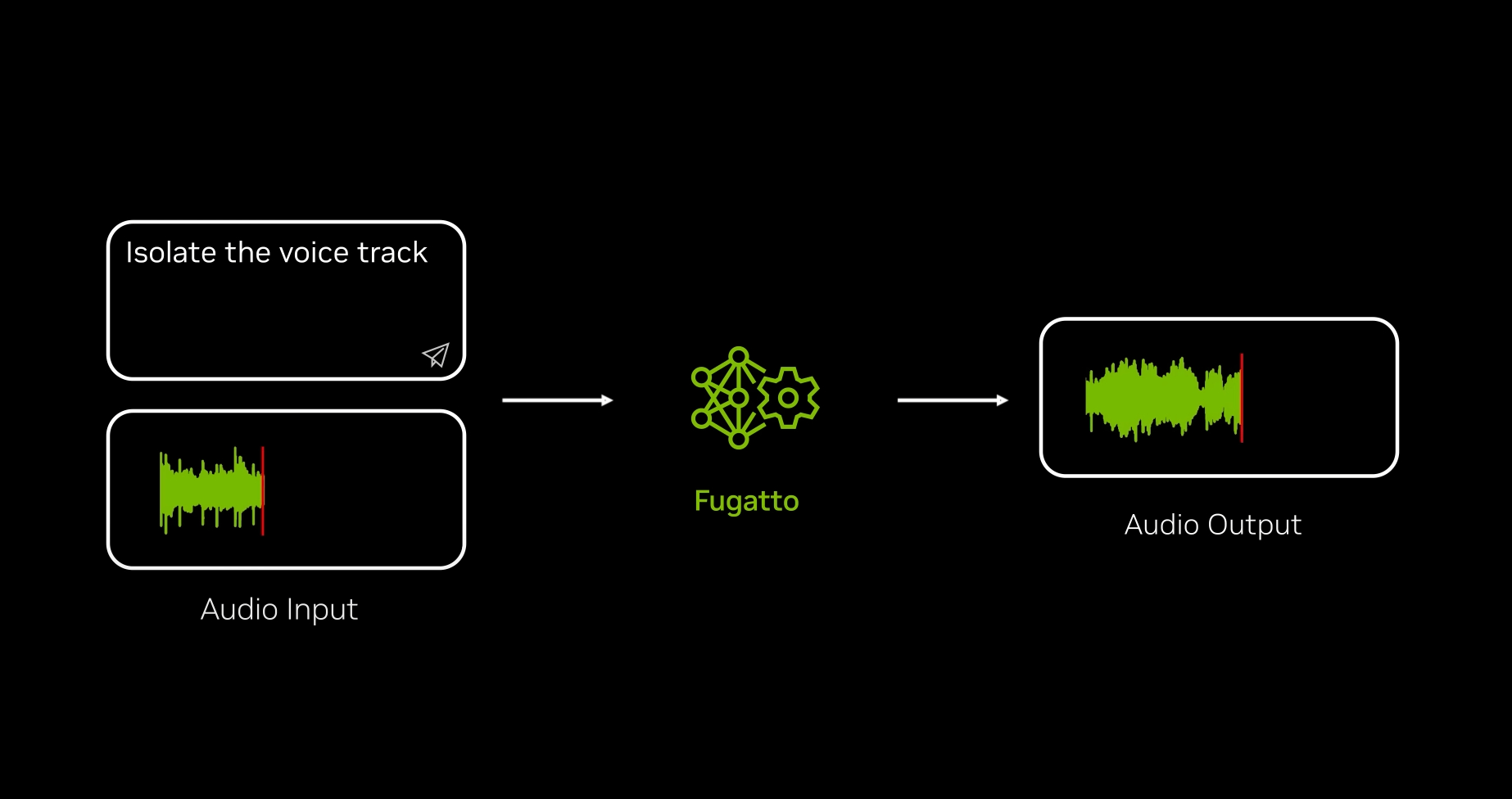

Nvidia hat im Bereich generativer Audio-KI eine Art Schweizer Taschenmesser entwickelt. Es nennt sich "Fugatto" Foundational Generative Audio Transformer Opus 1 und gener...

Hier geht es zur Newsmeldung auf den slashCAM Magazin-Seiten:

Hier geht es zur Newsmeldung auf den slashCAM Magazin-Seiten:

Nvidia zeigt Fugatto - KI-Sounddesigner, Audiotool und Mitmusiker

Antwort von Blackbox:

Eine interessante Entwicklung.

Während 'früher' Geld und kreative Ressourcen, sowie Fähigkeitsentwicklung zwischen Musikern, Tonstudios,Bildungseinrichtungen, Sprecher:innen und Grafiker:innen etc. floss, geht bald die gesamte Kohle an global agierende US-Megakonzerne, die mit ihren 'Ki' incl. ABO-Modell für einen kontinuierlichen Zustrom an Kapital sorgen, um weiterhin in der Lage zu sein die Technologieführerschaft im Absaugen der kreativen Ideen von altmodischen und wohl immer stärker auch mittellosen 'Biomusikern' 'Biosprecher:innen', 'Biografiker:innen' und 'Biofilmschaffenden' auszubauen.

Passt auch perfekt zu Gesellschaftdiagnosen wie etwa dem Reckwitz'schen 'Singularisierungs'-Befund:

statt mehr oder weniger vergnüglicher gemeinsamer Arbeit in kreativen Kollektiven wird der einsame creative-worker am Schreibtisch oder der promtende PR-Agentur Praktikant zum Anwender der creative-tools anonymer Großkonzerne, nicht selten zudem um mit den Ergüssen des ABO-Audiooutputs allerlei Produktnippes zu vermarkten, das oft mindestens so überflüssig ist wie ein Kropf.

Fehlen noch die Kaufroboter, die den ganzen Mist dann mit Prime-ABO bestellen, per Amazondrohne anliefern lassen und für das jeweilige Zeugs - natürlich 'ki'-gesteuert unter Einsatz der von Nvidias Rechenzentern generierten Avatare - zielgruppengerecht von Nvidias Rechenzentren vertonte Influenzervideos erstellen, um sodann nach getaner 'Arbeit' das überflüssige Zeugs zu zertrümmern und per autonomem Transporter zum automatisierten Recyclinhof zu bringen, auf dass aus den Rohstoffen wieder Chips für Konzerne wie Nvidia werden, was für nochmals verbesserten creative-content für den neuen verbesserten überflüssigen Technologienippes sorgt, der dann von Kaufrobotern ...

Wer hätte das gedacht, dass das mit dem perpetuum mobile doch noch Realität werden könnte.

Antwort von Frank Glencairn:

Deja-Vue

Why did the Musicians Union outlaw synthesisers in 1982?

As was so often the case, it was Barry Manilows fault. In 1982, the singer decided to go on tour with a selection of synth players rather than the orchestra hed worked with on his previous outing. When the MU caught wind of the decision, its members began calling for an outright ban of synthesisers to protect the jobs of string players. In May 1982, the union passed the motion, causing outrage among the musical community.

On the same day in 1973, Jefferson Airplane found themselves at the pointy end of the technophobic rage. The band was prevented from playing their scheduled concert in Golden Gate Park in their hometown of San Francisco due to a ban on amplified music. When they arrived, the band found a couple of hundred middle-aged protestors shouting: We built this city on orchestral music, a chant that inspired one of Starships most recognisable hits, We Built This City, released in 1985.

In the 90s, most formally-trained film composers used live orchestras. They would have learned their trade in a conservatoire, cutting their teeth the old fashioned way by writing scores and conducting the orchestra from that score. Think John Williams swirling his baton to the Jurassic Park Theme. In those days, the composers earning the big bucks were largely unfamiliar with the new digital practices coming in. To cover their blind spots, they hired assistants well versed in the ins and outs of virtual instruments and sample packs. Today, those assistants (people like Hanz Zimmer) are the composers earning the big bucks, and while many of them are still classically trained, they often rely on virtual orchestral plugins to make their scores, something which has massively altered the work of classical string, woodwind, brass and percussion musicians.

A few years ago, Spitfire Audio worked closely with the BBC Symphony Orchestra to craft a VST plugin for professional film and TV composers, sampling a huge variety of instruments and articulations to create a highly realistic-sounding orchestra in a box. Far from putting the players out of work, this venture actually provided the BBC Symphony Orchestras musicians with a long term project, and a portion of the profit from every pack sold goes directly to the musicians who feature on it.

The synthesisers of the 1980s became sonic mainstays because of their analogue imperfection, but one wonders if the ubiquity of quantising, highly realistic VSTs, etcetera is leading to a fear of imperfection and a worrying homogeneity in the kind of music were making. Then again, maybe Im just a neo-Luddite.

|

Antwort von ruessel:

Ich bin hier zum ersten mal von der KI Leistung (Ergebnis) wirklich beeindruckt. Klar, der erste Gedanken war, jetzt geht es den "kreativen" ernsthaft an den Hals bzw. an den Geldfluss - das Ende vieler Aufträge.

Trotzdem glaube ich an den kreativen Geist der nur von Menschen für Menschen gemacht werden kann. Der ganze KI Kram kann nur als Tool funktionieren, für die Unterstützung der menschlichen Kreativität. Ansonsten werden alle Horror-SiFi Filme Realität werden, Gesellschaften fallen auseinander, Maschinen übernehmen die Macht...... Trotzdem einen ruhigen ersten Advent! ;-)

Antwort von j.t.jefferson:

ich hab bei einem laufenden Projekt auch schon udio benutzt um Musik zu generieren.

Allerdings ist das dann nur eine ungefähre Ausrichtung für mich gewesen um das ganze dann am Ende einen Komponisten zu schicken, der dann versteht was ich will und dann darauf aufbauen kann. In der Vergangenheit hatte ich eher immer Schwierigkeiten damit einen Anfang zu bekommen und manchmal redete man aneinander vorbei. Ich denke der ganze KI Kram erleichtert eher die Prozesse und spart allen Zeit. Ersetzt wird meiner Meinung nach nur die Zeitverschwendung.