-paleface- hat geschrieben: ↑Do 02 Dez, 2021 15:46

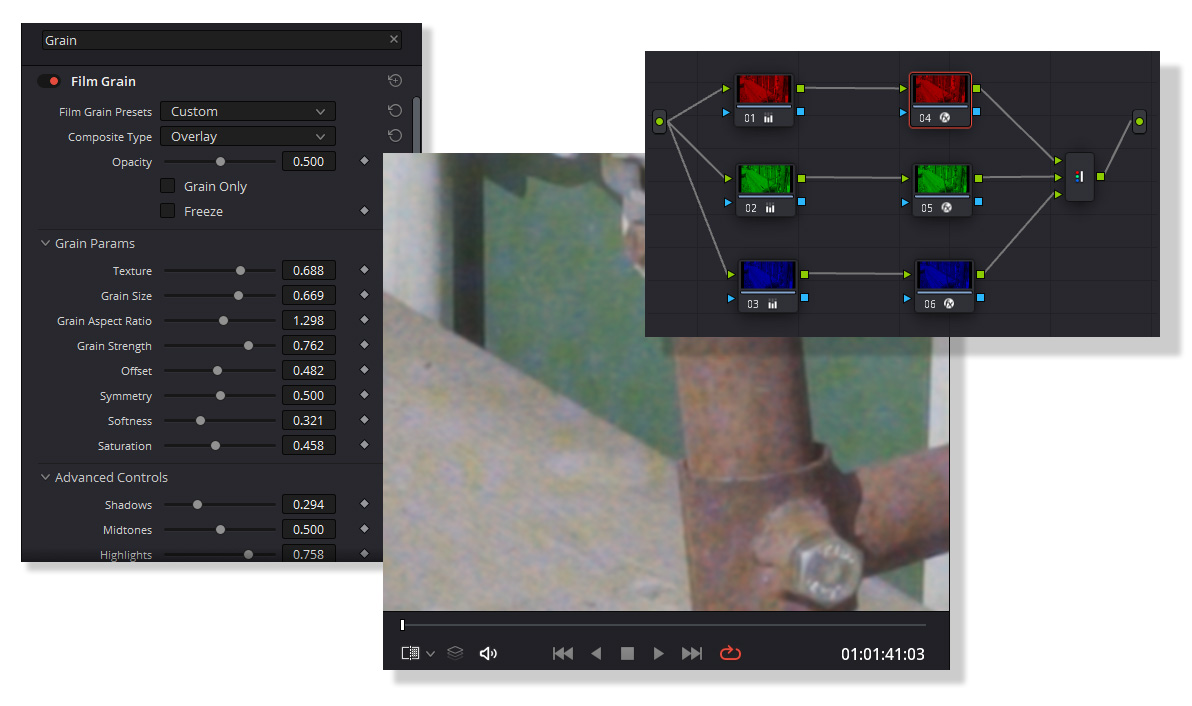

Und so wie ich deren Patent deute gehen die nicht über die RGB Layer sondern rein über die Helligkeiten.

Sprich die splitten sich die Helligkeits Zonen aus dem Material und setzen dann ihre Grain Keys.

Macht ja eigentlich wenn man sich jedes Bild in Luma + Chroma überlegt, auch nur Sinn, beim Luma anzusetzen, oder? Aber interessante Sache, danke für das Teilen vom Patent!

cantsin hat geschrieben: ↑Do 02 Dez, 2021 15:57

Wahrscheinlich wird man das Problem in naher Zukunft via machine learning/KI lösen. Man müsste ja nur ein neuronales Netzwerk mit digitalen Bildern trainieren, die auf Film ausbelichtet und dann gescannt wurden, und zwar sowohl mit dem rein digitalen Ausgangsbild und dem gescannten Resultat.

Würde da nicht sogar der unendliche Fundus aus analogen Bildern alleine reichen? Letztendlich geht es ja nicht darum, am Ende das wahrnehmungsmäßige Resultat "Digitales Bild + simuliertes Grain" zu haben, sondern lediglich die KI das Resultat lernen zu lassen?

Die "Hausmittel" kennt die KI ja, was sie nicht kennt ist das erwünschte Resultat.

Zu sagen, das ist eine Gesicht, das ist menschliche Haut, das sind feine Haardetails macht ja dann nur in einem schon auf Film-basierten Kontext Sinn, es muss nicht zuerst das digitale Resultat erlernt werden?

Ich bin wirklich kein machine learning Experte, gar nicht sogar. Mich interessiert das nur im Hinblick auf dieses Thema. Und da hab ich mich gefragt, ob das wirklich den trainingsmäßigen Ausgang im Digitalen Bild nehmen muss, oder ob das bei entsprechend etablierter Software nicht eigentlich die Differenz errechenbar macht.