In Sachen Bewegtbild wird ja seit einiger Zeit Topaz AI breit beworben. Ich hab es mir vor kurzem tatsächlich gekauft, weil ich ein paar alte DV-Film für den Upload auf youtube aufwerten wollte und kann dazu folgendes sagen:

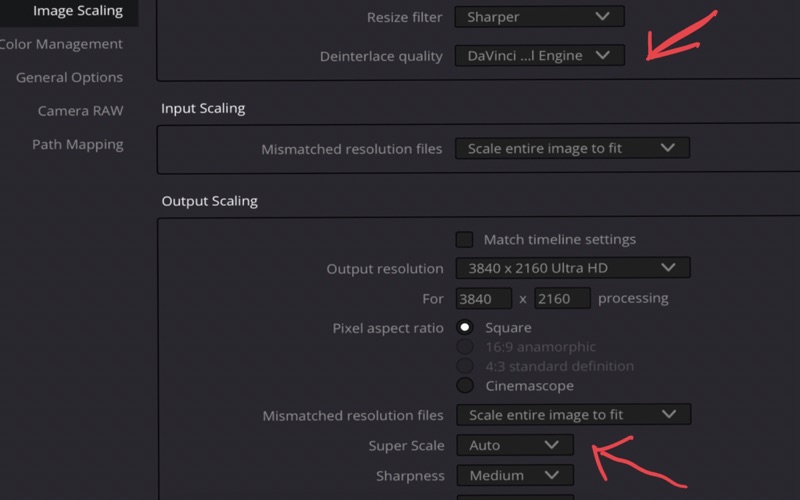

Was das Programm phantastisch kann: Deinterlacing. Der Wandel von 25i in 50p Material ist absolut tadellos, ohne die sonst oft auftretende Treppchenbildung durch Deinterlacing. Auch das Farbsubsampling wird glattgebügelt und die grobklotzigen Farbinformationen (auffällig grade bei rot) sind danach quasi komplett unauffällig.

Was mich sehr überrascht hat: Topaz AI kann die starke elektronische Nachschärfung von altem SD-Material quasi wegrechnen!! DAS ist für mich ein echtes Highlight, da ich bis dato immer dachte, elektronische Schärfe im Bild ist quasi nicht entfernbar im Nachhinein. Es gibt natürlich Szenen, wo es weniger gut funktioniert und zum Beispiel bei weichen Blenden tauchen die Artefakte dann wieder kurz auf, aber grundsätzlich für mich eines der besten features!

Der eigentliche USP der Software, also das Upscaling: Naja. Die "dazu erfundenen Details" sehen für mich einfach nicht gut aus. Bei klaren Linien schafft es die Software gut, diese nachzuzeichnen. Bei chaotischen Details, wie Haaren oder Blattwerk und Zweige, werden, soweit ich das beurteilen kann, weitere Linien parallel dazu erzeugt und die sehen dann aus die Echowellen oder Rasterdruck. Also für eine Verdopplung der Auflösung mag das noch gehen, aber das was beworben wird ist ja "Von SD auf 4K (oder 8K)" und das ist Quatsch, bzw. sieht einfach nur sch*** aus.

Ich denke mal, wenn in ein paar Jahren die KI versteht, was menschliche Haut ist und was Blattwerk, Haare, Asphalt, etc. dann kann das richtig geil werden. Zur Zeit steckt es noch sehr in den Kinderschuhen meiner Meinung nach.

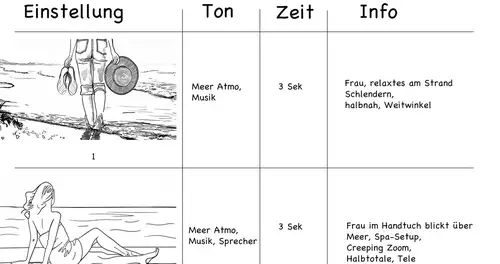

TopazAIComp.jpg

Du hast keine ausreichende Berechtigung, um die Dateianhänge dieses Beitrags anzusehen.