cantsin hat geschrieben: ↑Sa 11 Mai, 2024 01:05

iasi hat geschrieben: ↑Sa 11 Mai, 2024 00:29

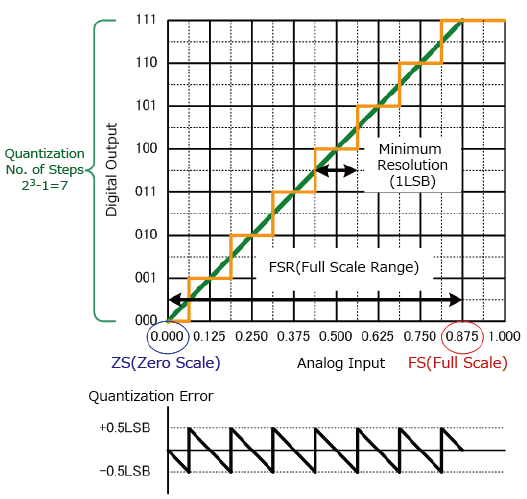

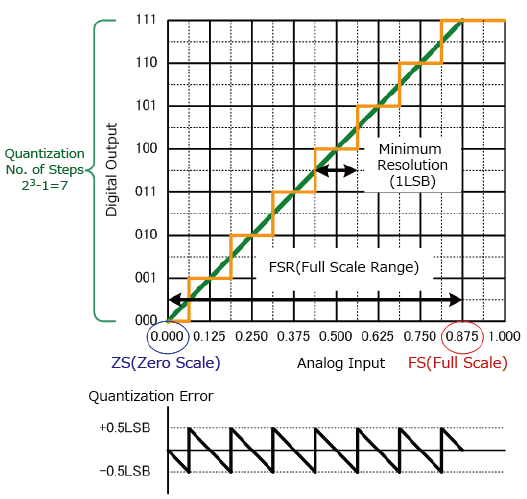

Ein AD-Wandler wandelt (wie der Name schon sagt) ein analoges Eingangssignal, das von 0 bis zum Maximalwert (DR) reichen kann, in digitale Werte um.

Die Abstufungen sind dabei dann umso größer, je mehr Einsen und Nullen zur Verfügung stehen.

Nein, Du verstehst einfach die Grundlagen nicht und verwechselt rohe Sensordaten mit Sensordaten, auf die eine Gamma-Kurve gelegt wurde. Nur in letzterem Fall, und nach Debayering, kriegst Du durch mehr Bittiefe auch mehr Abstufungen.

Du bist es eher, der die Grundlagen nicht versteht.

Denn du vermischt hier so ziemlich alles und verlierst den Überblick.

DR ist der Bereich, in dem der Sensor einfallendes Licht in nutzbares analoges Signal umwandeln kann.

Ab einer bestimmten Lichtmenge liefert er nur noch einen Maximalwert.

cantsin hat geschrieben: ↑Sa 11 Mai, 2024 01:05

Der AD-Wandler wandelt die einfallenden Signale aber linear in Bits um. Und da korrespondiert eine Blende DR genau mit einem Bit. Wenn Du 14bit lineares Raw aufnimmst, der Sensor aber nur 12 Blenden DR liefert, hast Du einfach zwei leere Bits bzw. zwei Bits mit nichts als Rauschen.

Und das ist dein Denkfehler: DR und Bit korrespondieren nicht.

Wenn ich 12 Blenden DR aufnehme, habe ich bei 14bit eine feinere Abstufung je Blendestufe als bei 12bit.

Da gibt es keine leeren Bits.

00001111 oder 00000001 oder 11101110 sind nur Werte und keine Inhalte. Rauschen ist dann ein verfälschter Wert, hat aber nichts mit der Anzahl der Bits zu tun.

Hier könnte man auch statt 3bit 8bit oder 14bit nehmen und würde dieselbe Abdeckung des analogen Signals erhalten - aber in feinerer Auflösung.

cantsin hat geschrieben: ↑Sa 11 Mai, 2024 01:05

Daher findest Du 14bit- und 16bit AD-Wandler auch nur in Kameras mit Sensoren (i.d.R. Full Frame oder Mittelformat), die diesen Dynamikumfang überhaupt abbilden können.

Bei kleineren Sensoren (den meisten APS-C-Sensoren, allen Four Thirds- und 1"-Bayer-Sensoren) kommen nur 12bit AD-Wandler zum Einsatz, weil mehr Bits nichts bringen. Und Smartphones haben sogar nur 10bit AD-Wandler und zeichnen 10bit-Raw auf, aus demselben Grund.

RAW 14 Bit ist auch bei APS-C Standard.

cantsin hat geschrieben: ↑Sa 11 Mai, 2024 01:05

- Was die gängigen Video-Rawformate durchaus machen, ist, Rohdaten aus 16bit- oder 14bit-Wandlern platzsparend in 12bit zu packen, indem die linearen Raw-Werte mit einer logarithmischen Gamma-Kurve auf die 12bit verteilt bzw. komprimiert werden. Der umgekehrte Weg, z.B. Signale aus einem 12bit AD-Wandler als 14bit Raw zu speichern, ist technischer Unsinn und wird AFAIK auch von keiner Kamera gemacht.

Ja - da macht man dann aus den 16.384 Werten bei 14bit handlichere 4096 bei 12bit.

Hier sind wir dann aber auch schon in der Datenverarbeitung.

Wenn du dir das Bild oben ansiehst, kannst du erkennen, dass zwischen 0,5625 und 0,6875 keine Unterscheidung gemacht wird und sich 101 ergibt.

Bei 8bit würden Helligkeitsunterschiede zu einem Wert umgewandelt, während derselbe Helligkeitsunterschied bei 14bit in 16 Werten abgestuft würde. In den Schatten sind die Signalunterschiede geringer, daher profitieren sie besonders von von mehr bit.

Und natürlich kann man dann aus einem 8bit-Wert nicht wieder diese 16 abgestufte 14bit-Werte zurückholen.