Newsmeldung von slashCAM:

In diesem kurzen Interviewclip nimmt Geoff Boyle Stellung zum Schlagwort "Auflösung" von digitalen Cine-Kameras und weist darauf hin, dass sich die reale Auflösung beträc...

Hier geht es zur Newsmeldung auf den slashCAM Magazin-Seiten:

Hier geht es zur Newsmeldung auf den slashCAM Magazin-Seiten:

Kommt es auf Auflösung an? - Interview mit Geoff Boyle

Antwort von TonBild:

slashCAM hat geschrieben:

In diesem kurzen Interviewclip nimmt Geoff Boyle Stellung zum Schlagwort "Auflösung" von digitalen Cine-Kameras und weist darauf hin, dass sich die reale Auflösung beträc...

Hier geht es zur Newsmeldung auf den slashCAM Magazin-Seiten:

Kommt es auf Auflösung an? - Interview mit Geoff Boyle

"Wir empfehlen in diesem Zusammenhang, sich einmal bei der nächsten großen Videomesse hochauflösendes Bewegtbild auf Spezialmonitoren mit Auflösungen oberhalb von 4K anzuschauen und dann zu überlegen, ob dies einen Bildeindruck hinterlässt, den man als cinematisch wahrnimmt."

https://youtu.be/SVCD1ZnYFjk

Beim obigen Messestand hat der Hersteller auch Lupen zur Betrachtung des hochauflösenden Bildes angeboten damit man mit diesen den Unterschied besser feststellen kann.

Mein letztes Anschauen eines 8 K Monitors auf einer Messe hat bei normalem Betrachtungsabstand keinen besonderen Bildeindruck hinterlassen. Mir ist eigentlich kein großer Unterschied zu normalen Monitoren aufgefallen. Erst als ich ca. 20 cm vor dem Monitor stand konnte ich darauf den Text eines abgefilmten Buches fast so klar lesen als ob ich direkt das Buch lesen würde. Das war schon beeindruckend.

Aber cinematisch?

Im Kino sitze ich doch nicht 20 cm vor der Leinwand und benutze auch kein Fernglas oder eine Lupe wie im obigen Video angesprochen. Ist im Kinosaal überhaut eine 8k Auflösung für das menschliche Auge wahrnehmbar?

Ein 8k Monitor wäre sinnvoll um damit bei im öffentlichen Raum aufgestellten Werbedisplays auch noch das Kleingedruckte lesen zu können. Zumindest wenn man nah genug am Monitor ist.

;-)

Antwort von cantsin:

Das Interview mit Boyle sollte man mal transkribieren und immer wieder aus dem Hut holen, wenn in Foren wieder die 4K-Debatte losbricht.

Antwort von Jott:

Natürlich ist 4K/8K nicht "cineastisch". Dass 2K dafür völlig reicht, sieht man ja im Kino, echte 4K-Projektionen gibt es dort so gut wie nie.

Das japanische 8K-TV zielt auf das Gegenteil, nämlich zum Greifen nahe Reality (Live-Übertragungen, Sport, Hochglanz-Doku ...). Auch das sollte man bei zukünftigen Diskussionen im Kopf behalten! :-)

Antwort von dienstag_01:

Das japanische 8K-TV zielt auf das Gegenteil, nämlich zum Greifen nahe Reality (Live-Übertragungen, Sport, Hochglanz-Doku ...). Auch das sollte man bei zukünftigen Diskussionen im Kopf behalten! :-)

irgendwie scheint zwischen der japanischen Mediaindustrie und der deutschen Autoindustrie die eine oder andere Parallele zu bestehen ;)

Antwort von Jott:

Der Boyle tut hier so, als sei diese Bayer-Erkenntnis neu. Ist sie ja nicht, dieser über den Daumen gepeilte Verlustfaktor von 0,7 (den er auch erwähnt) ist ja klar und gilt schon immer und für jeden Hersteller. Aber zählt Auflösung wirklich nicht? Dieser Faktor gilt ja für alle Einzelsensorauflösungen, also haben 4K, 6K und 8K trotzdem immer einen Vorteil gegenüber den niedrigeren Ks. Kommt halt drauf an, welchen Nutzen man daraus zieht. Für VFX sind hohe Basisauflösungen sicher nicht von Nachteil.

Wie auch immer: Boyle ist (war?) der liebste Intimfeind von Jim Jannard/RED:

http://www.hollywoodreporter.com/behind ... eud-609701

Antwort von Starshine Pictures:

Dass Netflix 4K Kameras vorschreibt liegt wohl daran dass sie ihr 4K Angebot explizit monetarisieren. Wer Netflix in 4K sehen will bezahlt mehr. Da muss man natürlich auch gewährleisten dass die Auflösung und der dadurch entstehende Mehrwert auch beim Zuschauer ankommt.

https://backlothelp.netflix.com/hc/en-u ... ments-v2-1

Hier mal deren Kameraliste die den Ansprüchen gerecht werden:

zum Bild

Ich habe das Boyle Interview auch schon vor einigen Tagen gesehen und dachte die hätten unseren WoWu befragt. Ich denke jedoch dass Auflösung und Detailschärfe bald ebenfalls zu einem filmischen Stilmittel werden wie Grading, Aspect Ratio oder Kamerafahrten. Ein Micheal Bay kann seine hochauflösenden Transformers durch das 8k Universum jagen während ein Damien Chazelle (La La Land) in verträumtem analogen 2k die Mädels in den tollsten Farben tanzen lässt.

Grüsse, Stephan von Starshine Pictures

Antwort von domain:

Gibt ja offenbar zwei Fraktionen.

Die einen (wie Tiefflieger früher) streben die absolut realistische Abbildung der Wirklichkeit an.

Die anderen, mehr cineastisch orientierten, geben Tipps wie man die Schärfe herunterdrehen kann, welche Diffuserfilter man verwenden sollte und welche alten weichzeichnenden Objektive das von Haus aus liefern.

Da wird es nie zu einem Konsens kommen.

Aber das ist eben der Unterschied zwischen Künstlern und Realisten.

Bei Spielfilmen ist die Realität nie wirklich wichtig, sondern ihre Ableitung in je nach Bedarf verfremdeten Bildern. Die Realität will man gar nicht sehen.

Antwort von Jott:

Stimmt. Aber wieso zwei Fraktionen? Die vielleicht dritte - scheuklappenfreie - weiß, wann was sinnvoll zu nutzen ist, tut das auch und schüttelt bei verbissenen und rechthaberischen Grabenkämpfen nur den Kopf. Oder amüsiert sich prächtig.

Antwort von Peppermintpost:

also ich finde Boyle's aussagen zum Thema nicht besonders hilfreich. Das Bayer Pattern auf dem er herumreitet ist ja kein Argument pro/contra hohe Auflösung und das Argument "Cineastischer Look" das verstehen zwar ein paar Leute, die Masse versteht es aber nicht und hält schärfer grundsätzlich für besser.

Ich finde das Argument von TonBild (gleich der erste Beitrag) sehr viel besser, man sieht bei einem normalen Betrachtungsabstand einfach keinen Unterschied. Das ist in unendlichen Tests auch schon längst bewiesen worden das er damit recht hat. Selbst Red hat das gestestet und ist ebenfalls zu genau der Feststellung gelangt.

Jetzt kommt das Argument der Post/VFX. Machen höhere Auflösungen in der Post Sinn? Da KANN es bedingt Sinn machen, muss es aber nicht. Das Material was ich so bekomme ist zu 60-70% Alexa Footage und zu 20-30% Red Footage, und nur ein sehr kleiner Prozentsatz alles andere, von der Blackmagic über GH4 oder 5D. Meine Erfahrung ist das Alexa Footage in der Post 1A ohne irgendwelche Probleme funktioniert. Dennoch ist mir Red Footage in manchen seltenen Fällen etwas lieber, weil ich finde das die viel besungene ausgezeichnete Farbwiedergabe der Alexa zwar tatsächlich ausgezeichnet ist, die Red ist aber absolut nicht schlechter. Also an Bildqualität vergebe ich da nichts nur weil ich eine höhere Auflösung bekomme, aber bei super feinem fussel Zeugs wie Haaren kann ich einfach bei ner Red schlampiger arbeiten, weil ich es am Ende halt runter skaliere zu HD und dann ist wieder alles gut. Ich erkaufe mir also weniger Arbeitszeit durch längere Rechenzeit. Für mich ist das eine Rechnung die aufgeht weil ich sowieso viel mehr Renderpower habe als ich brauche. Hab ich keine Friemel scheisse, dann ist mein erster schritt sowieso immer das Material erstmal auf die Grösse zu skalieren die ich auch brauche. Ich poste nix in 4k oder 8k was nicht zwingend sein muss oder vom Kunden so verlangt wird.

Das ist aber noch alles recht schwammig, was bedeutet das wirklich? ich habe in 2017 noch nicht einen einzigen Shot in mehr als 2k gepostet, ich hab in 2016 ganze 4 shots in über 2k gespostet, 3 shots davon aus einem Film. 2015 war ein echtes High Res Jahr, da hab ich ca 20 Shots in 4k bearbeitet (von mehreren hundert). Ich finde das spricht eine klare Sprache. Hätte ich die Shots von einer Alexa bekommen würden die ergebnisse genau so aussehen und der Mehraufwand wäre kompl. vernachlässigbar. Also wenn ich die wahl habe nehme ich gerne Red Footage, ich stehe auf Red genau so wie auf Arri, aber der objektive Vorteil ist dann doch eher in meinem Kopf als wirklich messbar vorhanden.

Aber ein wirkliches Argument contra High-Res, und darauf weist WoWu ja auch schon seit Jahren hin, das wird nur grundsätzlich ignoriert, das Objektiv muss die Auflösung halt auch hergeben. Also wer nicht mit Arri Master- oder Ultra Primes dreht, der sollte sowieso einfach die Klappe halten weil die 8k aus dem Objektiv schon nicht raus kommen. Da kann man dann auch einen 100k Sensor dahinter klemmen.

Antwort von nic:

Peppermintpost hat geschrieben:

also ich finde Boyle's aussagen zum Thema nicht besonders hilfreich. Das Bayer Pattern auf dem er herumreitet ist ja kein Argument pro/contra hohe Auflösung und das Argument "Cineastischer Look" das verstehen zwar ein paar Leute, die Masse versteht es aber nicht und hält schärfer grundsätzlich für besser.

Ich finde das Argument von TonBild (gleich der erste Beitrag) sehr viel besser, man sieht bei einem normalen Betrachtungsabstand einfach keinen Unterschied. Das ist in unendlichen Tests auch schon längst bewiesen worden das er damit recht hat. Selbst Red hat das gestestet und ist ebenfalls zu genau der Feststellung gelangt.

Aber ein wirkliches Argument contra High-Res, und darauf weist WoWu ja auch schon seit Jahren hin, das wird nur grundsätzlich ignoriert, das Objektiv muss die Auflösung halt auch hergeben. Also wer nicht mit Arri Master- oder Ultra Primes dreht, der sollte sowieso einfach die Klappe halten weil die 8k aus dem Objektiv schon nicht raus kommen. Da kann man dann auch einen 100k Sensor dahinter klemmen.

Das "Argument" mit dem Bayer Pattern ist doch gerade das Argument für hohe Auflösungen bei der Bildaufnahme. Wenn man langfristig echtes 4K anstrebt, sich gleichzeitig aber noch Reserven für die Bildbearbeitung in der Post bewahren will, landet man eben schnell nahe der 8K Bayer-Sensoren. Und wenn mir das Bild doch zu "scharf" ist, dann kann ich filtern, in der Post blurren oder Vintage-Objektive nutzen... Auflösung reduzieren natürlich immer, nur wenn ich sie brauche, habe ich sie mit der entsprechenden Kamera eben zur Verfügung.

Und an der Auflösung scheitert es bei den wenigsten "günstigen" Objektiven, ein, zwei Blenden gekniffen lösen fast alle modernen Optiken ziemlich hoch auf. Was du dir durch gute Objektive ersparst sind viel eher CAs, Verzeichnungen, Atmen...

Antwort von iasi:

domain hat geschrieben:

Gibt ja offenbar zwei Fraktionen.

Die einen (wie Tiefflieger früher) streben die absolut realistische Abbildung der Wirklichkeit an.

Die anderen, mehr cineastisch orientierten, geben Tipps wie man die Schärfe herunterdrehen kann, welche Diffuserfilter man verwenden sollte und welche alten weichzeichnenden Objektive das von Haus aus liefern.

Da wird es nie zu einem Konsens kommen.

Aber das ist eben der Unterschied zwischen Künstlern und Realisten.

Bei Spielfilmen ist die Realität nie wirklich wichtig, sondern ihre Ableitung in je nach Bedarf verfremdeten Bildern. Die Realität will man gar nicht sehen.

Der digitalen Entwicklung sei Dank: Man kann nun die Wirklichkeit absolut realistisch abbilden und in der Postpro das Bild so kreativ gestalten, wie man nur will. Die Gestaltungsmöglichkeiten sind für den Künstler nun weit größer als noch zu Negativ-Zeiten.

Viele müssen sich erst noch darüber im klaren werden, dass digitales Produzieren sich eben doch sehr von dem mit Negativen unterscheidet. Die Angst vieler Kameraleute dabei: Die Bildgestaltung erfolgt nun weit mehr in der Postpro und eben nicht mehr allein durch den DP am Drehort.

Daher ist auch diese Sichtweise, die das Aufnahme- vom Endformat nicht unterscheidet schlicht überholt.

Heute kann man wirklich jeden Bildbereich in der Post absolut kontrolliert aufhellen oder abdunkeln, wie es am Drehort auch die besten Beleuchter nicht zustande bringen können. Es ist eben nicht "fix it in post" sondern "gestalte in der Post".

Dabei ist Auflösung natürlich nicht alles. 8k in 8bit bringt nichts.

Übrigens gibt"s bei Red gerade auch eine Disussion zum Thema:

http://www.reduser.net/forum/showthread ... Resolution

Antwort von Peppermintpost:

7nic hat geschrieben:

Das "Argument" mit dem Bayer Pattern ist doch gerade das Argument für hohe Auflösungen bei der Bildaufnahme. Wenn man langfristig echtes 4K anstrebt, sich gleichzeitig aber noch Reserven für die Bildbearbeitung in der Post bewahren will, landet man eben schnell nahe der 8K Bayer-Sensoren. Und wenn mir das Bild doch zu "scharf" ist, dann kann ich filtern, in der Post blurren oder Vintage-Objektive nutzen... Auflösung reduzieren natürlich immer, nur wenn ich sie brauche, habe ich sie mit der entsprechenden Kamera eben zur Verfügung.

Und an der Auflösung scheitert es bei den wenigsten "günstigen" Objektiven, ein, zwei Blenden gekniffen lösen fast alle modernen Optiken ziemlich hoch auf. Was du dir durch gute Objektive ersparst sind viel eher CAs, Verzeichnungen, Atmen...

klar, wenn du 4k haben willst dann must du deutlich mehr k bei der aufnahme haben wegen dem bayer pattern, das ist richtig. aber er fängt ja an mit 4k ist nicht 4k wegen dem pattern. da hat er recht. das stimmt bei hd aber genau so.

das ist richtig für jede digital kamera und jede auflösung. deswegen meine ich es ist weder ein pro noch contra argument wenn es um hohe auflösungen geht.

bei dem talk geht es doch darum ob auflösungen über hd sinn machen oder nicht. da geht es für mein verständniss also nicht darum das arri für eine 2k aufnahme 2,8k aufnimmt sondern ob auflösungen von 4k und höher noch sinn machen oder nicht.

die 2,8k von arri fur 2k ist ja nur eine frage des marketings. wir haben uns inzwischen daran gewöhnt das die auflösung in sensor auflösung angegeben wird und nicht in realer bild auflösung, da das aber in direkter korrelation steht finde ich ist es egal und nicht die eigendliche frage. wenn er das fass aufmachen will, was von high res tatsächlich übrig bleibt, dann ist das bayer pattern das geringste der probleme. objektivgüte, kompression etc spielt bei zumehmender sensor auflösung eine deutlich höhere rolle.

Antwort von Peppermintpost:

@Iasi

die sichtweise beruht leider auf unwissenheit. film kann man genau so verbiegen wie digital, haben wir früher so gemacht und wird bei den hollywood blockbustern die auf film gedreht werden auch so gemacht.

Antwort von iasi:

Peppermintpost hat geschrieben:

Aber ein wirkliches Argument contra High-Res, und darauf weist WoWu ja auch schon seit Jahren hin, das wird nur grundsätzlich ignoriert, das Objektiv muss die Auflösung halt auch hergeben. Also wer nicht mit Arri Master- oder Ultra Primes dreht, der sollte sowieso einfach die Klappe halten weil die 8k aus dem Objektiv schon nicht raus kommen. Da kann man dann auch einen 100k Sensor dahinter klemmen.

Die Abbildungsqualität bei ordentlichen Objektiven unterscheidet sich bei optimaler Blende nicht so sehr, wie immer impliziert wird.

Bei Offenblende mögen die Unterschiede zwar vorhanden sind, aber schon bei t2.8 sind sie bedeutungslos.

http://www.reduser.net/forum/showthread ... ot-Results

Zudem stellt sich die Frage: Womit reize ich ein gutes Objektiv eher aus?

Mit 2k oder mit 8k?

Antwort von iasi:

Peppermintpost hat geschrieben:

@Iasi

die sichtweise beruht leider auf unwissenheit. film kann man genau so verbiegen wie digital, haben wir früher so gemacht und wird bei den hollywood blockbustern die auf film gedreht werden auch so gemacht.

Aber das kannst du eben auch nur, wenn du den Weg über das Scannen/Digitalisieren gehst.

Und auch hier versucht man doch höchstmögliche Auflösung für die Post zu erhalten - auch wenn es dann in 2k-Kinos läuft.

Antwort von Peppermintpost:

iasi hat geschrieben:

Peppermintpost hat geschrieben:

@Iasi

die sichtweise beruht leider auf unwissenheit. film kann man genau so verbiegen wie digital, haben wir früher so gemacht und wird bei den hollywood blockbustern die auf film gedreht werden auch so gemacht.

Aber das kannst du eben auch nur, wenn du den Weg über das Scannen/Digitalisieren gehst.

Und auch hier versucht man doch höchstmögliche Auflösung für die Post zu erhalten - auch wenn es dann in 2k-Kinos läuft.

ja, das stimmt

Antwort von WoWu:

cantsin hat geschrieben:

Das Interview mit Boyle sollte man mal transkribieren und immer wieder aus dem Hut holen, wenn in Foren wieder die 4K-Debatte losbricht.

Dabei hat er ja lediglich ein altes Problem aufgegriffen und solche Probleme, dass ganze Bildpassagen aus Patches künstlich generiert werden, nicht mal im Ansatz erwähnt.

Aber es scheint tatasächlich der Paradigmenwechsel , vollzogen zu sein, dass es auf Bilddetais mittlerweile weniger ankommt, als auf Pixelmengen.

Es ist eben leichter, großen, goldenen Zahlen und nachgerechneten Kanten zu glauben, als gute Bilder zu machen.

@Stephan

Wenn's mal Detailschärfe wären .... es sind ja leider keine Details, sondern Patches.

Details würden ja die Wiedergabe eines Originaldetails voraussetzen.

Das gibt es aber z.Tl. gar nicht mehr im Bild.

Antwort von Roland Schulz:

Einige Ansätze finde ich ja ganz ok und und stützenswert, andere scheinen gerade auf dem Mond gelandet zu sein. Wer definiert eigentlich immer was "ich" sehe und vor allem wie ich es sehe?! Wer darf sagen 2K reicht für alles, mehr sieht "man" nicht?! Das galt vielleicht in Zeiten in denen 70cm Standard waren und die ganze Glotze einen kleinen Ausschnitt des Sehwinkels ausfüllte - da hatten wir allerdings kein 2K.

Wer verbietet mir mich 2m vor einen 65" 4K TV zu setzen? Hat schon mal jemand eine "Großbild-Diashow" in 2K sehen "müssen"?!

Michael Martin steht bei mir eigentlich ziemlich hoch im Kurs, ich habe die Präsentationen mehrfach gesehen. Einmal "musste" ich relativ weit vor sitzen. Wisst ihr was das für ein Mist ist wenn man ca. 4m vor einer Riesenleinwand sitzt, welche mit einem 2K Beamer befeuert wird?!

Da kannste dann Pixel zählen! Selbst 4K wäre da noch eine Qual gewesen und nein, ich muss hier auch nicht das ganze Bild auf einmal sehen, ich kann mich auf für mich interessante Ausschnitte konzentrieren!

Leider gibt es, und da muss ich Michael etwas in Schutz nehmen, praktisch keinen "hier angemessen bezahlbaren" 4K Beamer mit einer ähnlichen, notwendig (!!) hohen Helligkeit welche der 2K Panybeamer liefert, und der kostet auch schon ~25k!

Im Kino, sei es 2K oder 4K, habe ich noch nie irgendeinen "Schärfeeindruck" erlebt!! Was soll "cinematisch" und was ist daran (noch) erstrebenswert?? Langsam ist mal gut mit Retro!! Ich kann jede 4- oder 8K Kamera so versauen dass es so aussieht, umgekehrt funktioniert das nicht!

Was soll das immer dass es keine Objektive gäbe die 4K oder 8K auflösen?! Bayerdemosaicing bedingt schaffen wir ohnehin keine echten 4- oder 8K, soweit richtig, aber wer sich mal "vernünftige" Fotos einer EOS 5dsR (8,7K) angesehen und diese mit einer 6K Kamera (z.B. D750) verglichen hat wird feststellen, dass selbst hier noch klare Unterschiede in Details zu erkennen sind (vgl. dpreview studio shot comparison) - da brauche ich auch keine 3x2m für zu drucken (da wären es gerade mal noch ~75dpi Raster*0,7 = ~50dpi effektiv!!).

Man darf das Gesamtpaket aber auch nicht nur an der Auflösung festmachen, DR und SNR etc. sind u.A. auch relevante Qualitätseckpunkte. Grundsätzlich zu behaupten dass alles über 2K Unsinn ist ist aber Quatsch Comedy! Unter bestimmten Gesichtspunkten macht auch 8K ohne Frage Sinn, vor allem im Kino!

Man sollte keine Bilder präsentieren in denen die Kanten flimmern und jede Linie zwei "Nachbarn" hat. Bei dem ganzen weichgespülten Mist kriege "ich" aber Plaque!! Da sollte heute mehr möglich sein wenn man die Technik beherrscht!

Den Reduktionsfaktor von ~0,7 hatten wir zudem immer (Ausnahme 3 Chip), von daher kann ich ohne weiteres 2K mit 4K und 6K sowie 8K vergleichen. Alle Auflösungen werden gleichermaßen reduziert!

Antwort von Frank Glencairn:

Auch deine Augen, dein Gehirn, und dein Bewußtsein funktioniert genauso wie beim Rest hier - mach dich mal locker.

Antwort von BigT:

@Frank: Diese Relativität habe ich ganz drastisch nach meiner Graustar-OP erlebt. Als ich mit den neuen künstlichen Linsen plötzlich wieder die ganze Dynamik und Sättigung des visuellen Spektrums sah, war das ein paar Tage pure Euphorie. Die eigene Wahrnehmung ist wirklich kein zu unterschätzender Faktor.

Ansonsten kann ich nur aus der Sicht des CGI-Artisten reden. Da ist es ja genau umgekehrt. Es ist oft ernüchternd, wenn man zuerst ein Lo-Res Preview auf einem Hi-Res Monitor anschaut. Dank dem Upscaling sieht das jeweils schön diffus und ''cinematisch' aus. Das finale rohe HD- oder 4K-Rendering wirkt mit seiner Schärfe hingegen eher unattraktiv und künstlich.

Aber eben, ich bin auch in den 70ern erstmals ins Kino und voreingenommen in der Frage, was 'cinematisch' wirkt.

Antwort von iasi:

WoWu hat geschrieben:

cantsin hat geschrieben:

Das Interview mit Boyle sollte man mal transkribieren und immer wieder aus dem Hut holen, wenn in Foren wieder die 4K-Debatte losbricht.

Dabei hat er ja lediglich ein altes Problem aufgegriffen und solche Probleme, dass ganze Bildpassagen aus Patches künstlich generiert werden, nicht mal im Ansatz erwähnt.

Aber es scheint tatasächlich der Paradigmenwechsel , vollzogen zu sein, dass es auf Bilddetais mittlerweile weniger ankommt, als auf Pixelmengen.

Es ist eben leichter, großen, goldenen Zahlen und nachgerechneten Kanten zu glauben, als gute Bilder zu machen.

@Stephan

Wenn's mal Detailschärfe wären .... es sind ja leider keine Details, sondern Patches.

Details würden ja die Wiedergabe eines Originaldetails voraussetzen.

Das gibt es aber z.Tl. gar nicht mehr im Bild.

Immer dieselben Theorieauslassungen - das hatten wir doch schon zu HD-Zeiten.

Und ich weiß: Die Details die ich bei einer 4k-Aufnahme zu sehen glaube, die bei 2k eben nicht da sind, bilde ich mir nur ein.

Und auch wenn man mit ein und demselben Objektiv an einer Kamera mehr MTF als bei einer anderen misst, so sind das alles nur IT-Tricks.

16 ordentliche Pixel liefern natürlich ebensoviele Werte ab, wie 64. Und da es 16 sind, wird natürlich nicht gerechnet - auch wenn"s ein Bayer-Sensor ist.

Also ich freue mich darüber, dass durch die gestiegene Hardwareleistung die Rechnungen nun komplexer und auf Basis von mehr Messwerten erfolgen können.

Antwort von WoWu:

Iasi, Du traust Dich ja auch nicht, mal ein 2x2cm großes Objekt in 100m bei 4K zu zeigen, weil Du die Wahrheit nicht verträgst und immer nur von irgendwelchen Fenstern auf fernen Almen schwärmst, die Du vor 10 Jahren noch nicht erkennen konntest.

Pack es doch mal und zeig, wie ein 2x2cm großes Objekt am ende eines Fußballfeldes dargestellt wird, statt immer nur von Pixeln zu labern.

Antwort von Jott:

Und im Gegenzug zeigst du dann mal ein Beispiel für deine berühmten 24, 25 oder noch öfter pro Sekunde errechneten künstlichen Patches/Bildteile.

Antwort von iasi:

WoWu hat geschrieben:

Iasi, Du traust Dich ja auch nicht, mal ein 2x2cm großes Objekt in 100m bei 4K zu zeigen, weil Du die Wahrheit nicht verträgst und immer nur von irgendwelchen Fenstern auf fernen Almen schwärmst, die Du vor 10 Jahren noch nicht erkennen konntest.

Pack es doch mal und zeig, wie ein 2x2cm großes Objekt am ende eines Fußballfeldes dargestellt wird, statt immer nur von Pixeln zu labern.

Du redest ständig von "errechneten" Bildern und Details - als ob das Bild eines 2k-Bayer-Sensors nicht auch errechnet wird und die Wirklichkeit absolut real abbildet.

Ich sehe nun einmal nur noch Klötzchen bei einer 2k-Aufnahme, wo ich bei 4k eben noch Bilddetails erkenne. Da muss ich dann auch nicht ein Objekt irgendwo aufstellen.

Du bist doch der, der ständig auf Zahlen herumreitet. Mir ist es eigentlich nur wichtig, dass ein 4k-Sensor mehr Details liefert als ein 2k-Sensor - auch wenn ich weiß, dass ein 4k-Bayer-Sensor eben nicht wirklich 4k-Auflösung liefert. Und das Bild einer VV 8k ist nun einmal beeindruckend - selbst heruntergerechnet auf 2k.

Bei all den Kameratests habe ich noch nie gesehen, dass die Geräte auch mal in einer Totalen verglichen worden wären.

Bei Skyfall fiel mir jedoch der Unterschied zwischen den Red-Luftaufnahmen und den Alexa Landschafttotalen auf - eben der höhere Detailreichtum der Red.

Antwort von rob:

***von Admin nach Offtopic verschoben***

Antwort von WoWu:

Tja, IASI ... dann besteht doch Übereinkunft, dass 4 K nur in der Pixelauflösung und nicht in den Bilddetails besteht. Dann hat Geoff Boyle doch Recht.

Dann muss jetzt nur noch jemand 16K auf sein Gerät schreiben und alle sehen 16K.

Früher hat man die Bildauflösung noch in Bilddetails angegeben. Die Broadcaster machen das heute noch. .... wie altmodisch.

Sie sollten sich ein Beispiel an den Amateuren nehmen, bei denen ist 4 K schon lange ein alter Hut .... frage ist eben nur, was da drin steckt.

Darin besteht wohl auch heute noch ein Unterschied.

Und auch das Argument der Cropper oder Pan&scanner in der Post, man könne aus 4k mehr Details ziehen ... wenn im Bild nur 2K Bilddetails stecken haben sie bei jedem Crop entsprechend weniger, denn mit der Reduktion der Pixels, reduzieren sich zwangsläufig auch die Bilddetails im Verhältnis.

Aber ... super Idee, wenn man sowieso nur SD braucht, das aber messerscharf gerechnet.

Nee, nee IASI, all die selbsternannten Praktiker hier sollten den Test mal machen.

Sie trauen sich nur nicht ran, weil ihre neue Kamera sie dann desillusioniert.

Geoff Boyle hat schon Recht, auch wenn ich heute entlang seiner Argumentation nicht mehr unbedingt gehen würde, aber wenn er SR berücksichtigen würde, auf alle Fälle.

Antwort von nic:

Immer wieder die gleiche alte "Diskussion". Dabei könnte man doch jetzt hier mal der Frage nachgehen: Profitiert ein gutes Bild von Auflösung und Detailreichtum oder eben nicht. Meine persönliche Meinung ist: definitiv. Wannimmer mit mal eine Einstellung (zufällig) wirklich gelungen ist, dann gewinnt sie auch dadurch, dass sie in voller Auflösung dargestellt wird. Sind manche Dinge schiefgelaufen (Fokus unpräzise, Licht nicht auf den Punkt, usw.), dann wäre ich froh, wenn man das Ganze als SD rausgehen könnte...

Antwort von WoWu:

Die Frage hat er doch in dem Interview schon beantwortet ....

Die Argumentation dahinter ist doch ... wozu eigentlich sogenannte 4K, wenn Bilder auch in 2K gut aussehen .... und da hat er doch völlig Recht.

Die Frage ist doch beantwortet.

Bleiben eben nur die, die argumentieren, man könne in der Post was rausholen ... kann man auch, wenn man mit weniger als 2K auch zufrieden ist.

Und was natürlich auch bleibt, ist die Frage nach der eigentlichen Pixelqualität, ob ich eine optische Umsetzung haben will oder eine künstliche Umsetzung per Patsch.

Antwort von Jan Reiff:

diese Dynamik Diskussion ist dann auch mal langsam ad acta

man vgl mal ne Helium Dynamik mit IPP2 mit der so total überlegenen Alexa ...

Ausgangsmaterial kann nicht Details genug haben.

Weiss nicht was diese Diskussion immer noch soll.

Antwort von WoWu:

Redet doch keiner von Dynamik und dass Ausgangsmaterial möglichst viele Details haben sollte ist doch auch unstrittig, aber Pixels sind nun mal keine Details.

Und IPP2 ist auch nur ein Processing. Du kannst aber nur verarbeiten, was Du aufgenommen hast und wenn das keine Bildinhalte sondern Patches sind, dann sind das eben auch keine 4/6/8 K.

Da nützt auch IPP2 nix.

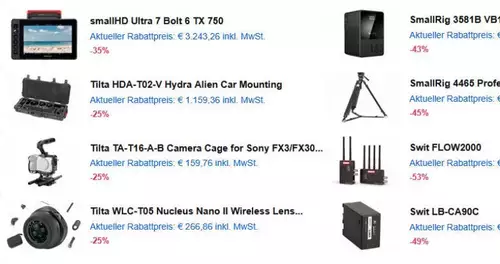

Antwort von Roland Schulz:

...guckt mal hier

10k-4k.PNG

10k-4k_2.PNG

Quelle:

https://www.dpreview.com/reviews/image- ... 8718881343

Wir brauchen nicht diskutieren ob wie im Beispiel zu sehen eine 10k Kamera (PhaseOne IQ180)

MEHR Pixel UND DAMIT DETAILS liefert als eine 8,7k Kamera (Canon EOS 5dsR), diese mehr Auflösung hat als eine 6k Kamera (Nikon D750) bzw. diese mehr zeigt als eine 4,1k Kamera (Panasonic LX100). 2k ist im Fotobereich nicht mehr zeitgemäß und deshalb "leider" im Vergleich nicht zu finden.

Hier werden zudem keine Kanten errechnet oder irgendwas abgeschätzt, so eine tolle Technik die dass wie im gezeigten Beispiel/Ausschnitt/Text kann ist noch nicht erfunden!!

Was wir allerdings im zweiten Screenshot sehen sind die Effekte der Bayer Interpolation, welche wie in den von mir mal eingestellten Charts besonders im blau/rot Bereich Defizite aufweisen.

Welche Auflösung davon in der Praxis sinnvoll bzw. in welchen Abbildungsmaßstäben Vorteile liefert bleibt die zweite Frage. In einer 3x2m Projektion bleiben von der 5dsR wie oben erwähnt ca. 50dpi übrig, "farbig" zum Teil

wesentlich weniger (blau/rot Details...).

50dpi Luma sind zugegeben nicht schlecht, in entsprechenden Projektionen in denen das Auge auch gerne mal in der Szene wandern darf dann aber auch nicht mehr soooo viel, zumal blau/rote Details schon eher Richtung 25dpi laufen werden.

Bei 4K wären das in Luma noch ~25dpi, bei 2K nur noch ~13dpi!!! Damit wir da keine Stufen mehr in den Linien sehen was anstrengend anzusehen wäre wird alles weichgebügelt wie nen Pudel - das ist dann für mich (besonders im Kino) anstrengend und ich stelle mir unberechtigt die Frage, ob ich nicht doch bald die erste Brille brauche ;-)...

BTW: Alle im gezeigten Vergleich verwendeten Objektive lösen für die sich dahinter befindlichen Sensoren "ausreichend" auf. Selbst bei der IQ180 sieht man zumindest in der Mitte im Textbeispiel Ansätze von Aliasing, die anderen Sensoren werden aufgrund "fehlender" Antialiasingfilter gnadenlos "überfahren".

Antwort von WoWu:

Na, dann wird es ja mühelos möglich sein, mal so ein paar Probeframes zu machen und so eine 2x2 cm Kachel wird dann ja leicht in 100m zu erkennen sein.

Da bin ich aber zuversichtlich.

Oder habt Ihr alle keine 4K Kameras ?

Oder ist es so schwer, 100m abzumessen und dann mal auf den Knopf zu drücken.

Es gibt doch hier soviele Praktiker.

Aber das ist entweder zu profan, oder sie wissen genau, dass es nicht klappt.

Also Roland, mach mal und rede nicht.

Antwort von ZacFilm:

Die ganze Debatte geht mir auf den Senkel. Wer gute Filme macht, macht sie auch mit 2x3 Pixeln, und eine dumme Gurke kriegt auch mit ner Arri 6K nichts gescheites hin.

Antwort von WoWu:

Dann hast Du das Interview oben offenbar nicht gehört.

Solche Dinge standen nie in Frage.

Und es ist niemand gezwungen, die Diskussion weiter zu verfolgen.

Antwort von Roland Schulz:

Wolfgang mein Bester! Klar mache ich den Test mal!!

100m abzumessen sind kein Problem, genau so lang werden die schwarzen Streifen beim Porsche immer beim Burnout ;-) ;-) ;-)!!!

...vielleicht am Weekend!

Antwort von Starshine Pictures:

Mit welcher Brennweite soll denn eigentlich dieser 100m/2x2cm Test geschossen werden? (Ernst gemeinte Frage)

Antwort von Alf_300:

100 Meter ist 4 Strassenlaternen weiter oder das andere Ende vom Fußballfeld,

Wer sieht da was ?

Antwort von Jott:

Meter durch Straßenlaternen gleich Brennweite.

Antwort von nic:

Lieber Wolfgang,

ich glaube du verrennst dich da in etwas.

Niemand hier hat behauptet oder glaubt daran, dass eine Kamera mit 4K Bayer-Pattern ein 4K RGB-Bild ausgibt. Insofern ist es auch sinnfrei deinen Test durchzuführen.

Aber was ich und ein paar andere behaupten und glauben - im Bezug auf tatsächliche Detailauflösung: 2K Bayer < 4K Bayer < 6k Bayer < 8K Bayer.

Und die Frage ist doch dann nur: Möchte ich dieses Mehr an Auflösung haben - oder reicht mir Full HD? Und die Frage kann dir auch ein Geoff Boyle nicht beantwortet. Sondern das muss jeder Bildgestalter für sich selbst beantworten. Genau wie die Frage welche Brennweite, welchen Filter und welches Licht er wählt.

Und im Bezug auf deine "Patches": Mir ist keine Kamera bekannt, die künstliche Bildinhalte "content-aware" generieren würde. Natürlich werden beim Demosaicing selbst und einer Rauschunterdrückung oder Kantenaufsteilung Pixel errechnet- aber das ja nur auf Mikroebene und ohne, dass da (intelligente) Inhalte hinzugefügt würden. Und in RAW kannst du diese Prozesse ja meist ganz umgehen. Könntest du da mal etwas konkreter werden? Das klingt mir doch alles zu sehr nach einer Verschwörungstheorie...

Antwort von Roland Schulz:

...die Brennweite bzw. besser der Öffnungswinkel ist doch frei wählbar da nicht definiert ;-) - von daher wird alles gut!!!

Antwort von Roland Schulz:

Jott hat geschrieben:

Meter durch Straßenlaternen gleich Brennweite.

ne ne, Pfund pro Woche!!!

Antwort von ruessel:

Ab 3:00

Antwort von Frank Glencairn:

Alles gut und recht, aber nix davon ist in der Praxis relevant.

Alle Kameras (ab ner gewissen Liga), die man 2017 kaufen kann, machen Bilder, die gut genug für alles sind.

Jedes Licht, jede Flag, jedes Set Design machen einen größeren Unterschied als Auflösung.

Auflösung ist IMHO der unwichtigste Faktor in einem Film.

Wahrscheinlich ist sogar das Catering am Set wichtiger :-)

Die ganze Diskussion - vor allem Auflösung und das was für "Schärfe" gehalten wird - ist sowieso hauptsächlich ne Hobby Diskussion.

Das Kamera Department, dessen Filme für gewöhnlich Oscars gewinnen, sind mit ner Alexa die bestenfalls echte 2K macht, oder sogar mit 2K gescanntem 16mm Film erfolgreich.

Antwort von Roland Schulz:

"Frank Glencairn" hat geschrieben:

Alles gut und recht, aber nix davon ist in der Praxis relevant.

Alle Kameras (ab ner gewissen Liga), die man 2017 kaufen kann, machen Bilder, die gut genug für alles sind.

Jedes Licht, jede Flag, jedes Set Design machen einen größeren Unterschied als Auflösung.

Auflösung ist IMHO der unwichtigste Faktor in einem Film.

Wahrscheinlich ist sogar das Catering am Set wichtiger :-)

Die ganze Diskussion - vor allem Auflösung und das was für "Schärfe" gehalten wird - ist sowieso hauptsächlich ne Hobby Diskussion.

Das Kamera Department, dessen Filme für gewöhnlich Oscars gewinnen, sind mit ner Alexa die bestenfalls echte 2K macht, oder sogar mit 2K gescanntem 16mm Film erfolgreich.

Mag alles zum Teil stimmen, Fortschritt ist das aber nicht! Ich kann ne Super Story im SD TV rüberbringen, keine Frage, gucke ich mir aber z.B. Naturdokus an (oder Planet Erde...) würde ich sowas in SD und miesem HD gleich ausmachen. Bei PE sieht man schon ganz deutlich den Unterschied zwischen den Szenen die in 4K aus ner RED gefallen sind oder die mit irgendwelchen Baumarkt-Canons gedreht wurden.

Nochmal, ich habe noch keinen Kinofilm im Kino gesehen der mich von der Bildqualität annähernd angesprochen hätte. Da die Story auch oft recht mau ist -> kein Erlebnis für das ich vergleichsweise viel Geld ausgeben möchte. Es gibt Ausnahmen, aber zumindest mich könnte man nach 3D durch echtes HDR UND vernünftige Auflösung begeistern. Glaube damit bin ich nicht alleine alleine auf der Welt.

Eine "Diashow" (MM) in nur "echten 2k" ist trotz 4:4:4 für viele Abbildungmaßstäbe/kurze Betrachtungsweiten einfach nur fürs Klo!! Sowas kann ich mir deutlich besser vorstellen, da verlieren auch die besten Bilder ihre Kraft!!

Antwort von mediavideo:

Als ob Geoff Boyle nachfolgende Herleitung gelesen hätte...

Einzig irrt Geoff Boyle bei der Betrachtung, dass es einen festen 0.7-Faktor gäbe mit dem man aus der Sensorauflösung die optische Auflösung errechnen könnte. Der Faktor variiert nämlich je nach Optik, Sensorgröße, Pixelgröße/Pixelmenge und Sensor-/Kameratechnik von maximal ca. 0.85 bei S35-4k über maximal ca. 0.6 bei S35-6k bis vermutlich sogar unter 0.5 bei S35-8k-Sensoren, wie man nachfolgend sieht:

Die physikalisch/technische Herleitung warum mehr Auflösung bei gleicher Sensorgröße/Technologie (z.B. S35) ein Bild mit schlechterer Dynamik und mehr Rauschen ergeben muss:

siehe slashCam-Link:

viewtopic.php?f=3&t=136335&p=904078#p904078

Die Auswirkungen dieser Herleitung in der Kamerapraxis bei der Bildqualität am Beispiel unabhängiger EBU/BBC-Kameramessungen aktueller S35-Modelle von Canon (4k-C300 Mark II) und RED (6k-Dragon):

siehe slashCam-Link:

viewtopic.php?f=3&t=136335&p=904555#p904555

Dazu noch ein weiteres Beispiel aus der Praxis:

Canon war z.B. im September 2015 bei der Vorstellung einer S35-8k-Kamera mit dann nur noch 13 Stops/Blendenstufen (gegenüber 15 Stops bei der 4k C300 Mark II - siehe Berechnung in der obigen Herleitung) auch sehr ehrlich:

Zitat: "Canon Super 35 mm-equivalent CMOS sensor that makes possible high-resolution

8,192 x 4,320 pixel (approximately 35.39 million effective pixels) imaging performance even at a frame rate of 60 frames per second

with 13 stops of dynamic range"

siehe:

http://nofilmschool.com/2015/09/canon-d ... lr-display

Bei ehrlichen Firmen wie z.B. Canon kann man die obige Herleitung auch in den Angaben verifizieren - bei unseriösen Firmen/Marktschreiern eben nicht, da kann schon mal der Sensor von S35-6k auf S35-8k steigen und Blendenumfang und Rauschwerte bleiben im Prospekt gleich.

Dass Kameras physikalischen/technischen Zusammenhängen bzw. Grundlagen unterliegen verstehen vielleicht nach Jahren dann auch mal IASI und Jan Reif ...

Antwort von Frank Glencairn:

"Roland Schulz" hat geschrieben:

Mag alles zum Teil stimmen, Fortschritt ist das aber nicht!

Das ist wie wenn man sagen würde: Die Räder an unseren Autos sind rund, und rollen ganz hervorragend - Fortschritt ist das aber nicht.

"Roland Schulz" hat geschrieben:

Eine "Diashow" (MM) in nur "echten 2k" ist trotz 4:4:4 für viele Abbildungmaßstäbe/kurze Betrachtungsweiten einfach nur fürs Klo!! Sowas kann ich mir deutlich besser vorstellen, da verlieren auch die besten Bilder ihre Kraft!!

Schon ein einziger Pixel motion Blur halbiert die Auflösung - für gewöhnlich haben wir mehr als einen Pixel.

Bei extrem komprimierten Aufnahme- und Delivery-Formaten, wie H264/65, oder sogar Prores (DCT) hats sich die ganze Auflösungsdiskussion sowieso erledigt, wenn da über 80% der Bildinformation aus dem Fenster geworfen werden.

Eine Diashow wäre wahrscheinlich wirklich das beste, für Leute wie dich.

Alternativ einfach die Kanten aufstellen und den Kontrast erhöhen, das sollte den Effekt ergeben, auf den du stehst.

Die ganze Diskussion wird IMHO sowieso auf der falschen Ebene geführt, nämlich auf der technischen, und da nur auf dem Papier (oder bestenfalls auf schwarz/weiß - Standbild - Testcharts).

Sie sollte aber auf der wahrnehmunspsychologischen Ebene geführt werden, weil nur die wirklich zählt.

Deine Augen, dein Gehirn, und dein Bewußtsein sind der ultimative Flaschenhals, wo aus einem Video Clip, Kino wird, oder - ab einer gewissen Informationsdichte (räumlich/zeitlich bzw. Auflösung/FPS) - eben halt nicht.

Was dann über bleibt, ist nichtimmersives EB, ohne daß du in der Lage bist, eine emotionale Bindung mit den Charakteren oder der Story einzugehen - sprich: es funktioniert als Film nicht.

Das ist längst untersucht und bewiesen, und auch keine neue Erkenntnis. Trotzdem besteht - vor allem im Hobby/Semipro Segment - immer noch der Mythos, daß größere Zahlen zwangsläufig zu einem besseren Erlebnis führen.

Antwort von Cinealta 81:

"Frank Glencairn" hat geschrieben:

Alles gut und recht, aber nix davon ist in der Praxis relevant.

Alle Kameras (ab ner gewissen Liga), die man 2017 kaufen kann, machen Bilder, die gut genug für alles sind.

Jedes Licht, jede Flag, jedes Set Design machen einen größeren Unterschied als Auflösung.

Auflösung ist IMHO der unwichtigste Faktor in einem Film.

Wahrscheinlich ist sogar das Catering am Set wichtiger :-)

Full ACK! Aber um Bilder zu machen, die "gut genug für alles sind", müsste man - jenseits von Zäunen, Blümchen und Bäumen - eine Idee, bzw. ein Drehbuch (und genügend Geld) haben. Und dann müsste man sich aufs Filmen konzentrieren. Schlecht für Pixelpeeper und kreativitätsferne, technikfixierte Besserwisser...

Die ganze Diskussion um Auflösung und Schärfe ist am Ende des Tages ein "falscher Hase" - sie wird geführt von selbsterklärten Movern und vermeintlichen Influencern, die Mühe haben, von einigen Affiliate-Dollar zu überleben. Und an ihrer Seite kämpfen noch zahlreiche Theoretiker, Foren- und Spezifikationsexperten - die zwar angeblich alles wissen, aber nichts zustandebringen. Da wollen einfach Hobbyisten und "Enthusiasten" verkünden, dass ihre 1.500 USD teure Möhre kaum von einer ARRI zu unterscheiden ist. Und dabei glauben sie ernsthaft, wenn sie ganz laut schreien und 20.000 Abrufe/YT-Video haben, ihre Meinung wäre relevant. Nein, ist sie nicht - denn dafür interessieren sich wiederum ähnlich mindertalentierte (aber sehr diskussionsfreudige) Spielzeugkamera-Pistoleros.

Ein Filmmacher ist ein Filmemacher, ist ein Filmemcher. Ob mit einer alten & billigen 7D, einer BM Pocket, einer ARRI, oder einer Weapon. Ich fürchte jedoch, nicht einmal der Besitz sämtlicher hier aufgeführten Kameras, würde im gedanklichen und kreativen Umfeld einschlägiger Diskutanten etwas ändern. Weil es weder mit irgendeiner Kamera, noch mit Auflösung oder Schärfe etwas zu tun hat. Sondern damit, dass es 99 Prozent (und da nehme ich mich persönlich nicht aus) nicht oder nicht gut genug können, oder auch nur entfernt erahnen, worum es geht.

Antwort von klusterdegenerierung:

Skywalda is back oder was? ;-))

Antwort von Roland Schulz:

"Roland Schulz" hat geschrieben:

Eine "Diashow" (MM) in nur "echten 2k" ist trotz 4:4:4 für viele Abbildungmaßstäbe/kurze Betrachtungsweiten einfach nur fürs Klo!! Sowas kann ich mir deutlich besser vorstellen, da verlieren auch die besten Bilder ihre Kraft!!

"Frank Glencairn" hat geschrieben:

Schon ein einziger Pixel motion Blur halbiert die Auflösung - für gewöhnlich haben wir mehr als einen Pixel.

Bei extrem komprimierten Aufnahme- und Delivery-Formaten, wie H264/65, oder sogar Prores (DCT) hats sich die ganze Auflösungsdiskussion sowieso erledigt, wenn da über 80% der Bildinformation aus dem Fenster geworfen werden.

Was hat denn die Diashow mit Motion Blur an der Mütze?! Was hat ne statische Motiveinstellung damit zu tun???

Warum "halbiert" Motion Blur die Auflösung, die exakte Herleitung wird "allgemein" unmöglich zu halten sein, es ist einfach falsch.

Die Reduzierung der Auflösung durch Bewegung ist von der Verschlusszeit und der Geschwindigkeit der Bewegung abhängig - das kann von Bruchteilen eines Pixels bis zu mehreren Pixeln führen.

Mach Dich auch von "Mythen" frei wie Verschlusszeit gleich halbe Framegeschwindigkeit ;-), das "kann" man in beide Richtungen variieren, führt trotzdem in keinem Fall allgemein zu einer Halbierung der Auflösung!

Antwort von WoWu:

"Starshine Pictures" hat geschrieben:

Mit welcher Brennweite soll denn eigentlich dieser 100m/2x2cm Test geschossen werden? (Ernst gemeinte Frage)

Die 100m sind die Variable denn die richten sich nach der Sensorgrösse und der Brennweite. Es liegt also zwischen 80 und 120m

Es gilt die Formel für den Bildwinkel, um die Entfernung zu ermitteln:

Bildwinkel = 2 x arctan (Breite / 2 / Brennweite)

@7nic

"Und im Bezug auf deine "Patches": Mir ist keine Kamera bekannt, die künstliche Bildinhalte "content-aware" generieren würde. Natürlich werden beim Demosaicing selbst und einer Rauschunterdrückung oder Kantenaufsteilung Pixel errechnet- aber das ja nur auf Mikroebene und ohne, dass da (intelligente) Inhalte hinzugefügt würden. Und in RAW kannst du diese Prozesse ja meist ganz umgehen. Könntest du da mal etwas konkreter werden? Das klingt mir doch alles zu sehr nach einer Verschwörungstheorie..."

Das ist alles nachzulesen in "Super resolution" und dass Dir keine Kamera, die solche Algorithmen einsetzt, bekannt ist, spricht eine eigene Sprache, sagt aber nichts darüber aus, dass die Algorithmen nicht eingesetzt werden.

Und dass wir übereinstimmen, dass 4K keine 4k sind, ist ja schon mal ein Schritt in die richtige Richtung.

Und wenn wir dann genügend 8K Objektive haben, können wir uns 4K mal wieder näher betrachten.

Antwort von iasi:

WoWu hat geschrieben:

Tja, IASI ... dann besteht doch Übereinkunft, dass 4 K nur in der Pixelauflösung und nicht in den Bilddetails besteht. Dann hat Geoff Boyle doch Recht.

Dann muss jetzt nur noch jemand 16K auf sein Gerät schreiben und alle sehen 16K.

Früher hat man die Bildauflösung noch in Bilddetails angegeben. Die Broadcaster machen das heute noch. .... wie altmodisch.

Sie sollten sich ein Beispiel an den Amateuren nehmen, bei denen ist 4 K schon lange ein alter Hut .... frage ist eben nur, was da drin steckt.

Darin besteht wohl auch heute noch ein Unterschied.

Und auch das Argument der Cropper oder Pan&scanner in der Post, man könne aus 4k mehr Details ziehen ... wenn im Bild nur 2K Bilddetails stecken haben sie bei jedem Crop entsprechend weniger, denn mit der Reduktion der Pixels, reduzieren sich zwangsläufig auch die Bilddetails im Verhältnis.

Aber ... super Idee, wenn man sowieso nur SD braucht, das aber messerscharf gerechnet.

Nee, nee IASI, all die selbsternannten Praktiker hier sollten den Test mal machen.

Sie trauen sich nur nicht ran, weil ihre neue Kamera sie dann desillusioniert.

Geoff Boyle hat schon Recht, auch wenn ich heute entlang seiner Argumentation nicht mehr unbedingt gehen würde, aber wenn er SR berücksichtigen würde, auf alle Fälle.

Ich verstehe wirklich nicht, wo das Problem sein soll.

Die Hersteller schreiben 4k auf eine Kamera mit 4k-Pixeln. Was ist daran nicht legitim?

Das Problem ist doch eher, dass das, was die Kamera liefert immer mit dem gleichgesetzt wird, was am Ende steht. Das klingt immer ganz so, als würde das Filmnegativ am Ende durch den Projektor geschickt.

Du wirfst ständig Zahlen in den Raum und postulierst sie als Grenzwerte - nun stecken plötzlich 2k Bilddetails in einem Bild.

Nee, Nee WoWu - es ist eben wie beim Negativ: Es gibt nicht die eine Bildauflösung, die Negative erzielen.

Boyle steckt in einem Glauben fest und nimmt technische Entwicklung gar nicht mehr wahr.

Es tut sich in allen Bereichen von Sensoren bis zu Objektiven erstaunlich viel. Und aufgrund der enorm gestiegenen Rechenpower eröffnen sich nun eben auch neue Lösungen - eben auch bei Bayer-Sensoren.

Selbst eine GH5 errechnet die 4k aus einer höheren Pixelanzahl.

Und aus einer Red Helium 8k bekommst du am Ende eben auch 4k - selbst bei leichtem Crop.

Mehr als das, was man aus einer Alexa herausholen kann, ist es sicherlich.

Auflösung ist nicht alles, aber es ist hilfreich.

Antwort von iasi:

"Frank Glencairn" hat geschrieben:

Alles gut und recht, aber nix davon ist in der Praxis relevant.

Alle Kameras (ab ner gewissen Liga), die man 2017 kaufen kann, machen Bilder, die gut genug für alles sind.

da gebe ich dir recht - wobei "für alles" etwas übertrieben ist

"Frank Glencairn" hat geschrieben:

Jedes Licht, jede Flag, jedes Set Design machen einen größeren Unterschied als Auflösung.

Auflösung ist IMHO der unwichtigste Faktor in einem Film.

Wahrscheinlich ist sogar das Catering am Set wichtiger :-)

Dem würde ich widersprechen.

Je besser das Ausgangsmaerial ist, umso besser sind auch die Gestaltungsmöglichkeiten in der Post. Wo das GH2-Team beim Camerashootout mit vielen zusätzlichen Lichtern feinarbeit am Set leisten musste, wurden beim Alexa-Material in der Post nur einige Fenster gesetzt und leicht aufgehellt.

Zeitaufwand am GH2-Set war größer.

Und wenn du von Praxis sprichst. Es hat eine enorme Wirkung, wenn man z.B. durch ein leichtes Hineinzoomen in ein Bild den Blick kaum wahrnehmbar verengt. In der Post mit entsprechendem Material schnell, problemlos und unter absoluter Kontrolle gemacht, ist der Aufwand am Set enorm, will man es mit einer Fahrt machen.

"Frank Glencairn" hat geschrieben:

Die ganze Diskussion - vor allem Auflösung und das was für "Schärfe" gehalten wird - ist sowieso hauptsächlich ne Hobby Diskussion.

Das Kamera Department, dessen Filme für gewöhnlich Oscars gewinnen, sind mit ner Alexa die bestenfalls echte 2K macht, oder sogar mit 2K gescanntem 16mm Film erfolgreich.

na na na - das stimmt so aber auch nicht ganz.

Antwort von Jott:

Vor zehn Jahren wurde behauptet, dass "Full HD" (1080) nicht funktionieren kann, weil die Objektive das gar nicht darstellen können. Daher sei 720p das einzig wahre Format. Seltsam, irgendwas muss sich seitdem verändert haben ...

Antwort von Frank Glencairn:

"Roland Schulz" hat geschrieben:

Was hat denn die Diashow mit Motion Blur an der Mütze?! Was hat ne statische Motiveinstellung damit zu tun???

Warum "halbiert" Motion Blur die Auflösung, die exakte Herleitung wird "allgemein" unmöglich zu halten sein, es ist einfach falsch.

Die Reduzierung der Auflösung durch Bewegung ist von der Verschlusszeit und der Geschwindigkeit der Bewegung abhängig - das kann von Bruchteilen eines Pixels bis zu mehreren Pixeln führen.

Mach Dich auch von "Mythen" frei wie Verschlusszeit gleich halbe Framegeschwindigkeit ;-), das "kann" man in beide Richtungen variieren, führt trotzdem in keinem Fall allgemein zu einer Halbierung der Auflösung!

Wenn du solche Fragen stellen mußt, ist das nix für dich.

Antwort von WoWu:

@IASI

"Boyle steckt in einem Glauben fest und nimmt technische Entwicklung gar nicht mehr wahr"

Du schließt aus, dass es auch anders herum sein könnte und Du auf eine "Entwicklung" hereinfällst, die in Marketingbüros stattgefunden hat und man statt dessen, was man sieht, einfach das angibt, was man überträgt.

Ich dachte immer, in der Videotechnik hätte man es mit einem optischen Medium zu tun, das das, was man real sieht auch technisch überträgt.

Aber dass es mittlerweile Patches sind, die man vorgesetzt bekommt, das ist so, als würde in Deinem morgendlichen Kellogg's 40% der Flocken aus Plastik bestehen.

Ich denke, dass Boyle näher an der Entwicklung dran ist, als so mancher, hier im Forum.

Antwort von nic:

WoWu hat geschrieben:

@7nic

"Und im Bezug auf deine "Patches": Mir ist keine Kamera bekannt, die künstliche Bildinhalte "content-aware" generieren würde. Natürlich werden beim Demosaicing selbst und einer Rauschunterdrückung oder Kantenaufsteilung Pixel errechnet- aber das ja nur auf Mikroebene und ohne, dass da (intelligente) Inhalte hinzugefügt würden. Und in RAW kannst du diese Prozesse ja meist ganz umgehen. Könntest du da mal etwas konkreter werden? Das klingt mir doch alles zu sehr nach einer Verschwörungstheorie..."

Das ist alles nachzulesen in "Super resolution" und dass Dir keine Kamera, die solche Algorithmen einsetzt, bekannt ist, spricht eine eigene Sprache, sagt aber nichts darüber aus, dass die Algorithmen nicht eingesetzt werden.

Und dass wir übereinstimmen, dass 4K keine 4k sind, ist ja schon mal ein Schritt in die richtige Richtung.

Und wenn wir dann genügend 8K Objektive haben, können wir uns 4K mal wieder näher betrachten.

Es spricht vor allem eine eindeutige Sprache, dass du erstaunlicherweise nicht auf meine Frage eingehst. Ein bisschen überhebliches Blabla - und das war's. Super resoultion hat nichts mit dem von dir genannten "content-aware patching" zu tun. So etwas ist heutzutage kameraseitig schlicht noch unmöglich.

4K sind natürlich 4K. Nur sind eben 4K Bayer Pattern keine 4K RGB. Worüber diskutieren wir da? Es gibt schlicht keine sinnvollere Möglichkeit die Auflösung eines Sensors zu deklarieren. Also gibt man die "photosites" an. Die finale Detailauflösung variiert letztlich von Aufnahme zu Aufnahme. Also sorgst du bei der Aufnahme für ein entsprechendes Oversampling zur Ausgabeauflösung. Das muss dem Anwender bewusst sein... und ist es auch.

Antwort von iasi:

WoWu hat geschrieben:

@IASI

"Boyle steckt in einem Glauben fest und nimmt technische Entwicklung gar nicht mehr wahr"

Du schließt aus, dass es auch anders herum sein könnte und Du auf eine "Entwicklung" hereinfällst, die in Marketingbüros stattgefunden hat und man statt dessen, was man sieht, einfach das angibt, was man überträgt.

Ich dachte immer, in der Videotechnik hätte man es mit einem optischen Medium zu tun, das das, was man real sieht auch technisch überträgt.

Aber dass es mittlerweile Patches sind, die man vorgesetzt bekommt, das ist so, als würde in Deinem morgendlichen Kellogg's 40% der Flocken aus Plastik bestehen.

Ich denke, dass Boyle näher an der Entwicklung dran ist, als so mancher, hier im Forum.

Eigentlich falle ich auf die Bilder herein, die die Kameras liefern. Die bieten mir den Gestaltungsspielraum, den ich mir wünsche.

Und ich stelle nun einmal einen Unterschied zwischen Kameras e der Auflösung fest, auch wenn du behauptest, er wäre nicht vorhanden.

Es kommt mir aber eben wieder einmal so vor, als hätte man zähneknirschent 4k geschluckt und schießt nun auf die 8k.

Wie oben schon gesagt: eine 8k/8bit-Kamera interessiert mich nicht.

Eine Helium 8k könnte aber für bestimmte Projete interessant sein - oder auch eine Alexa65 - aber meist genügt schon weniger bzw. kommt es auf andere Aspekte an.

Antwort von WoWu:

@IASI

Ja, aber das ist doch genau der Kern, dass wir uns heute über gute HD Bilder freien können und nur die Amateure darauf abfahren, was an goldenen Ziffern auf der Kamera steht.

Mehr sagt das Interview ja auch nicht aus.

Es steht nur immer die Behauptung im Raum, man könne 4K Auflösung (sichtbar, also als Bilddetailauflösung) nutzen und das ist etwas, was nun mehrfach ad absurdum geführt wurde und mittlerweile ja auch mehr und mehr Anwender hier im Forum sich von ihrem 4K Glauben sich auf die Position zurückziehen ... " na ja, aber besser als früher sind die Bilder ja schon ..."

Das ist doch ein Fortschritt und wir haben endlich vernünftiges HD.

Und .. wie gesagt, wenn wir dann die 8 oder 16k Kameras und die passenden Objektive (und die Kohle dafür) haben, sprechen wir über 4K Bilder.

@7nic

Außer Dir spricht hier niemand von "content-aware patching".

Du musst über den Tellerrand von Photoshop schon mal hinausschauen.

Ich spreche von Algorithmen, die in SR eingesetzt werden und Patches aus CNNs bilden.

Antwort von Starshine Pictures:

Bildwinkel = 2 x arctan (Breite / 2 / Brennweite)

Sorry, kann mir das mal jemand für nen S35 Sensor ausrechnen? Ich war schon immer scheisse in Mathe und Physik. Ausserdem bin ich mit den Kindern im Garten, und die Sonne brutzelt aufn Kopp. Aber ich würde das schon gern mal testen. Schliesslich hat die C100 ja einen 4k Sensor drin. Muss das zu filmende winzige Objekt irgend eine besondere Eigenschaft haben? Also z.B. Farblos oder gleiche Farbe wie Hintergrund oder sowas? Eignet sich ein roter Legostein auf einem Gartenzaun?

Antwort von mediavideo:

@IASI

Du hast es immer noch nicht verstanden:

Es geht generell nicht darum, dass man nach dem Debayern natürlich weniger optische Auflösung als Pixelauflösung auf dem Sensor hat.

Es geht darum, dass man auf jeder Sensorgröße (z.B. S35) eine maximale Pixelanzahl hat ab der die optische Bildqualität wieder sinkt. Und der Punkt liegt bei S35 offenbar bei ca. 4.5k Auflösung. 6k können dann eine niedrigere optische Bildqualität als 4k bringen.

Das zeigt doch der Vergleich von zwei aktuellen Kameramodellen in einem unabhängigen Qualitätstest der EBU/BBC nach Tech-3335:

4k-Kamera Canon C300 Mark II im unabhängigen Tech-3335 EBU/BBC-Test:

https://tech.ebu.ch/docs/tech/tech3335_s18.pdf

Gemessenes Rauschen im dunklen Bereich: -48 dB (siehe 3.4 Noise - auf Seite 15 -> Figure 9 bei ca. 0.2)

Gemessene brauchbare Dynamik in Blendenstufen: ca. 15 Stops (siehe 3.2 Gamma curves - auf Seite 13 - 11 pus 4.8 stops)

Gemessene optische maximale Auflösung: 3300x1750 (siehe 3.3.1 Resolution for 4k - auf Seite 14 -> vom 4k/UHD-Sensor-Readout)

6k-Kamera RED-Dragon im unabhängigen Tech-3335 EBU/BBC-Test:

https://tech.ebu.ch/docs/tech/tech3335_s16.pdf

Gemessenes Rauschen im dunklen Bereich: -44 dB (siehe 2. Dynamic range and Noise - Seite 5 - Figure 6 bei ca. 0.2)

Gemessene brauchbare Dynamik in Blendenstufen: ca. 13,5 Stops (siehe 2. Dynamic range and Noise - auf Seite 6 - 14 stops or less delivering useful pictures)

Gemessene optische maximale Auflösung: 2450x1380 (siehe 1. Resolution for 4k - Seite 2 -> 4k mode readout)

Gemessene optische maximale Auflösung: 2930x1650 (siehe 1. Resolution for 4k - Seite 2 -> 5k mode readout)

Gemessene optische maximale Auflösung: 3400x1900 (siehe 1. Resolution for 4k - Seite 2 -> 6k mode readout - allerdings nur noch außerhalb vom S35-Objektiv-Standard )

Und jetzt bitte nicht die RED S35-8k-Helium ins Spiel bringen, denn die Qualitätsproblematik wird doch immer schlimmer bei mehr k-Sensor-Auflösung bei S35 ... - das kann man schon an der Preisgestaltung bei RED sehen, denn die S35-8k-Helium ist preisgleich zur S35-6k-Dragon - warum wohl ?

Dazu verlangen Hersteller auch noch absurde Mondpreise für die schlechtere Bildqualität:

82485.- Euro - RED-6k-Dragon als drehfertiges Kit (ohne Akkus/Ladegerät ?)

- 49500.- Euro - RED 6k-Dragon Brain (ohne alles)

- 22685.- Euro - Cinemount Package (Side-Handle, Sucher, 7-Zoll Monitor, Breakout-Box, ...)

- 295.- Euro - Skin-Tone OLPF

- 5680.- Euro - 2 Stück 960GB RED-Mini-Mag

- 4325.- Euro - RED-Rocket X für schnelles Transcoding etc.

14004.- Euro - Canon C300 Mark III (ab Anfang 2018 dann inkl. internem RAW wie bei der C200) als drehfertiges Kit (mit Akku/Ladegerät)

- 12500.- Euro - Canon C300 Mk III (inkl. internes RAW, Sucher, Monitor, Side-Handle)

- 1504.- Euro - 8 Stück CFAST 256 GB Karten bis 250 MB/S reicht bei Canon 1:2.4 Kompression (günstigste Transcend 600x reichen)

Dabei hat die Canon C300 Mark III weitere erhebliche technische und bildqualitative Vorteile:

- So etwas wie das von RED empfohlene RED-Rocket X braucht man nicht

- Man hat extremst rauschfreie Verstärkung, sogar bis ISO 32000 (32-tausend) nutzbar (siehe: https://player.vimeo.com/moog/219685676 ... _start=off )

- Man hat eine sehr gute ColorScience und braucht dafür keinen OLPF-Tausch am dann offen liegenden Sensor am Set (bei Regen und Staub ...)

- Man hat zusätzlich den Top-Autofocus im S35-Bereich

- Man hat interne Objektivkorrekturen für Canon Foto- und Cine-Optiken (sehr gute und direkte in-kamera Korrektur von Verzeichnung und chromatischer Abberation)

- Man hat mit XF-AVC-4k-10/12bit den moderneren/besseren Codec gegenüber dem veralteten Apple-ProRes Codec (auf DCT-Basis)

- Man hat interne ND-Filter

- Die 120 Bilder/sek Zeitlupe ist gegenüber RED nicht gecroppt (Canon vom Full-Sensor-Readout)

- Integrierter GPS-Empfänger mit Einbettung in Aufnahmen

- Viele frei belegbare Tasten und Funktionen

- Canon-Kamerafernbedienungs-App für Smartphone/Tablet zur kompletten Remote-Kontrolle der Kamera über WLAN/Funk

- In Deutschland und vielen Ländern ist eine Herstellerniederlassung mit speziellem Pro-Service

Wo ist da der Sinn für mehr Auflösung bei S35-Sensoren? - Die RED 6k-Dragon kostet ca. 68500.- Euro mehr und ist technisch/optisch deutlich schlechter - das ist doch nur noch grotesk !!!

Mehr Auflösung geht nur noch sinnvoll mit wesentlich größeren Sensoren, siehe Alexa 65. Und 99% der Konsumenten interessiert mehr als 2k/HD-Auflösung sowieso nicht - teilweise interessiert die nicht mal 2k/HD, siehe DVD-Verkäufe zu BluRay-Verkäufe ...

IASI, hast Du das jetzt verstanden ?

Antwort von nic:

Bist du Canon-Händler? Oder welches Interesse steht hinter dieser Auslassung?

Antwort von Peppermintpost:

@mediavideo

du kaufst bei red halt nicht nur die technik, sondern du kaufst dich in eine bestimmt klasse von produktion ein. niemand dreht high-end werbung oder spielfilm mit einer canon (auch nicht wenn du jetzt eine liste mit 5 produktionen postest, statistisch ist das unerheblich).

ob das von der technischen seite her sinn macht oder nicht, das steht auf einem anderen blatt. aber so funktioniert das geschäft nunmal.

auf der anderen seite hab ich schon einiges an canon Cxxx footage bekommen und es war IMMER scheisse. das kann ich bei red beim besten willen nicht sagen. da hatte ich in der anfangszeit auch mal den einen oder anderen aussetzer dabei, aber seit dragon hab ich definitiv nicht ein einziges mal mehr schlechtes footage bekommen. selbst die sachen die der kameraman definitiv vergurkt hatte waren noch problemlos nutzbar.

man sein das canon auf den tech specs super aussieht, aber ne red ist schon eine ganz andere klasse wenn wir über bildqualität sprechen.

Antwort von WoWu:

"Starshine Pictures" hat geschrieben:

Bildwinkel = 2 x arctan (Breite / 2 / Brennweite)

Sorry, kann mir das mal jemand für nen S35 Sensor ausrechnen? Ich war schon immer scheisse in Mathe und Physik. Ausserdem bin ich mit den Kindern im Garten, und die Sonne brutzelt aufn Kopp. Aber ich würde das schon gern mal testen. Schliesslich hat die C100 ja einen 4k Sensor drin. Muss das zu filmende winzige Objekt irgend eine besondere Eigenschaft haben? Also z.B. Farblos oder gleiche Farbe wie Hintergrund oder sowas? Eignet sich ein roter Legostein auf einem Gartenzaun?

Muss zwar gleich aus dem Haus, komme aber damit hinterher durch ...

Muss nur noch wissen, welche Objektivbrennweite Du hast.

Du kannst auch eine Euromünze nehmen, die hat 2,3 cm Durchmesser.

Erst wenn Du auch Informationen zum Chroma haben willst, musst Du 4 identisch große Bauteile unterschiedlicher Farben nehmen, dann aber doppelt soweit weggehen. Aber fang mal mit ner Münze an. Lego geht natürlich auch.

Antwort von Abercrombie:

7nic hat geschrieben:

4K sind natürlich 4K. Nur sind eben 4K Bayer Pattern keine 4K RGB. Worüber diskutieren wir da? Es gibt schlicht keine sinnvollere Möglichkeit die Auflösung eines Sensors zu deklarieren. Also gibt man die "photosites" an. Die finale Detailauflösung variiert letztlich von Aufnahme zu Aufnahme. Also sorgst du bei der Aufnahme für ein entsprechendes Oversampling zur Ausgabeauflösung. Das muss dem Anwender bewusst sein... und ist es auch.

+1

Und ein HD-Bayer-Sensor kann weniger Informationen einfangen als ein 4K-Bayer-Sensor. Warum also nicht in 4K filmen, sofern Dynamik, Farben, Ergonomie, Postproduktion und so weiter für das Projekt passen?

Antwort von iasi:

mediavideo hat geschrieben:

@IASI

Du hast es immer noch nicht verstanden:

Es geht generell nicht darum, dass man nach dem Debayern natürlich weniger optische Auflösung als Pixelauflösung auf dem Sensor hat.

Es geht darum, dass man auf jeder Sensorgröße (z.B. S35) eine maximale Pixelanzahl hat ab der die optische Bildqualität wieder sinkt. Und der Punkt liegt bei S35 offenbar bei ca. 4.5k Auflösung. 6k können dann eine niedrigere optische Bildqualität als 4k bringen.

IASI, hast Du das jetzt verstanden ?

Wieder einmal so eine Größe, die als gegeben in den Raum gestellt wird.

Es ist doch interessant, dass der 8k-Helium eine höhere Bildqualität liefert, als der 6k-Dragon.

Es ist wie bei den Foto-Sensoren: Immer werden Grenzen postuliert, die dann aber eben durch neue Kameras einfach eingerissen werden.

Da schneidet eine A7s2 doch sogar selbst beim LowLight schlechter ab, als eine A7r2

https://www.dxomark.com/Cameras/Compare ... 7_1035_963

und dies, obwohl hier 12 Mpix mit 42 Mpix verglichen werden.

Antwort von WoWu:

Abercrombie hat geschrieben:

+1

Und ein HD-Bayer-Sensor kann weniger Informationen einfangen als ein 4K-Bayer-Sensor. Warum also nicht in 4K filmen, sofern Dynamik, Farben, Ergonomie, Postproduktion und so weiter für das Projekt passen?

Stimmt leider nur, wenn Du einen entsprechend großen Sensor hast und/oder ein Objekiv mit einer dazugehörigen Auflösung und einem perfekten Punktbild.

Gibt es alles, aber oberhalb von 50.000 EUR.

Sagt ja keiner, dass man mit viel Mühe und nochmehr Geld keine 4K Bildauflösung machen kann.

Nur eben nicht mit erschwinglichen Bordmitteln und unterdimemsionierten Sensoren.

Insofern sollte man Deinen Vergleich unter identischen Tahmenbedingungen betrachten ansonsten stimmt das Ergebnis leider nicht.

Antwort von Frank Glencairn:

Peppermintpost hat geschrieben:

du kaufst bei red halt nicht nur die technik, sondern du kaufst dich in eine bestimmt klasse von produktion ein. niemand dreht high-end werbung oder spielfilm mit einer canon ..

Naja, niemand wird bei dieser Klasse von Produktionen angeheuert, weil er eine bestimmte Kamera besitzt.

Normal werden Kameras von der Produktion gemietet, die meisten DPs wollen sowieso eine Alexa/Alexa Mini.

Die Mietkosten sind im Vergleich zu den anderen Produktionskosten so lächerlich niedrig, daß man sich mit einer bestimmten Kamera-Marke nirgendwo "einkaufen" kann.

Antwort von Starshine Pictures:

@ WoWu

Ich hab hier grad alles zwischen 11mm und 135mm zur Verfügung. Alles Fotoobjektive von ungefähr gleicher Schärfegüte.

Antwort von nic:

WoWu hat geschrieben:

Abercrombie hat geschrieben:

+1

Und ein HD-Bayer-Sensor kann weniger Informationen einfangen als ein 4K-Bayer-Sensor. Warum also nicht in 4K filmen, sofern Dynamik, Farben, Ergonomie, Postproduktion und so weiter für das Projekt passen?

Stimmt leider nur, wenn Du einen entsprechend großen Sensor hast und/oder ein Objekiv mit einer dazugehörigen Auflösung und einem perfekten Punktbild.

Gibt es alles, aber oberhalb von 50.000 EUR.

Sagt ja keiner, dass man mit viel Mühe und nochmehr Geld keine 4K Bildauflösung machen kann.

Nur eben nicht mit erschwinglichen Bordmitteln und unterdimemsionierten Sensoren.

Insofern sollte man Deinen Vergleich unter identischen Tahmenbedingungen betrachten ansonsten stimmt das Ergebnis leider nicht.

Oberhalb von 50.000 Euro? Es gibt keine gängigen Primes, die auch nur annähernd so teuer sind. Selbst Master Primes bekommst du für 20k das Stück. Und die lösen dir dann so 200lp/mm auf. Offenblende. Aber selbst abgeblendete Samyang Billigoptiken schaffen das...

6k auf S35 (Helium 8K) entsprächen allerdings nur etwa 130lp/mm. Wenn ich mich nicht irre.

Und da ein Bayer-Sensor sowieso keine 8k auflöst, dürften Objektive mit rund 100lp/mm doch noch von der Auflösung profitieren...

Antwort von klusterdegenerierung:

7nic hat geschrieben:

Aber selbst abgeblendete Samyang Billigoptiken schaffen das...

Wobei man bei den Samyangs getrost von preiswert statt billig sprechen kann! ;-))

Antwort von Jott:

Was sagen eigentlich Fotografen dazu, dass gerade mal 8 Megapixel nicht auflösbar sein sollen?

Antwort von klusterdegenerierung:

Kommt immer auf die Megapixel an.

Meine erste Digi war die legendäre Coolpix 990 mit Schwenkoptik.

Die hatte 3MP, aber die waren immer noch besser als die der Sparte von Cams, die schon 3x soviel hatten.

Auch meine erste DSLR, die Fuji S2 mit 6MP war ein Knaller,

die Daten waren so sauber, die macht so mancher Cam noch was vor.

Mir waren die MP immer recht schnuppe, aber die Werbeagenturen machten immer richtig Druck

mit diesem MP hype, aber das lag wohl daran, das viele wie damals auch,

immer noch nicht vertstehen, das man Großformatplots nicht mit 300dpi druckt. ;-)

Der ewige Spruch klingelt mir immer noch in den Ohren:

"Aber 300dpi, ne!"

Antwort von iasi:

Es ist immer dieselbe Art der Diskussion:

Die Theoretiker werfen mit Zahlen und scheinbaren Fakten um sich, während die Praktiker ihre Eindrücke zu untermauern versuchen.

http://blog.vincentlaforet.com/2017/06/ ... ualifiers/

das sieht eben nun einmal beeindruckend aus, was die Kamera an Bilder ausgibt

und dass das alles eben nicht so einfach in einigen Größen zu erfassen ist, sagt auch unser Red-Mann:

http://www.reduser.net/forum/showthread ... tion/page5

I'm not happy predicting in theory what is going to work best on the sensor side of things. There's too many variables and pixel design advances along with the electronics and processing. Unfortunately that means we'll have to wait on good empirical data before I can answer that! But my guess is that the size of the sensor is intimately tied to the lenses used with it, and that is a major influence on the image we see. Pixel density is going to interact with the lens MTF too, and that is partly why Helium sensors look so good. It's a very interesting question.

Graeme

Antwort von Peppermintpost:

das problem ist nur, immer wenn die theoretiker mal was zu lachen haben wollen, dann laden sie eine gruppe leute ein und machen einen A/B test, und alle die die vorher sagen wie toll doch der unterschied ist und im dilirium davon faseln das das endlich ist wie ein blick durchs fenster und das ganze bla bla, genau die praktiker sind dann aber halt doch nicht in der lage hd von 4k zu unterscheiden. komisch oder?

Antwort von Roland Schulz:

WoWu hat geschrieben:

Die 100m sind die Variable denn die richten sich nach der Sensorgrösse und der Brennweite. Es liegt also zwischen 80 und 120m

Es gilt die Formel für den Bildwinkel, um die Entfernung zu ermitteln:

Bildwinkel = 2 x arctan (Breite / 2 / Brennweite)

Servus Wolfgang,

ganz ehrlich, damit kann ich als Ingenieur nichts anfangen, das ist sehr stark interpretierbar bzw. macht keinen Sinn. In Deiner Formel taucht die ominösen Entfernung von 100m (bzw. 80-120) gar nicht mehr auf. Wieso ergibt sich dann eine Abhängigkeit des Bildwinkels? Welche Breite ist gemeint? Die des Sensors oder die der aufzunehmenden Szene? Wie hängt Bildwinkel mit Entfernung zusammen, da fehlt die Formel bzw. die Beschreibung des Zusammenhangs. Du schreibst nur "richten sich nach", das ist kein reproduzierbarer Zusammenhang.

WAS willst Du eigentlich zeigen oder wiederlegen mit dem genau 2cm großen Quadrat in 100m Entfernung? Soll dieses noch sichtbar sein? Viel einfacher - bei welcher Aufnahme-/Abbildungsbreite soll das 2cm Rechteck noch zu sehen sein - würde für mich mehr Sinn machen.

Das kann ich je nach Bildwinkel in vergleichsweise kurzer wie langer Entfernung praktizieren.

Antwort von Jörg:

im dilirium davon faseln das das endlich ist wie ein blick durchs fenster und das ganze bla bla, genau die praktiker sind dann aber halt doch nicht in der lage hd von 4k zu unterscheiden

wie oft habe ich das schon erlebt ;-))

Antwort von iasi:

Peppermintpost hat geschrieben:

das problem ist nur, immer wenn die theoretiker mal was zu lachen haben wollen, dann laden sie eine gruppe leute ein und machen einen A/B test, und alle die die vorher sagen wie toll doch der unterschied ist und im dilirium davon faseln das das endlich ist wie ein blick durchs fenster und das ganze bla bla, genau die praktiker sind dann aber halt doch nicht in der lage hd von 4k zu unterscheiden. komisch oder?

klar - weil wenn sie einen Unterschied sehen, dann erzählen ihnen die Theoretiker etwas über Kanten und Schärfung und und und ...

Also ich sehe jedenfalls die Unterschiede - und mir genügt das dann auch schon, um mich für 4k statt HD zu entscheiden.

Antwort von Roland Schulz:

"Frank Glencairn" hat geschrieben:

"Roland Schulz" hat geschrieben:

Was hat denn die Diashow mit Motion Blur an der Mütze?! Was hat ne statische Motiveinstellung damit zu tun???

Warum "halbiert" Motion Blur die Auflösung, die exakte Herleitung wird "allgemein" unmöglich zu halten sein, es ist einfach falsch.

Die Reduzierung der Auflösung durch Bewegung ist von der Verschlusszeit und der Geschwindigkeit der Bewegung abhängig - das kann von Bruchteilen eines Pixels bis zu mehreren Pixeln führen.

Mach Dich auch von "Mythen" frei wie Verschlusszeit gleich halbe Framegeschwindigkeit ;-), das "kann" man in beide Richtungen variieren, führt trotzdem in keinem Fall allgemein zu einer Halbierung der Auflösung!

Wenn du solche Fragen stellen mußt, ist das nix für dich.

Deine Aussage bzgl. Halbierung der Auflösung ist einfach völlig falsch bzw. nur für eine relative Bewegungsgeschwindigkeit korrekt, vielleicht ist ein variabler Faktor zur Reduzierung der Auflösung einfach nichts für Dich ;-)!?!

Du hast allerdings Recht das bei einer Diashow das Standbild bereits mit "langer" Verschlusszeit aufgenommen worden sein kann und somit in der Auflösung reduziert ist, mein Fehler wobei ich hier davon ausgegangen wäre dass das abgeleitet wurde - zuviel erwartet.

Bei der im Weiteren angeführten "statischen" Szene ist es aber eindeutig, hier wird nichts durch Bewegung in der Auflösung reduziert weil sich im Bild (-Ausschnitt) NICHTS bewegt!

Antwort von Roland Schulz:

Ich weiß gar nicht warum hier einige immer noch Auflösungen über 2K in Frage stellen und behaupten, dass diese nicht existent seien. Guckt Euch das hier bitte nochmal an, am besten über den Link, dann ist fertig, auch wenn ihr es nicht glaubt und euch weiter lächerlich macht.

~10K vs. 8,7K vs. 6K vs. 4K

10k-4k.PNG

10k-4k_2.PNG

Quelle: https://www.dpreview.com/reviews/image- ... 8718881343

Antwort von Frank Glencairn:

Wir haben mal so nen Test mit 2 x identischem HD footage gemacht, einer der beiden HD Monitore hatte leicht erhöhten Kontrast, sonst waren alle Parameter gleich. Den Probanden haben wir gesagt, daß auf einem der Monitore 4k Material laufen würde -und selbstverständlich haben die ganzen "Spezialisten" Stein und Bein geschworen, sie könnten da deutlich mehr Details sehen, viel schärfer blah... und das sei natürlich eindeutig 4K Material, das sehe doch ein Blinder usw.

War im Rahmen eines Workshops über Wahrnehmungs-Psychologie in der Film/TV Technik.

Ich hab tagelang das Grinsen nicht mehr vom Gesicht bekommen :-)

Antwort von Frank Glencairn:

"Roland Schulz" hat geschrieben:

Deine Aussage bzgl. Halbierung der Auflösung ist einfach völlig falsch bzw. nur für eine relative Bewegungsgeschwindigkeit korrekt, vielleicht ist ein variabler Faktor zur Reduzierung der Auflösung einfach nichts für Dich ;-)!?!

Du hast allerdings Recht das bei einer Diashow das Standbild bereits mit "langer" Verschlusszeit aufgenommen worden sein kann und somit in der Auflösung reduziert ist, mein Fehler wobei ich hier davon ausgegangen wäre dass das abgeleitet wurde - zuviel erwartet.

Bei der im Weiteren angeführten "statischen" Szene ist es aber eindeutig, hier wird nichts durch Bewegung in der Auflösung reduziert weil sich im Bild (-Ausschnitt) NICHTS bewegt!

Du hast immer noch nicht mal im Ansatz verstanden, was ich gesagt hab.

Antwort von Olaf Kringel:

iasi hat geschrieben:

klar - weil wenn sie einen Unterschied sehen, dann erzählen ihnen die Theoretiker etwas über Kanten und Schärfung und und und ...

...wie oft habe ich "genau das" auch schon hier bei manchen Diskussionen gedacht ;)

Ich schnapp mir dann halt die cam und mache eigene praktische Tests und die Ergebnisse decken sich von der visuellen Wahrnehmung her nicht immer mit der Theorie.

Wer lieber in FHD drehen mag, soll das aber selbstverständlich machen, solange es Spaß macht...

Antwort von Funless:

"Frank Glencairn" hat geschrieben:

War im Rahmen eines Workshops über Wahrnehmungs-Psychologie in der Film/TV Technik.

Vielleicht wird ja auch einigen hier einfach nur Unrecht getan, weil sie vielleicht keine Menschen sind, sondern Androiden, so wie Data aus TNG, deren Augen >16 Blenden wahrnehmen und aus jedem Pixel x^12 Bilddetails extrahieren können?

Wer weiß das schon?

Antwort von Olaf Kringel:

...sorry, das ich noch mal kurz dazwischen schreibe,

bzgl. der Frage im thread Titel, wäre meine Antwort übrigens ganz klar nein, sofern der Erfolg eines Filmes damit gemessen werden sollte.

Antwort von Roland Schulz:

"Frank Glencairn" hat geschrieben:

"Roland Schulz" hat geschrieben:

Deine Aussage bzgl. Halbierung der Auflösung ist einfach völlig falsch bzw. nur für eine relative Bewegungsgeschwindigkeit korrekt, vielleicht ist ein variabler Faktor zur Reduzierung der Auflösung einfach nichts für Dich ;-)!?!

Du hast allerdings Recht das bei einer Diashow das Standbild bereits mit "langer" Verschlusszeit aufgenommen worden sein kann und somit in der Auflösung reduziert ist, mein Fehler wobei ich hier davon ausgegangen wäre dass das abgeleitet wurde - zuviel erwartet.

Bei der im Weiteren angeführten "statischen" Szene ist es aber eindeutig, hier wird nichts durch Bewegung in der Auflösung reduziert weil sich im Bild (-Ausschnitt) NICHTS bewegt!

Du hast immer noch nicht mal im Ansatz verstanden, was ich gesagt hab.

Du hast geschrieben dass schon ein einziger Pixel Motion Blur die Auflösung um die Hälfte reduziert - bitte, technisch falschere Aussagen hats hier selten gegeben.

Antwort von Roland Schulz:

"Frank Glencairn" hat geschrieben:

Wir haben mal so nen Test mit 2 x identischem HD footage gemacht, einer der beiden HD Monitore hatte leicht erhöhten Kontrast, sonst waren alle Parameter gleich. Den Probanden haben wir gesagt, daß auf einem der Monitore 4k Material laufen würde -und selbstverständlich haben die ganzen "Spezialisten" Stein und Bein geschworen, sie könnten da deutlich mehr Details sehen, viel schärfer blah... und das sei natürlich eindeutig 4K Material, das sehe doch ein Blinder usw.

War im Rahmen eines Workshops über Wahrnehmungs-Psychologie in der Film/TV Technik.

Ich hab tagelang das Grinsen nicht mehr vom Gesicht bekommen :-)

...kannst mal sehen was für Blindgänger Du da eingeladen hast.

Welche Unterschiede fallen Dir im von mir verlinken dpreview Vergleich auf??? Auch keine - alles das selbe?? Dann ist es Zeit für ne neue Brille, Augen OP oder nen ganz anderes Diskussionsumfeld.

Antwort von cantsin:

"Roland Schulz" hat geschrieben:

Du hast geschrieben dass schon ein einziger Pixel Motion Blur die Auflösung um die Hälfte reduziert - bitte, technisch falschere Aussagen hats hier selten gegeben.