Der Begriff Denoising (auch Noise Reduction, kurz NR) bedeutet Entrauschen und ebendiese Funktion nutzen viele Anwender in letzter Zeit immer häufiger. Doch wann macht der Einsatz eines Denoisers überhaupt Sinn?

Auf den ersten Blick klingt "Denoising" wie eine magische Wunderwaffe. Mit genügend Rechenpower ist es scheinbar irgendwie möglich, aus stark verrauschten Aufnahmen wieder ein "klares" Bild zu erzeugen. Doch in der Praxis ist die Rauschentfernung auch mit ein paar Nachteilen verbunden, auf die wir sukzessive eingehen wollen.

Denoising braucht Rechenleistung

Als Daumenregel kann erst einmal gelten: Je besser ein Denoising-Algorithmus funktioniert, desto mehr Rechenleistung benötigt er. Auf einer normalen CPU ist schon ein moderner FullHD-Denoising-Algorithmus kaum in Echtzeit zu schaffen. Auf einer modernen GPU (also Grafikkarte) dagegen schon. Wenn es jedoch um die bestmöglichen Ergebnisse - eventuell sogar in 4K - geht, kommt man in der Regel nicht um längere Rendering-Sessions herum.

Dies ist insofern problematisch, weil man in vielen Bereichen einen Denoiser immer visuell kontrollieren sollte. Parameter, die in einer Szene gut funktionieren, können in einer anderen Szene (oder auch nur in anderen Bildbereichen) für hässliche Artefakte sorgen. Um jedoch die Qualität eines Denoisers richtig einzuschätzen, MUSS man dessen Ergebnis in Echtzeit sehen. Sieht man das Ergebnis z.B. nur mit 17 fps statt mit 24 fps, so ist eine korrekte Einschätzung der Bildwirkung fast unmöglich, da man das Bewegungsverhalten der Flächen und des übrigen Rauschens bei anderen Bildraten eben ganz anders wahrnimmt.

Zwei Grundtypen

Grundsätzlich lassen sich die Verfahren zur Rauschunterdrückung in zwei Klassen einteilen, temporale und spatiale Verfahren, wobei die besten Denoiser meistens beides kombinieren.

Die spatialen Verfahren betrachten nur die Rauschverteilung innerhalb eines Bildes und versuchen sich ein eigenes Bild des Rauschens zu machen. In der Regel erstellen sie so etwas wie einen typischen Abdruck (Noise-Print), worunter man sich eine möglichst getreue Simulation des vorhandenen Rauschens vorstellen kann. Dieses geschätzte Rauschen wird dann aus dem Original-Bild herausgerechnet.

Bei den temporalen Verfahren versucht dagegen die Noise Reduction zu erkennen, welche Veränderungen zwischen mehreren Bildern alleine auf das Rauschen zurückzuführen sind. Damit dies gut funktioniert, muss die Software daher auch erkennen, wenn sich die Kamera oder einzelne Objekte bewegen. Deswegen wird hierbei in der Regel das Material mittels Optical Flow-Algorithmen analysiert, was ohne GPU extrem zeitaufwändig ist. Im Gegenzug sind die temporalen Verfahren meist spürbar effektiver und gehen meist deutlich weniger destruktiv zu Werke. Eben weil sie über den zeitlichen Vergleich besser einschätzen können, welche Pixelwerte zu einem Objekt gehören und welche Pixelveränderungen durch Rauschen entstehen.

In diesem Zusammenhang sei auch kurz angemerkt, dass fast alle uns bekannten temporalen Rauschunterdrücker zeitlich nur in eine Richtung arbeiten. Das bedeutet, dass die ersten Frames eines Clips meistens noch stärker rauschen, bis der Algorithmus seine Parameter gefunden hat. Es ist daher anzuraten, beim Denoising immer ein paar Frames mehr Vorlauf/Fleisch mitzunehmen, als man später einsetzen wird. Denn dieses "Einschwingen" der Noise Reduction fällt auch ungeübten Betrachtern schnell ins Auge.

Rechenhilfe GPU

Gute Plugins wie Neat oder auch der integrierte Denoiser in Resolve können wie bereits angedeutet die GPU zur Berechnung einer Noise-Reduction nutzen. Besser gesagt es können sogar mehrere Grafikkarten genutzt werden, was in nicht allzu komplexen Fällen tatsächlich auch eine 4K-Echtzeit-Vorschau (aktuell ab ca. drei) mächtigen GPUs möglich macht. In Ermangelung dieser nicht unbedingt günstigen Hardware kann man alternativ auch immer kurze Clipbereiche in einen Cache rendern lassen, um eine Echtzeitvorschau zur Kontrolle zu erhalten.

Bessere Qualität ?

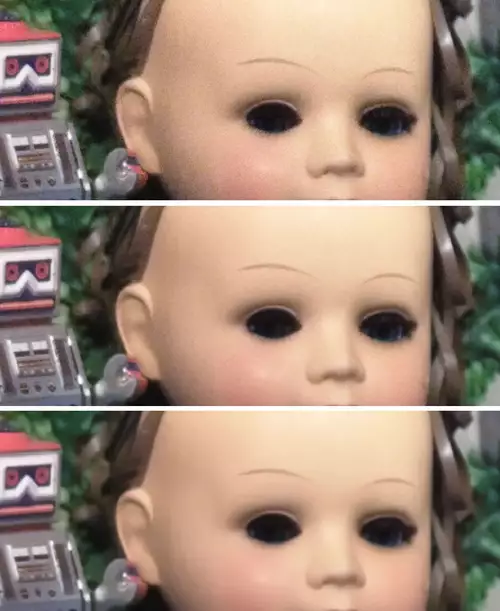

Wenn man sich an eine Rauschunterdrücktung wagt, verändert man zwangsläufig die Qualität seines Bildmaterials. Und keineswegs immer nur zum Guten, wobei hier der subjektive Anspruch eine große Rolle spielt. Denn letztlich erzeugt jede Rauschunterdückung unnatürliche Flächen und Verläufe, wo vorher eben Rauschen war. Die besonderen Problembereiche zeigen sich im Ergebnis oft an typischen Bildbereichen wie:

1. unnatürliche, "wachsige" Haut,

2. Texturen, die wie ein Aquarellbild gemalt scheinen sowie

3. aalglatte, strukturlose Flächen.

Dazu wirkt etwas Rauschen in der Regel auf viele Betrachter keinesfalls unangenehm, sondern wird eher sogar als natürlicher Bildeindruck wahrgenommen. Deswegen sollte man eine Rauschunterdückung vor allem dort einsetzen, wo das Bildrauschen so stark auffällt, dass es vom eigentlichen Bildinhalt ablenkt.

Rauschen ist nicht gleich Rauschen

Ein natürliches Rauschen entsteht an jedem einzelnen Sensel/Pixel des Sensors. Es gibt jedoch auch ein hieraus zusammengefasstes, gröberes Rauschen, welches vor allem durch die Kompression im Codec entsteht, wenn es nicht gelingt, mehrere Pixel eines 8x8 Blocks ausreichend genau zu speichern. In diesem Fall sieht man zusammengefasste Rauschmuster, die nicht nur unnatürlich wirken, sondern sich auch je nach Kompression in komischen (Bewegungs-)Mustern von Frame zu Frame verändern.

Dies ist ein elementares Problem von Kameras, die nicht mit ausreichend hoher Datenrate aufzeichnen können, um auch feine Rauschdetails exakt zu speichern. Grundsätzlich lässt sich sagen, dass erst bei unkomprimierten RAW-Aufnahmen wirklich natürliches Rauschen aufgezeichnet wird. Bei 4K mit 100 Mbit ist es dagegen definitiv nicht möglich, Rauschmuster natürlich zu komprimieren (10 Bit ProRES HQ reiht sich zwischen diesen Extremen ein). Dieses zusammengefasste Kompressionsrauschen ist in der Postproduktion übrigens viel schwieriger zu entfernen als eine natürliche Rauschverteilung.

Oder doch schon in der Kamera?

Aus genau diesen Gründen setzt praktisch jeder Kamerahersteller auf eine interne Rauschunterdrückung des Signals, bevor es zum Encodieren in den Codec gelangt. Doch hier entsteht das Problem, dass Algorithmen, die in der Kamera 4K in Echtzeit entrauschen müssen, nicht sehr viel Rechenleistung zur Verfügung haben. Sie müssen daher sehr grobschlächtig zu Werke gehen und bügeln viele Details einfach platt anstatt zu versuchen, sie aufwändig zu retten. Dies ist übrigens auch der Hauptgrund dafür, warum Consumer-Kameras im Low-Light Einsatz immer schnell unscharf werden.

Die Alternative wäre jedoch, das Signal ohne Rauschunterdrückung an den Codec zu schicken, der bei 100 Mbit/s davon absolut überfordert wäre und dann sehr hässliches Macroblocking zeigen würde. So gesehen ist bei typischer, starker Kompression wie 100 MBit/s H.264 bei 4K oder 25 MBit/s bei FullHD eine Rauschunterdrückung in der Kamera "alternativlos". Wenn die Kamera jedoch bei HDMI-Ausgabe die Noise Reduction deaktiviert kann dies - auch wenn es komisch klingt - als wertvolles Feature mit einem externen Recorder genutzt werden.

Downscaling = Automatisches Denoising

Ebenfalls erwähnenswert ist der Effekt des Downscalings auf das Rauschen. Da beispielsweise beim Herunterskalieren von 4K/UHD auf FullHD vier Pixel zu einem Pixel zusammengefasst werden, wirkt sich dies wie eine natürliche Rauschunterdrückung aus. Denn bei der Erzeugung des Mittelwerts der vier Farbwerte wird auch automatisch der Rauschanteil mit gemittelt, was einer Filterung gleichkommt. Die damit verbundene Auflösungsreduktion ist in diesem Fall ja absichtlich und erwünscht, weshalb diese automatische Rauschunterdrückung auch gar nicht vermeidbar ist. Dies ist wiederum der Grund, warum so viele Anwender von ihren Kameras sagen, dass sie in 4K stärker rauschen als in FullHD. Denn dies ist prinzipbedingt gar nicht zu vermeiden.

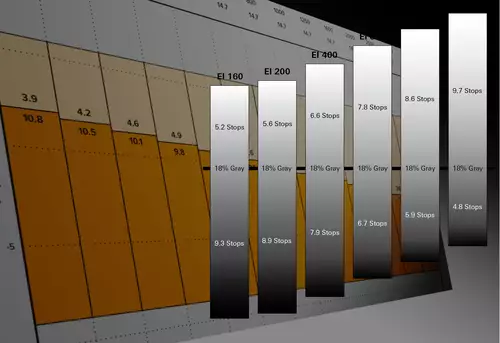

Rauschen und Log

Doch woher kommt das Rauschen eigentlich? Einfach erklärt: Beim Rauschen verzählt sich der Sensor bei den erfassten Photonen um ein paar Stück hin oder her. Doch in den dunkelsten Bildbereichen entsprechen ein paar Photonen schnell ein oder mehr Blendenstufen. In hellen Bildbereichen erfasst ein Sensor-Sensel dagegen auch gerne mal 10.000 Photonen oder mehr und eine Blendenstufe entspricht in hellen Bereichen mehreren tausend Photonen, weshalb hier eine Abweichung um ein paar Photonen nicht sonderlich auffällt. Dies ist wiederum der Grund, warum das Rauschen meistens nur ein Problem in den dunklen Bildbereichen darstellt.

Filmt man mit Log-Profilen, verstärkt man auf den ersten Blick dieses Problem noch. Denn bei der Log-Kurve werden die dunklen Bildpartien in die mittleren Bildbereiche verschoben. Und damit werden effektiv nicht nur die Schatten vor der Aufzeichnung angehoben, sondern mit ihnen auch das enthaltene Rauschen verstärkt. Bei einer Log-Aufzeichnung ist daher das Rauschen noch einmal viel deutlicher zu sehen, als beispielsweise bei einer Rec709-Aufzeichnung, welche die Schatten viel tiefer hält.

Dabei hat dieses deutlich sichtbare Rauschen erst mal handfeste Vorteile: Zunächst geht es quasi sowieso von alleine wieder zurück, wenn man im Mastering die Schattenbereiche des Bildes wieder auf die "echten Schwarzwerte" setzt. Doch bei der Aufzeichnung bekommt der Codec das Rauschen in den mittleren Bildbereichen deutlicher zu Gesicht und kann daher die Details in den Schatten (inkl. des Rauschens) effektiver komprimieren. Es bleiben also bei der Aufzeichnung mehr Details erhalten.

Und nicht zuletzt kann auch die Noise Reduction in der Post Produktion das Rauschen besser analysieren, wenn es in helleren Bildbereichen sitzt. Es macht also durchaus Sinn, das Rauschen vor der Aufzeichnung durch Log implizit "zu verstärken", um es sauberer aufzuzeichnen. Dann kann man es in der Postproduktion leichter herausrechnen und danach die Schatten wieder Richtung Master-Schwarz fallen lassen. Das Ergebnis von so einem Workflow können extrem saubere Schatten sein. Besonders wenn anschließend noch von 4K auf FullHD skaliert wird.

Die meisten Schnittprogramme bringen übrigens keinen eigenen Denoiser mit, sondern dieser muss in der Regel als Plugin zugekauft werden. Als Plugin für fast alle gängigen Plattformen beliebt, bewährt und kontinuierlich weiterentwickelt ist Neat Video. Lösungen anderer Hersteller sind meistens teurer, jedoch nicht mehr unbedingt besser. Wer etwas Frickelei nicht scheut, findet auch viele guten Open-Source Ansätze, die jedoch erst einmal beherrscht sein wollen. Diese sind meistens für AVISynth oder VirtualDub ausgelegt und laufen daher nicht ohne weiteres in kommerziellen Schnittprogrammen.

Die meisten Schnittprogramme bringen übrigens keinen eigenen Denoiser mit, sondern dieser muss in der Regel als Plugin zugekauft werden. Als Plugin für fast alle gängigen Plattformen beliebt, bewährt und kontinuierlich weiterentwickelt ist Neat Video. Lösungen anderer Hersteller sind meistens teurer, jedoch nicht mehr unbedingt besser. Wer etwas Frickelei nicht scheut, findet auch viele guten Open-Source Ansätze, die jedoch erst einmal beherrscht sein wollen. Diese sind meistens für AVISynth oder VirtualDub ausgelegt und laufen daher nicht ohne weiteres in kommerziellen Schnittprogrammen.