Newsmeldung von slashCAM:

Mit der Venice 2 mit 8K Sensormodul stellt Sony sein Flaggschiff im CineAlta Bereich vor. Mit 8.2K 16 Bit X-OCN RAW Recording bis max 60 fps und 5.8K X-OCN Aufnahme bis max 90 fps setzt die Sony Venice 2 ein deutliches Ausrufezeichen in Sachen Auflösung und Frameraten. Wir hatten Gelegenheit zu einem ersten Praxisdreh mit der soeben frei gegebenen finalen Firmware für die neue 8K CineAlta Sony ?

Hier geht es zum slashCAM Artikel:

Test: Sony Venice 2: Flaggschiff 8K RAW Cine-Kamera in der Praxis - ARRI LF Konkurrenz reloaded ...

Antwort von Frank Glencairn:

" 2nd DOP" ?

Sollte das nicht AC1 oder 1st AC heißen?

Ansonsten ja, sehr schicke Mühle, da hat Sony vieles richtig gemacht.

Hab gerade Material davon für nen Trailer auf dem Schneidetisch - recht geschmeidig.

Antwort von rob:

Hi Frank,

ja, hast Recht - spielt gerade neu aus.

Und ja, das "Sony RAW" ist ziemlich performant - auch in 8K.

Viele Grüße

Rob/

slashCAM

Antwort von pillepalle:

Was ist an X-OCN denn anders als bei 'normalem RAW'. Ist das schon debayert? Denn komprimiert werden die andere RAW Formate ja auch.

VG

Antwort von Paralkar:

Hattet Ihr irgendwelche Problem mit dem M1 Max Macbook die AXS Karten zu finden und zu kopieren (hab schon öfters von fehlenden Treibern für Apple Silicon gelesen, bei manchen klappts die Karten zu finden und zu kopieren, bei manchen nicht)

Wie waren eure debayering Settings, full debayring?

Wieviel Frames/s Renderspeed konntet ihr mit dem M1 Max Bsp.: bei ner 4k Timeline zu 4k h264/5 erreichen bzw. gerne auch Full HD Timeline zu Full HD h264/5 oder ProRes

Antwort von rob:

Paralkar hat geschrieben:

Hattet Ihr irgendwelche Problem mit dem M1 Max Macbook die AXS Karten zu finden und zu kopieren (hab schon öfters von fehlenden Treibern für Apple Silicon gelesen, bei manchen klappts die Karten zu finden und zu kopieren, bei manchen nicht)

Wie waren eure debayering Settings, full debayring?

Wieviel Frames/s Renderspeed konntet ihr mit dem M1 Max Bsp.: bei ner 4k Timeline zu 4k h264/5 erreichen bzw. gerne auch Full HD Timeline zu Full HD h264/5 oder ProRes

Hallo P.

witziger Weise war es genau umgekehrt. Der Sony Reader wurde problemlos am M1Max erkannt (aber

nicht am Windows Rechner).

Debayert haben wir mit Sony Full.

X-OCN Exporte nach YT mp4 habe ich nicht gestoppt - machen wir sicherlich beim nächsten Mac Rendertest wieder

Viele Grüße

Rob/

slashCAM

Antwort von Paralkar:

Erstmal vielen lieben Dank,

Das ist beruhigend zu hören, weil ich da noch am meisten Sorgen hatte, befinde mich grad in nem Projekt mit 2 Venice 1 und für weitere 5 Folgen sollen es 2 x Venice 2 werden, da ich mein Macpro late 2013 maxed out verkaufen und aufs Macbook M1 Max wechseln wollte, falls es irgendwann man ankommt....

Antwort von rob:

Nein - keine Probleme hier damit - allerdings ist der Sony Reader recht laut (kleines Flugzeug das auf dem Tisch startet ) - nichts für Umgebungen die leise bleiben müssen ;-)

VG

Rob/

slashCAM

Antwort von Mantas:

pillepalle hat geschrieben:

Was ist an X-OCN denn anders als bei 'normalem RAW'. Ist das schon debayert? Denn komprimiert werden die andere RAW Formate ja auch.

VG

hm vielleicht legt Sony weniger Wert auf das Wort als das Slashcam Forum :)

Antwort von pillepalle:

@ Mantas

Es geht ja nicht um ein Wort, sondern einfach darum um was für eine Art Daten es sich dabei handelt. Warum wird das im Filmbereich so selten klar kommuniziert?

Wenn ich den Slashcam Artikel lese bekomme ich den Eindruck es verhalte sich so ähnlich wie RAW. Auch beim schnellen googeln nach X-OCN bei Sony habe ich nur

Geschwurbel gefunden. Irgendwas von 16 Bit mit vielen Farben und komprimiert. Deshalb meine Frage :)

RAW bedeutet ja nur das es sich um die undebayerten, nicht veränderbaren Sensordaten handelt. Um sie dauerhaft zu ändern, muss man sie in einem anderen Format speichern. Mir ist schon klar, dass das Red-Patent vermutlich damit zu tun hat, denn ohne Kompression ist RAW im Filmbereich ja eher witzlos. Nur ändert das ja nichts daran, dass man dem Nutzer sagen könnte was für Daten er bekommt, bzw inwieweit sie verändert wurden.

VG

Antwort von Mantas:

pillepalle hat geschrieben:

RAW bedeutet ja nur das es sich um die undebayerten, nicht veränderbaren Sensordaten handelt. Um sie dauerhaft zu ändern, muss man sie in einem anderen Format speichern. Mir ist schon klar, dass das Red-Patent vermutlich damit zu tun hat, denn ohne Kompression ist RAW im Filmbereich ja eher witzlos. Nur ändert das ja nichts daran, dass man dem Nutzer sagen könnte was für Daten er bekommt, bzw inwieweit sie verändert wurden.

Vielleicht gehört Geschwurbel bissel dazu. Blackmagic schmeißt auch mit dem RAW um sich.

Antwort von klusterdegenerierung:

Haa, wenn da jetzt NikonAlta drauf gestanden hätte, würde sich diese Frage wahrscheinlich nicht stellen. ;-)

Antwort von j.t.jefferson:

Wieviele Gigabyte sind denn eine Minute in dem Codec bei 25fps?

Antwort von rush:

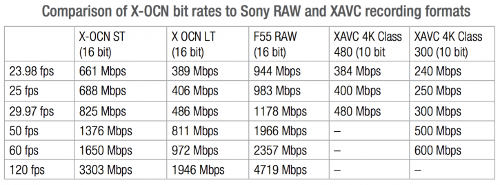

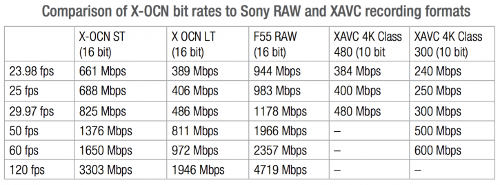

Bezüglich X-OCN allgemeiner (Artikel ist von 2016...):

https://www.slashcam.de/news/single/Fas ... 13036.html

Dort sind auch die Datenraten bis 4k 120fps in Verbindung mit dem damaligen R7 Andockrekorder gelistet:

Antwort von

Antwort von andieymi:

pillepalle hat geschrieben:

RAW bedeutet ja nur das es sich um die undebayerten, nicht veränderbaren Sensordaten handelt. Um sie dauerhaft zu ändern, muss man sie in einem anderen Format speichern. Mir ist schon klar, dass das Red-Patent vermutlich damit zu tun hat, denn ohne Kompression ist RAW im Filmbereich ja eher witzlos. Nur ändert das ja nichts daran, dass man dem Nutzer sagen könnte was für Daten er bekommt, bzw inwieweit sie verändert wurden.

Das liegt glaube ich stark daran, dass das keine Kameras sind, wo sich Foren voll Leute die Finger über die exakte Auslegung des Wortes 'Raw' wund schreiben, sondern die "Werkzeug"-Sichtweise überwiegt:

Wer zum ersten Mal darauf drehen will, geht sowieso üblicherweise mehr als einen Tag testen und schaut sich die eigenen Tests in der gewünschten Umgebung an. Ist das Kino, auch im Kino.

Nichts für ungut, ich hab das bei Leuten die auf nichts anderem Drehen (Arri, Sony, Red vl noch weniger) nie so wahrgenommen, dass das wen interessiert. Es ist legitim die Fragen zu stellen, aber eigentlich interessiert es vor allem Foristen.

Da ist dann auch relativ egal ob das jetzt Fake-Raw, eigentlich besseres ProRes oder wie auch immer der Hersteller in der Formulierung trickst - solang die Resultate die Erwartungshalten Pre-Test bestätigen, wird das Ding verwendet, egal ob da Roh oder Geschnitten draufsteht.

Nichts für ungut, aber Sony lässt sich da sowieso nicht in die Karten schauen. Genau so wie bei Red nur über Umwege rauskam, dass im R3D von Komodo & Raptor jetzt DCT statt Wavelet (bis DSMC2) steckt. Das interessiert eigentlich keinen, solange die Resultate stimmen.

Soweit ich weiß hat Sony das Red Patent durch den eigentlich extern verkauften, wenn auch quasi nahtlos an die Kamera integrierbaren AXS Recorder umgangen und bei der Venice 2 zahlen sie jetzt tatsächlich an Red.

So als nette Anekdote: Scheinbar wusste Deakins bis Sicario nicht, dass Alexa auch Open Gate kann, weil's ihn nie interessiert hat. Muss es ja auch nicht, weil die Master Primes Open Gate unzureichend covern, zumidnest im Weitwinkel in den üblichen Blenden. Die sind für S35 angegeben, 2K S35 war damals was gedreht wurde und dann hat ihm mal wer für ne Totale Open Gate reingegeben weil's gepasst hat. Ich weiß nicht wie viel davon stimmt, gesagt hat der Mann das so selbst. Aber das sind tatsächlich glaube ich keine Gedanken, die auf dem Level eine Rolle spielen. Technik muss in dem Umfang, indem sie wichtig ist funktionieren, für mehr Gedanken bleibt eh keine Zeit und ist jede Sekunde besser in der Kooperation mit anderen Departmens (Regie, Production Design, Licht, Grip) aufgewendet. Nur um die Sichtweise von Haupt-Nutzern dieser Kameras zu erklären.

Antwort von iasi:

andieymi hat geschrieben:

Das liegt glaube ich stark daran, dass das keine Kameras sind, wo sich Foren voll Leute die Finger über die exakte Auslegung des Wortes 'Raw' wund schreiben, sondern die "Werkzeug"-Sichtweise überwiegt:

Wer zum ersten Mal darauf drehen will, geht sowieso üblicherweise mehr als einen Tag testen und schaut sich die eigenen Tests in der gewünschten Umgebung an. Ist das Kino, auch im Kino.

Nichts für ungut, ich hab das bei Leuten die auf nichts anderem Drehen (Arri, Sony, Red vl noch weniger) nie so wahrgenommen, dass das wen interessiert. Es ist legitim die Fragen zu stellen, aber eigentlich interessiert es vor allem Foristen.

So technikfern denken diese Leute aber eben doch nicht.

Denen ist eben schon auch klar, dass sie bei Arri unkomprimiertes Raw bekommen, dann aber eben auf hohe Auflösungen verzichten müssen.

Bei Sony erhalten sie nun eben eine für 4k ideale Bayer-Auflösung von 8k, aber eben kein unkomprimiertes Raw.

Das ist bei Red dasselbe.

Diese Leute setzen sich eben durchaus mit ihren Werkzeugen auseinander. Wie zu Negativ-Zeiten wählen sie sehr genau das "Aufnahmematerial".

Und ein Roger Deakins war dann eben auch zunächst erschrocken, als er hörte, dass Skyfall auch im IMAX in 4k gespielt werden sollte. Denn er fürchtete vor allem um die Farbwiedergabe des ARRIRAW 2.8K source-Materials.

Ein Messerschmidt quält dann eben das ProRes Raw der DJI 4D mit garstigem Licht, um zu sehen, wie sich das 12bit-Material verhält.

Was nicht sonderlich ins Gewicht fällt, sind die Datenmengen, die während des Drehs erzeugt werden.

Aber die Datenrate von unkomprimiertem Raw bekommt man eben auch heute noch nicht bei einer Auflösung von 8k weggeschrieben.

Antwort von andieymi:

Wir werden wohl nicht mehr übereinstimmen, aber selten so technizentrierte Argumentation gelesen.

Niemand macht sich auf dem Level Gedanken um ideale Bayer-Auflösungen. Nicht umsonst würde Arri einen UHD Upscale überhaupt kameraintern anbieten, da gibt sich jeder Bayer-Auflösungsfanatiker doch lieber die Kugel als sowas auch nur ohne Handschuhe anzugreifen.

Auflösung ist für jene DPs auch nur ein Mittel. Niemand, der mit Fincher arbeitet hat Letztentscheidung über Kadrage, deshalb lässt Fincher nur Extraction-Kadrage am Set zu, der Rest wird in der Post Pixelgeschubst. Drum dreht auch niemand für Fincher auf Arri, die Auflösung ist nicht da.

Keiner macht sich Gedanken über Bayer-Auflösung, während er aus dem Panavision Keller gekramte 60er Jahre Anamorphotem mit Randundschärfe wie Flaschenböden testet. Vielleicht mal 4K S35 gegen 6K FF gegen 8K S35. Aber auch dann passiert die Entscheidung resultatbasiert und nicht technik-a-priorisch. Vielleicht unterbewusst, aber da ist nie das Hauptkriterium, wetten? Sondern immer resultatbasierte Wahrnehmung statt technisch-zentriertem Vorwissen allein.

Nach der Logik gäbe es keine anderen Grund außer auf Arri zu drehen weil die das unkomprimierteste Raw haben. Das passiert oft (aber nicht deswegen!), aber es gibt genügend Großproduktionen auf Venice oder Red. Glaubst Du wirklich Fincher interessiert ob das Raw von Red komprimiert ist? Glaubst Du wirklich Miranda dreht Cruise für Top Gun auf Venice wegen Rialto und weint heimlich am Abend weil er kein unkomprimiertes .ari rausbekommt von der Footage, die dieser danach nie persönlich in die Finger bekommt, sondern 3 Tage heim Grading danebensitzt und die restlichen 3 Wochen passieren dann ohnehin ohne ihn.

Antwort von Jott:

iasi hat geschrieben:

So technikfern denken diese Leute aber eben doch nicht.

Denen ist eben schon auch klar, dass sie bei Arri unkomprimiertes Raw bekommen, dann aber eben auf hohe Auflösungen verzichten müssen.

Bei Sony erhalten sie nun eben eine für 4k ideale Bayer-Auflösung von 8k, aber eben kein unkomprimiertes Raw.

Das ist bei Red dasselbe.

Diese Leute setzen sich eben durchaus mit ihren Werkzeugen auseinander. Wie zu Negativ-Zeiten wählen sie sehr genau das "Aufnahmematerial".

Und ein Roger Deakins war dann eben auch zunächst erschrocken, als er hörte, dass Skyfall auch im IMAX in 4k gespielt werden sollte. Denn er fürchtete vor allem um die Farbwiedergabe des ARRIRAW 2.8K source-Materials.

Ein Messerschmidt quält dann eben das ProRes Raw der DJI 4D mit garstigem Licht, um zu sehen, wie sich das 12bit-Material verhält.

Was nicht sonderlich ins Gewicht fällt, sind die Datenmengen, die während des Drehs erzeugt werden.

Aber die Datenrate von unkomprimiertem Raw bekommt man eben auch heute noch nicht bei einer Auflösung von 8k weggeschrieben.

Ich glaub, so viele Allwissen suggerierende eben hast du noch nie in einem Post untergebracht! :-)

Antwort von iasi:

Jott hat geschrieben:

iasi hat geschrieben:

So technikfern denken diese Leute aber eben doch nicht.

Denen ist eben schon auch klar, dass sie bei Arri unkomprimiertes Raw bekommen, dann aber eben auf hohe Auflösungen verzichten müssen.

Bei Sony erhalten sie nun eben eine für 4k ideale Bayer-Auflösung von 8k, aber eben kein unkomprimiertes Raw.

Das ist bei Red dasselbe.

Diese Leute setzen sich eben durchaus mit ihren Werkzeugen auseinander. Wie zu Negativ-Zeiten wählen sie sehr genau das "Aufnahmematerial".

Und ein Roger Deakins war dann eben auch zunächst erschrocken, als er hörte, dass Skyfall auch im IMAX in 4k gespielt werden sollte. Denn er fürchtete vor allem um die Farbwiedergabe des ARRIRAW 2.8K source-Materials.

Ein Messerschmidt quält dann eben das ProRes Raw der DJI 4D mit garstigem Licht, um zu sehen, wie sich das 12bit-Material verhält.

Was nicht sonderlich ins Gewicht fällt, sind die Datenmengen, die während des Drehs erzeugt werden.

Aber die Datenrate von unkomprimiertem Raw bekommt man eben auch heute noch nicht bei einer Auflösung von 8k weggeschrieben.

Ich glaub, so viele Allwissen suggerierende eben hast du noch nie in einem Post untergebracht! :-)

Das hat nichts mit "allwissend" zu tun, sondern mit "belegbar".

Zu einer Argumentation gehört dies eben dazu, denn nur behaupten genügt eben nicht.

Antwort von iasi:

andieymi hat geschrieben:

Wir werden wohl nicht mehr übereinstimmen, aber selten so technizentrierte Argumentation gelesen.

Niemand macht sich auf dem Level Gedanken um ideale Bayer-Auflösungen. Nicht umsonst würde Arri einen UHD Upscale überhaupt kameraintern anbieten, da gibt sich jeder Bayer-Auflösungsfanatiker doch lieber die Kugel als sowas auch nur ohne Handschuhe anzugreifen.

Auflösung ist für jene DPs auch nur ein Mittel. Niemand, der mit Fincher arbeitet hat Letztentscheidung über Kadrage, deshalb lässt Fincher nur Extraction-Kadrage am Set zu, der Rest wird in der Post Pixelgeschubst. Drum dreht auch niemand für Fincher auf Arri, die Auflösung ist nicht da.

Keiner macht sich Gedanken über Bayer-Auflösung, während er aus dem Panavision Keller gekramte 60er Jahre Anamorphotem mit Randundschärfe wie Flaschenböden testet. Vielleicht mal 4K S35 gegen 6K FF gegen 8K S35. Aber auch dann passiert die Entscheidung resultatbasiert und nicht technik-a-priorisch. Vielleicht unterbewusst, aber da ist nie das Hauptkriterium, wetten? Sondern immer resultatbasierte Wahrnehmung statt technisch-zentriertem Vorwissen allein.

Nach der Logik gäbe es keine anderen Grund außer auf Arri zu drehen weil die das unkomprimierteste Raw haben. Das passiert oft (aber nicht deswegen!), aber es gibt genügend Großproduktionen auf Venice oder Red. Glaubst Du wirklich Fincher interessiert ob das Raw von Red komprimiert ist? Glaubst Du wirklich Miranda dreht Cruise für Top Gun auf Venice wegen Rialto und weint heimlich am Abend weil er kein unkomprimiertes .ari rausbekommt von der Footage, die dieser danach nie persönlich in die Finger bekommt, sondern 3 Tage heim Grading danebensitzt und die restlichen 3 Wochen passieren dann ohnehin ohne ihn.

Es geht doch gar nicht so sehr um die Detailauflösung. Deakins fürchtete z.B., dass beim Upscaling auf 4k die Farben leiden würden.

Der debayer-Prozess profitiert nun einmal von einer Sensorauflösung von 8k. Da ist man eben schon recht nah am Optimum.

Das Ganze dann in einem technisch lossless-Raw-Format wäre ideal - aber eben (noch) nicht umsetzbar.

Fincher wird sicherlich bei der Komprimierungsrate kompromisslos sein und die geringsten Qualitätsverluste anstreben.

Bei der Red Raptor hat man diese Wahl:

REDCODE HQ, MQ and LQ at 8K 17:9 (8192 x 4320) up to 60 fps

Wofür würdest du dich entscheiden?

Was die Auflösung und Objektive betrifft, gibt"s hier etwas Interessantes zu lesen:

https://www.fdtimes.com/2022/03/16/cook ... me-primes/

Was die Sony Venice 2 betrifft, denke ich, dass wir damit doch fast schon am Ziel sind, bedenkt man den Weg den Digitale Cine-Cams zurückgelegt haben.

8k-Bayersensor für 4k

Vollformat

HFR

ein sehr hochweriges Raw-Format

annähernd GlobalShutter

hohe Empfindlichkeit

...

Und andere Kameras sind ebenfalls nah an diesem Niveau und bieten dabei andere Einsatzschwerpunkte.

Was will man eigentlich mehr?

Antwort von andieymi:

iasi hat geschrieben:

Fincher wird sicherlich bei der Komprimierungsrate kompromisslos sein und die geringsten Qualitätsverluste anstreben.

In der Tat nicht.

Mindhunter war 8:1 bei 6.5K Extraction aus dem 8K.

https://thefincheranalyst.com/2019/09/1 ... eason-two/

(Optimum wäre 5:1)

Es ist teilweise tatsächlich schwer die tatsächlichen Kompressionsraten aus Interviews rauszubekommen, aber bei Mank war es auch 6.5K aus aus 8K.

Fraser hat für Dune die Digital-Footage nach kurzem Grade noch Ausbelichten lassen, vom Film neu gescannt und dann erst in die Color gestartet:

https://postperspective.com/cinematogra ... m-process/

Letzteres ist auch eine technische Herangehensweise an Ästhetik, aber nicht aus dem Willen einer technischen Optimierung heraus. In der Praxis bedeutet das auf dem Level einfach fast immer das Gegenteil von dem, was Du machen würdest. Da geht's nicht um Bayer-Auflösung, sondern im Endeffekt um weniger nutzbare Auflösung in fast jedem Punkt der Pipeline, der kontrollierbar ist. Klar, keiner will Verlust durch schlechte Codecs, aber die Kompression wird auch so gewählt, dass das der Nutzen erfüllt ist (UND NICHT DARÜBER HINAUS!). Keiner will Verschlechterung durch verlustbehaftete Intermediate-Codecs (im Gegenteil: 32-Bit Blowup für VFX quasi Standard), aber da wo es kontrollierbar ist (Optiken, Filter(!), Digital-Film-Transfer) eher Auflösungsreduktion.

Deakins ist da tatsächlich oft eine Ausnahme, der ist auch gefühlt der einzige der ohne Filtration dreht, was aber auch daran liegen mag, dass er bisher immer Arri und "nur" 3.4K (Ausnahme 1917) gefahren ist und kein 6-8K. Die Sorge vor Upscaling kommt vermutlich aus einer Zeit, wo das tatsächlich ein No-Go gewesen wäre. Heute sind Algorithmen wirklich gut, werden immer besser und schneller, nicht umsonst würde Arri die Möglichkeit überhaupt anbieten, das ist so ziemlich die konservativste Firma im Kamerabereich (was nicht negativ gemeint ist, nur eine Haltung beschreibt, die umgekehrt extreme Verlässlichteit und Sicherheit zur Folge hat).

iasi hat geschrieben:

Bei der Red Raptor hat man diese Wahl:

REDCODE HQ, MQ and LQ at 8K 17:9 (8192 x 4320) up to 60 fps

Wofür würdest du dich entscheiden?

Aufgrund meiner Tests die Einzige meiner Meinung nach richtige Antwort: Das hängt 100% vom Projekt ab. Als Dienstleister bist Du nicht verpflichtet, die technisch-möglich beste Qualität zu liefern (wenn es für den Kunden Verzögerungen oder Mehrkosten bedeutet, und dieser nichts vom Nutzen (selbst unterbewusst) mitbekommt, sondern die richtige und angemessene Qualität und das muss nicht immer HQ sein. Wenn deine Kunden Pendler sind, wirst Du aus dem Anspruch heraus das bestmöglichste Auto über Hubraum/Leistung zu definieren nicht weit kommen. Und tatsächlich hat Red da die Hausaufgaben gemacht, meine Erfahrungen decken sich 1:1 mit der Herstellervorgabe.

("For high complexity scenes, VFX, and stills from motion workflows, RED recommends the HQ setting. For cinema (non-VFX) and high-end TV, RED recommends the MQ setting. For TV, online content, documentary and interviews, RED recommends the LQ setting.")

Ich kann in der Nutzung keinerlei Unterschiede in der Farbflexibilität gegenüber den einzelnen Stufen feststellen, das wäre tatsächlich ein KO-Kriterium. Es verbiegt aber auch niemand Sonnenlbumengelbe Pullis im Kostüm zu Navy-Blau im Grading weil man lustig ist, sowas passiert einfach am Set und dafür hat in der Post auch niemand Zeit, dafür gibt's das in camera Mantra. Und das ist auch auf keinem Level das Ziel.

Das bedeutet im Normalfall:

LQ für reinen Web-Content, der durch stärkere Kompression muss und oder extreme Drehrations oder Laufzeiten (Doku). Da ist tatsächlich als einziges ein visueller Verlust an feinsten Details (Zeichnung von Blättern auf Bäumen hinten in Totalen, Texturen, etc. zwischen LQ vs. MQ/HQ) vor Komprimierung sichtbar. Allerdings sind das Nuancen. Aber immerhin Nuancen.

MQ ist für alles gut genug was an den ORF geht und neben 20:15-Spielfilm (als Werbung) läuft bzw. im Kino vor den eigentlichen Filmen.

HQ für alles mit Keying (allerdings dann auch oft Einstellungs-Spezifisch als Ausnahme), für normales Compositing / Retusche etc.

Wo man im Unterschied zum bisherigen Wavelet tatsächlich einen Unterschied merkt ist wie LQ bei Unterbelichtung eher wegbricht, das deckt sich auch mit meinen Erfahrungen zu X-OCN, bei Belichtung an der Grenze zeigen sich schon Vorteile von LQ vs ST/XT. Blöd, weil alles was dokumentarischer (ich sag nicht Doku) gedreht wird, gleichzeitig von höheren Stufen profitieren kann, aber das hilft nichts.

iasi hat geschrieben:

Das hat nichts mit "allwissend" zu tun, sondern mit "belegbar".

Zu einer Argumentation gehört dies eben dazu, denn nur behaupten genügt eben nicht.

Aber dann bring doch einmal ein paar Beispiele, sagen wir von den besten der Branche wie ich es versucht habe, wo deine Argumentation untermauert wird. Wo sind die ASC-DPs die hinsichtlich Bayer-Auflösung testen, optikseitig alles auf höchste Auflösung optimieren - sich vielleicht sogar durch algorithmusseitiges Upscaling überlegt haben mehr Details rauszukitzeln.

Mich würde das wirklich interessieren, denn bis jetzt ist alles was Du machst "eben" behaupten, alle würden das technisch-bestmögliche automatisch verwenden und ich habe schon mittlerweile genügend Beispiele gebracht, wo das von branchenweit anerkannten DPs, Academy-Award-Preisträgern anders gemacht wird.

Es wäre mal an der Zeit, statt deine Argumentationen mit "eben" zu versehen, auch mal Beispiele oder Quellen zu nennen.

iasi hat geschrieben:

Was will man eigentlich mehr?

pillepalle hat geschrieben:

Es geht ja nicht um ein Wort, sondern einfach darum um was für eine Art Daten es sich dabei handelt. Warum wird das im Filmbereich so selten klar kommuniziert?

Scheinbar eh nur klarere Kommunikation gegenüber den Benutzern. Ich glaube darüberhinaus mehr zu wollen wäre vermessen, es gab nie eine größere Zahl an quasi perfekten Kameras als zum heutigen Zeitpunkt.

Antwort von iasi:

andieymi hat geschrieben:

iasi hat geschrieben:

Fincher wird sicherlich bei der Komprimierungsrate kompromisslos sein und die geringsten Qualitätsverluste anstreben.

In der Tat nicht.

Mindhunter war 8:1 bei 6.5K Extraction aus dem 8K.

https://thefincheranalyst.com/2019/09/1 ... eason-two/

(Optimum wäre 5:1)

Wobei Helium bei 8k und 5.1 nur 24fps liefert.

Gedreht wurde in 8k für Video/Netflix.

Das ist wiederum interessant:

"Out of the 8K raster we framed for a 6.5K extraction area, which left room for stabilization in post."

andieymi hat geschrieben:

Es ist teilweise tatsächlich schwer die tatsächlichen Kompressionsraten aus Interviews rauszubekommen, aber bei Mank war es auch 6.5K aus aus 8K.

Wobei das ja nichts mit der Kompressionsrate zu tun hat.

andieymi hat geschrieben:

Fraser hat für Dune die Digital-Footage nach kurzem Grade noch Ausbelichten lassen, vom Film neu gescannt und dann erst in die Color gestartet:

https://postperspective.com/cinematogra ... m-process/

Letzteres ist auch eine technische Herangehensweise an Ästhetik, aber nicht aus dem Willen einer technischen Optimierung heraus. In der Praxis bedeutet das auf dem Level einfach fast immer das Gegenteil von dem, was Du machen würdest. Da geht's nicht um Bayer-Auflösung, sondern im Endeffekt um weniger nutzbare Auflösung in fast jedem Punkt der Pipeline, der kontrollierbar ist.

Ich denke, dass hier das Ziel war, den weichen Kornfluß von Filmmaterial zu erhalten.

Der größte Unterschied zwischen Negativ und Sensor ist das sich von Bild zu Bild ändernde Kornmuster und die starre Pixelanordnung.

Gerade aufgrund dieses "Kornflusses" lässt sich die Auflösung eines Negativfilms eben nicht an einem Einzelbild ermitteln.

andieymi hat geschrieben:

Klar, keiner will Verlust durch schlechte Codecs, aber die Kompression wird auch so gewählt, dass das der Nutzen erfüllt ist (UND NICHT DARÜBER HINAUS!). Keiner will Verschlechterung durch verlustbehaftete Intermediate-Codecs (im Gegenteil: 32-Bit Blowup für VFX quasi Standard), aber da wo es kontrollierbar ist (Optiken, Filter(!), Digital-Film-Transfer) eher Auflösungsreduktion.

Deakins ist da tatsächlich oft eine Ausnahme, der ist auch gefühlt der einzige der ohne Filtration dreht, was aber auch daran liegen mag, dass er bisher immer Arri und "nur" 3.4K (Ausnahme 1917) gefahren ist und kein 6-8K. Die Sorge vor Upscaling kommt vermutlich aus einer Zeit, wo das tatsächlich ein No-Go gewesen wäre. Heute sind Algorithmen wirklich gut, werden immer besser und schneller, nicht umsonst würde Arri die Möglichkeit überhaupt anbieten, das ist so ziemlich die konservativste Firma im Kamerabereich (was nicht negativ gemeint ist, nur eine Haltung beschreibt, die umgekehrt extreme Verlässlichteit und Sicherheit zur Folge hat).

iasi hat geschrieben:

Bei der Red Raptor hat man diese Wahl:

REDCODE HQ, MQ and LQ at 8K 17:9 (8192 x 4320) up to 60 fps

Wofür würdest du dich entscheiden?

Aufgrund meiner Tests die Einzige meiner Meinung nach richtige Antwort: Das hängt 100% vom Projekt ab. Als Dienstleister bist Du nicht verpflichtet, die technisch-möglich beste Qualität zu liefern (wenn es für den Kunden Verzögerungen oder Mehrkosten bedeutet, und dieser nichts vom Nutzen (selbst unterbewusst) mitbekommt, sondern die richtige und angemessene Qualität und das muss nicht immer HQ sein. Wenn deine Kunden Pendler sind, wirst Du aus dem Anspruch heraus das bestmöglichste Auto über Hubraum/Leistung zu definieren nicht weit kommen. Und tatsächlich hat Red da die Hausaufgaben gemacht, meine Erfahrungen decken sich 1:1 mit der Herstellervorgabe.

("For high complexity scenes, VFX, and stills from motion workflows, RED recommends the HQ setting. For cinema (non-VFX) and high-end TV, RED recommends the MQ setting. For TV, online content, documentary and interviews, RED recommends the LQ setting.")

Ich kann in der Nutzung keinerlei Unterschiede in der Farbflexibilität gegenüber den einzelnen Stufen feststellen, das wäre tatsächlich ein KO-Kriterium. Es verbiegt aber auch niemand Sonnenlbumengelbe Pullis im Kostüm zu Navy-Blau im Grading weil man lustig ist, sowas passiert einfach am Set und dafür hat in der Post auch niemand Zeit, dafür gibt's das in camera Mantra. Und das ist auch auf keinem Level das Ziel.

Das bedeutet im Normalfall:

LQ für reinen Web-Content, der durch stärkere Kompression muss und oder extreme Drehrations oder Laufzeiten (Doku). Da ist tatsächlich als einziges ein visueller Verlust an feinsten Details (Zeichnung von Blättern auf Bäumen hinten in Totalen, Texturen, etc. zwischen LQ vs. MQ/HQ) vor Komprimierung sichtbar. Allerdings sind das Nuancen. Aber immerhin Nuancen.

MQ ist für alles gut genug was an den ORF geht und neben 20:15-Spielfilm (als Werbung) läuft bzw. im Kino vor den eigentlichen Filmen.

HQ für alles mit Keying (allerdings dann auch oft Einstellungs-Spezifisch als Ausnahme), für normales Compositing / Retusche etc.

Wo man im Unterschied zum bisherigen Wavelet tatsächlich einen Unterschied merkt ist wie LQ bei Unterbelichtung eher wegbricht, das deckt sich auch mit meinen Erfahrungen zu X-OCN, bei Belichtung an der Grenze zeigen sich schon Vorteile von LQ vs ST/XT. Blöd, weil alles was dokumentarischer (ich sag nicht Doku) gedreht wird, gleichzeitig von höheren Stufen profitieren kann, aber das hilft nichts.

Abgesehen vom Zielmedium spielt aber eben auch der Bildinhalt und die Aufnahmesituation eine große Rolle.

Bei einer Einstellung kannst du sogar bei LQ auf der großen Leinwand keine Kompressionsverluste erkennen, aber bei einer anderen Einstellung kommt sogar MQ an die Grenzen.

Nicht jeder Bildinhalt lässt sich gleich gut komprimieren.

andieymi hat geschrieben:

iasi hat geschrieben:

Das hat nichts mit "allwissend" zu tun, sondern mit "belegbar".

Zu einer Argumentation gehört dies eben dazu, denn nur behaupten genügt eben nicht.

Aber dann bring doch einmal ein paar Beispiele, sagen wir von den besten der Branche wie ich es versucht habe, wo deine Argumentation untermauert wird. Wo sind die ASC-DPs die hinsichtlich Bayer-Auflösung testen, optikseitig alles auf höchste Auflösung optimieren - sich vielleicht sogar durch algorithmusseitiges Upscaling überlegt haben mehr Details rauszukitzeln.

Man muss doch nicht das Rad jedesmal neu erfinden.

Du hast doch z.B. selbst einen Link hier geteilt, in dem Messerschmidt sagt:

"We did extensive lighting, color and workflow tests prior to the decision to switch camera sensors"

Und hier auf Slashcam bekommt man doch zu jeder Kamera gerade diese Tests, die ich nun als Beispiel nennen soll.

Zur Venice 2 kann man dann lesen:

"Es sind praktisch alle 4K-Details sichtbar - und dies nahezu artefaktfrei. Dieses bestmögliche Ergebnis ist einem 2:1-Sensor-Readout geschuldet, der zudem noch im RAW-ähnlichen X-OCN aufgezeichnet wurde."

andieymi hat geschrieben:

Mich würde das wirklich interessieren, denn bis jetzt ist alles was Du machst "eben" behaupten, alle würden das technisch-bestmögliche automatisch verwenden und ich habe schon mittlerweile genügend Beispiele gebracht, wo das von branchenweit anerkannten DPs, Academy-Award-Preisträgern anders gemacht wird.

Es wäre mal an der Zeit, statt deine Argumentationen mit "eben" zu versehen, auch mal Beispiele oder Quellen zu nennen.

Man muss nicht für alles, was man als Kenntnis voraussetzen können muss, ein Beispiel bringen.

Dies hier ist ein Thread zu einem Kameratest. Da kann man wohl erwarten, dass den auch alle Diskussionsteilnehmer hier gelesen haben.

Zudem kann man doch wohl auch ein wenig logische Schlussfolgerung voraussetzen.

Wenn DPs zu Negativzeiten ausführlich Test gemacht und nur bestimmte Emmullsionschargen genutzt hatten, dann kann man wohl schlussfolgern, dass heutige DPs ausführliche Tests bei der Wahl einer digitalen Kamera machen.

Und wovon ich nun einmal einfach ausgehe:

Ein DP wird die für das Projekt bestmögliche Lösung anstreben, um das, was sich vor der Linse abspielt, festzuhalten.

andieymi hat geschrieben:

iasi hat geschrieben:

Was will man eigentlich mehr?

pillepalle hat geschrieben:

Es geht ja nicht um ein Wort, sondern einfach darum um was für eine Art Daten es sich dabei handelt. Warum wird das im Filmbereich so selten klar kommuniziert?

Scheinbar eh nur klarere Kommunikation gegenüber den Benutzern. Ich glaube darüberhinaus mehr zu wollen wäre vermessen, es gab nie eine größere Zahl an quasi perfekten Kameras als zum heutigen Zeitpunkt.

... digitalen Kameras ...

Antwort von klusterdegenerierung:

Herzlichen Glückwunsch, sie haben hiermit den längsten Post auf slashcam verfasst, sie erhalten einen Gewinn in Höhe von 346DM!

Vergessen sie nicht ihre Kontonummer anzugeben.

Antwort von iasi:

klusterdegenerierung hat geschrieben:

Herzlichen Glückwunsch, sie haben hiermit den längsten Post auf slashcam verfasst, sie erhalten einen Gewinn in Höhe von 346DM!

Vergessen sie nicht ihre Kontonummer anzugeben.

Und der Preis für die größte Anzahl an Beiträgen, die nichts mit dem Thema zu tun haben, geht an klusterdegenerierung.

Wie schon in der Schule erhalten Sie eine ... ;)

Antwort von ruessel: